Holy Sh*t,我的大便被卖给 AI 了

Holy Sh*t,我的大便被卖给 AI 了Reddit 上的 r/DHExchange 板块从来都不缺奇怪的交易。但月初的一个帖子,还是让见多识广的我打了个问号。「我囤积了一个非常有价值的大型数据库,只是不是你想的那种……15 万张粪便图像。」

搜索

搜索

Reddit 上的 r/DHExchange 板块从来都不缺奇怪的交易。但月初的一个帖子,还是让见多识广的我打了个问号。「我囤积了一个非常有价值的大型数据库,只是不是你想的那种……15 万张粪便图像。」

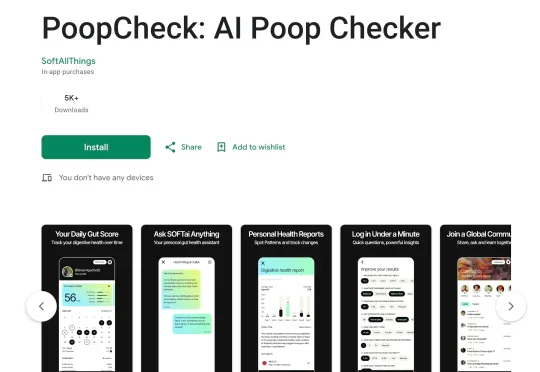

每次想让AI读个外部网站的信息,看到这句话头都要炸了。不过,GitHub有个开源项目OpenCLI把这事儿解决了:网站变命令行。Reddit讨论、B站热门、Arxiv论文,以前开浏览器一个个翻的东西,现在终端一行命令直接出结构化数据。

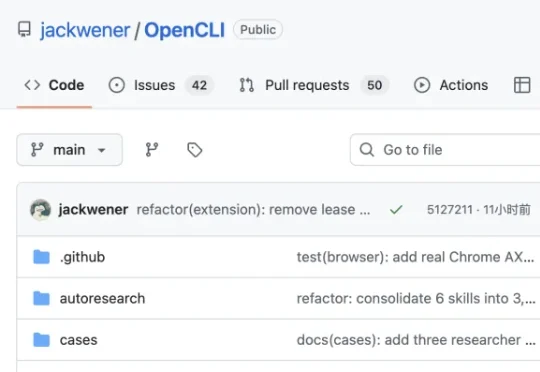

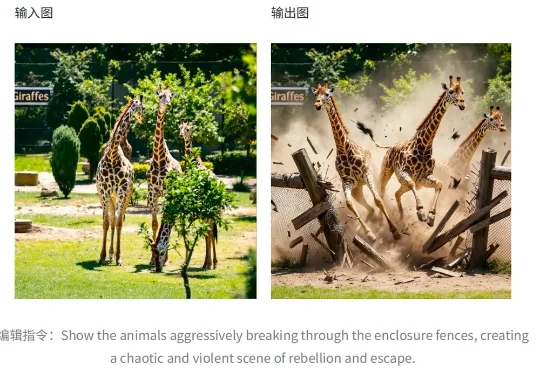

近日,字节跳动智能创作部门(Intelligent Creation Lab)提出新作 DreamLite,一个主干网络仅有 0.39B 参数的轻量级统一扩散模型,在单一网络内同时支持文生图(Text-to-Image) 和图像编辑(Text-guided Image Editing)两个任务,是目前已知首个实现这一能力的端侧模型。

我一直全程关注他打假的全过程,也一直有个想法:耿同学做的这些,能不能让 AI 分担一部分?这几天我琢磨了很久,也 Vibe Coding 了很久,最后做出来一个初版的 「学术打假 Skill——research-integrity-auditor」。

独家获悉,字节跳动日前低调公布全球首个25B级、基于混合专家 (MoE) -扩散自注意力机制(DiT) 的开源增强统一多模态模型Mamoda2.5。Mamoda2.5依托Qwen3-VL-8B、128 个专家,Top-8 路由的MoE+DiT架构搭建,最终模型参数高达250亿,而每次仅激活约30亿参数(约12%)。

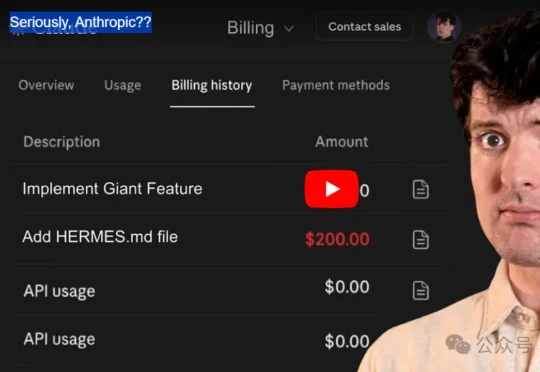

不是 Anthropic 主动通知,不是账单透明到让用户自己看出来,是一个 Reddit 帖子,一个 YouTube 视频,一堆截图,在社区里流传开了,才终于有官方工作人员在 X 的评论区回复,说这是第三方恶意工具引入的 BUG,已经退款并做了补偿。

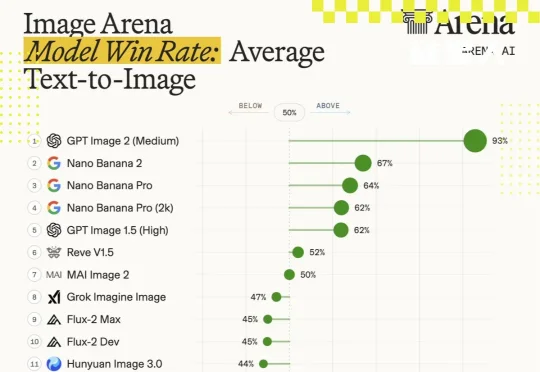

GPT Image 2 凭什么这么强?是扩散模型又迭代了一版?是把 DiT 的参数量从 7B 扩到 20B?是训了更多高质量数据?先给结论:OpenAI 很可能已经不在“纯扩散模型”这条主赛道上了。他们已经把图像生成从“美术课”调到了“语文课”——用一个能读懂指令、能记住上下文、能理解物体关系的 LLM 主导语义规划,至于最后一步的像素生成,可能由扩散组件或其他解码器完成。

社交网络应用 Series 宣布已筹集 510 万美元的种子前轮融资,投资者包括 Venmo 联合创始人 Iqram Magdon-Ismail、Pear VC、Reddit 首席执行官 Steve Huffman 以及 GPTZero 创始人 Edward Tian。该公司由耶鲁大学学生 Nathaneo Johnson 和 Sean Hargrow 于去年初创立,两人目前仍在该校就读大四。

Modus 以 8500 万美元 融资的消息却撬开了这块大陆,它引发的深远影响不仅仅关乎金钱的流动,而是深刻挑战了这个“稳固”的行业底层架构。本轮融资由 Lightspeed Venture Partners 领投,Garry Tan 等投资人参与,但更令人注目的是,这家公司没有走典型的 AI 路径

近日,京东开源图像模型JoyAI-Image-Edit,将空间智能纳入图像理解与编辑,让AI开始处理真实世界中的空间关系,让模型真正“理解空间,编辑空间”。简单解释,这是一个以空间智能为核心的图像生成与编辑模型,让 AI 真正“看懂”三维空间,从而让生成更合理、编辑更精准。