Gyges Labs会是AI+AR眼镜的未来答案吗?

Gyges Labs会是AI+AR眼镜的未来答案吗?对于硬件,对于AR,应该都不甚了解的某知名投资人朱啸虎,对自己出手的第一个AI硬件也是AI眼镜项目是如此评价:“Gyges Labs的DigiWindow技术相比其他等方案,有着一个非常重要的优势:它的显示模组隐形,能把内容投到眼睛,

对于硬件,对于AR,应该都不甚了解的某知名投资人朱啸虎,对自己出手的第一个AI硬件也是AI眼镜项目是如此评价:“Gyges Labs的DigiWindow技术相比其他等方案,有着一个非常重要的优势:它的显示模组隐形,能把内容投到眼睛,

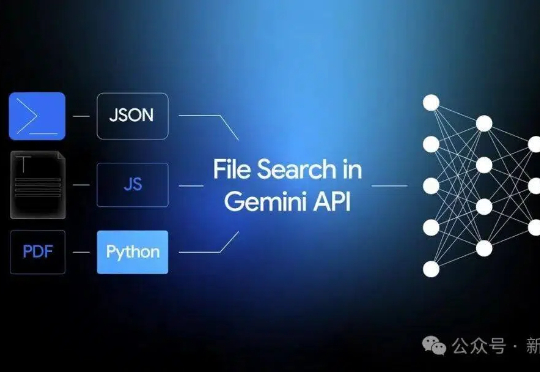

Google宣判RAG死刑!那条曾让无数工程师自豪的技术链,如今只剩下一行API调用。Gemini的File Search,把检索、分块、索引、引用,全都封进了模型内部。开发者不再需要理解流程,只需要上传文件。当智能被自动化吞并,工程师第一次发现,自己也成了被自动化的一部分。

美国加州大学圣地亚哥分校(UCSD)徐升教授对 DeepTech 表示:“很荣幸我们的工作成为 Nature Sensors 期刊的首篇论文,我们第一次通过 AI 的方法实现了在动态下抗运动伪影的人机交互,应用场景包括可穿戴和移动设备的手势控制、机器人遥操作、AR/VR 动作追踪、游戏、康复与辅助设备、工业与军事训练、健康与运动监测、

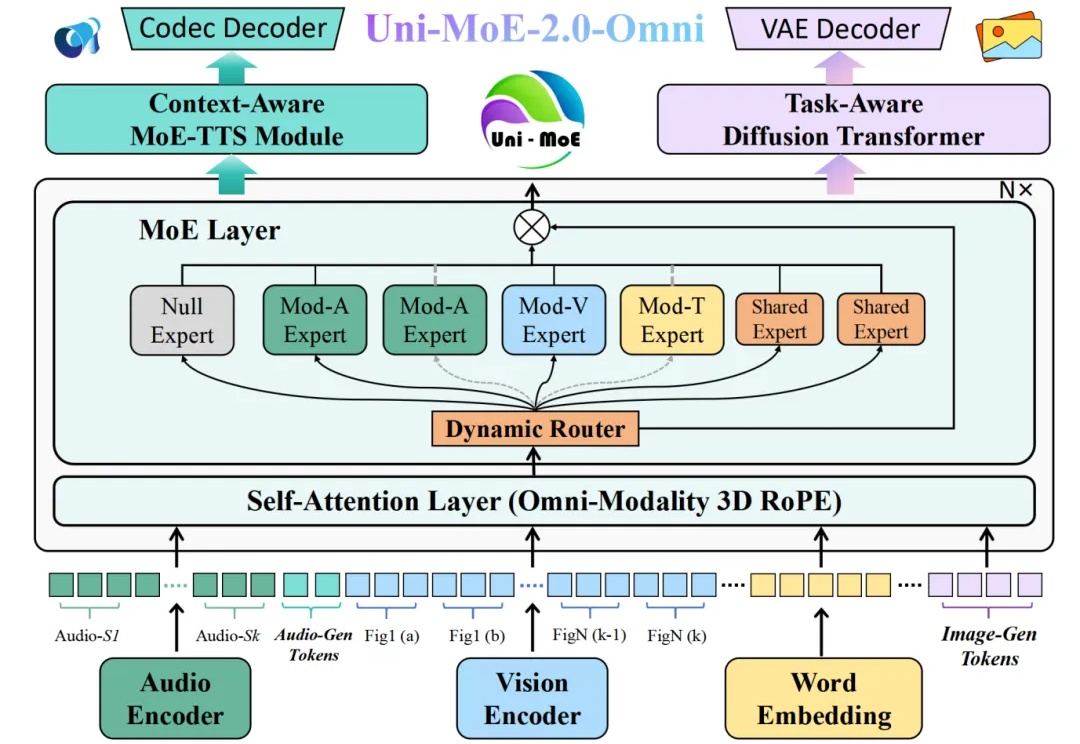

全模态大模型(Omnimodal Large Models, OLMs)能够理解、生成、处理并关联真实世界多种数据类型,从而实现更丰富的理解以及与复杂世界的深度交互。人工智能向全模态大模型的演进,标志着其从「专才」走向「通才」,从「工具」走向「伙伴」的关键点。

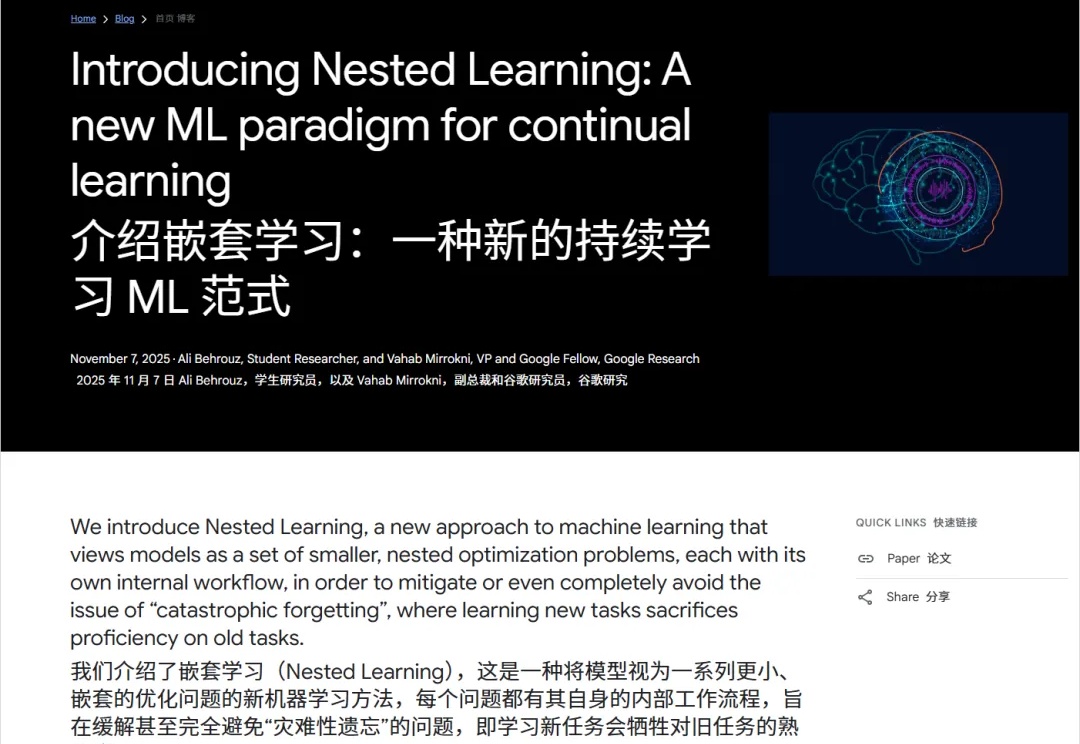

前两天,Google发了一个非常有趣的论文: 《Nested Learning: The Illusion of Deep Learning Architectures》

两个AI顶流终于是碰到了一起,这回设计师们真要慌了但也可能是大意过望了—— 因为Lovart,这个顶流设计师Agent,现在已经正式接入Nano Banana Pro了!

前天晚上谷歌推出了基于 Gemini 3 优化后的 Nano Banana Pro 模型,能力大幅提升,而且解决了多语言问题。

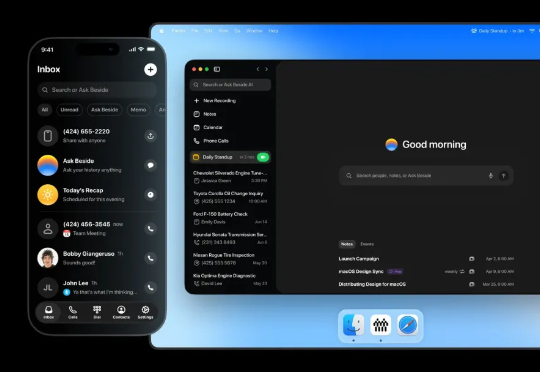

Beside 要解决的正是这个核心问题。他们并不是简单地在现有电话系统上加一层 AI,而是从底层重建了整个电话基础设施。这意味着他们能够直接接入电话网络,捕获每一通来电和短信,然后让 AI 在这些实时对话中发挥作用。

2025年11月,印度国会议员、前外交部国务部长沙希·塔鲁尔(Shashi Tharoor)在《印度教徒报》发表了一篇颇具影响力的专栏文章。文章中,他以“十字路口”为喻,描绘了印度IT产业的集体焦虑。

当AI能「看」见实验室的细节,能「听」见研究员的每一次反应,能「感知」实验进展的每一点变化——它的推理将不再局限于硅基世界。那时,AI将通过人类的双手,直接参与并改变物理现实。它或许将成为实验室中最勤奋、最可靠的「智能伙伴」。