"将注意力旋转90°":深入浅出解读 Kimi 最新出圈成果

"将注意力旋转90°":深入浅出解读 Kimi 最新出圈成果前几天,一篇来自Kimi的论文「ATTENTION RESIDUALS」在 AI 圈引发了激烈讨论——马斯克罕见地发出评价:"Impressive work from Kimi"。同时,两位前Openai大佬也同样发出了高度评价,OpenAI 「推理模型之父」Jerry Tworek表示“深度学习2.0时代即将到来”。

前几天,一篇来自Kimi的论文「ATTENTION RESIDUALS」在 AI 圈引发了激烈讨论——马斯克罕见地发出评价:"Impressive work from Kimi"。同时,两位前Openai大佬也同样发出了高度评价,OpenAI 「推理模型之父」Jerry Tworek表示“深度学习2.0时代即将到来”。

近日,金融AI领跑者讯兔科技(Alpha派)正式完成近2亿元A轮融资。继去年10月完成超亿元Pre-A轮融资后,讯兔科技在短短5个月内再获顶级机构强强加持。讯兔科技的核心团队成员均来自国内头部资管机构,拥有稀缺的投研基因。团队成员曾主导头部公募基金数字化体系建设,并曾在FactSet、标普全球、汤森路透等国际金融资讯巨头担任过技术研发与商业化核心高管。

看过 HBO 神剧《硅谷》(Silicon Valley)的朋友,想必都对那个名为 Pied Piper(魔笛手)的虚构公司念念不忘。

葬AI开源了两个项目,一个没有前端,一个没有后端。

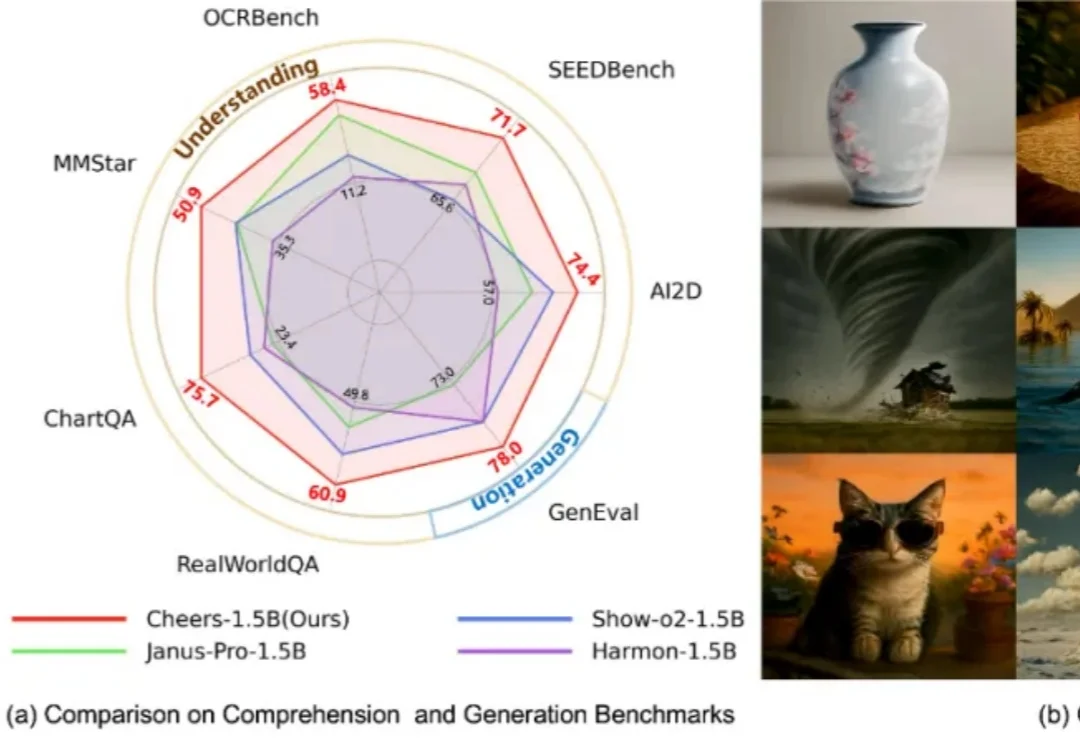

过去几年,多模态模型在理解任务上快速演进,图像问答、OCR、视觉推理、跨模态对话等能力不断提升;与此同时,图像生成模型也在视觉质量、指令遵循和细节表达上持续突破。下一步一个自然的问题是:能否用同一个模型,同时做好理解与生成?这正是统一多模态模型(Unified Multimodal Models, UMMs)正在回答的问题。

Salesforce最近在推的Einstein Agent,定位已经从Copilot(副驾驶)转向了真正的Agent(代理)。他们的客户服务Agent可以独立处理客户请求,销售Agent可以自主跟进线索。Google也在Workspace中推出了类似能力,Agent能够独立完成邮件处理、日程安排等任务。这不是个例,而是整个行业都在经历的范式转变。

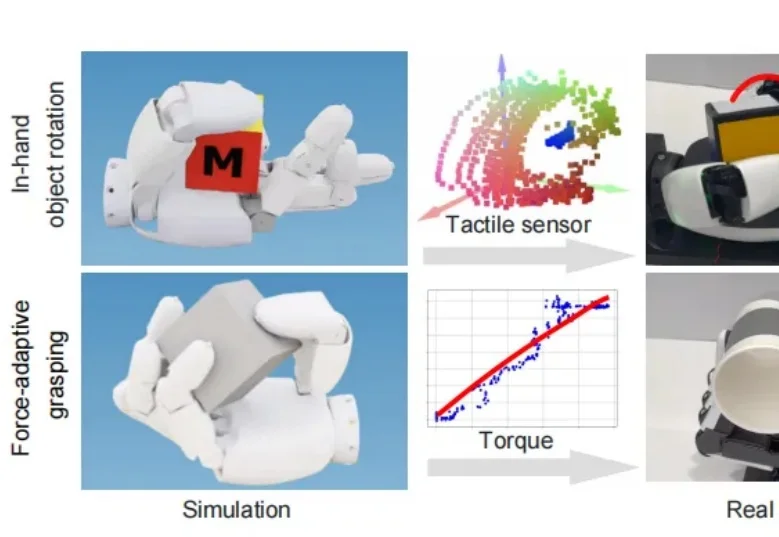

实现具备人类水平的灵巧操作能力,是机器人学领域长期以来的核心挑战之一。尽管多指灵巧手在硬件上具备了类似人类的潜力,但由于接触丰富的物理特性和非理想的驱动机制,训练能够直接部署在真实硬件上的控制策略仍然非常困难。

视频编辑应用 Captions 的开发商 Mirage 已从 General Catalyst 的客户价值基金(CVF)筹集了 7500 万美元的增长融资。

3月以来,港股AI股票又开始猛涨了。

Dash0 已在一轮由Balderton Capital 领投的融资中筹集了 1.1 亿美元,估值达到 10 亿美元,以将其用于检测软件系统问题的监控平台拓展至美国全境。