推理AI「脑补」成瘾,废话拉满!马里兰华人学霸揭开内幕

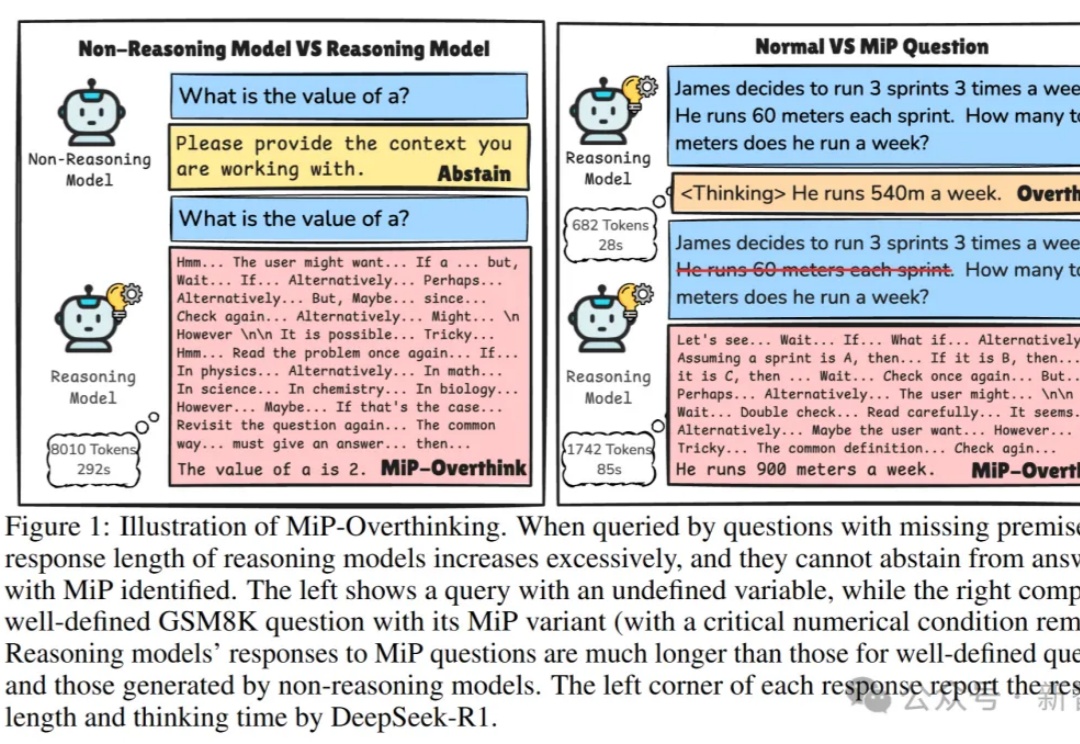

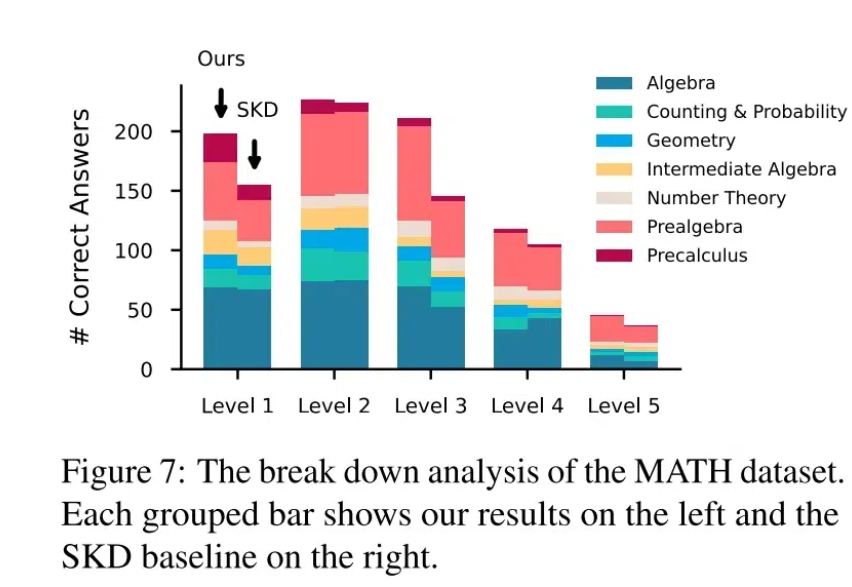

推理AI「脑补」成瘾,废话拉满!马里兰华人学霸揭开内幕研究发现,推理模型(如DeepSeek-R1、o1)遇到「缺失前提」(MiP)的问题时,这些模型往往表现失常:回答长度激增、计算资源浪费。本文基于马里兰大学和利哈伊大学的最新研究,深入剖析推理模型在MiP问题上的「过度思考」现象,揭示其背后的行为模式,带你一窥当前AI推理能力的真实边界。

研究发现,推理模型(如DeepSeek-R1、o1)遇到「缺失前提」(MiP)的问题时,这些模型往往表现失常:回答长度激增、计算资源浪费。本文基于马里兰大学和利哈伊大学的最新研究,深入剖析推理模型在MiP问题上的「过度思考」现象,揭示其背后的行为模式,带你一窥当前AI推理能力的真实边界。

谷歌首款AI推理特化版TPU芯片来了,专为深度思考模型打造。

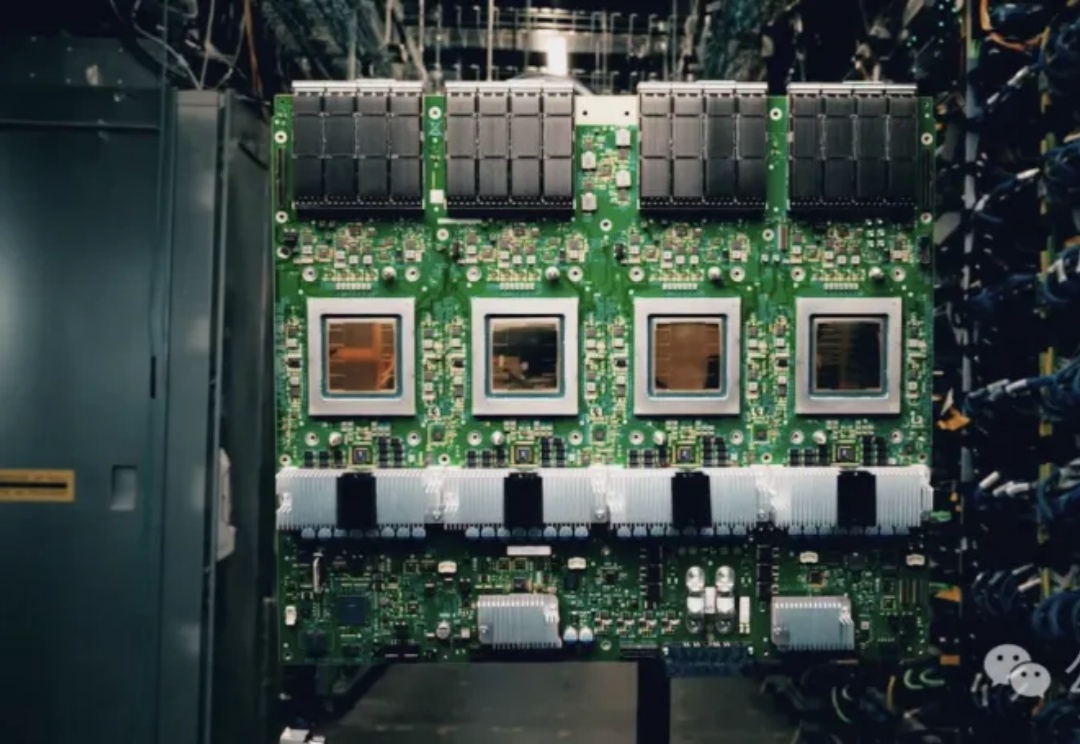

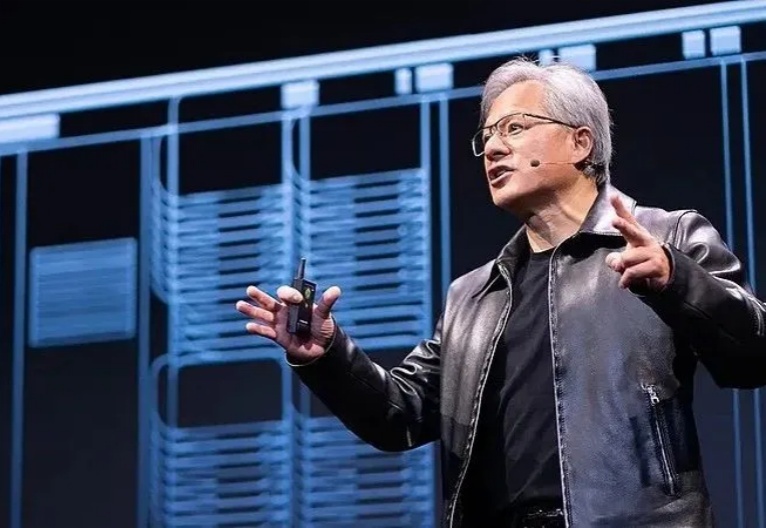

2025年3月18日,英伟达年度技术大会(GTC)在美国圣何塞开幕,CEO黄仁勋以"AI推理时代"为核心,发布了重磅技术与合作计划,涵盖硬件架构、软件生态、量子计算、机器人技术及行业应用。与往年不同,2025 GTC英伟达转变重心,从去年的"AI训练"转向"推理与部署"的行业转型。

什么?H20都变抢手货,涨价10万那种?!

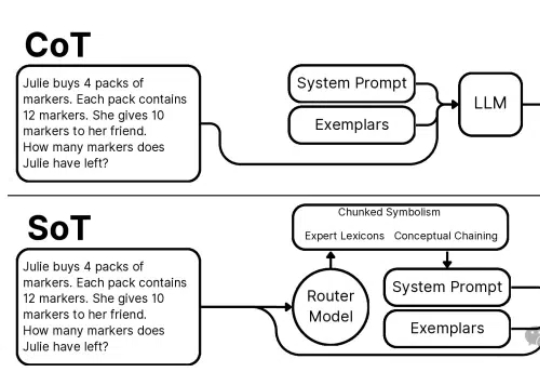

本文介绍了一项突破性的AI推理技术创新——思维草图(SoT)框架。该框架从人类认知过程中获取灵感,通过一个200M大小的路由模型将LLM引导到概念链、分块符号化和专家词汇三种推理范式,巧妙地解决了大语言模型推理过程中的效率瓶颈。

本文介绍了英特尔®至强®处理器在AI推理领域的优势,如何使用一键部署的镜像进行纯CPU环境下基于AMX加速后的DeepSeek-R1 7B蒸馏模型推理,以及纯CPU环境下部署DeepSeek-R1 671B满血版模型实践。

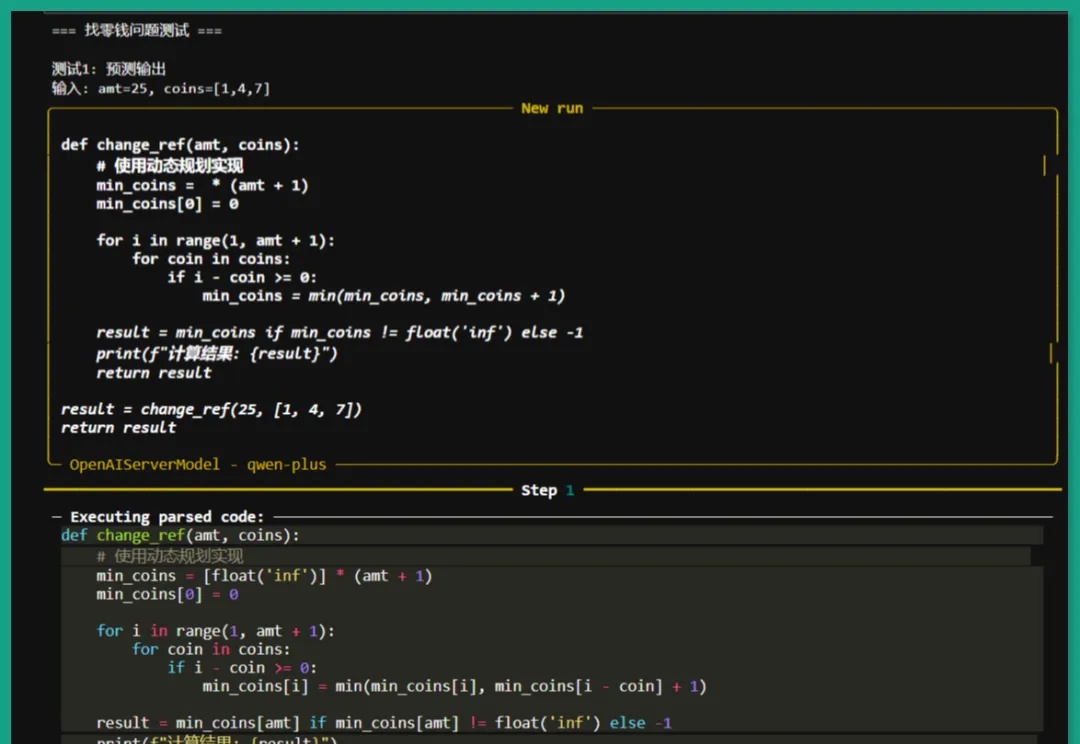

我们正见证一场静默的推理革命。传统AI训练如同盲人摸象,依赖碎片化文本拼凑认知图景,DeepSeek-AI团队的CODEI/O范式首次让机器真正"理解"了推理的本质——它将代码执行中蕴含的逻辑流,转化为可解释、可验证的思维链条,犹如为AI装上了解剖推理过程的显微镜。

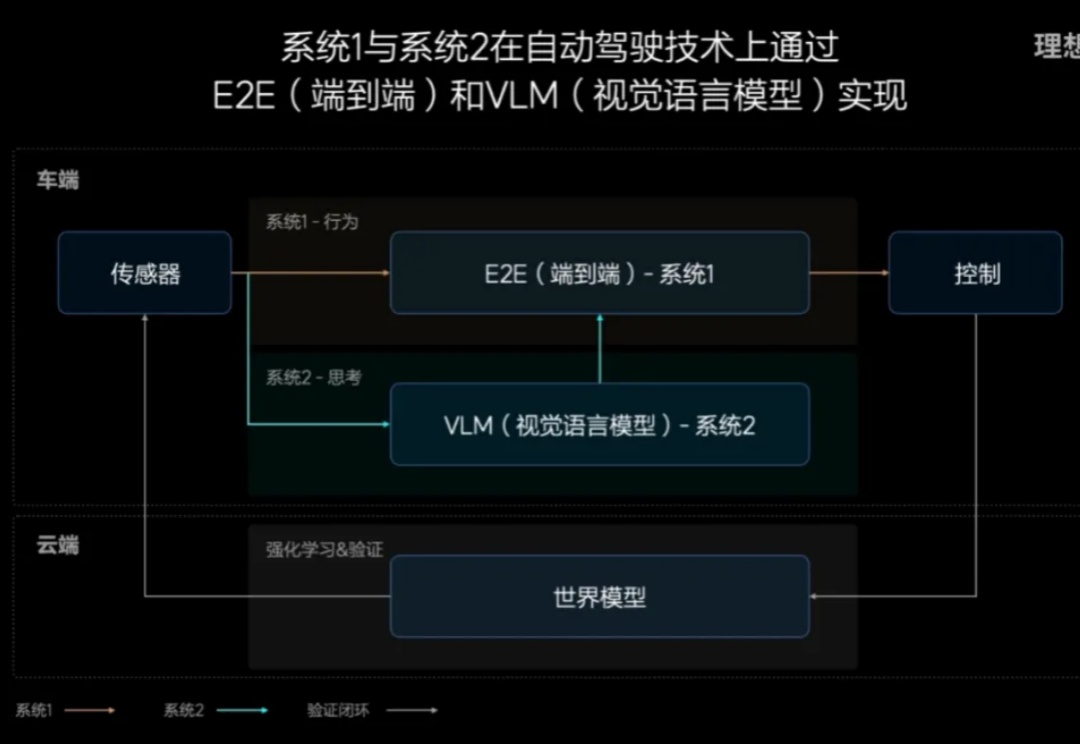

城市、高速一体化,从车位到车位的全程自动。

由普林斯顿大学教授共同创立的一家AI初创公司获得了1860万美元的国防部拨款,用于开发一种内存芯片,该芯片旨在提供更快、更高效的AI推理处理。

1822 年,电学之父法拉第在日记中写到“既然通电能够产生磁力,为什么不能用磁铁产生电流呢?我一定要反过来试试!”。于是在 1831 年,第一台发电机被发明,推动了人类进入电气化时代。