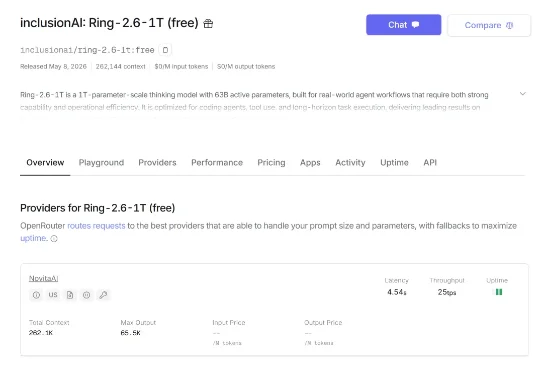

蚂蚁万亿参数思考模型Ring-2.6-1T来了!实测AIME真题难不倒,会写爽文、规划出行

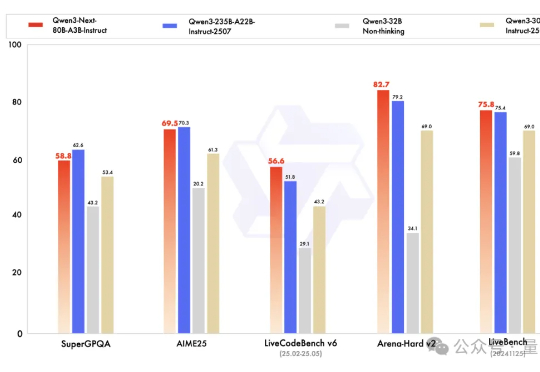

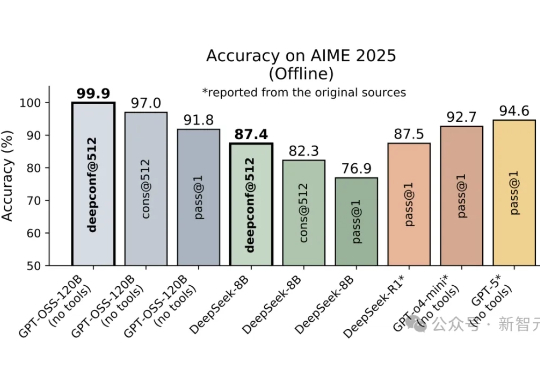

蚂蚁万亿参数思考模型Ring-2.6-1T来了!实测AIME真题难不倒,会写爽文、规划出行今天,蚂蚁百灵大模型发布Ring-2.6-1T。这是一款面向真实复杂任务场景的万亿级思考模型,目前已上线OpenRouter,并开放限时一周免费体验,后续将正式开源。Ring-2.6-1T加入了可调节的Reasoning Effort机制。开发者可以在high和xhigh两种推理强度之间选择:high面向Agent、Coding、多步工具调用等高频任务