如果没有AI算力,大模型这场战役我们可能胜不了

如果没有AI算力,大模型这场战役我们可能胜不了没想到,在ChatGPT爆火后的一年里,竟然出现了一个隐藏“Boss”——量子位获悉,百度、360等互联网大厂均已开始基于昇腾部署AI模型;而知乎、新浪、美图这样全速推进AI业务的公司,背后同样出现了华为云昇腾AI云服务的身影。

搜索

搜索

没想到,在ChatGPT爆火后的一年里,竟然出现了一个隐藏“Boss”——量子位获悉,百度、360等互联网大厂均已开始基于昇腾部署AI模型;而知乎、新浪、美图这样全速推进AI业务的公司,背后同样出现了华为云昇腾AI云服务的身影。

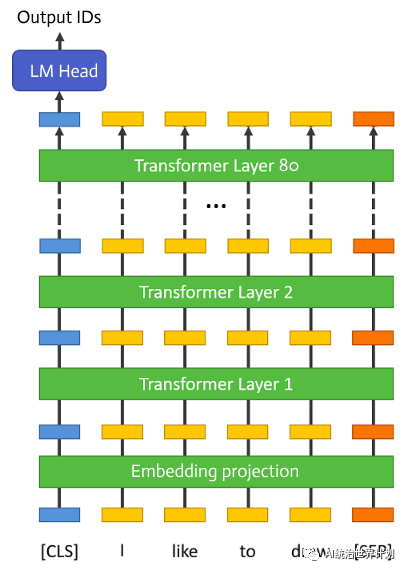

大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。

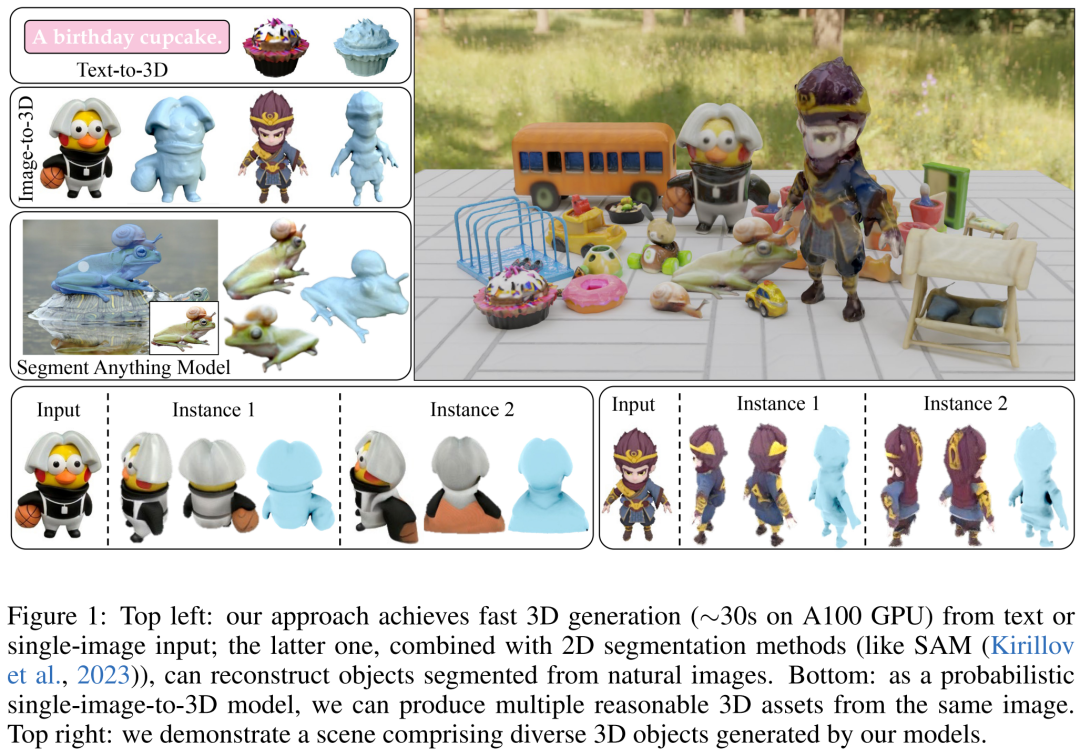

3D 生成是 AI 视觉领域的研究热点之一。本文中,来自 Adobe 研究院和斯坦福大学等机构的研究者利用基于 transformer 的 3D 大型重建模型来对多视图扩散进行去噪,并提出了一种新颖的 3D 生成方法 DMV3D,实现了新的 SOTA 结果。

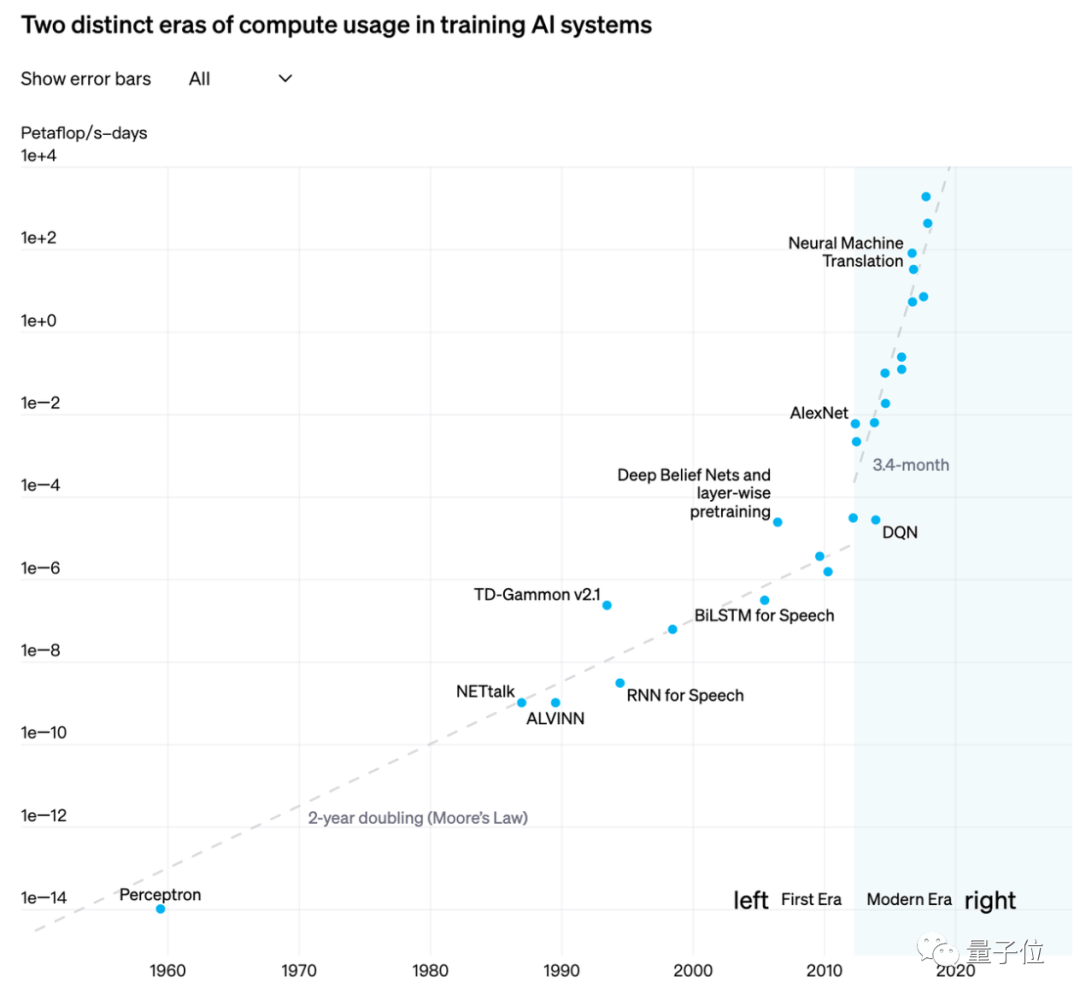

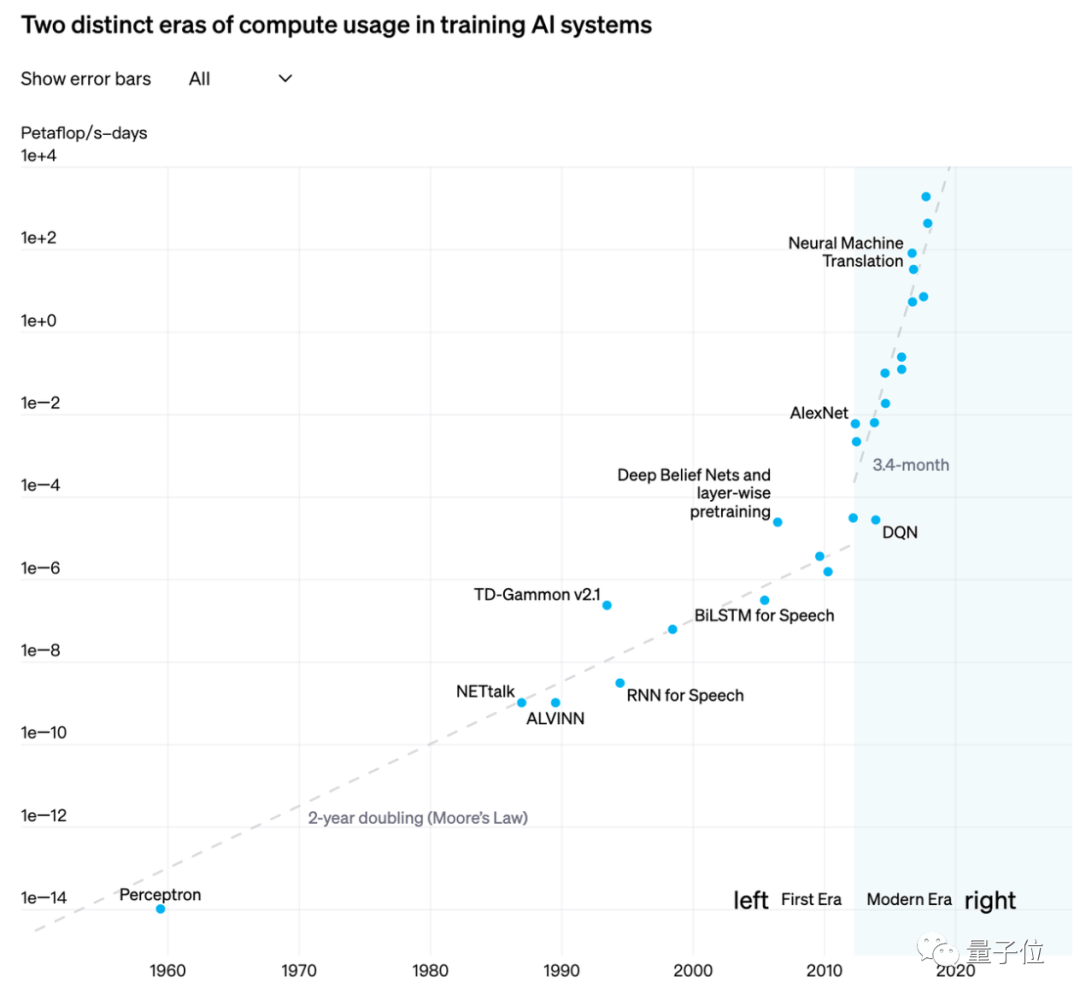

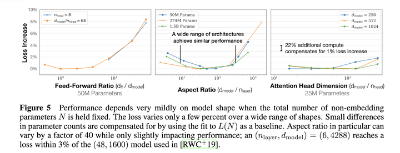

计划训练一个10B的模型,想知道至少需要多大的数据?收集到了1T的数据,想知道能训练一个多大的模型?老板准备1个月后开发布会,给的资源是100张A100,那应该用多少数据训一个多大模型最终效果最好?

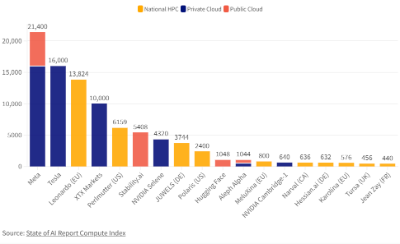

提及人工智能AI相关的算力芯片,现在绝大多数人的第一反应都是英伟达NVIDIA的GPU,作为AI模型搭建的基础,英伟达的A100/H100几乎成为了一块块“金砖”,深受业界喜爱。

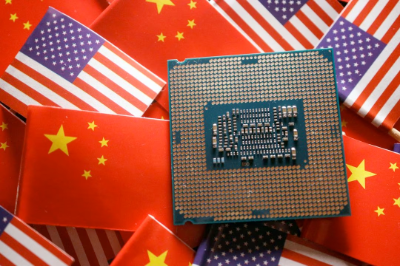

就在刚刚,美国再次收紧对我国出口尖端AI芯片,英伟达A100、A800、H100、H800等无一幸免。

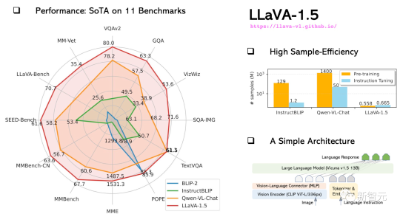

GPT-4V风头正盛,LLaVA-1.5就来踢馆了!它不仅在11个基准测试上都实现了SOTA,而且13B模型的训练,只用8个A100就可以在1天内完成。

在高性能计算(HPC)、人工智能(AI)、和数据分析等领域,图形处理器(GPUs)正在发挥越来越重要的作用。其中,NVIDIA的 A100尤为引人注目。这是英伟达最强大的显卡处理器,也是当前使用最广泛大模型训练用的显卡。