3D具身基础模型!北大提出Lift3D赋予2D大模型鲁棒的3D操纵能力

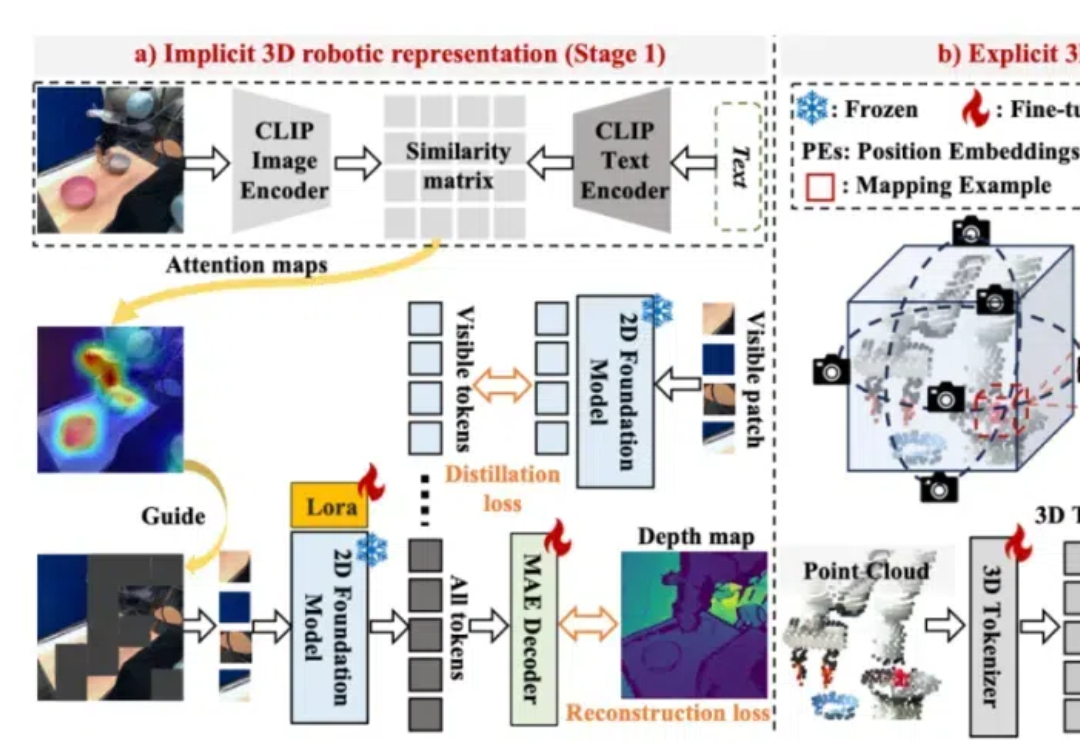

3D具身基础模型!北大提出Lift3D赋予2D大模型鲁棒的3D操纵能力为了构建鲁棒的 3D 机器人操纵大模型,Lift3D 系统性地增强 2D 大规模预训练模型的隐式和显式 3D 机器人表示,并对点云数据直接编码进行 3D 模仿学习。Lift3D 在多个仿真环境和真实场景中实现了 SOTA 的操纵效果,并验证了该方法的泛化性和可扩展性。

为了构建鲁棒的 3D 机器人操纵大模型,Lift3D 系统性地增强 2D 大规模预训练模型的隐式和显式 3D 机器人表示,并对点云数据直接编码进行 3D 模仿学习。Lift3D 在多个仿真环境和真实场景中实现了 SOTA 的操纵效果,并验证了该方法的泛化性和可扩展性。

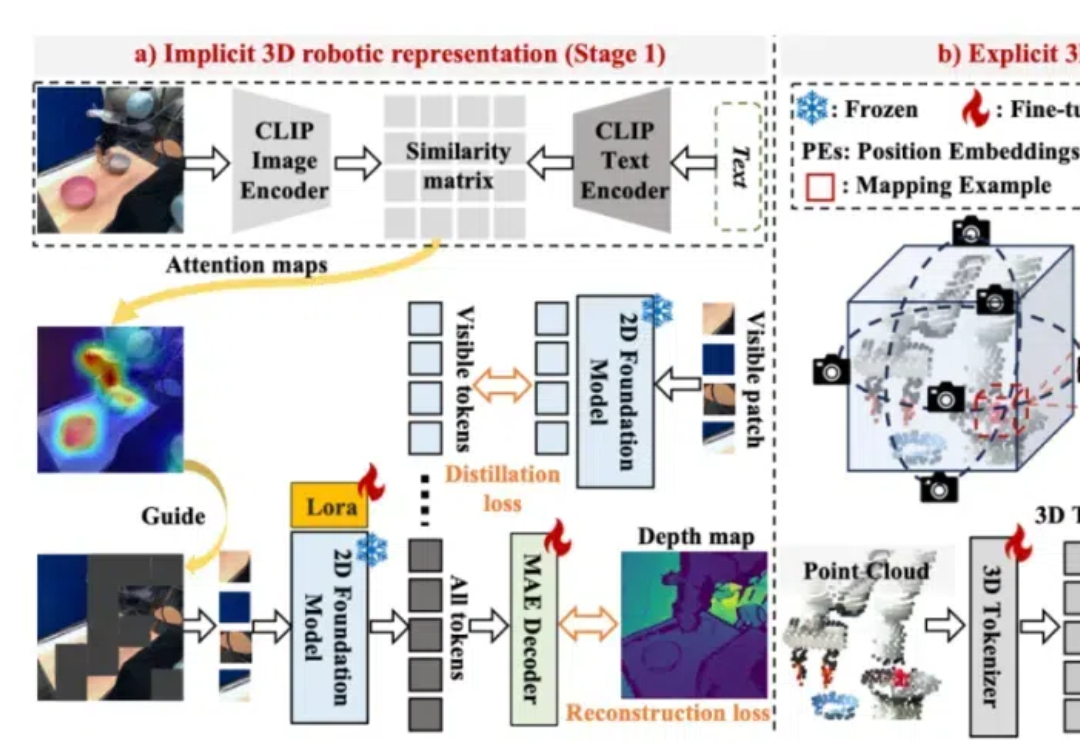

就在刚刚,Google Deepmind 深夜放大招,发布了最新基础世界模型 Genie 2。 想体验游戏世界?未来只需一张图片就能实现。 作为一个基础世界模型,Genie 2 能够凭借开局一张图生成各种可操作、可玩的 3D 环境。

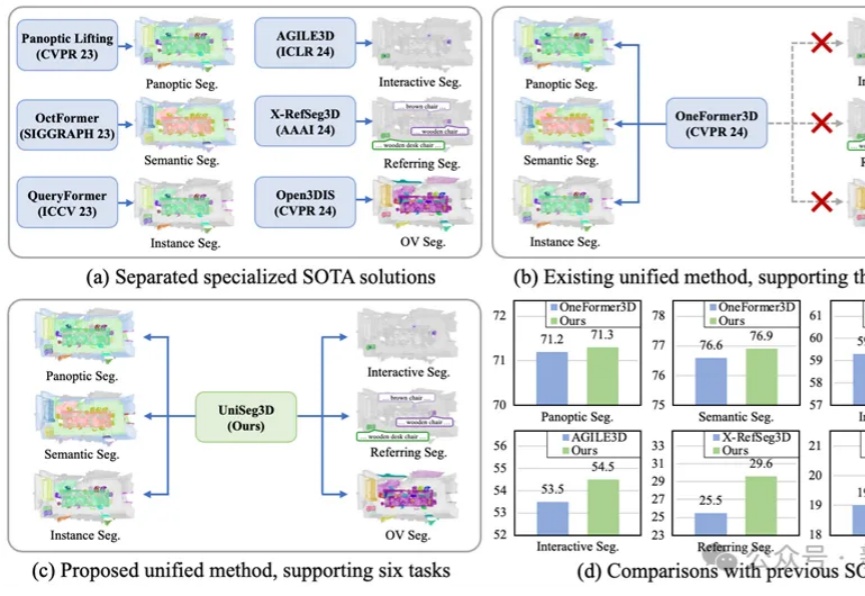

华中科技大学研发的UniSeg3D算法,能一次性完成三维场景中的六项分割任务,提升了场景理解的全面性和效率。通过任务间的信息共享,优化了性能,为虚拟现实和机器人导航等领域带来新的解决方案。

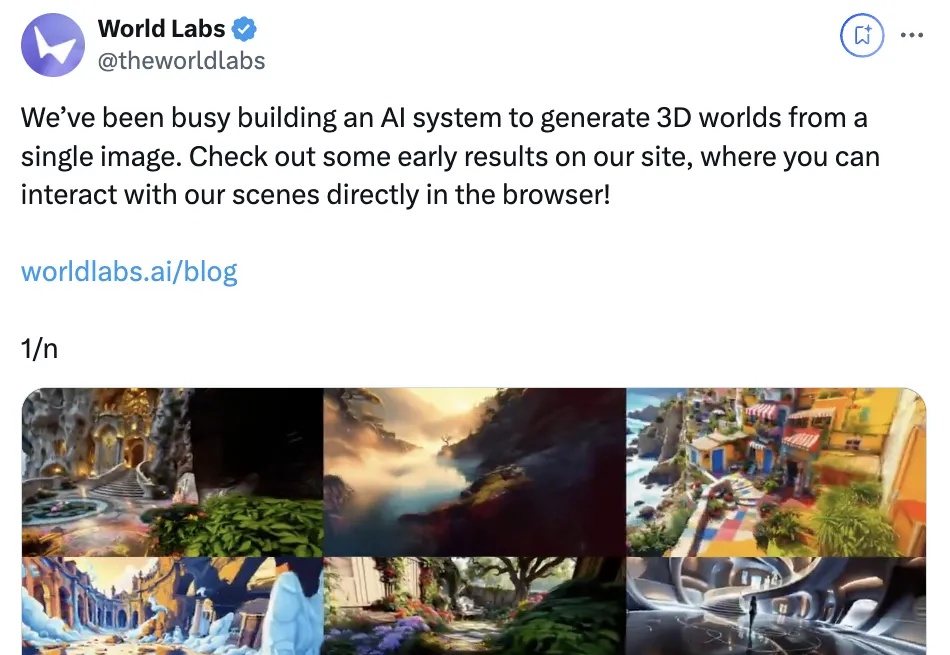

李飞飞的World Labs首个「空间智能」模型,刚刚诞生了!一张图生成一个3D世界,网友惊呼:太疯狂了,我们进入了下一轮革命,这就是视频游戏、电影的未来。

就在刚刚,李飞飞空间智能首个项目突然发布: 仅凭借1张图,就能生成一个3D游戏世界的AI系统!

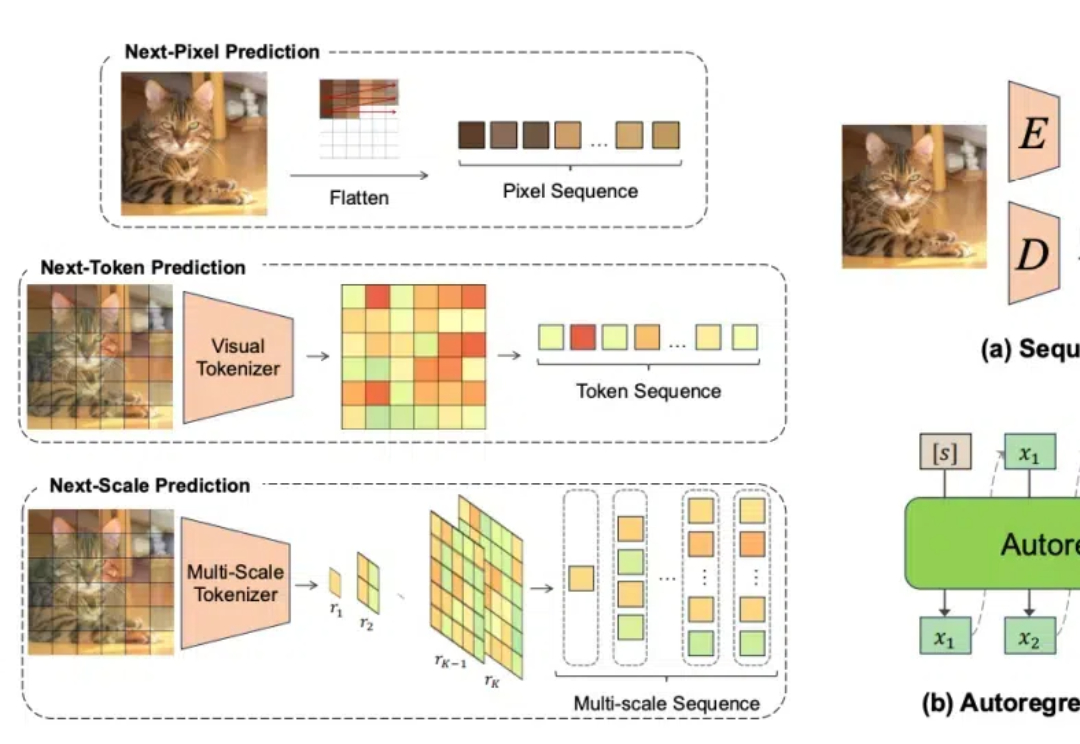

随着计算机视觉领域的不断发展,自回归模型作为一种强大的生成模型,在图像生成、视频生成、3D 生成和多模态生成等任务中展现出了巨大的潜力。然而,由于该领域的快速发展,及时、全面地了解自回归模型的研究现状和进展变得至关重要。本文旨在对视觉领域中的自回归模型进行全面综述,为研究人员提供一个清晰的参考框架。

这两天,在X上看到一个很酷的2D动漫AI视频。

时隔5年,巴黎圣母院终于完成修复,将在12月7日重新开放。在这场耗资数亿欧元的浩大工程中,3D建模等关键AI技术发挥了关键作用,让历经800多年沧桑的教堂与现代科技完美融合。

李飞飞谈到的空间智能,被这家中国独角兽补上关键一环。

5年,5000万个神经网络,这个世界从未被扫描过的角落,我们都能看到了。宝可梦GO团队,竟然抢先实现了李飞飞的「空间智能」?而「Pokémon Go」的玩家可能没想到,自己居然在训练着一个巨大的AI模型。