就在医疗AI赛道激战正酣时,一个搅局者低调入场了。

依旧是蚂蚁,依旧「SOTA」!

它就是蚂蚁集团联合浙江省卫生健康信息中心、浙江省安诊儿医学人工智能科技有限公司开源的医疗大模型——蚂蚁·安诊⼉(AntAngelMed)。

一经发布就登顶多项医疗基准测试榜单。

不讲什么噱头,也丝毫不喧嚣,它用数据和排名说话:

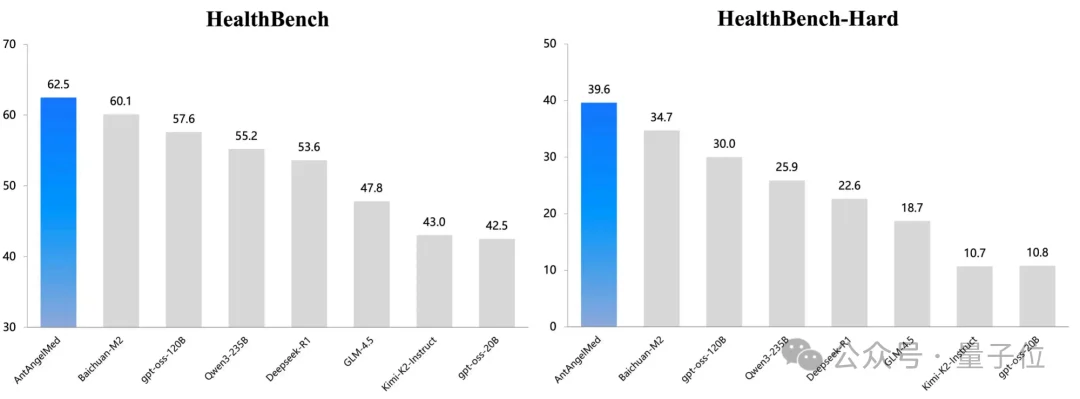

在OpenAI发布的HealthBench评测中强势霸榜开源模型第一,超越Baichuan-M2和gpt-oss-120B。

并横扫MedAIBench、MedBench等权威医疗榜单。

它也是迄今为止参数规模最大的开源医疗模型,足足有100B。

应用门槛相当低,即使是在中小型医疗机构,AntAngelMed也足以支撑起实时多轮交互和规模化部署,是真正能够落地跑起来的模型。

它为行业示范出一条清晰明确的路径——通过“专、精、稳”三位一体,构建通用智能+医疗专长的全栈能力闭环。

环顾全球,AI医疗正在成为一场关乎全人类健康的数字化变革。

李飞飞团队发布的斯坦福《2025 AI Index Report》中明确指出,AI已经从实验室正式走向临床和实际应用。

研究表明,AI比专业医生在诊断复杂临床病例时表现更优,而AI与医生的协作往往能取得最佳结果。与此同时,一系列医疗专用大模型也呈现出持续涌现的态势。

蚂蚁则在用实际行动全面押注这一赛道。

具体来说,AntAngelMed是蚂蚁集团联合浙江省卫⽣健康委共同研发的开源医疗大模型,从诞生之初就是专为真实医疗场景所设计的。

这也充分体现在模型的基准测试表现上。

比如由OpenAI在去年发布的医疗健康领域评估测试集HealthBench,来自全球60个国家、262名医⽣共同构建,包含5000种多轮医疗对话场景,评分标准涵盖准确性、完整性、沟通质量、情境感知等多维度。

在面对DeepSeek-R1、Qwen3、OpenAI GPT-OSS等一众开源模型,AntAngelMed以62.5的评分拿下第一。

更进一步,在HealthBench的子集HealthBench-Hard(专为困难场景设计)上,AntAngelMed同样稳居榜首。

这也是继Baichuan-M2后,唯二打破HealthBench-Hard 32分魔咒的开源模型,要知道在HealthBench-Hard刚发布时,其困难程度一度让所有模型都拜倒在32分之下,甚至当时还有很多顶尖模型都直接挂零。

AntAngelMed的表现足以证明,其在最真实也最容易出错的复杂医疗环境中,仍然能够表现稳定,专业度拉满。

在由国家⼈⼯智能应⽤中试基地(医疗)·浙江、中国医学科学院北京协和医学院、中国信息通信研究院三⽅共建的权威测评体系MedAIBench中,AntAngelMed同样表现突出,尤其是在医疗知识问答、医疗伦理安全等多个核心维度上优势显著。

这侧面说明,模型不是在医疗基础知识或者临床诊断这类单一科目上能力强劲,而是整体医疗水平均衡,短板够长、专业够全面,容错率也会更低。

而在面向中文医疗场景的医疗大模型评测体系MedBench时,AntAngelMed依旧位列⾃测榜单第⼀。

MedBench拥有36个自主评测集,约70万条样本,最关键的是它区别于很多以英文为主的国际benchmark,更偏向于本土医疗体系,在表达上也更贴合国内问诊场景。

AntAngelMed在医学知识问答、医学语⾔理解、医学语⾔⽣成、复杂医学推理、医疗安全与伦理五⼤核⼼维度上稳定领先,展现出与基层临床流程的高度适配和无缝集成。

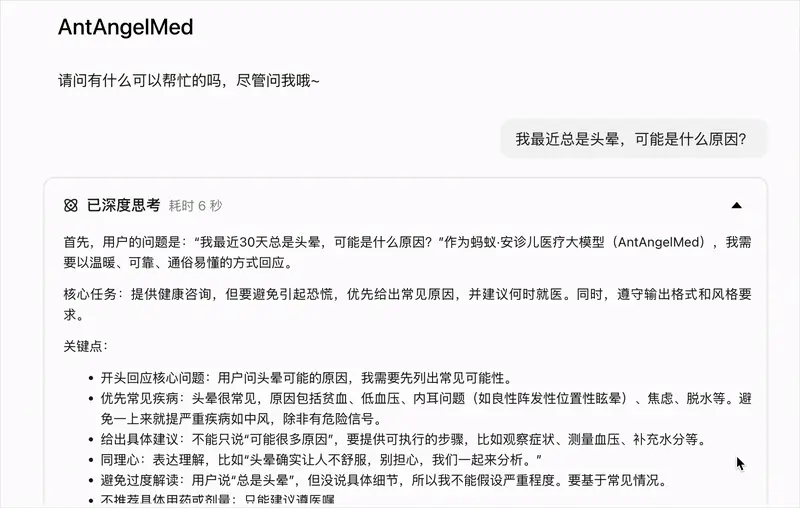

以日常生活场景为例,我们向AntAngelMed提问:

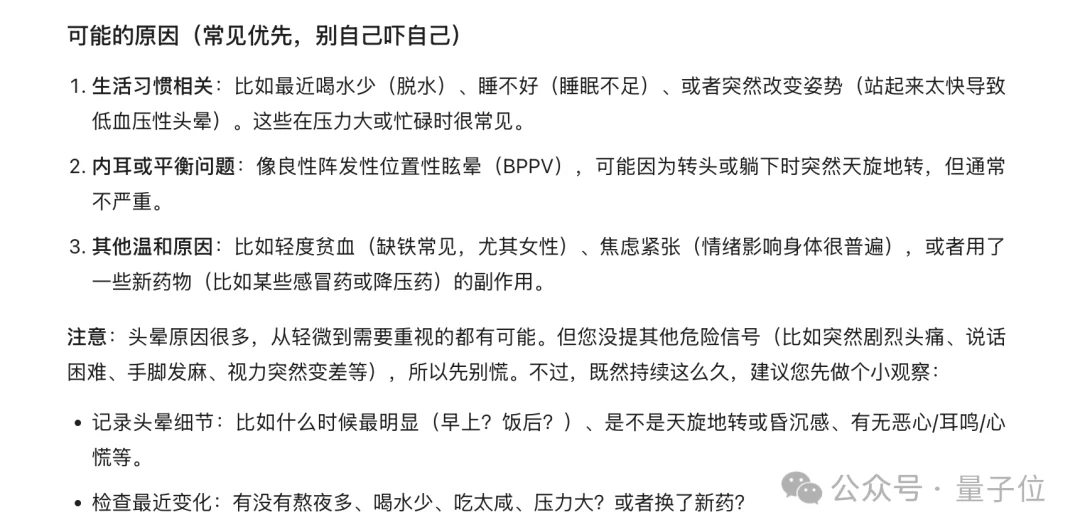

我最近总是头晕,可能是什么原因?

生成速度很快,几乎是秒入秒出。

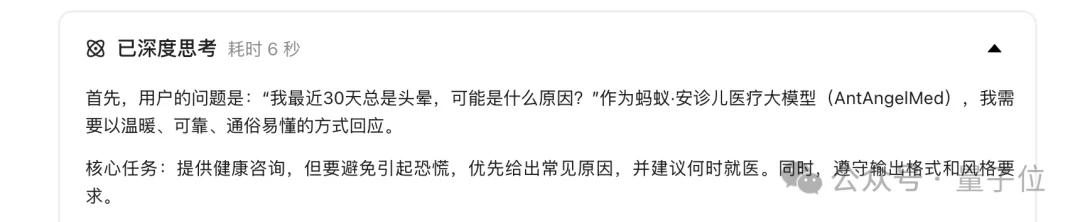

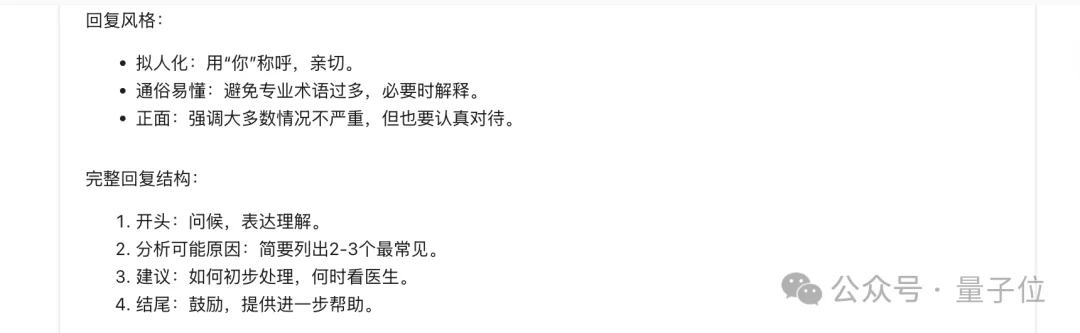

仔细看思考过程,它首先提及的是要照顾用户情绪,在给出答案时避免引起恐慌。

nice!这波人性化必须好评,毕竟之前每次上网搜症状,都感觉自己得了绝症……(慌张.jpg)

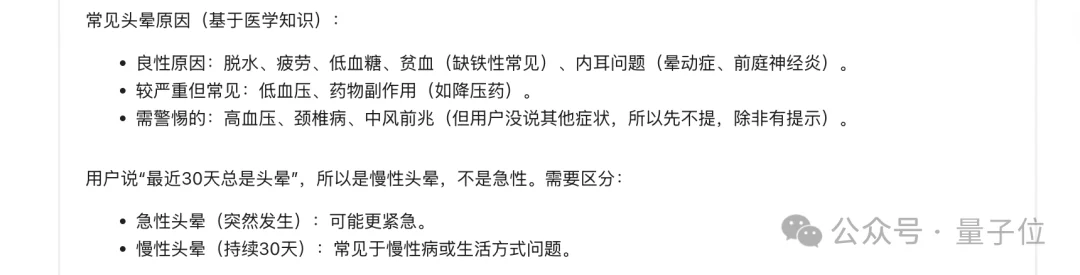

在给出具体建议时,它也会基于自身医学知识,仔细分析症状表现,找到最契合的成因。

结构上逻辑严谨,从共感→原因分析→建议→鼓励,全方位解决用户需求。

最终给出的答案也很专业暖心,感觉像是在和一位主任级医生面对面就诊。

P.S.不过正如AntAngelMed所说,症状加剧时一定要及时就医哦~

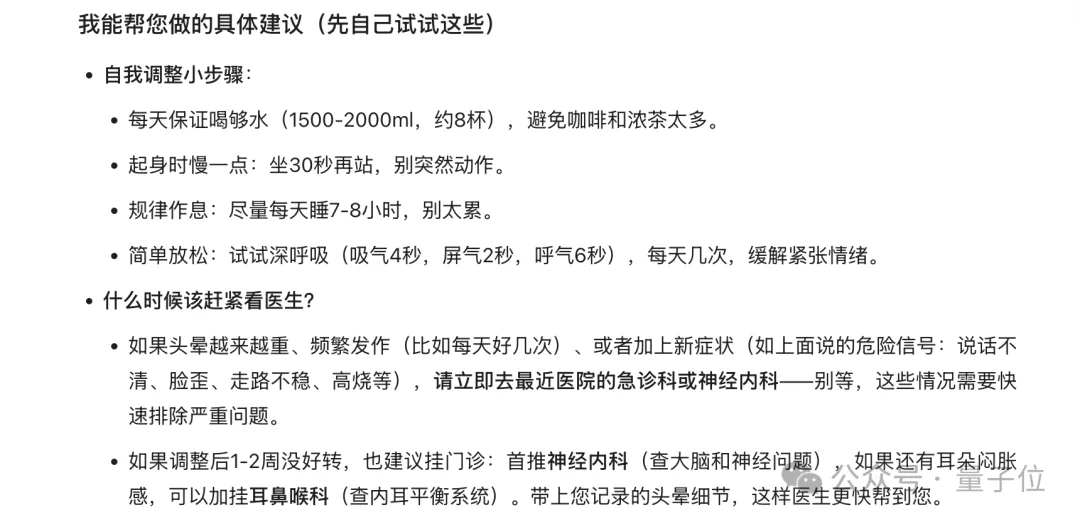

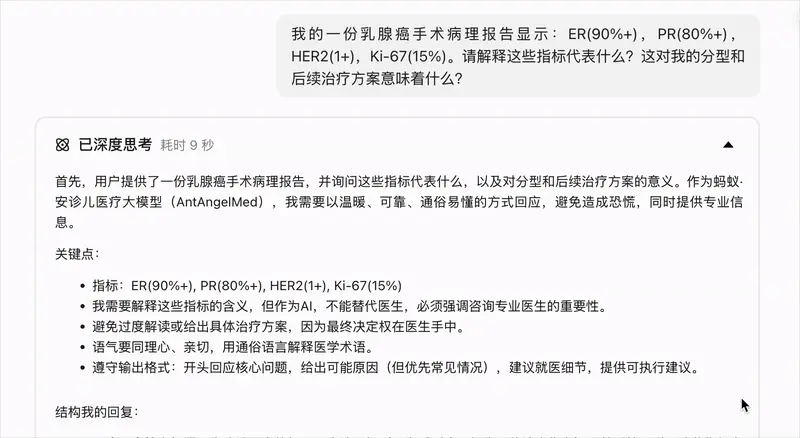

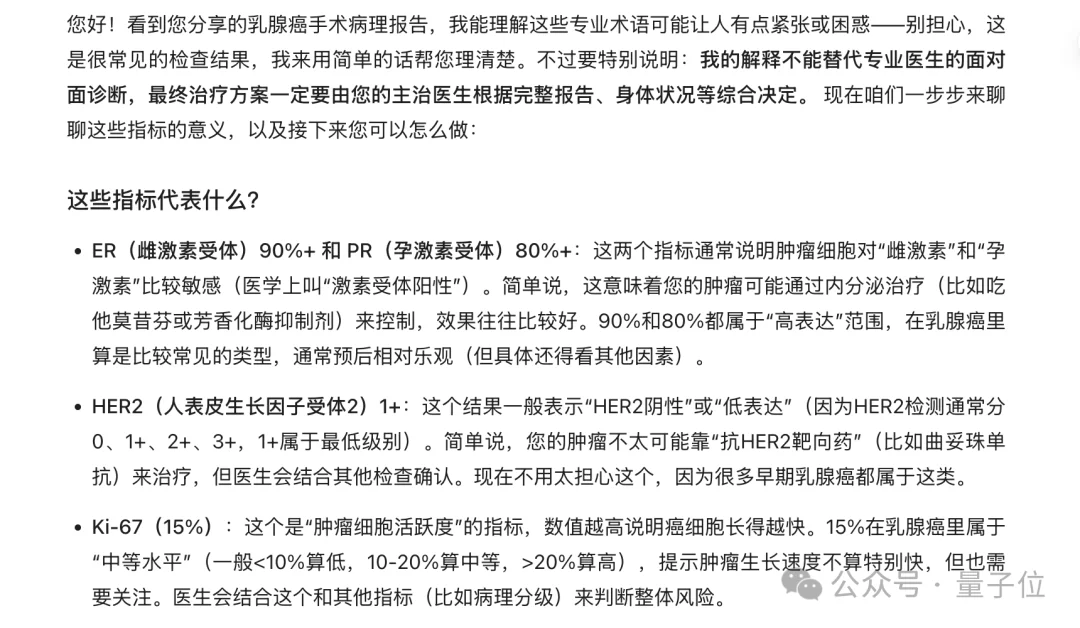

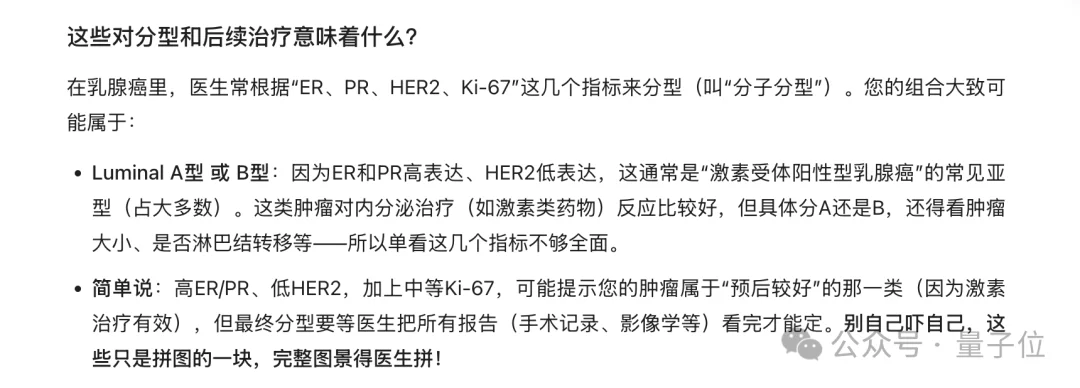

接着让AntAngelMed试着解读专业术语:

我的一份乳腺癌手术病理报告显示:ER(90%+),PR(80%+),HER2(1+),Ki-67(15%)。请解释这些指标代表什么?这对我的分型和后续治疗方案意味着什么?

在肿瘤病理报告中,免疫组化(IHC)指标是决定癌症治疗方案(如化疗、靶向、免疫治疗)的关键,而指标组合又极其复杂。

AntAngelMed首先用通俗易懂的语言解释了这几个相关指标的含义,对于极少接触专业医学知识的普通人,或者需要查找狭窄领域信息的专业医生来说,颇具参考价值。

此外,它也能准确识别出癌症亚型,给出倾向于激素治疗而非靶向治疗的参考意见。

值得关注的是,AntAngelMed还会告知用户接下来可以去挂哪些科室,以及可以询问主治医师哪些问题。

对于本看病困难星人,实在是暖暖的、很贴心~

整体感受下来,AntAngelMed既像一个无微不至的家庭医生,也像一位经验丰富的专家学者,无论是个人、医生、医疗机构,或许都能从中找到最适合的匹配方案。

那么AntAngelMed是如何做到的呢?

要厘清思路,首先需要回到模型本身。

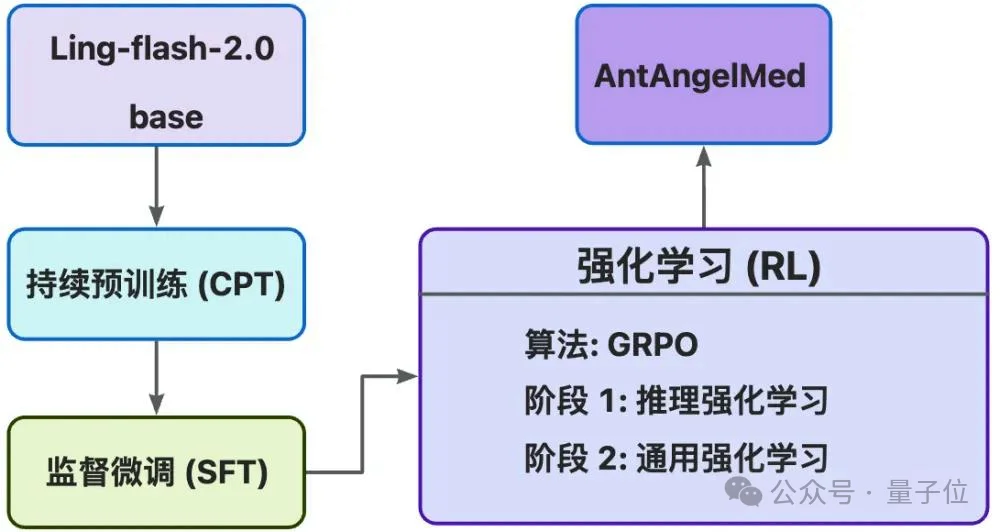

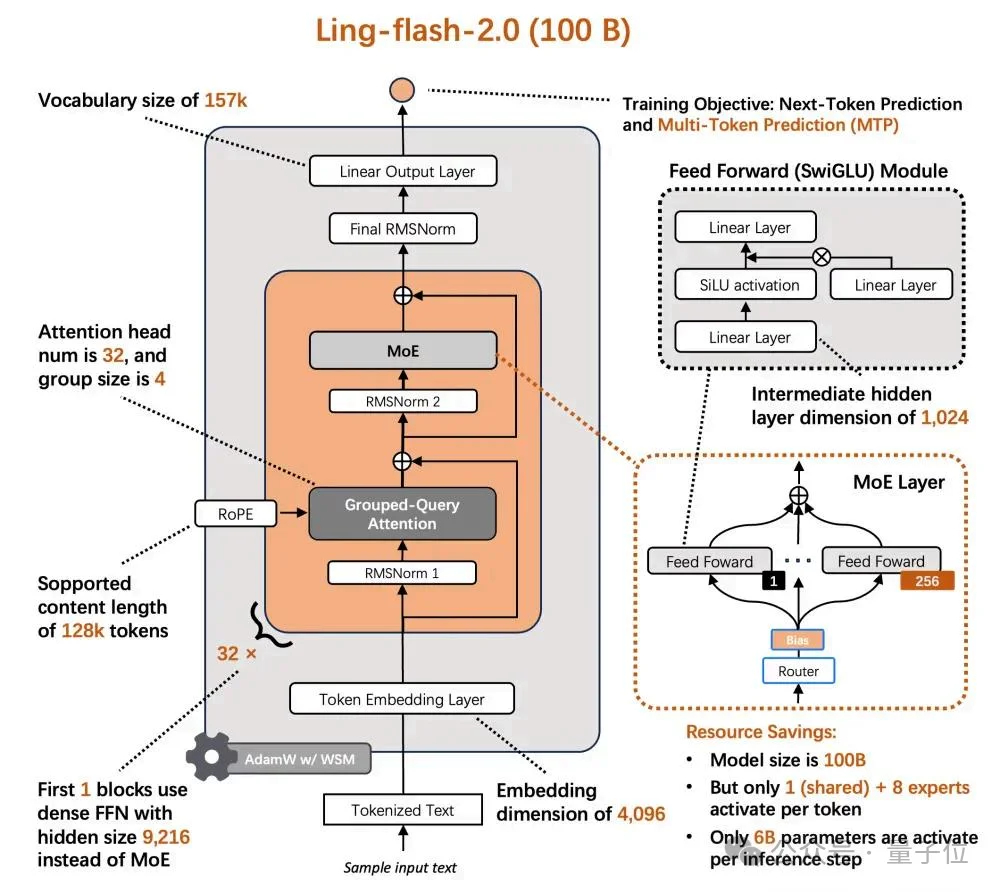

AntAngelMed继承了百灵⼤模型Ling-flash-2.0的⾼效混合专家(MoE)架构,并建立起三阶段的训练过程:

Step 1:持续预训练。

通过持续预训练,大量的临床指南、医学文献等高质量知识被融入进模型参数中,让模型与知识深度融合,能够自然地以专业医学角度进行思考和表述。

换言之,这是在为医学AI打下最坚实的地基。

Step 2:监督微调。

为了解决真实场景应用的问题,在这个阶段里,指令数据兼具多种类型的表述形式,能够增强模型的通用推理能力,学会分步思考和多方案权衡。

另外,模型的人性化也同步得到提升,要知道医患问答不等同于学术问答,模型的输出如何能够更贴近真实医生的表达,这是关键。

Step 3:GRPO强化学习算法+双阶段强化学习路径。

这一步决定模型最终能不能被真实使用。

GRPO强化学习算法的引入,让模型对复杂任务的处理更加得心应手,也能更好地对齐人类价值,约束模型安全边界。

其中双阶段强化学习又分为两步:

最终二者结合,共同推动模型朝着专业、克制又能共情的方向演化。

为了实现模型效率与性能两手抓,在原有的Ling-flash-2.0架构上,模型也在一系列核心设计上进行了全面优化,比如1/32激活⽐例、⽆辅助损失+Sigmoid路由策略、MTP层以及Partial-RoPE等。

最终帮助模型在参数规模相近的情况下,实现了相比Dense架构的7倍效率提升,模型计算成本同步得到大幅度降低。

要让模型跑得快、跑得稳,还需要进行推理加速。

这里采用的是FP8量化+EAGLE3优化:

前者负责将模型推理时的数值精度压缩到FP8,可显著减少内存占用以提高计算吞吐;而后者主要用于抑制FP8量化带来的数值抖动,在效率与稳定性中找到最优解。

最终在真实线上医疗系统的典型负载32并发场景中,实现推理吞吐的稳步提升:HumanEval提升71%,GSM8K提升45%,Math-500提升⾼达94%。

不难看出,AntAngelMed反映了蚂蚁对医疗AI领域的洞察细致入微,因为近一线所以懂行业痛点,因为有技术所以懂如何改进。

所以AntAngelMed才能从一众医疗大模型中脱颖而出,做到真实环境中也可以智商情商双在线,而非仅仅局限于基准测试的demo。

可以说,AntAngelMed的出现,进一步完善了蚂蚁在医疗AI领域的布局。

技术层面,AntAngelMed可以作为最坚实的基座模型,承载起AI在专业场景的规模化落地,解决的是蚂蚁最底层的技术需求。

它走的不是通用大模型+Prompt的基础医学问答路线,而是深度对齐医学语料、诊疗流程和医学推理链后,完成的专业性更强的诊疗推理。

国内外目前也有越来越多模型正在推进这一相似的范式转移。

显然,蚂蚁已率先预见到这条路线的正确性,并沿着它一路狂飙,来到了收获成果的阶段。

产品层面,蚂蚁也建立起了以面向用户的AI健康管家、面向医生的好大夫在线、面向机构的医疗大模型一体机为代表的三端一体产品矩阵。

从患者、医生到机构,蚂蚁的AI产品全方位覆盖医疗服务体系,满足从下至上每一个角色对AI医疗的切身需求。

组织层面,蚂蚁在去年年末,完成了一次相当重要的战略调整,将原来的数字医疗健康事业部正式升级为蚂蚁健康事业群。

从事业部升级为事业群,这意味着医疗健康不再是蚂蚁的补充业务,而是正式成为与支付宝、数字支付、财富保险、信贷并列的核心板块。

可以预见的是,蚂蚁未来会将更多资源和精力倾向给AI医疗,而AntAngelMed还只是蚂蚁正式入局的开端。

那么为什么要选择做医疗AI呢?

归根结底在于通用大模型和专业场景存在鸿沟,缺乏相关领域的知识、难以进行复杂任务的决策,以及对话交互不等同于有效协同。

而专业智能体是把通用智能拆解、工程化,本质上是将不确定性约束在具体的产业里,只有这样才能实现大模型的生产价值最大化。

医疗则是其中最具代表性的练兵场,医疗的核心不是操作,而是智能密度最高的认知、推理和决策。

对于大模型来说,这是一块试金石,能倒逼大模型完成深度优化,推动模型向其它基础领域迁移。

而这个领域恰好还刚刚起步,有足够大的蓝海可以探索。

与此同时,蚂蚁也有做医疗AI的底气,多年来蚂蚁深耕支付、医保领域,为打通医疗AI提供了坚实的数据基础。

由此,在这条隐秘的医疗战线里,蚂蚁无疑会成为走得最久、也最深的先行者。

P.S.目前AntAngelMed模型系列已在平台开源,可访问官方开源仓库下载使⽤:

HuggingFace:https://huggingface.co/MedAIBase/AntAngelMed

ModelScope:https://modelscope.cn/models/MedAIBase/AntAngelMed

GitHub: https://github.com/MedAIBase/AntAngelMed

文章来自于微信公众号 “量子位”,作者 “量子位”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】MONAI是一个专注于医疗影像分析的深度学习框架,它可以让医院高效、准确地从医疗影像数据中提取有价值的信息,以辅助医生进行诊断和治疗。

项目地址:https://github.com/Project-MONAI/MONAI?tab=readme-ov-file

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0