当检索增强生成(RAG)从静态走向动态,一个核心问题浮出水面:何时该触发检索?

现有方法的答案是:看模型内部信号。FLARE看句子中的token生成概率,DRAGIN看entropy和attention,ETC看entropy的一阶二阶差分,SeaKR看FFN内部状态……

但这一范式存根本性缺陷:LLM通常校准能力很差,经常对错误输出表现出高置信度。

DRAGIN vs QuCo-RAG对比。(a)DRAGIN依赖模型内部信号,错误地将问题中的「Il」标记为高不确定性,却对幻觉出的错误导演名显示低不确定性。(b) QuCo-RAG通过预训练语料中的零共现检测,正确识别出幻觉。

DRAGIN在生成错误的导演名「Mario Camerini」时显示低不确定性(Uncertainty < threshold),却对问题中的普通token「Il」报出高不确定性(Uncertainty = 1.47 > threshold)。

这就是所谓的「自信地胡说八道」(confident hallucination)——模型不知道自己不知道,内部信号完全失效。

更根本地,近期理论工作(Kalai & Vempala, 2024)证明:对于罕见事实,即使是完美校准的模型也必须产生幻觉以维持统计一致性。

那么,有没有一种方法,能绕过这些不可靠的内部信号?

伊利诺伊大学芝加哥分校、纽约大学、与蒙纳士大学的联合团队提出QuCo-RAG,首次跳出「从模型自己内部信号来评估不确定性」的思维定式,转而用预训练语料的客观统计来量化不确定性,在多跳QA基准上对OLMo系列模型实现5-14个EM点的显著提升,并且有效性成功迁移至Llama3、Qwen2.5、GPT4.1/5等预训练数据未公开的模型。

论文链接:https://arxiv.org/abs/2512.19134

开源代码:https://github.com/ZhishanQ/QuCo-RAG

QuCo-RAG的核心洞察是:LLM的事实知识本质上由预训练语料塑造。

低频实体 = 长尾知识风险:如果一个实体在预训练语料中很少出现,模型就难以可靠地记忆关于它的知识。

零共现 = 幻觉高风险:如果两个实体在整个预训练语料中从未在同时出现,那么模型声称的它们之间的关系就缺乏任何证据支撑——这几乎必然是幻觉。

更重要的是,这种因果关系是不对称的:

基于这一洞察,QuCo-RAG从「主观内部置信度」转向「客观语料统计」,通过Infini-gram引擎对4万亿token的OLMo-2预训练语料进行毫秒级查询,实现精准的检索触发。

QuCo-RAG框架总览。两阶段检测:生成前知识评估(检查实体频率)+ 运行时声明验证(检查实体共现)。

QuCo-RAG通过两阶段检测机制量化不确定性:

提取问题中的关键实体(如Silas Hardy、Lee Mantle);

查询每个实体在4万亿token预训练语料中的出现频率;

如果平均频率低于阈值(默认1000次),触发检索;

核心逻辑:低频实体代表「长尾知识」,模型很可能没有可靠记忆。

在模型生成过程中,系统持续监控每个生成的句子:

使用轻量级0.5B模型提取知识三元组(头实体, 关系, 尾实体);

查询头尾实体在预训练语料中的共现次数;

如果共现次数为0,触发检索并重新生成;

核心逻辑:零共现意味着模型正在「无中生有」——编造训练数据中从未出现过的实体关系。

QuCo-RAG利用Infini-gram引擎——一个基于后缀数组的索引系统,支持对万亿级token语料库的毫秒级频率和共现查询。

为了最小化开销,团队从GPT-4o-mini蒸馏了一个专用的0.5B三元组提取模型,基于Qwen2.5-0.5B-Instruct微调。

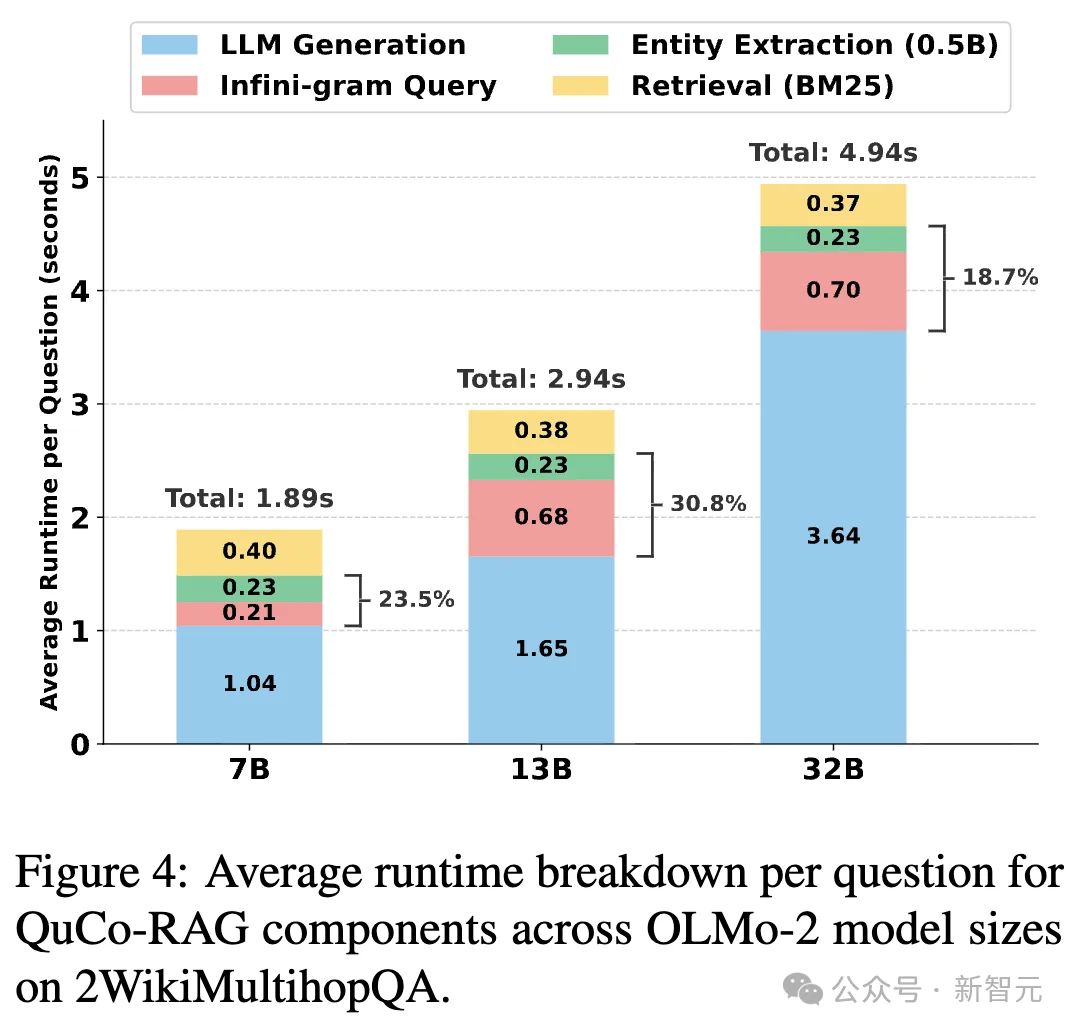

QuCo-RAG各组件运行时间分解。LLM生成占主导(55-74%),Infini-gram查询仅占18-31%,证明语料库检测引入的开销适度。

实验结果

全面领先,迁移能力惊人

OLMo-2全系列5-12点提升

在2WikiMultihopQA和HotpotQA两大多跳QA基准上,QuCo-RAG在OLMo-2全系列模型(7B、13B、32B)上全面超越所有baseline:

而基于内部信号的方法(FLARE、DRAGIN、ETC、SeaKR)表现极不稳定,有时甚至不如简单的单轮检索(SR-RAG)。

主实验为什么选择OLMo-2?

QuCo-RAG的核心是利用预训练语料的统计信息。但一个关键问题是:如何验证「语料统计」这个信号源本身是有效的?

这就需要一个「匹配语料」设置——即模型的预训练数据必须完全公开,才能精确计算实体频率和共现统计。

OLMo-2是目前满足这一条件的高性能代表性开源模型:

这使得OLMo-2成为验证QuCo-RAG核心假设的理想测试平台。

跨模型迁移:代理语料库同样有效

一个关键问题:如果模型的预训练数据不公开怎么办?

研究团队验证了一个重要假设:网络规模的预训练语料库之间存在大量重叠。

因此,使用OLMo-2的语料库作为「代理语料库」,同样可以有效指导其他模型。

QuCo-RAG在Qwen2.5、Llama-3、GPT-4.1、GPT-5等模型上均实现显著提升。

关键发现:

效率分析:更少检索,更高性能

效率-性能权衡分析。QuCo-RAG以最少的token消耗和LLM调用次数达到最高EM。

QuCo-RAG实现了「精准狙击」式的检索:

领域泛化:生物医学问答同样有效

在PubMedQA生物医学问答基准上,QuCo-RAG同样表现出色:

QuCo-RAG在PubMedQA上达到66.4%准确率,超越Wo-RAG 11.2个百分点。

内部信号方法在这个专业领域暴露出两种失败模式:

QuCo-RAG则两者兼顾:平均0.93次检索,54.9个token,最高准确率。

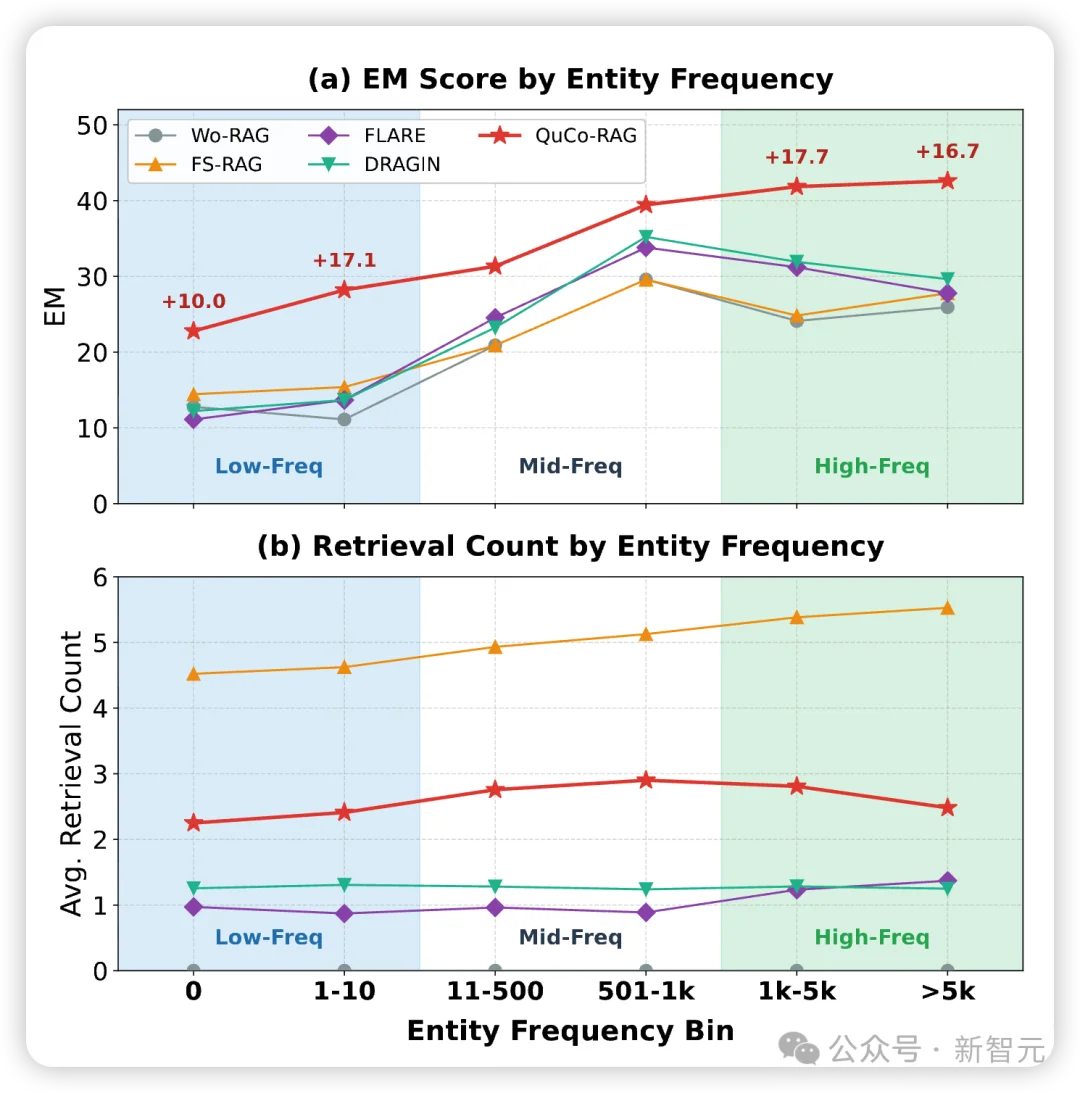

深度分析:为什么实体频率分析有效?

研究团队按实体在语料库中的出现频率将问题分组,揭示了有趣的规律:

这最后一点尤为重要:高频实体让模型「过度自信」,但QuCo-RAG通过共现检测捕捉到模型对熟悉实体的错误关系声明。

深远影响与未来方向

本文将语料统计确立为模型内部不确定性信号的客观替代方案。虽然本文聚焦于RAG系统中的检索触发,但这一范式转变在AI安全与鲁棒性领域开辟了多个值得探索的研究方向。

赋能可信AI应用

实验证明,语料统计比内部信号提供了更可靠的不确定性度量。这种可靠性不仅对RAG有价值,还可扩展到更广泛的安全关键任务:

从推理时干预到以数据为中心的AI

语料统计分析能够精确识别模型的知识盲区。

这一信号可以指导训练数据策划:与其仅在推理时通过检索来弥补知识缺口,开发者可以在持续预训练或后训练阶段主动收集低频实体的数据。类似地,语料统计还可以指导:

范式的延伸方向

多个研究方向值得探索:

理论基础

跨模型迁移的有效性引发了一些值得思考的问题:为什么代理语料能跨模型族生效?能否形式化地建立「给定语料统计的幻觉概率」的信息论界限?这些问题与LLM中「记忆vs泛化」的更广泛讨论相关联。

参考资料:

https://arxiv.org/abs/2512.19134

文章来自于微信公众号 “新智元”,作者 “新智元”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner