大模型的记忆墙,被MIT撬开了一道口子。

MIT等机构最新提出了一种新架构,让推理大模型的思考长度突破物理限制,理论上可以无限延伸。

这个新架构名叫Thread Inference Model,简称TIM。

TIM配上专用推理引擎TIMRUN,把推理过程变成类似树状的递归子任务结构,并动态修剪掉不再需要的子任务,就能让模型在输出窗口有限的情况下实现几乎无限制的长程推理。

当前所有顶尖大模型都面临一个尴尬的困境:上下文窗口限制。

但现实应用经常需要更长的推理链条,特别是当模型需要调用外部工具、处理复杂多步骤任务时,这个限制就成了致命短板。

传统解决方案要么是把任务切分给多个模型处理,要么是压缩历史信息,但这两种方法都会损失信息完整性。

TIM团队提出了一个巧妙的洞察:

推理过程并不是线性的,而是像编程时一样具有递归结构。

例如当我们写代码时,通常只关注光标附近的代码、已完成函数的输入输出,以及待办事项,而不会记住每个函数的所有实现细节。

这种“潜意识”的信息过滤机制,正是TIM系统的核心灵感来源。

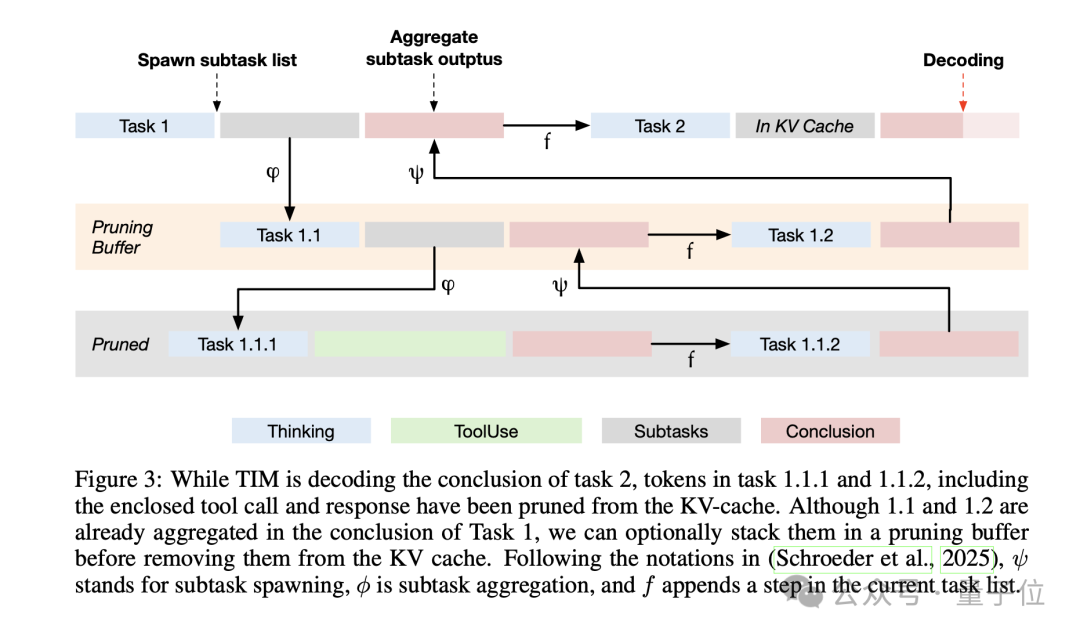

TIM最大的创新在于将推理轨迹建模为递归的子任务树,而不是传统的线性token序列。

每个任务单元包含四个关键组件:

当模型处理复杂问题时,会自动将其分解为更简单的子任务,直到达到可以一步完成的叶节点任务。

再配合子任务剪枝机制,当一个子任务完成后,模型只保留其结论,而将具体的执行细节从工作内存中移除。

研究团队使用了一个固定大小的子任务栈来管理这个过程,当栈满时会弹出最早的子任务并将其从内存中剪除。

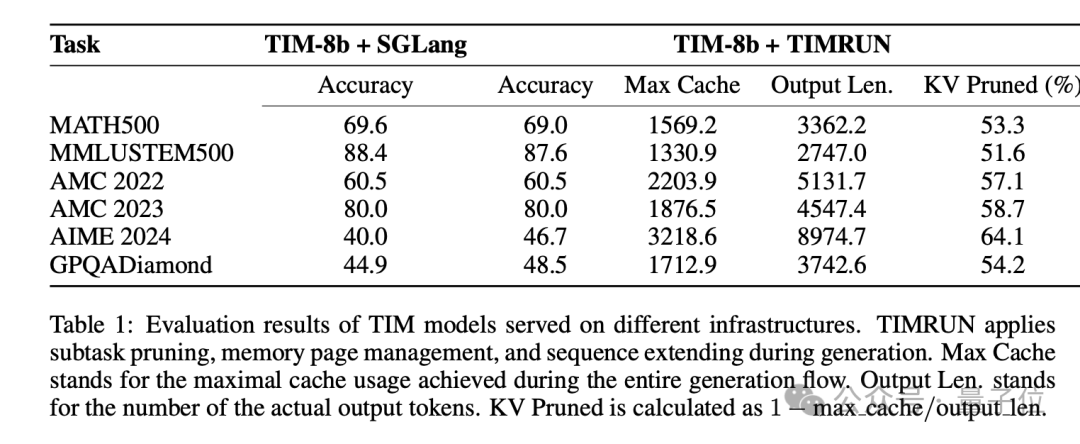

实验表明,这种机制可以减少超过50%的KV缓存使用,在AIME 2024数学竞赛任务上甚至达到了64.1%的剪枝率。

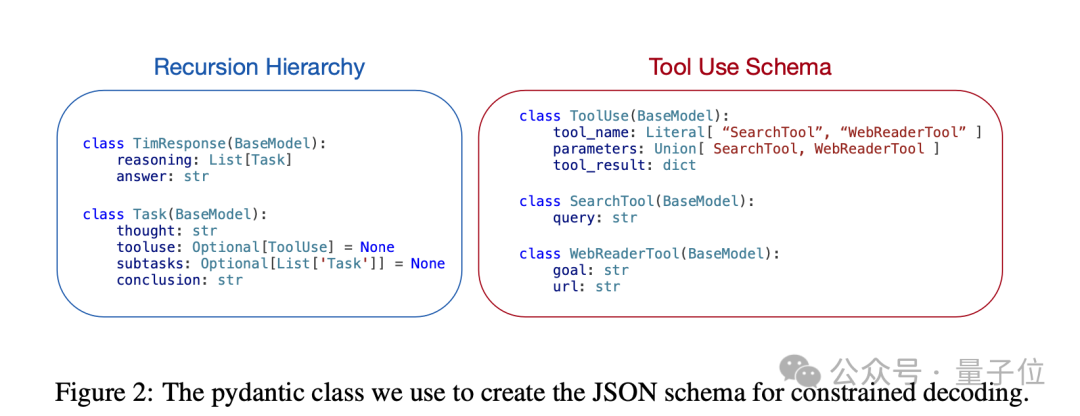

更重要的是,TIM采用了结构化生成方式,整个推理过程被编码为一个JSON字典,通过约束解码确保输出格式的正确性。

这使得模型可以在一次推理中完成多次工具调用,避免了传统方法中反复提交消息列表的开销。

专门设计的推理引擎解决了TIM部署中的关键挑战——如何在有限的GPU内存和位置编码范围内实现”无限”推理。

TIMRUN的核心技术突破在于动态内存管理和位置编码重用。

当子任务被剪枝后,系统不仅回收了GPU内存页,还重新分配了位置编码。

具体来说,被剪枝的token占用的位置会被后续的token重新使用,这样模型就能在固定的输出窗口限制下持续生成新内容。

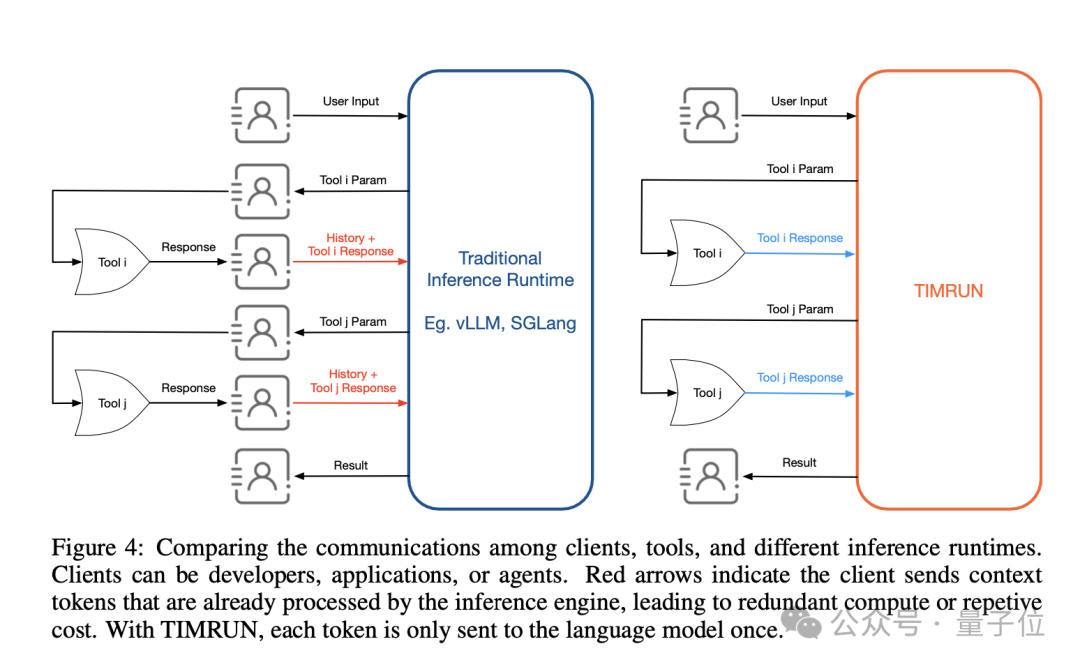

在工具调用方面,TIMRUN直接在运行时内部发起调用,而不是将参数发送回客户端。

当模型输出”tool_result:”时,TIMRUN会自动提取参数、调用外部工具,并将响应直接添加到推理序列中。

这种设计将传统多智能体系统中O(n²)的token成本复杂度降低到了O(n),其中n是推理步骤数。

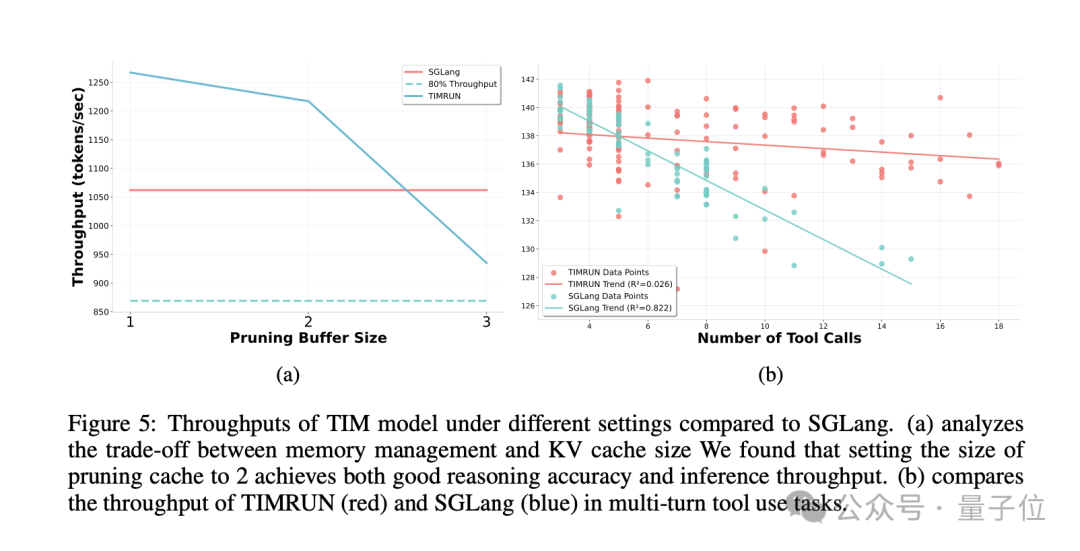

实验数据显示,即使进行30多次工具调用,TIMRUN仍能保持稳定的吞吐量。

研究团队在多个基准测试上验证了系统性能。

在MATH500数学推理任务上,TIM-8b模型达到了69%的准确率,而在更具挑战性的AIME 2024上也取得了46.7%的成绩。

值得注意的是,使用子任务剪枝不仅没有降低性能,在某些任务上反而有所提升——这证明了保持精简的工作内存有助于模型聚焦于相关信息。

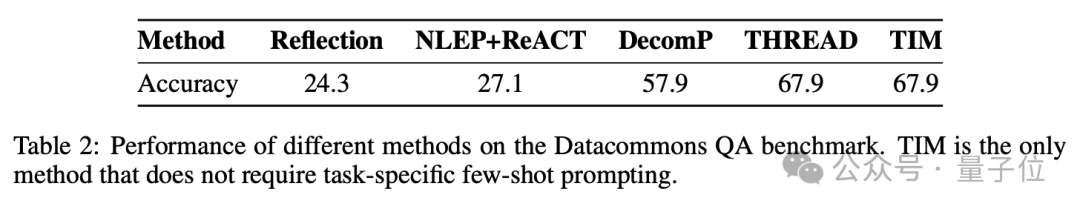

在需要多跳推理和工具使用的研究型任务上,Datacommons QA基准测试TIM达到了67.9%的准确率,与使用4000多token任务特定提示的Thread方法持平,但TIM只需要简洁的系统消息和工具描述。

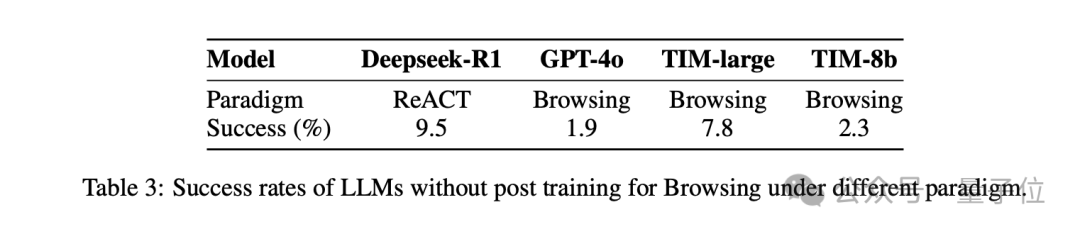

在更具挑战性的BrowseComp深度研究任务上,TIM-large的成功率达到7.8%,显著超过了GPT-4o的1.9%。

效率方面,TIMRUN在批量大小为30的情况下,吞吐量比基线系统SGLang提高了约20%。

更重要的是,随着工具调用次数的增加,SGLang的吞吐量急剧下降,而TIMRUN始终保持稳定,这要归功于其自动的上下文管理机制。

TIM和TIMRUN的组合解决了技术难题,推理这件事,终于不再被窗口框死

论文地址:

https://arxiv.org/abs/2507.16784

文章来自于微信公众号“量子位”,作者是“梦晨”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/