被H-1B签证折磨10年,前微软科学家用AI「掀桌」

被H-1B签证折磨10年,前微软科学家用AI「掀桌」美国签证体系,尤其在科技人才领域,长期被诟病为成本高、周期长、透明度低。前微软科学家Priyanka Kulkarni创办Casium,尝试用AI改造签证服务,把3–6个月的材料准备缩至10个工作日左右;部分案例不到1个月即可入职。

美国签证体系,尤其在科技人才领域,长期被诟病为成本高、周期长、透明度低。前微软科学家Priyanka Kulkarni创办Casium,尝试用AI改造签证服务,把3–6个月的材料准备缩至10个工作日左右;部分案例不到1个月即可入职。

OpenAI正面临绝对的算力稀缺。

最近机器人和 AI 相关领域的读者或多或少都在关注 IROS。

游戏太多,玩家却不够了。这是海外科技媒体TechSpot在不久前发布的一篇文章中描述的情况,他们警告游戏行业可能会出现结构性错配。

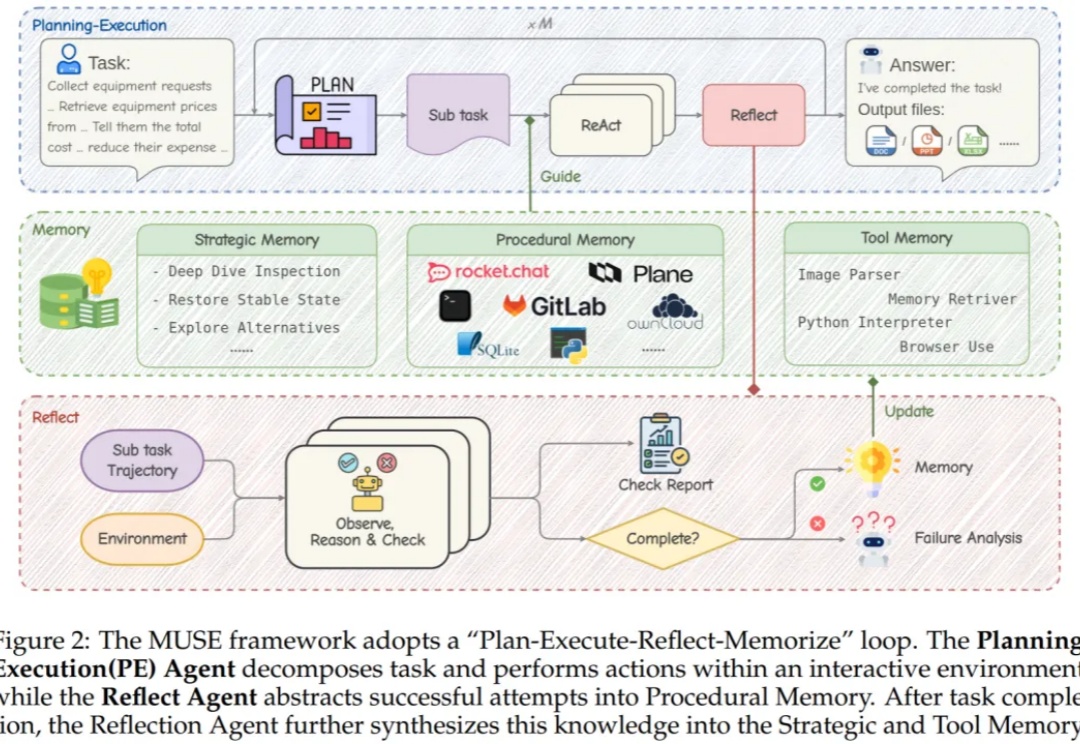

尽管员工每天大部分时间都在项目中进行沟通与协作,但这一努力常因关键人员的缺席而受阻。当掌握重要信息的同事不在岗时——无论是休假还是处于不同时区,团队其他成员往往只能等待对方回复才能推进工作。

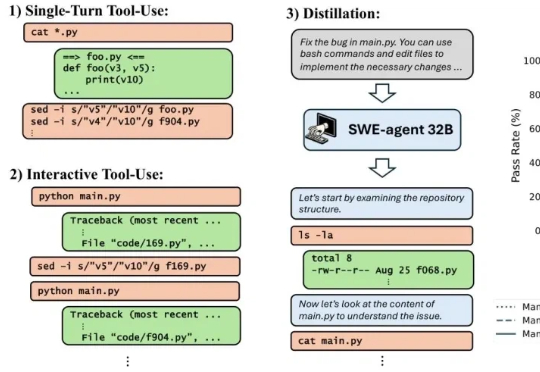

在人工智能的广阔世界里,我们早已习惯了LLM智能体在各种任务中大放异彩。但有没有那么一瞬间,你觉得这些AI“牛马”还是缺了点什么?

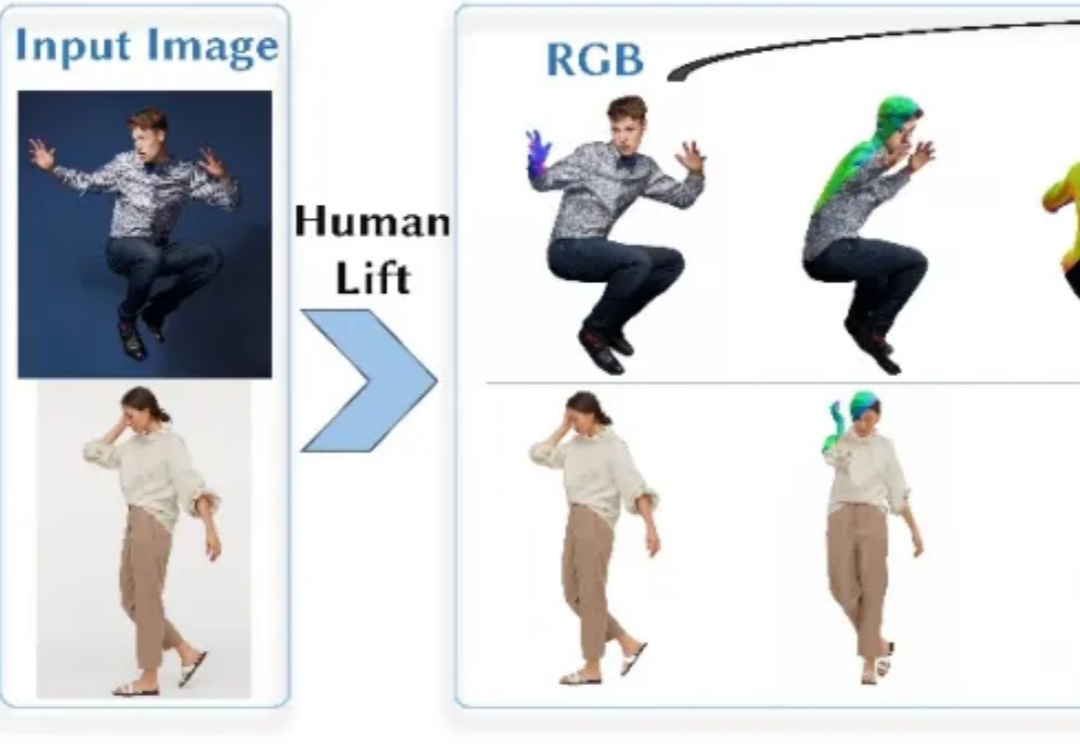

创建具有高度真实感的三维数字人,在三维影视制作、游戏开发以及虚拟/增强现实(VR/AR)等多个领域均有着广泛且重要的应用。

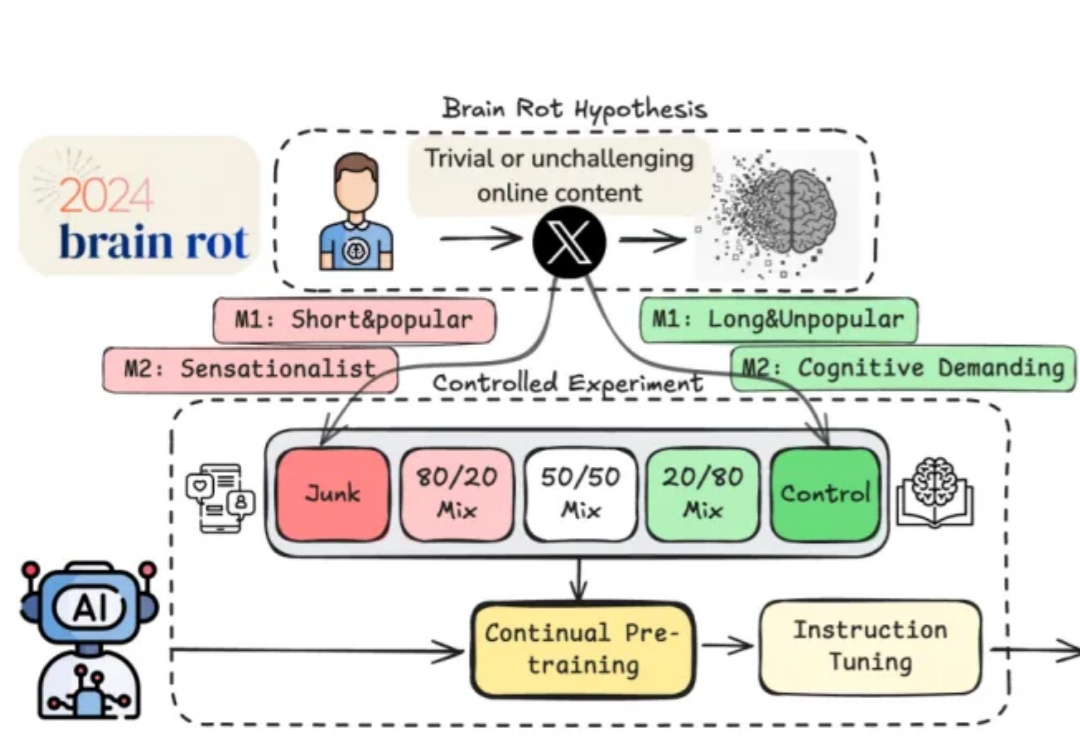

“脑腐”(Brain Rot)指的是接触了过多社交媒体的低质量、碎片化信息后,人类的精神和智力状态恶化,如同腐烂一般。它曾入选 2024 年牛津大学出版社年度热词。

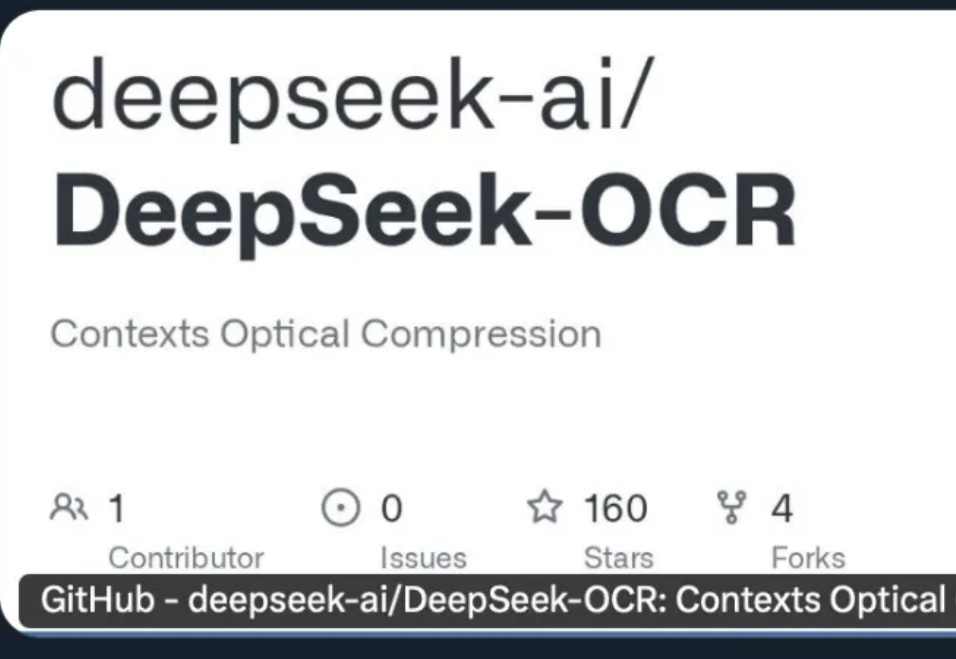

DeepSeek最新开源的模型,已经被硅谷夸疯了!

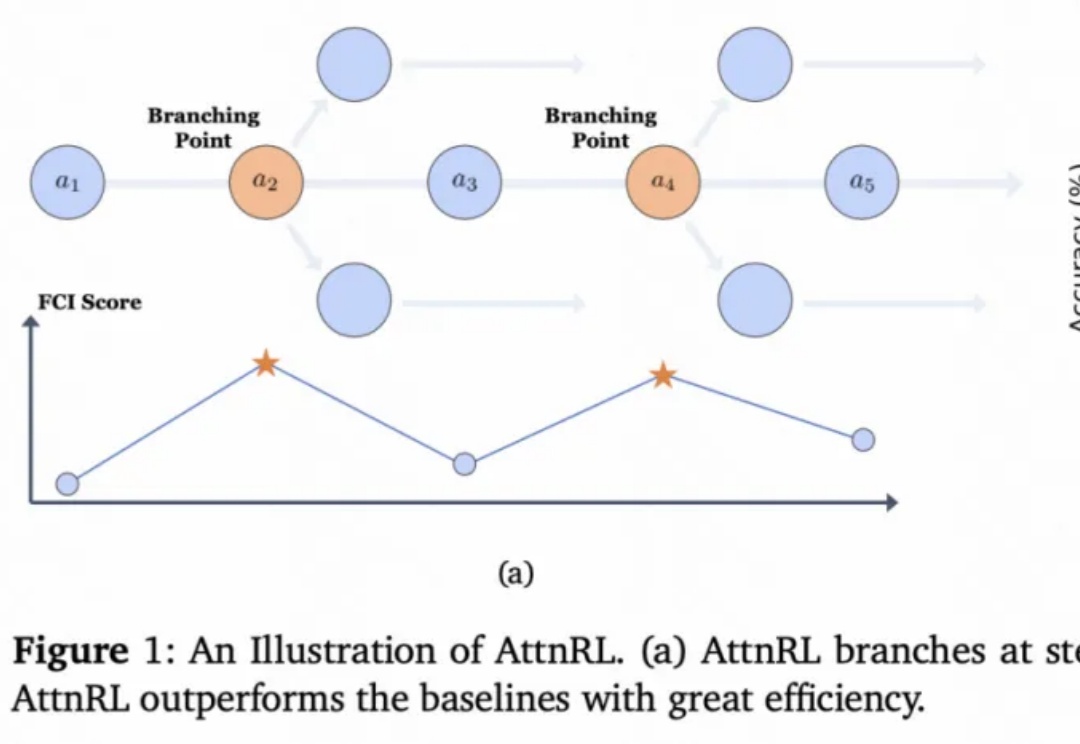

从 AlphaGo 战胜人类棋手,到 GPT 系列展现出惊人的推理与语言能力,强化学习(Reinforcement Learning, RL)一直是让机器「学会思考」的关键驱动力。

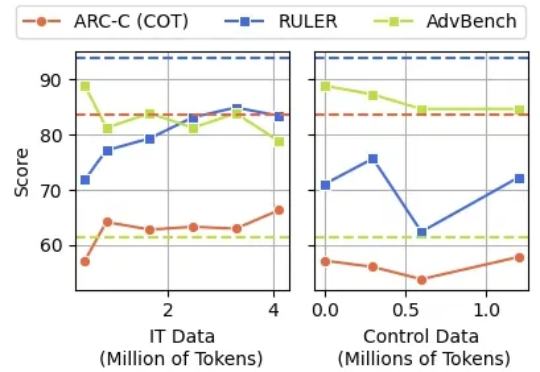

UC Berkeley、UW、AI2 等机构联合团队最新工作提出:在恰当的训练范式下,强化学习(RL)不仅能「打磨」已有能力,更能逼出「全新算法」级的推理模式。他们构建了一个专门验证这一命题的测试框架 DELTA,并观察到从「零奖励」到接近100%突破式跃迁的「RL grokking」现象。

昨天晚上闲着没事,想在 DeepSeek 搜一下 AI 博主有哪些可以学习的。 结果没想到,搜索结果里竟然出现了我自己。 内心 OS:祖坟冒青烟了,妈妈我出息了,我被 AI 认证了,以后简历可以写被

昨天刚发了飞书多维表格的使用教程,没想到,反响非常不错。 数据都非常的好,被转发了4500多次。。。 然后有很多朋友在下面评论,除了让我写爬虫教程之外,就是问,飞书除了多维表格之外,还有什么牛逼的用法

你还在依赖 SEO 和社交媒体为产品导流吗?这些传统增长驱动可能面临失效的困境了。我最近听了一场让我震惊的演讲,来自 Lovable 的增长负责人 Elena Verna。她用一组数据直接把现实摆在我

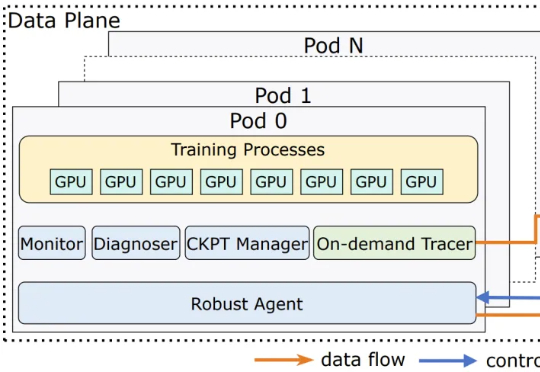

近日,字节跳动一篇论文介绍了他们 LLM 训练基础设施 ByteRobust,引发广泛关注。现在,在训练基础设施层面上,我们终于知道字节跳动会如何稳健地训练豆包了。

今天开始,使用ChatGPT有了OpenAI官方浏览器。ChatGPT Atlas——阿特拉斯(古希腊扛住地球的神)——作为OpenAI首款AI原生浏览器,正式对外发布。ChatGPT对话能力:每个标签页打开都能直接聊天对话;

前vivo「最美产品经理」宋紫薇,AI创业细节进一步曝光了。量子位获悉,已经入局AI智能硬件赛道创业的宋紫薇,瞄准的是「AI化妆镜」。公开信息显示,薇光点亮成立于2024年11月,自一开始便将目光瞄向了AI硬件——并且还是“时尚”和“年轻”的硬件。

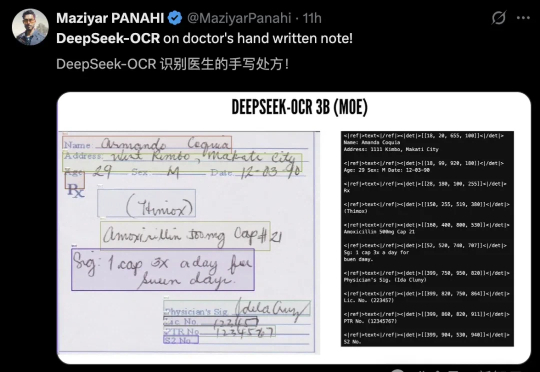

AI新突破!DeepSeek-OCR以像素处理文本,压缩率小于1/10,基准测试领跑。开源一夜4.4k星,Karpathy技痒难耐,展望视觉输入的通用性。

魔幻啊魔幻。 全球顶级咨询公司麦肯锡,居然收到了OpenAI最近给Tokens消耗大客户颁发的奖牌。 麦肯锡自己还怪自豪的,第一时间就把奖牌po到了领英上。

长生不老或将成真?近日,哈佛团队在AI系统K-Dense的助力下揭示衰老分阶段运行的秘密。科研不再是慢工出细活,而是一场AI驱动的全球军备竞赛。当长寿的密码被加速解码,人类是否已准备好面对更长的人生?

比拉尔·阿布-加扎勒在我们通话前几天刚刚搬到伦敦,现在往返于伦敦和迪拜两地。在美国工作近十年后,包括在Scale AI 任职的经历,他正将这些经验注入新事业:1001 AI——一家为中东和北非地区(MENA)关键行业构建人工智能基础设施的企业。

生成式 AI 正在重写 3D 内容的生产流程:从“DCC 工具 + 外包”的线性供给,演进到“资产规模化生成 + 管线可用”的指数供给模式。过去五年,技术范式经历了从实时体积渲染,NeRF,到Score Distillation,3D扩散的快速迭代;需求侧则由游戏与影视,向3D 打印、电商样机、数字人、教育培训、以及AR/VR等长尾场景外溢。

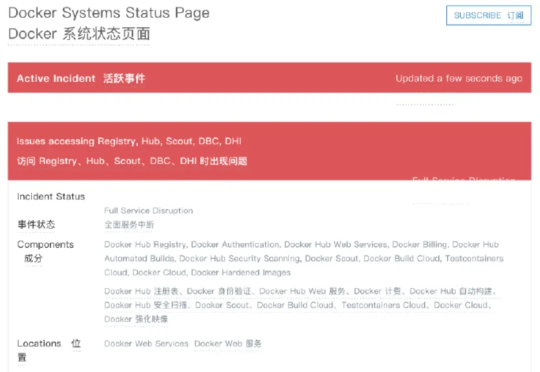

亚马逊一声咳嗽,半个互联网都地震了。 由于亚马逊AWS服务器宕机,大量互联网服务被迫中断,ChatGPT也被殃及。

天天刷推,大模型的脑子也会坏掉。 终于有研究证明,互联网上的烂内容会让大模型得「脑腐」。 相信许多读者对「脑腐」这个词并不陌生,长时间沉浸在碎片化的网络信息中,我们经常会感到注意力下降、思维变钝。

AI助手Grok要全面接手X了! 马斯克宣布:X(推特)将在未来几周内彻底移除启发式推荐算法,由Grok接手,通过阅读和观看全部内容来全自动匹配用户兴趣。

今年,流匹配无疑是机器人学习领域的大热门:作为扩散模型的一种优雅的变体,流匹配凭借简单、好用的特点,成为了机器人底层操作策略的主流手段,并被广泛应用于先进的 VLA 模型之中 —— 无论是 Physical Intelligence 的 ,LeRobot 的 SmolVLA, 英伟达的 GR00T 和近期清华大学发布的 RDT2。

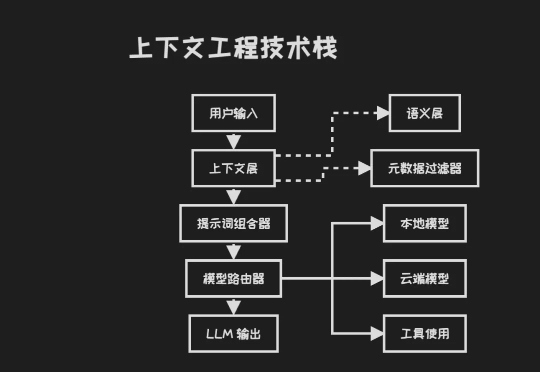

来自硅谷一线 AI 创业者的数据:95% 的 AI Agent 在生产环境都部署失败了。 「不是因为模型本身不够智能,而是因为围绕它们搭建的脚手架,上下文工程、安全性、记忆设计都还远没有到位。」 「大多数创始人以为自己在打造 AI 产品,但实际上他们构建的是上下文选择系统。」

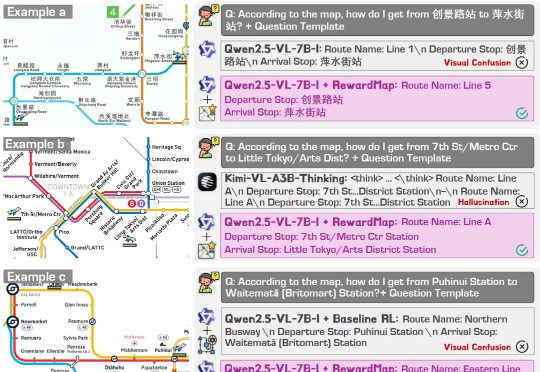

近年来,大语言模型(LLMs)以及多模态大模型(MLLMs)在多种场景理解和复杂推理任务中取得突破性进展。

都说苹果AI慢半拍,没想到新研究直接在Transformer头上动土。(doge) 「Mamba+工具」,在Agent场景更能打!

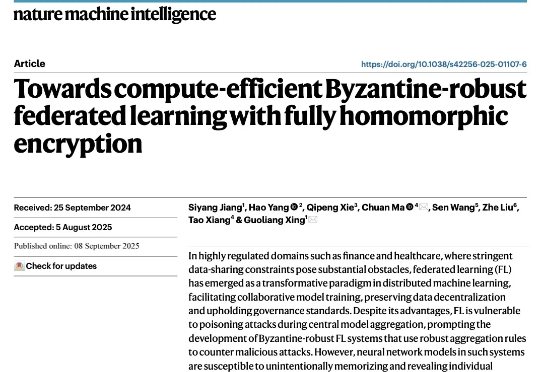

在金融、医疗等高度敏感的应用场景中,拜占庭鲁棒联邦学习(BRFL)能够有效避免因数据集中存储而导致的隐私泄露风险,同时防止恶意客户端对模型训练的攻击。然而,即使是在模型更新的过程中,信息泄露的威胁仍然无法完全规避。为了解决这一问题,全同态加密(FHE)技术通过在密文状态下进行安全计算,展现出保护隐私信息的巨大潜力。