拒绝谷歌 230 亿美元收购,这家公司凭什么?

拒绝谷歌 230 亿美元收购,这家公司凭什么?7 月 23 日,网络安全初创公司Wiz CEO Assaf Rappaport 在给员工的备忘录中宣布拒绝 Google 高达 230 亿美元的收购提议,他还表示 Wiz 下一个目标是实现 10 亿美元 ARR 并进行 IPO。

7 月 23 日,网络安全初创公司Wiz CEO Assaf Rappaport 在给员工的备忘录中宣布拒绝 Google 高达 230 亿美元的收购提议,他还表示 Wiz 下一个目标是实现 10 亿美元 ARR 并进行 IPO。

谷歌提出了一种新的基于ML的大气环流模型NeuralGCM,比传统的基于物理的模型节省了几个数量级的计算量,计算成本降低了10万倍,相当于高性能计算领域25年的进步速度。对于2-15天的天气预报,这种方法比SOTA物理模型还要准确。

巴黎奥运会期间,谷歌将首次携NBCUniversal,利用Gemini让AI技术走进赛场,为观众带来前所未有的观赛体验。

大公司与初创企业的差异,就决定了前者不得不选择保守。

前谷歌科学家Yi Tay重磅推出「LLM时代的模型架构」系列博客,首篇博文的话题关于:基于encoder-only架构的BERT是如何被基于encoder-decoder架构的T5所取代的,分析了BERT灭绝的始末以及不同架构模型的优缺点,以史为鉴,对于未来的创新具有重要意义。

OpenAI挖来前谷歌芯片员工,正与博通洽谈芯片开发。

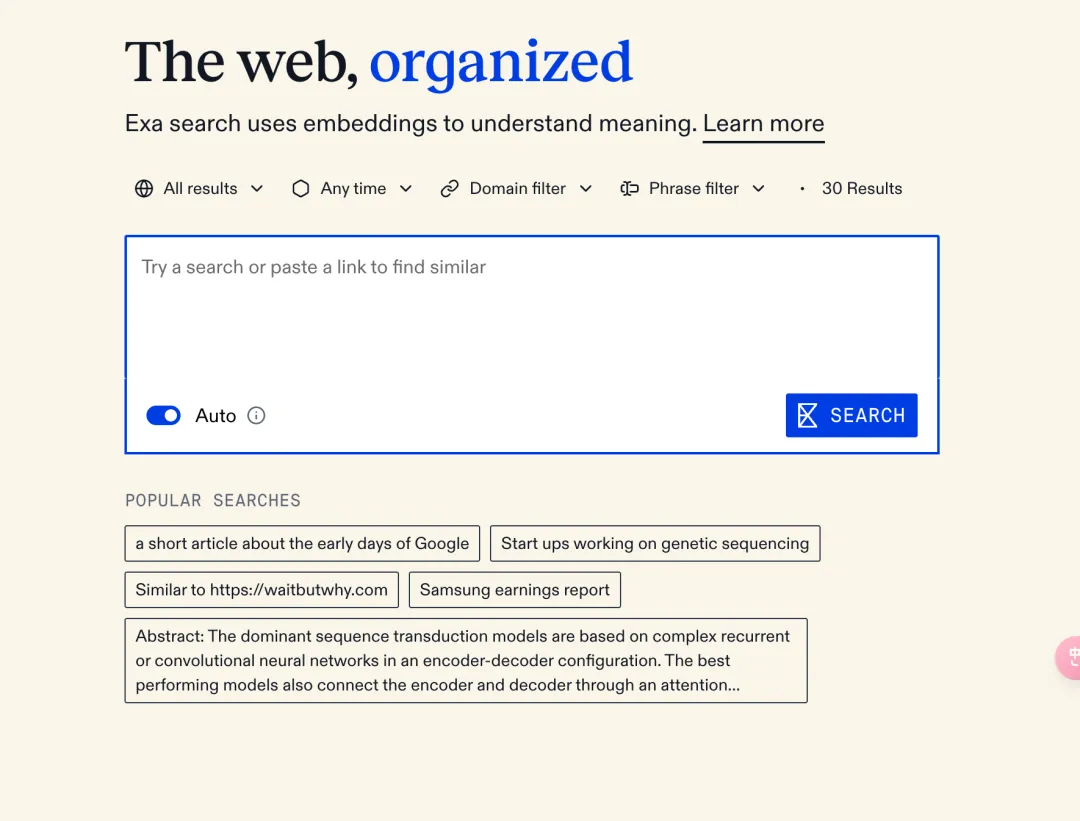

尽管有很多初创公司试图用人工智能驱动的搜索来取代当下的搜索引擎,但一家名为 Exa 的初创公司有一个不同的想法:为人工智能打造一个谷歌。创始人 Jeff Wang 和 Will Bryk 认为 Google 为人类做了什么,他们就希望通过 Exa 为 AI 做类似的事情。

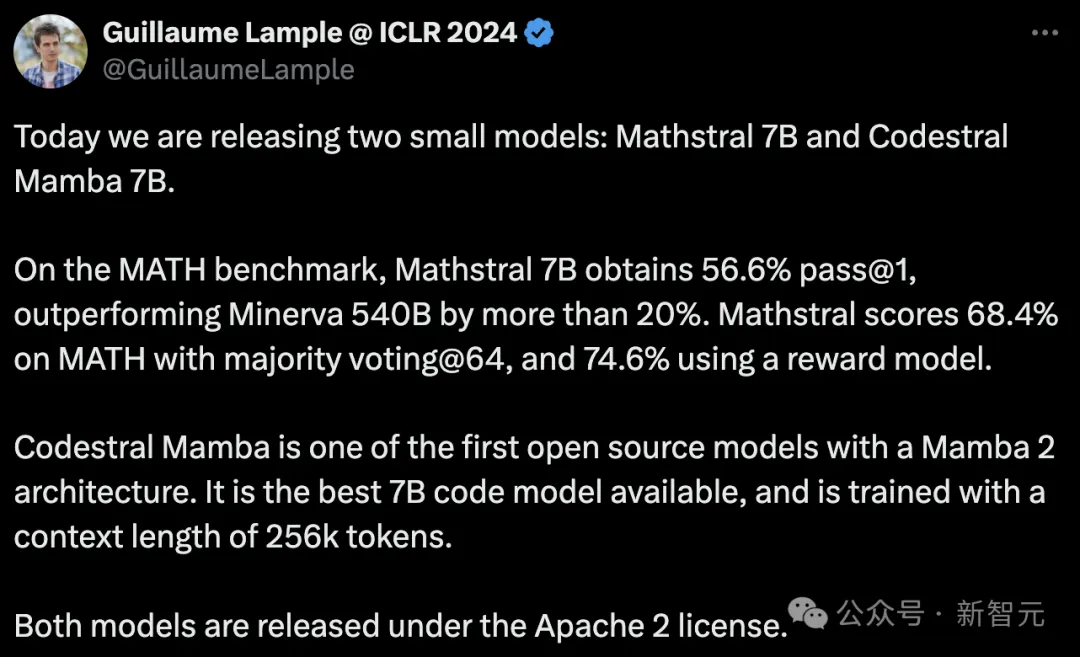

最近,7B小模型又成为了AI巨头们竞相追赶的潮流。继谷歌的Gemma2 7B后,Mistral今天又发布了两个7B模型,分别是针对STEM学科的Mathstral,以及使用Mamaba架构的代码模型Codestral Mamba。

「机器学习一直生活在一个令机器人专家、化学家、生物学家和神经科学家羡慕不已的泡沫中,随着它真正开始发挥作用,我们所有人都将遇到其他人多年来一直在应对的同样的现实壁垒。」

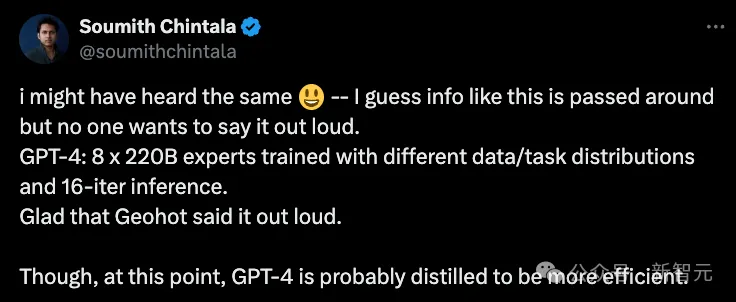

MoE已然成为AI界的主流架构,不论是开源Grok,还是闭源GPT-4,皆是其拥趸。然而,这些模型的专家,最大数量仅有32个。最近,谷歌DeepMind提出了全新的策略PEER,可将MoE扩展到百万个专家,还不会增加计算成本。