CVPR 2024高分论文:全新生成式编辑框架GenN2N,统一NeRF转换任务

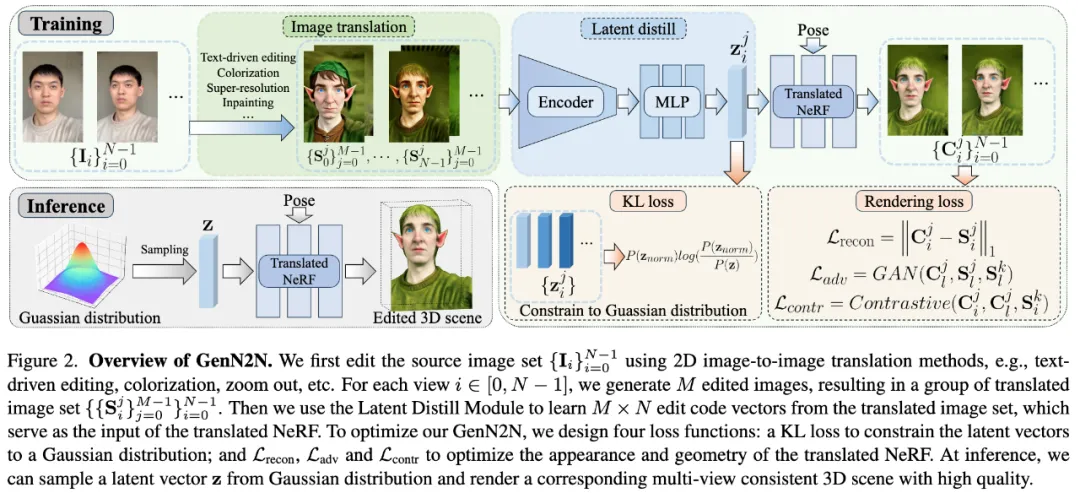

CVPR 2024高分论文:全新生成式编辑框架GenN2N,统一NeRF转换任务来自香港科技大学,清华大学的研究者提出了「GenN2N」,一个统一的生成式 NeRF-to-NeRF 转换框架,适用于各种 NeRF 转换任务,例如文字驱动的 NeRF 编辑、着色、超分辨率、修复等,性能均表现极其出色!

搜索

搜索

来自香港科技大学,清华大学的研究者提出了「GenN2N」,一个统一的生成式 NeRF-to-NeRF 转换框架,适用于各种 NeRF 转换任务,例如文字驱动的 NeRF 编辑、着色、超分辨率、修复等,性能均表现极其出色!

近期,硅谷 AI 公司 OpenAI 可谓是话题度拉满,先是一出「宫斗戏」引起舆论哗然,后是公布 Sora 效果炸裂受到了全网的一致好评。在这期间,一桩诉讼案件同样引爆了热点 —— 因 ChatGPT 涉嫌侵犯纽约时报著作权,OpenAI 及微软被起诉并要求支付巨额版权费 [1]。

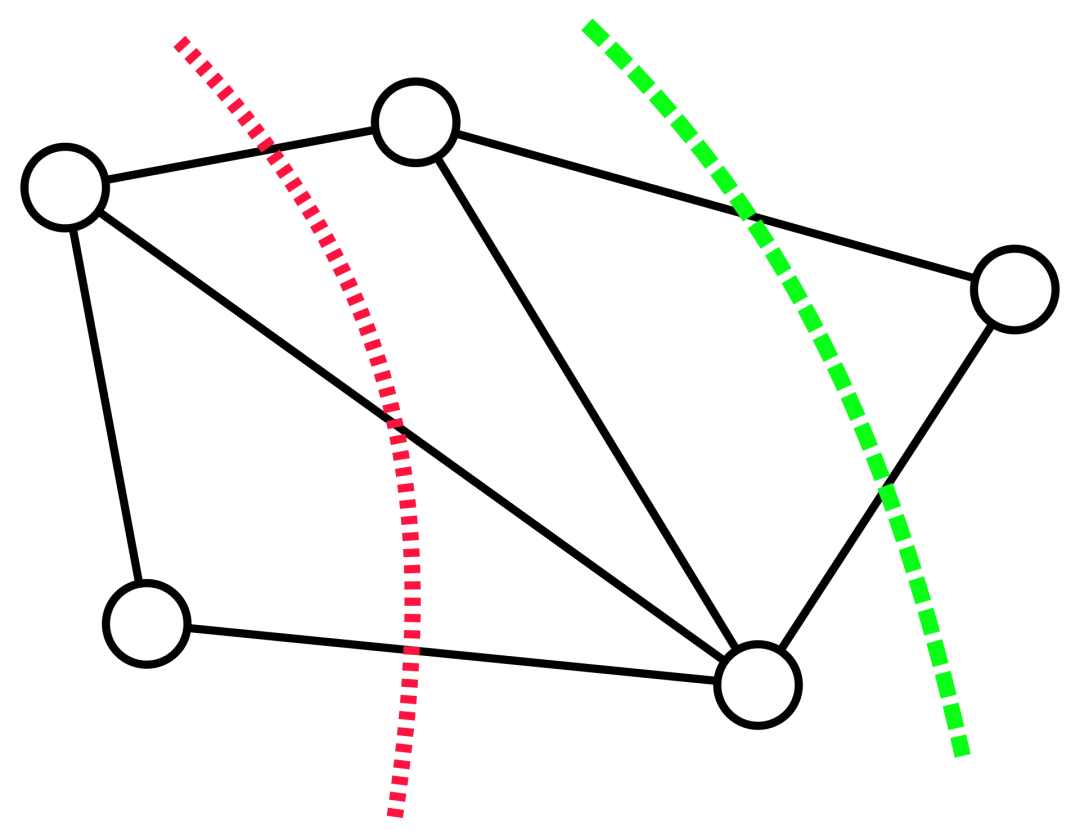

Karger 算法可以在时间为 O (m log^3n) 的图中找到一个最小割点,他们将这个时间称之为近线性时间,意思是线性乘以一个多对数因子

Transformers 的二次复杂度和弱长度外推限制了它们扩展到长序列的能力,虽然存在线性注意力和状态空间模型等次二次解决方案

继Mamba之后,又一敢于挑战Transformer的架构诞生了!

多任务机器人学习在应对多样化和复杂情景方面具有重要意义。然而,当前的方法受到性能问题和收集训练数据集的困难的限制

脑机接口最新进展登上Nature子刊,深度学习三巨头之一的LeCun都来转发。

如何复盘大模型技术爆发的这一年?除了直观的感受,你还需要一份系统的总结

现今,机器学习(ML),更具体地说,深度学习已经改变了从金融到医疗等广泛的行业。在当前的 ML 范式中,训练数据首先被收集和策划,然后通过最小化训练数据上的某些损失标准来优化 ML 模型

从国际顶流 GPT-4 128K、Claude 200K 到国内「当红炸子鸡」支持 200 万字上下文的 Kimi Chat,大语言模型(LLM)在长上下文技术上不约而同地卷起来了