刚刚,被全网猜是DeepSeek V4的神秘大模型,被小米认领了!还能免费“养龙虾”

刚刚,被全网猜是DeepSeek V4的神秘大模型,被小米认领了!还能免费“养龙虾”今日凌晨,小米MiMo大模型系列重磅三连更:旗舰基座大模型MiMo-V2-Pro、全模态Agent模型MiMo-V2-Omni、MiMo-V2-TTS,其最新发布的这三大模型都是为优化智能体能力打造。

今日凌晨,小米MiMo大模型系列重磅三连更:旗舰基座大模型MiMo-V2-Pro、全模态Agent模型MiMo-V2-Omni、MiMo-V2-TTS,其最新发布的这三大模型都是为优化智能体能力打造。

Midjourney 今天凌晨突然在 Alpha 平台上线 V8 模型测试版,速度暴涨5倍,支持原生2K分辨率,文本渲染大幅改进。官方推文12小时内狂揽131万浏览。但有用户花6小时测试后发现:RAW模式翻车,抽象艺术创作反而更难了。这次更新是王者归来,还是另有隐情?

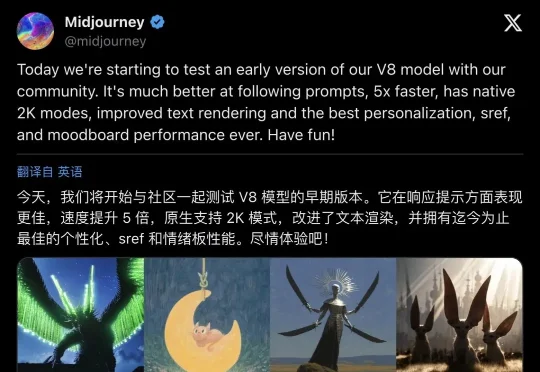

今日凌晨,在英伟达GTC大会上,月之暗面创始人杨植麟作为本届唯一受邀现场演讲的中国独立大模型公司创始人,发表题为《How We Scaled Kimi K2.5》的演讲,首次完整披露Kimi K2.5背后的技术路线图。

近日,世界模型与空间智能前沿公司魔芯科技已完成 Pre-A + 轮近亿元融资。本轮融资由华为哈勃领投,老股东跟投。

AGI,究竟如何评判?刚刚,谷歌DeepMind发出重磅论文,直接从认知科学「借」了一套度量衡——把通用智能拆成10大认知能力,配一套三阶段评估协议,还联合Kaggle砸了20万美金,向全球研究者悬赏:谁能测出真正的AGI?

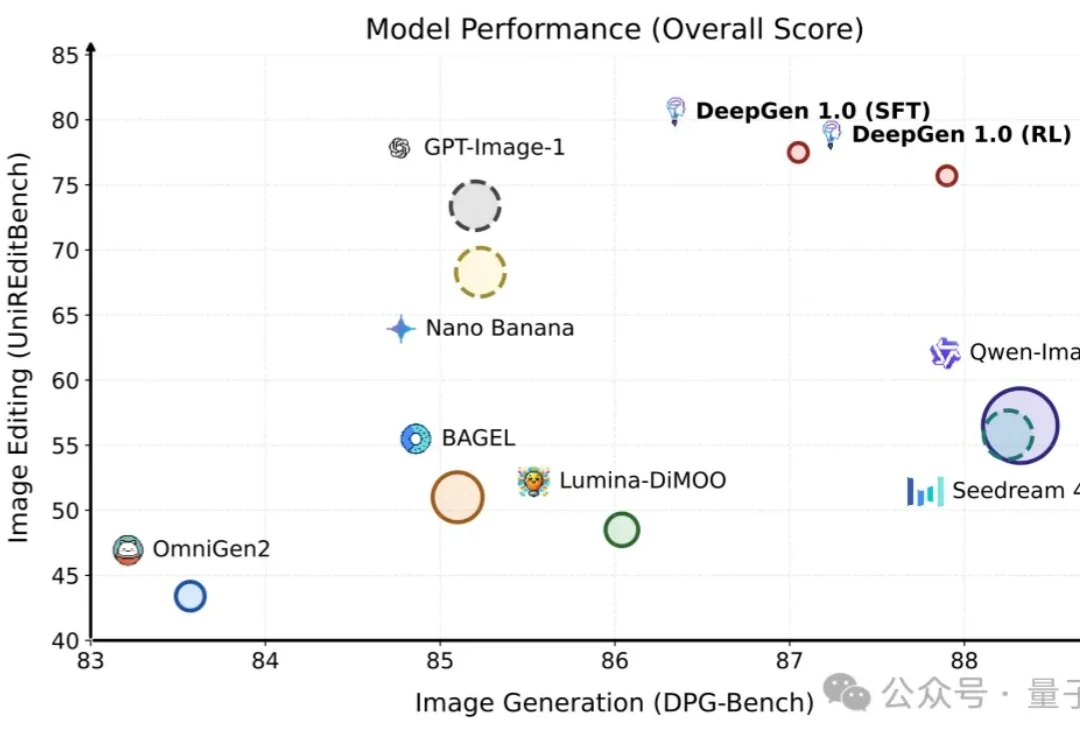

统一多模态生成编辑模型,正在走向“重器化”

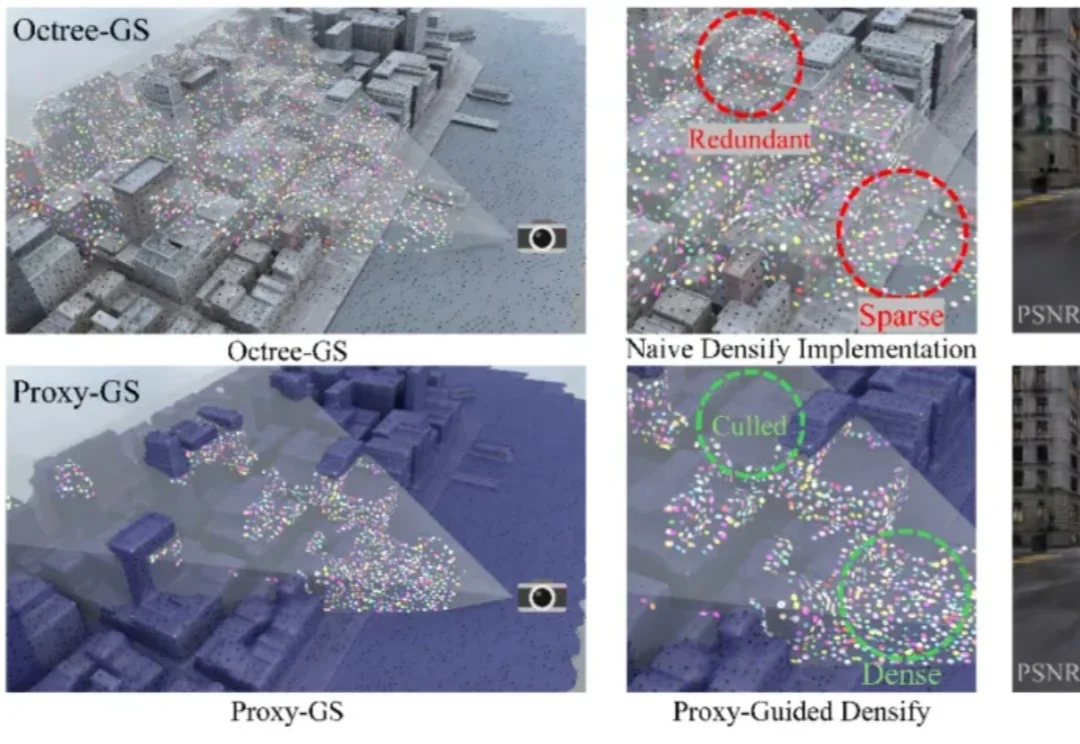

上海交通大学钟志航团队联合上海人工智能实验室、西北工业大学、四川大学等高校在 CVPR 2026 上提出Proxy-GS(Proxy-GS: Unified Occlusion Priors for Training and Inference in Structured 3D Gaussian Splatting),面向基于 MLP 的结构化 3D 高斯溅射(3DGS),

在 M2 系列模型发布后的几个月,我们收到了大量热心用户的反馈和建议,这促使我们进一步加速模型的迭代效率。除了更加认真工作之外,我们能找到的唯一途径就是开启模型和组织的自我进化。MiniMax M2.7 是我们第一个模型深度参与迭代自己的模型。

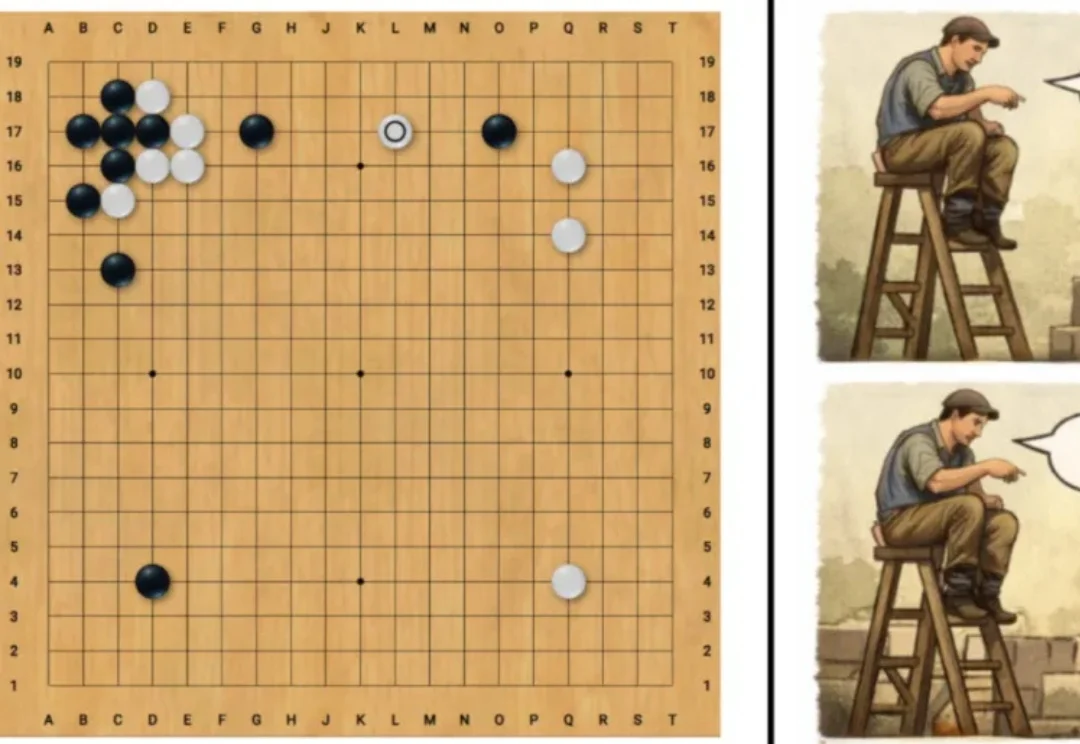

在经典强化学习问题中,动作空间通常是离散且有限的。例如在围棋中,一步棋就是一次行动;在机器人控制或视觉 - 语言 - 行动(VLA)模型中,动作往往来自一个有限的控制指令集合。

模型可以 6 个月迭代一次。Harness 需要系统性的、长时间的打磨。真正的护城河不在模型层,在 Harness 层。 最近因为具体的业务需求,我需要在扣子Coze上落地几个 Workflow 和