2.5天完成1年的MD计算?DeepMind团队基于欧几里得Transformer的新计算方法

2.5天完成1年的MD计算?DeepMind团队基于欧几里得Transformer的新计算方法近年来,基于从头算参考计算的机器学习力场 (MLFF) 的开发取得了巨大进展。虽然实现了较低的测试误差,但由于担心在较长的模拟时间范围内会出现不稳定性,MLFF 在分子动力学 (MD) 模拟中的可靠性正面临越来越多的审查。

近年来,基于从头算参考计算的机器学习力场 (MLFF) 的开发取得了巨大进展。虽然实现了较低的测试误差,但由于担心在较长的模拟时间范围内会出现不稳定性,MLFF 在分子动力学 (MD) 模拟中的可靠性正面临越来越多的审查。

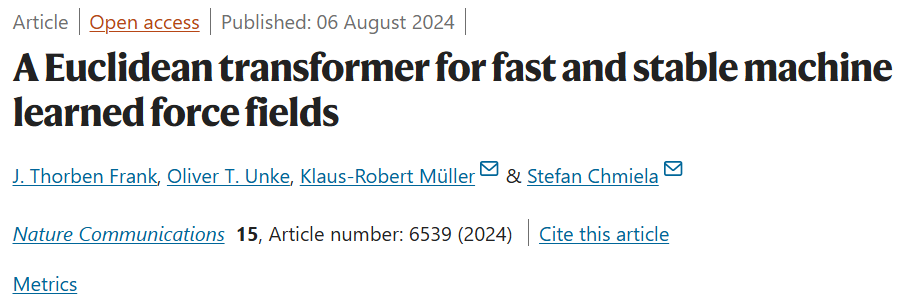

就在刚刚,CMU教授Zico Kolter正式宣布加入OpenAI董事会,并成为安全与安保委员会成员。OpenAI这是终于要在安全上下功夫了?

7月27日,与ICLR(国际学习表示会议)、NeurIPS(神经信息处理系统会议)并称三大机器学习顶级会议的ICML(国际机器学习大会),在奥地利维也纳会展中心落下帷幕。

人到中年,想半路出家转行成机器学习工程师,可行吗?最近,这位成功转行的国外小哥用一篇干货满满的硬核博客告诉我们:完全可以!

7月初,在约翰霍普金斯大学,资深科技记者、播客Pivot的联合主持人Kara Swisher与OpenAI CTO Mira Murati展开了一场火药味十足的对话,计算机科学家、斯坦福大学教授李飞飞也加入了提问阵营,他的另一个身份是Google云人工智能和机器学习首席科学家

用AI模型从代码层面深度分析和防御恶意软件。

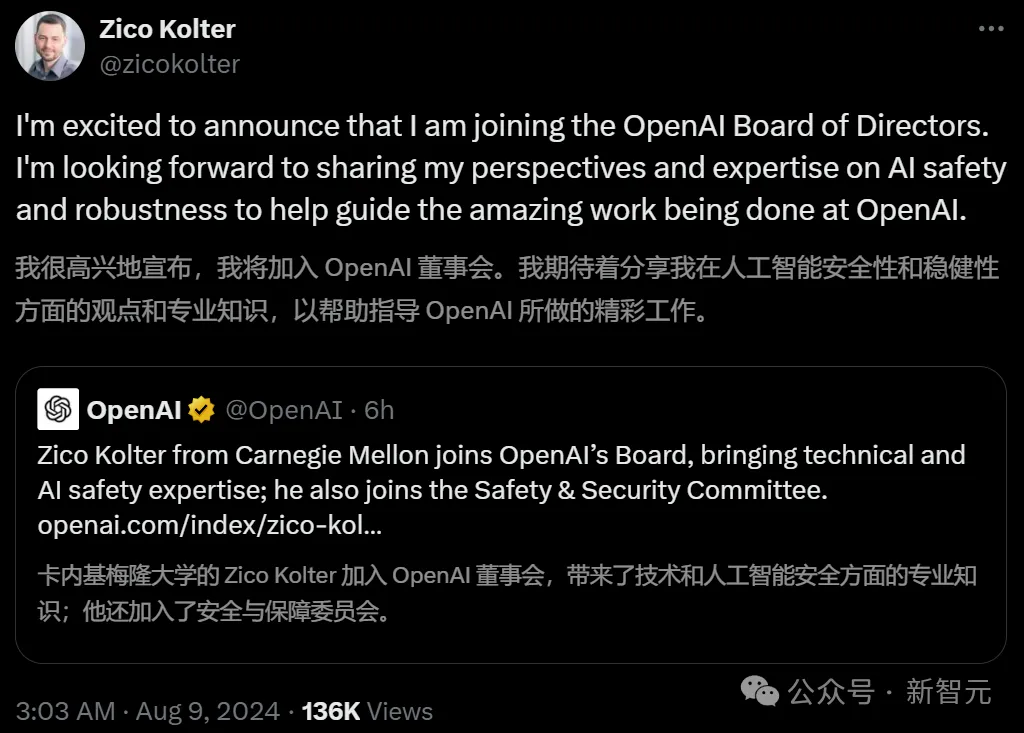

剑桥大学研究利用人工智能建立机器学习模型精准预测阿尔茨海默症发展,准确率远超临床测试结果,为阿尔兹海默症早期干预开辟新路径。

在信息爆炸的当今时代,我们如何从浩如烟海的数据中探寻深层次的联系呢?

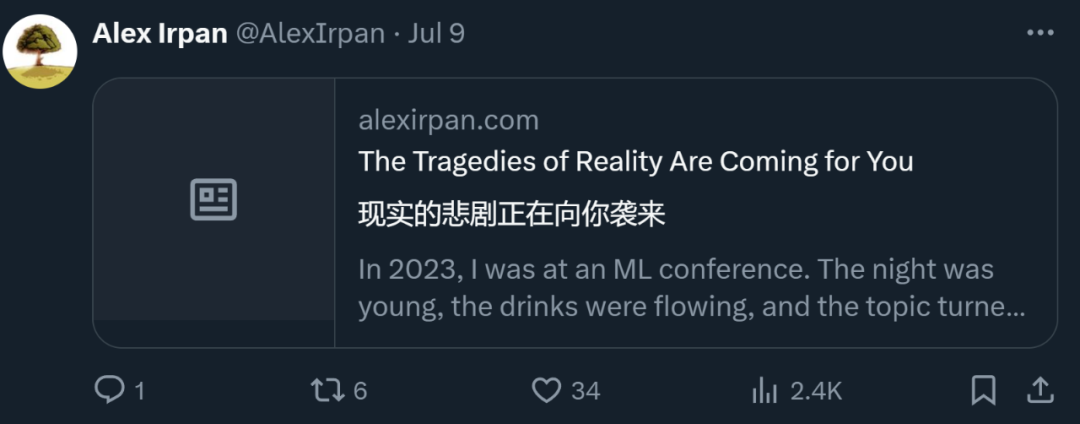

「机器学习一直生活在一个令机器人专家、化学家、生物学家和神经科学家羡慕不已的泡沫中,随着它真正开始发挥作用,我们所有人都将遇到其他人多年来一直在应对的同样的现实壁垒。」

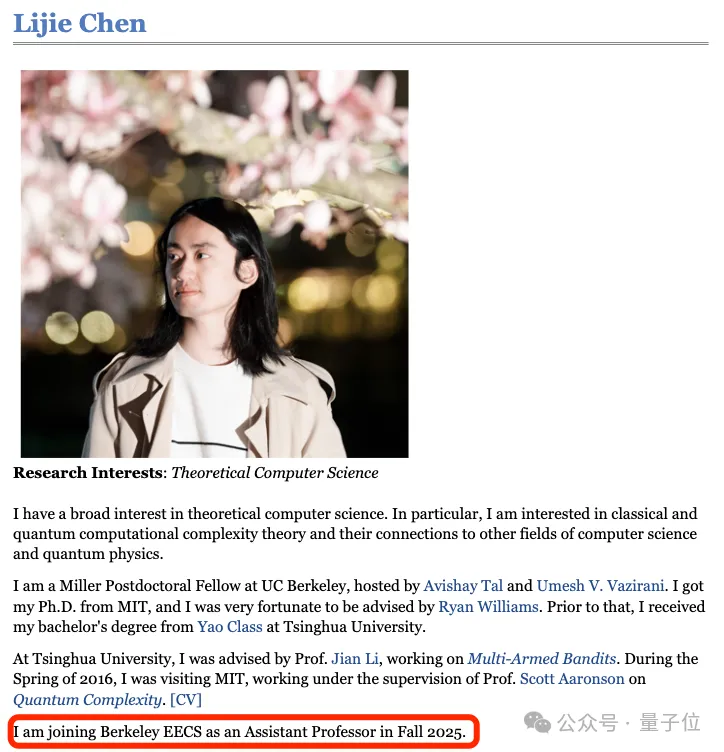

姚班大神陈立杰最新去向现已明朗:2025年秋季起,任加州大学伯克利分校EECS助理教授。