早于DeepSeek Engram!用「查表」重置Transformer记忆 | ICLR

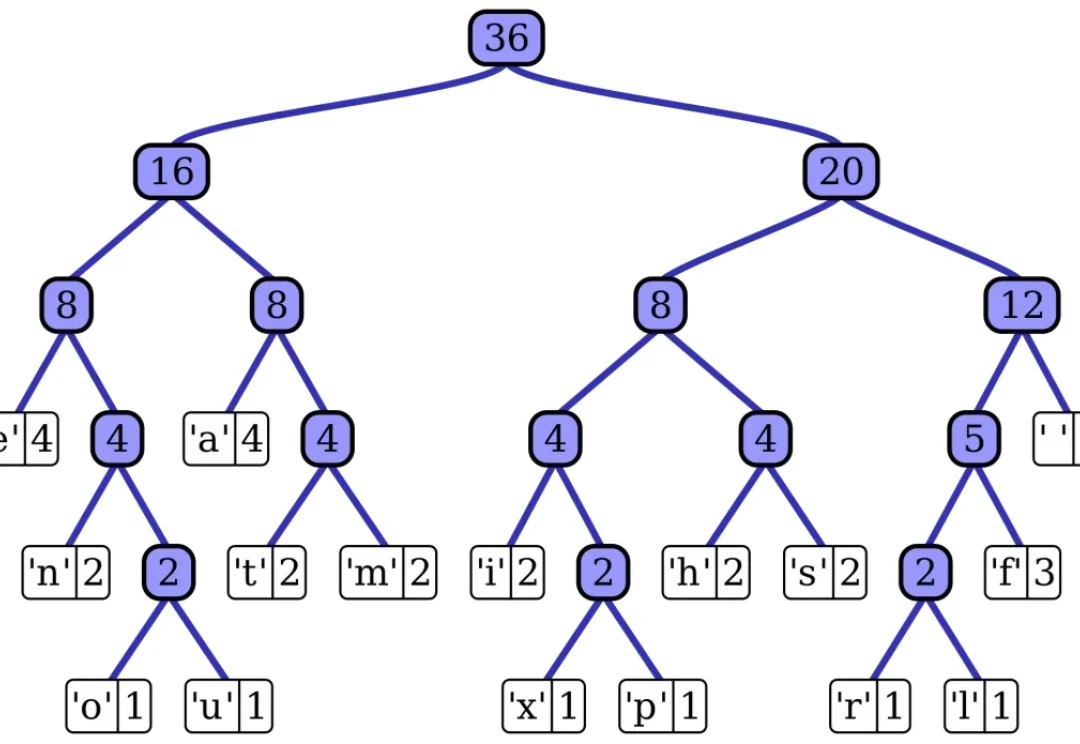

早于DeepSeek Engram!用「查表」重置Transformer记忆 | ICLRICLR论文STEM架构率先提出「查表式记忆」架构,早于DeepSeek Engram三个月。它将Transformer的FFN从动态计算改为静态查表,用token索引的embedding表直接读取记忆,彻底解耦记忆容量与计算开销。

ICLR论文STEM架构率先提出「查表式记忆」架构,早于DeepSeek Engram三个月。它将Transformer的FFN从动态计算改为静态查表,用token索引的embedding表直接读取记忆,彻底解耦记忆容量与计算开销。

您在使用LLM时,如果遇到它胡说八道或者彻底偏题,第一反应是什么?大概率是直接关掉窗口,新开一个对话,懒得跟机器废话。但您可能不知道,这个看似再正常不过的习惯,正在给下一代大语言模型的训练库疯狂“投毒”。

在生成式 AI 领域,视觉分词器(Visual Tokenizer)通常采用固定压缩率 —— 无论是单调的监控画面,还是复杂的动作大片,都被切分为等量的 Token。这种 "一刀切" 的做法不仅会造成巨大的计算冗余,也产生了 “信息量” 不同的 Token,不利于下游理解生成任务处理。

Anthropic 团队正以极高强度内部试用 Claude Code。

3月30日,界面新闻记者从知情人士处独家获悉,3月初,在Kimi K2.5模型发布一个月之后,月之暗面ARR(年度经常性收入)突破1亿美金。知情人士还表示,K2.5模型上线后,API供应的TPM(Tokens Per Minute,每分钟令牌数)配额迅速趋紧,有客户开出千万美元级别的消费承诺及预付担保,以期获得优先供应。

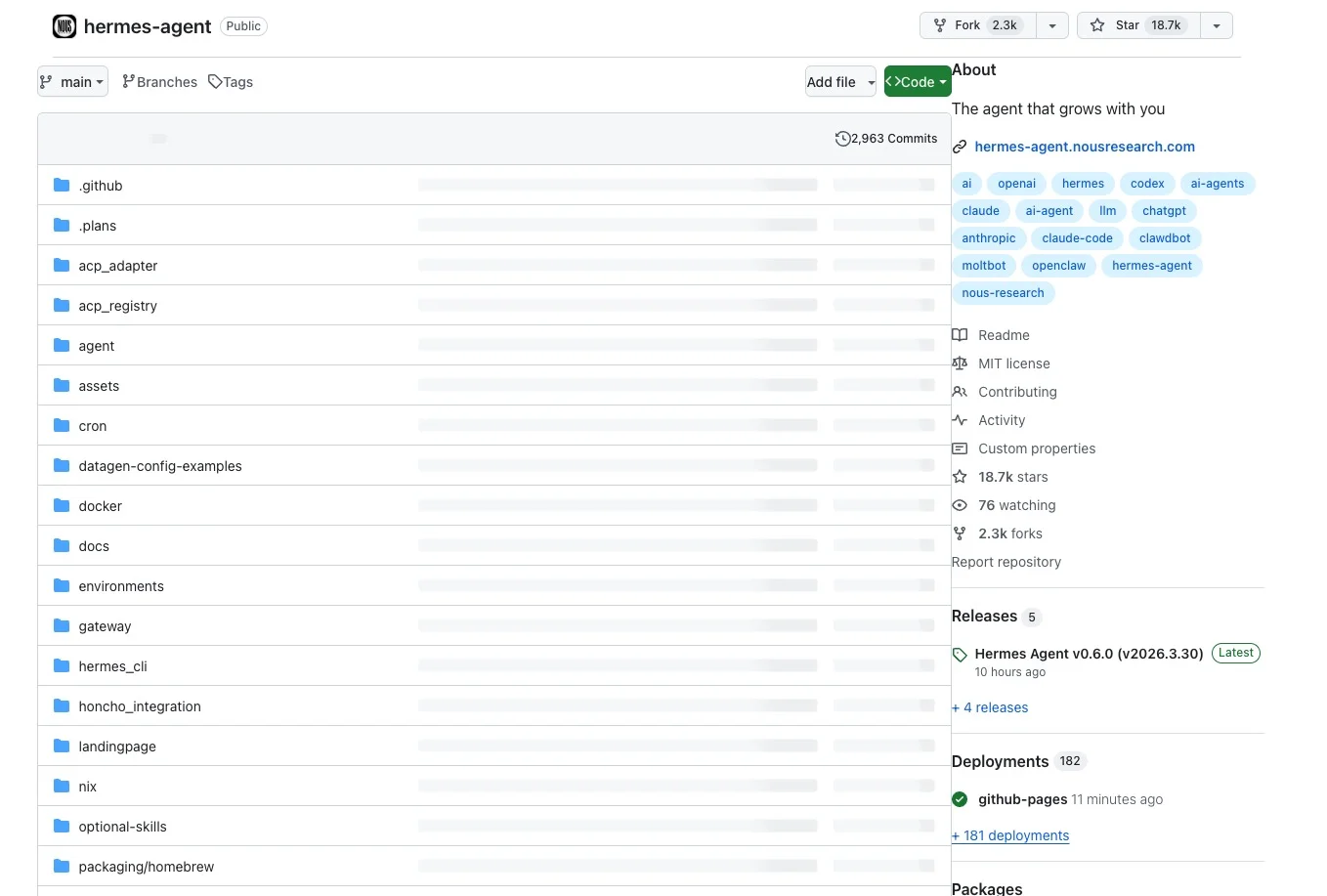

养了很多只龙虾,虽然有几只已稳定在岗,但依旧对OpenClaw脆弱的记忆机制感到恼火,明明昨晚千叮万嘱的工作流,第二天一早就忘的一干二净。虽然也找了各种补丁给OpenClaw打上,但效果却各种不尽人意。

大模型的狂热已然退潮。当我们将目光从参数榜单转向真实的活跃数据,四家头部大厂的底层商业图谱已极度收敛。AI的竞争,早已变成一场基于算力成本与高频场景的残酷算账。

官方宣传语:你是否隐隐担忧,自己或身边的人正在:参与一场席卷所有人的技能大退化?遭受 LLM 诱发的?一个名为 Sam Lavigne 的大学教授,最近发布并开源了一款名为「Slow LLM」的 AI 工具。

AirJelly 发布了内测版本。

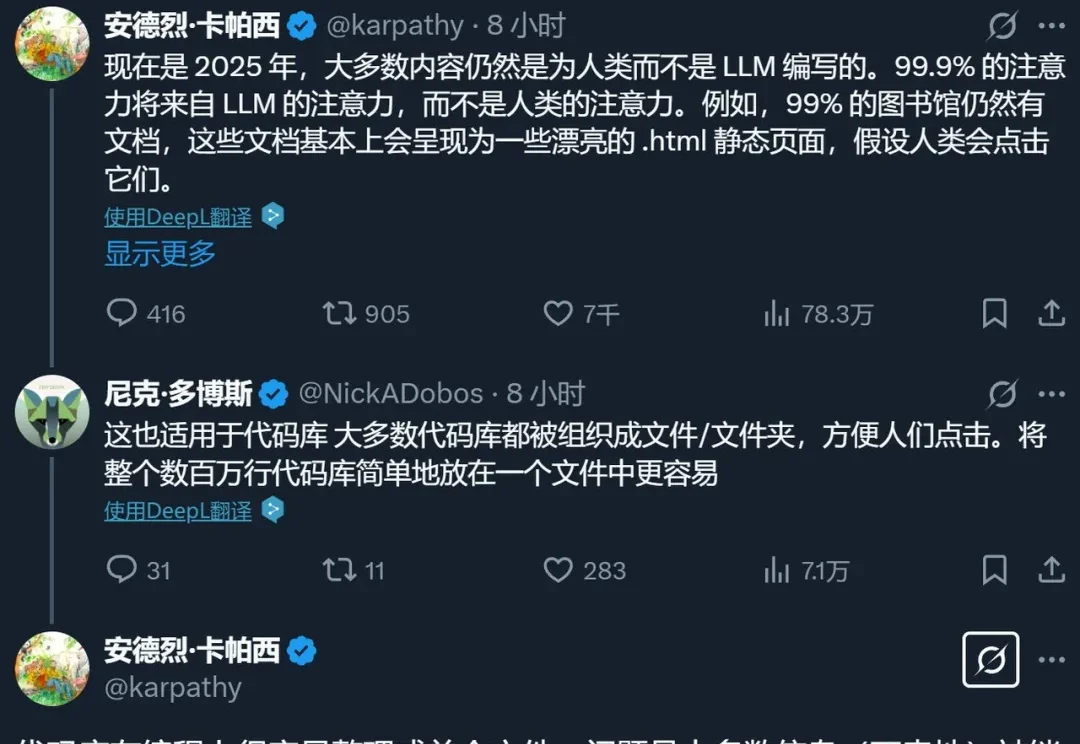

不知道大家还记不记得,去年 3 月,AI 大牛 Karpathy 发过一条推文。大体意思是说:现在的大多数内容仍然是为人类编写的,但未来,读取这些内容的可能就不是人类而是 AI 了。因此,从现在开始,我们就要考虑怎么把文档写得对 AI 更友好。