号称超越 GPT-4 的大模型们,有多少靠的是“抄袭”

号称超越 GPT-4 的大模型们,有多少靠的是“抄袭”大家相互薅羊毛,要用,但要小心用,一不小心就尴尬了。 一位国产大模型算法工程师在接受「甲子光年」采访时的吐槽,可以说是非常到位了。 它准确地阐述 AI 业内一个所有人「心照不宣」的公开秘密。

大家相互薅羊毛,要用,但要小心用,一不小心就尴尬了。 一位国产大模型算法工程师在接受「甲子光年」采访时的吐槽,可以说是非常到位了。 它准确地阐述 AI 业内一个所有人「心照不宣」的公开秘密。

2023年12月,宁德时代低调宣布在香港设立国际研发中心; 2024年3月11日,作为中国科学院在香港设立的首个国家级信息研发机构,中国科学院香港创新研究院人工智能与机器人创新中心发布了医疗多模态大模型CARES Copilot 1.0;

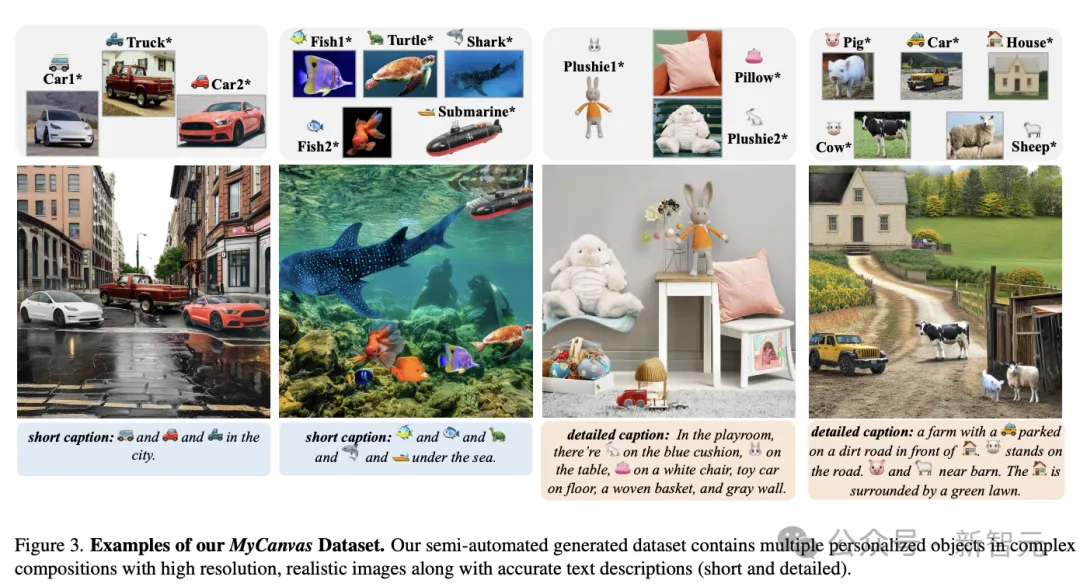

过去几年里,基于文本来生成图像的扩散模型得到了飞速发展,生成能力有了显著的提升,可以很容易地生成逼真的肖像画,以及各种天马行空的奇幻画作。

近日有消息称,微软将在日本组建数据中心,两年内将投入29亿美金,旨在全球生成式AI发展进程中,为其提供完备的数据及设备支撑。这也是历史以来微软向日本投资的最大一笔金额。

智东西4月19日消息,Meta推出迄今为止能力最强的开源大模型Llama 3系列,发布8B和70B两个版本。 Llama 3在一众榜单中取得开源SOTA(当前最优效果)。Llama 3 8B在MMLU、GPQA、HumanEval、GSM-8K等多项基准上超过谷歌Gemma 7B和Mistral 7B Instruct。

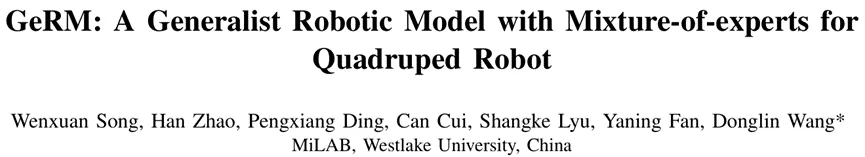

多任务机器人学习在应对多样化和复杂情景方面具有重要意义。然而,当前的方法受到性能问题和收集训练数据集的困难的限制

纵观生成式AI领域中的两个主导者:自回归和扩散模型。 一个专攻文本等离散数据,一个长于图像等连续数据。 如果,我们让后者来挑战前者的主场,它能行吗?

最近,一则数据点出了AI领域算力需求的惊人增长—— 根据业内专家的预估,OpenAI推出的Sora在训练环节大约需要在4200-10500张NVIDIA H100上训练1个月,并且当模型生成到推理环节以后,计算成本还将迅速超过训练环节。

编者按:从2014年开始,Matt Turck每年都会推出一个反映大数据、机器学习、人工智能整体格局的版图

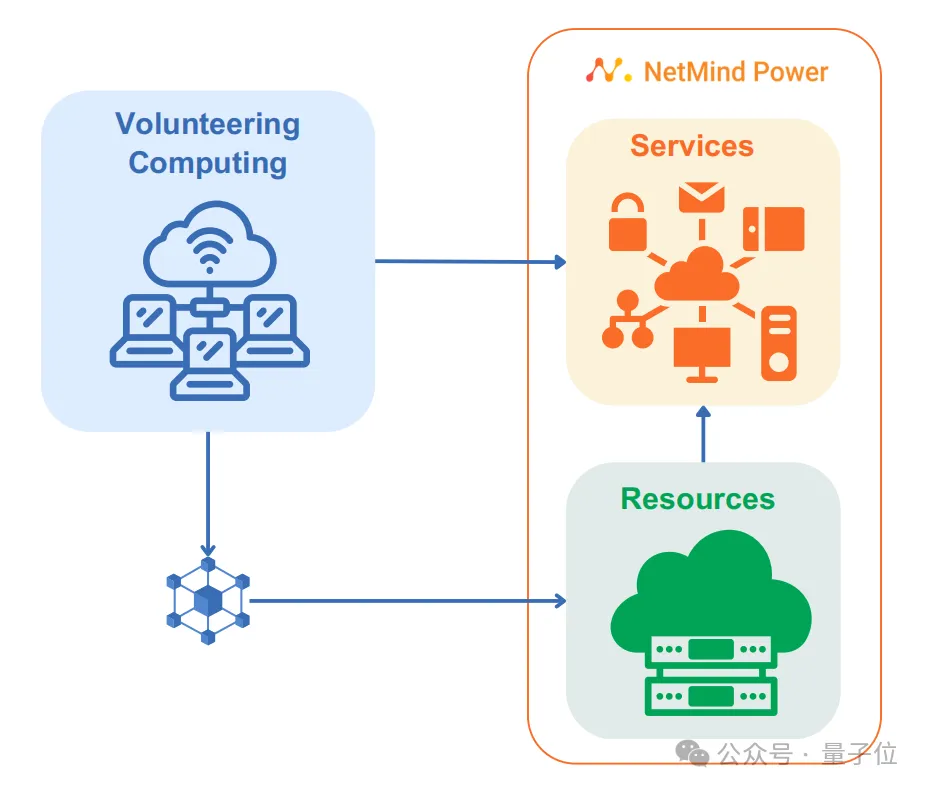

现今,机器学习(ML),更具体地说,深度学习已经改变了从金融到医疗等广泛的行业。在当前的 ML 范式中,训练数据首先被收集和策划,然后通过最小化训练数据上的某些损失标准来优化 ML 模型