突破传统:AI如何应对心电图中的长尾挑战?

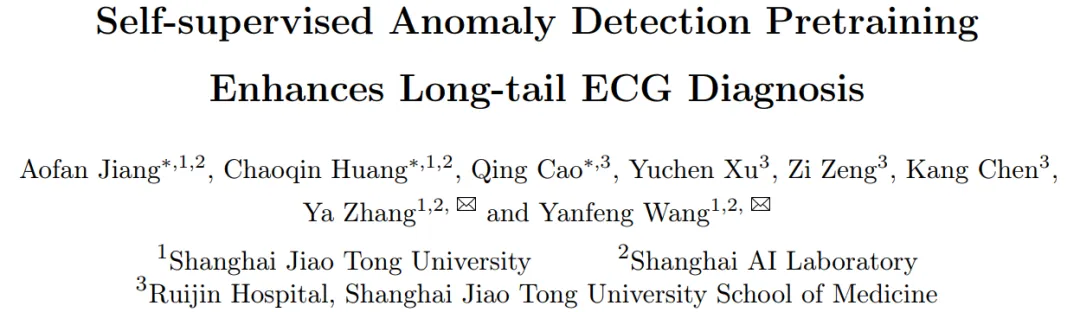

突破传统:AI如何应对心电图中的长尾挑战?近日,上海交通大学、上海人工智能实验室和上海交通大学附属瑞金医院联合团队发布基于异常检测预训练的心电长尾诊断模型。

近日,上海交通大学、上海人工智能实验室和上海交通大学附属瑞金医院联合团队发布基于异常检测预训练的心电长尾诊断模型。

根据最新泄露的数据,英伟达GeForce RTX 5080的功耗或将提升至400W,并在部分性能上达到RTX 4090的110%!而RTX 5090的功耗预计将增加150W,达到惊人的600W。

训练代码、中间 checkpoint、训练日志和训练数据都已经开源。

AlphaFold2解决了很大程度上解决了单体蛋白质结构预测问题。

企业要用好 LLM 离不开高质量数据。和传统机器学习模型相比,LLM 对于数据需求量更大、要求更高,尤其是非结构化数据。而传统 ETL 工具并不擅长非结构化数据的处理,因此,企业在部署 LLM 的过程中,数据科学家们往往要耗费大量的时间精力在数据处理环节。这一环节既关系到 LLM 部署的效率和质量,也对数据科学家人力的 ROI 产生影响。

训练数据的质量优劣,直接影响人工智能(AI)大模型的能力水平。

报告显示,目前国内生成式AI应用快速发展,预计市场规模有望达到4000亿元。 9月3日,极光旗下月狐数据发布《AI生产力工具暑期发展报告》。数据显示,AI生产力工具在用户侧呈现高速增长态势,总体月活跃用户数量达1.7亿。其中,夸克APP实现暑期新增用户数量行业第一,凭借大模型、数据、场景等优势,让更多用户享受到一站式AI服务。

内含一键部署教程

说好的AI给人类打工呢? 为了拿到新数据、训练AI大模型,字节等互联网大厂正在亲自下场,以单次300元不等的价格招募“AI录音员”,定制语料库。

据相关数据显示,早在 2020 年,国内选择语音输入的用户数量已经达到 2.5 亿,使用率接近 40%,更为便捷的语音交流,已经越来越成为主流。