OpenAI称有DeepSeek「偷窃」证据?美军已发起攻击!Anthropic CEO喊话加强芯片管制

OpenAI称有DeepSeek「偷窃」证据?美军已发起攻击!Anthropic CEO喊话加强芯片管制他们急了!特朗普的AI沙皇和微软纷纷指控DeepSeek「偷窃」数据,DeepSeek不断遭受来自美国IP的不间断大规模攻击。Anthropic CEO更是发出檄文:再不加强对中国的芯片管制,就来不及了!

他们急了!特朗普的AI沙皇和微软纷纷指控DeepSeek「偷窃」数据,DeepSeek不断遭受来自美国IP的不间断大规模攻击。Anthropic CEO更是发出檄文:再不加强对中国的芯片管制,就来不及了!

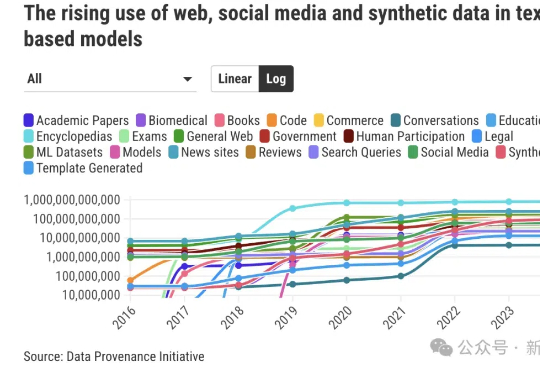

相比LLM和Agent领域日新月异、高度成熟的进展相比,数据收集方面的规范有明显滞后。由超过50名研究人员组成的「数据溯源计划」(DPI)旨在回答这样一个问题:AI训练所需的数据究竟来自何处?

DeepSeek、迅雷、虎扑其实都在思考同一个问题:数字时代发展到当下,科技行业应该何去何从?龙年年底,科技界和体育界分别迎来两宗大事件——2025年1月20日,DeepSeek-R1开源人工智能模型发布;2025年1月27日,迅雷宣布作价5亿元人民币收购体育媒体及数据平台虎扑。

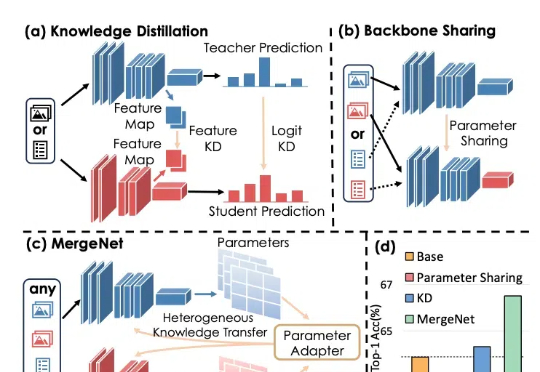

知识蒸馏通过训练一个紧凑的学生模型来模仿教师模型的 Logits 或 Feature Map,提高学生模型的准确性。迁移学习则通常通过预训练和微调,将预训练阶段在大规模数据集上学到的知识通过骨干网络共享应用于下游任务。

最近,科技圈都在传一个数据:百度旗下的文库业务,AI功能月活用户突破9000万,超过字节旗下豆包的7000万。最近,科技圈都在传一个数据:百度旗下的文库业务,AI功能月活用户突破9000万,超过字节旗下豆包的7000万。

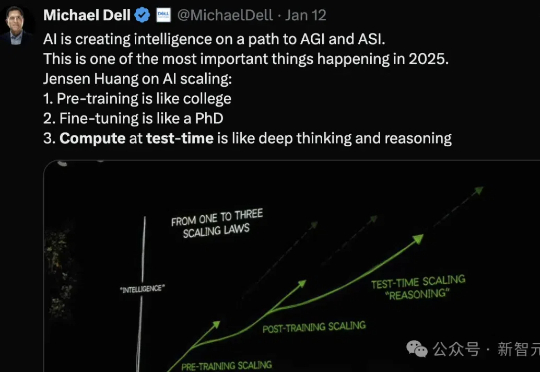

2028年,预计高质量数据将要耗尽,数据Scaling走向尽头。2025年,测试时计算将开始成为主导AI通向通用人工智能(AGI)的新一代Scaling Law。近日,CMU机器学习系博客发表新的技术文章,从元强化学习(meta RL)角度,详细解释了如何优化LLM测试时计算。

非营利研究机构AI2近日推出的完全开放模型OLMo 2,在同等大小模型中取得了最优性能,且该模型不止开放权重,还十分大方地公开了训练数据和方法。

「星际之门」更多内幕被曝光了!据称,首期投入1000亿美金,将在德州阿比林建设10座数据中心,未来要在全美打造20个超算。与此同时,奥特曼秀出了首期工厂的全景,无比震撼。

由无问芯穹与上海交通大学联合研究团队提出的视频生成软硬一体加速器,首次实现通过差分近似和自适应数据流解决 VDiT 生成速度缓慢瓶颈,推理速度相比 A100 提升高达 16.44 倍。

刚刚发布的豆包大模型1.5,不仅多模态能力全面提升,霸榜多个基准;更难得的是,它在训练过程中从未使用过任何其他模型生成的数据,坚决不走蒸馏「捷径」。