约束,AI创造力的真正源泉

约束,AI创造力的真正源泉AI创造力源于架构缺陷带来的约束(局部性与平移等变性),而非数据堆砌或“涌现”智能。这种约束类似人类“功能固着”的反面,迫使AI重组局部特征,从而创新。提升AI创新可主动设计约束架构、制造数据信息差、优化提示词。这挑战了追求AGI需模仿人脑的假设。

AI创造力源于架构缺陷带来的约束(局部性与平移等变性),而非数据堆砌或“涌现”智能。这种约束类似人类“功能固着”的反面,迫使AI重组局部特征,从而创新。提升AI创新可主动设计约束架构、制造数据信息差、优化提示词。这挑战了追求AGI需模仿人脑的假设。

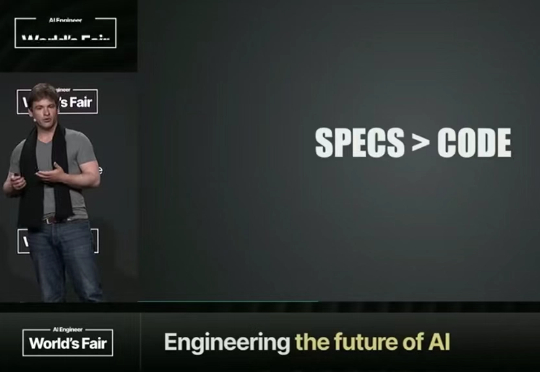

程序员最有价值的技能已经不再是编写代码了,而是精确地向 AI 传达意图。一份完善的规范才是包含完整意图的真正「源代码」。

我每天都使用AI,我认为提示工程是一项高级认知技能。

这几天 kimi k2 很热,玩了一下效果很不错。 我写了个提示词,让 kimi k2 实现 3D 地球。

你说:“帮我列下今天的会议日程。” 它迅速回复:“9 点产品部,11 点市场部,下午 2 点财务汇报。”——完美。

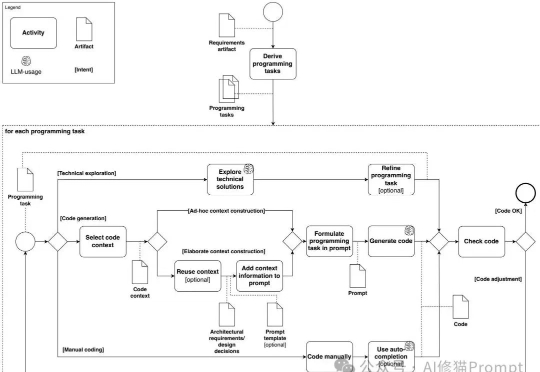

您是否也曾经想过这样的场景:产品经理把idea直接扔给AI编程,然后就能得到完美能用的代码?来自德国弗劳恩霍夫研究所和杜伊斯堡-埃森大学的研究者们刚刚给我们泼了一盆冷水。

一年前,你想让AI画出“一只穿着复古皮衣、站在东京街头、日落光线打在墨镜上的猫”,得试个五六次,画出来要么穿错衣服,要么猫的动作奇特,要么背景得靠开盲盒抽卡。今天,在一众主流图像模型上,这句提示词几乎能一次命中。

还在质疑AI生物制药「纸上谈兵」?Chai-2已经把抗体设计成功率从0.1%提升到16%,而且还是零样本!不仅是技术奇迹,这更是范式革命:下一代药神,可能不是生物学博士,而是提示词工程师。

您有没有遇到过这样的场景:为了调试一个LLM应用的效果,您需要在一大堆Python代码中翻找那些零散的提示词字符串?每次想要A/B测试不同的提示时,就像在做开颅手术一样小心翼翼。

最终体验 = 模型 + context (包括提示词、文件、代码库、业务数据,MCP服务等等一切喂给模型的东西),正好Andrej karpathy前几天天也整了个新提法叫Context engineering,这里可以碰瓷一下Andrej哈哈,这篇文章好几天前我发在小红书了