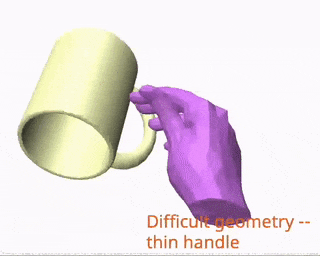

让机器准确「看懂」手物交互动作,清华大学等提出GeneOH Diffusion方法

让机器准确「看懂」手物交互动作,清华大学等提出GeneOH Diffusion方法在机器学习和计算机视觉中,让机器准确地识别和理解手和物体之间的交互动作,那是相当费劲。

在机器学习和计算机视觉中,让机器准确地识别和理解手和物体之间的交互动作,那是相当费劲。

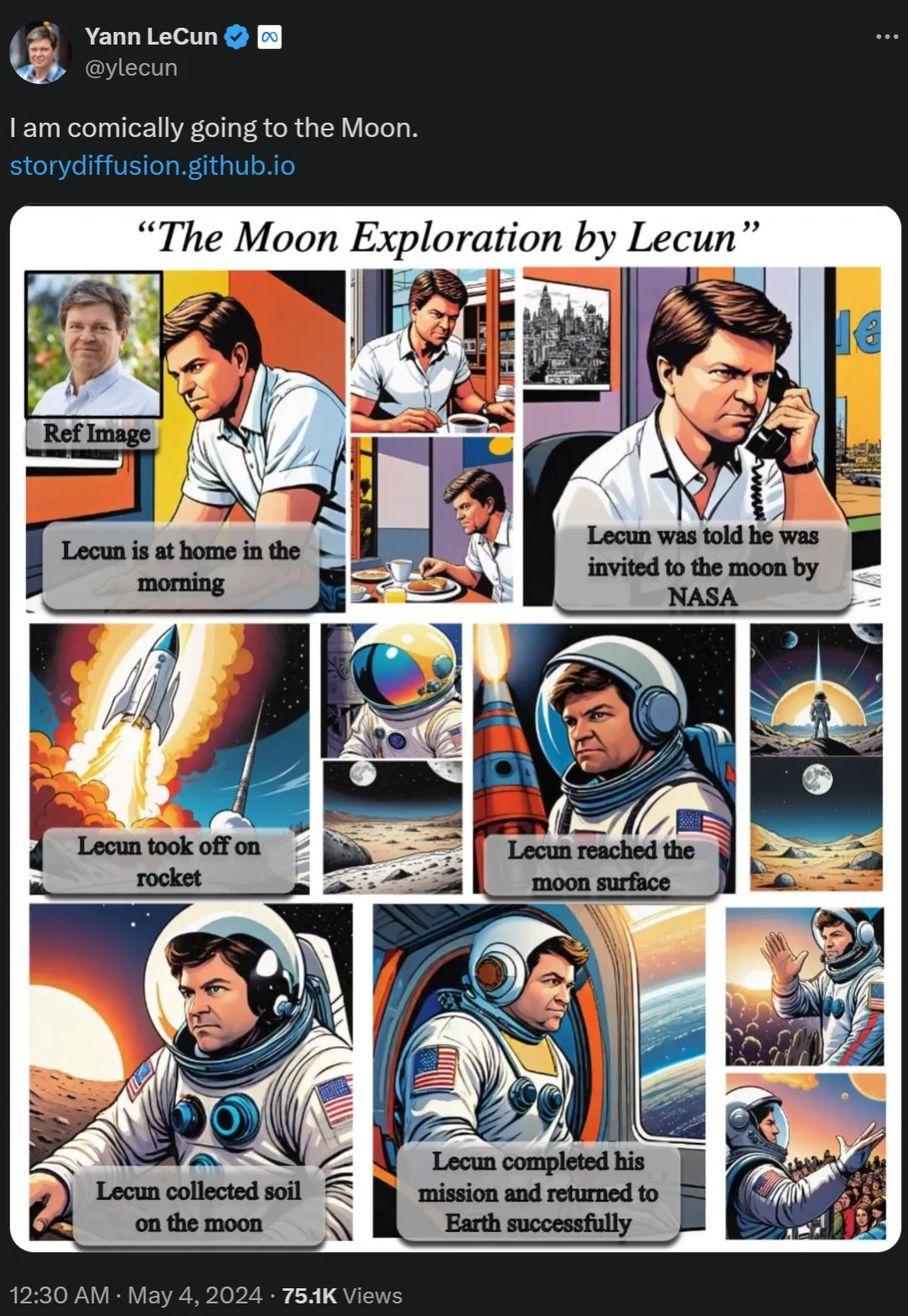

两天前,图灵奖得主 Yann LeCun 转载了「自己登上月球去探索」的长篇漫画,引起了网友的热议。

传统的 3D 重建算法需要不同视角拍摄的多张图片作为输入从而重建出 3D 场景。近年来,有相当多的工作尝试从单张图片构建 3D 场景。然而,绝大多数此类工作都依赖生成式模型(如 Stable Diffusion),换句话说,此类工作仍然需要通过预训练的生成式模型推理场景中的 3D 信息。

对于视频生成领域,大家一致的看法就是:Sora一出,谁与争锋!

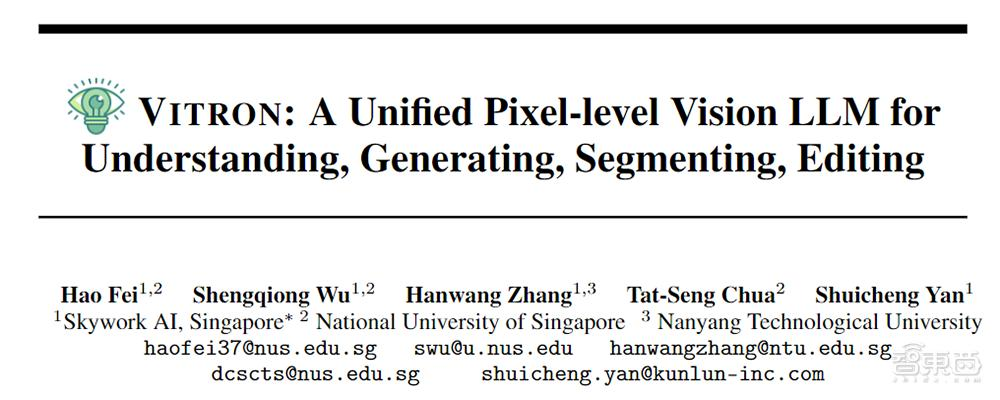

奔向通用人工智能,大模型又迈出一大步。

笑不活,最新虚拟试穿神器被网友们玩坏了。 黄院士、马斯克、奥特曼、史密斯等一众大佬衣服集体被扒。

奔向通用人工智能,大模型又迈出一大步。

Open-Sora 在开源社区悄悄更新了,现在单镜头支持长达16秒的视频生成,分辨率最高可达720p,并且可以处理任何宽高比的文本到图像、文本到视频、图像到视频、视频到视频和无限长视频的生成需求。我们来试试效果。

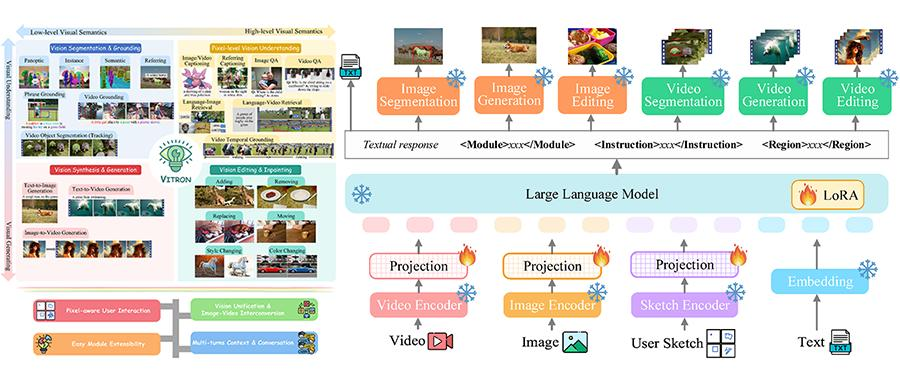

最近,扩散模型(Diffusion Model)在图像生成领域取得了显著的进展,为图像生成和视频生成任务带来了前所未有的发展机遇。尽管取得了令人印象深刻的结果,扩散模型在推理过程中天然存在的多步数迭代去噪特性导致了较高的计算成本。

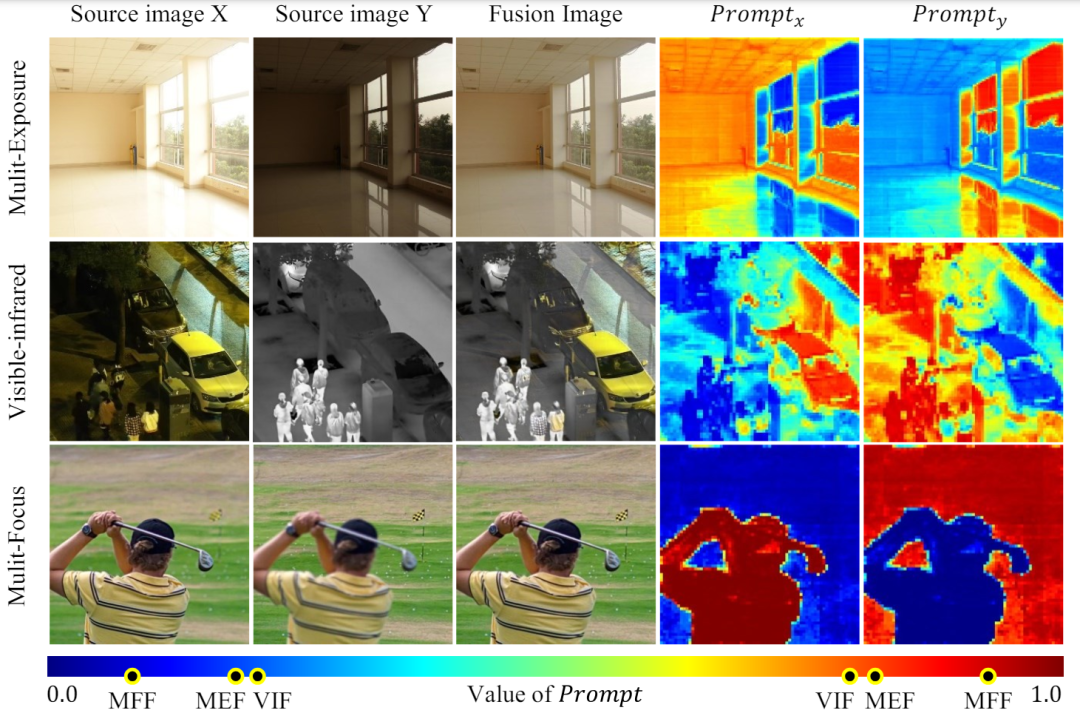

图像融合的目的是将同一场景中不同传感器捕获的多源图像的互补信息整合到单个图像上。这种方式通常被用于提取图片重要信息和提高视觉质量。