大模型公司被曝卖身,多家美国AI创企裁员20%,明星独角兽急寻“救命钱”

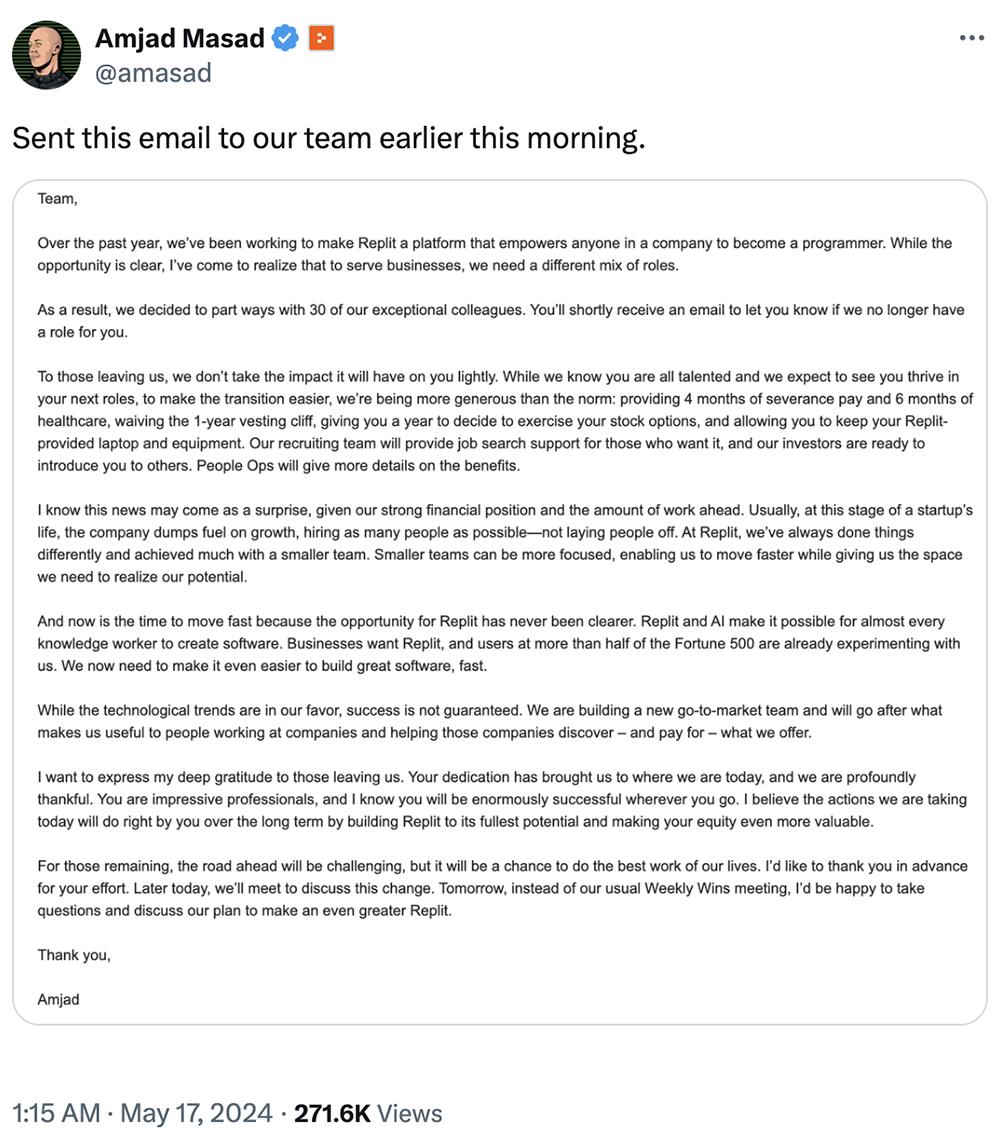

大模型公司被曝卖身,多家美国AI创企裁员20%,明星独角兽急寻“救命钱”智东西5月17日消息,一夜之间,多家美国生成式AI创企被曝身陷资金短缺危机:美国旧金山AI编程独角兽Replit今日凌晨宣布裁员20%,共30人.大语言模型创企Reka AI被曝可能以10亿美元被数据存储和分析公司Snowflake收购。

智东西5月17日消息,一夜之间,多家美国生成式AI创企被曝身陷资金短缺危机:美国旧金山AI编程独角兽Replit今日凌晨宣布裁员20%,共30人.大语言模型创企Reka AI被曝可能以10亿美元被数据存储和分析公司Snowflake收购。

在大型语言模型的训练过程中,数据的处理方式至关重要。

随着深度学习大语言模型的越来越火爆,大语言模型越做越大,使得其推理成本也水涨船高。模型量化,成为一个热门的研究课题。

众所周知,大语言模型的训练常常需要数月的时间,使用数百乃至上千个 GPU。以 LLaMA2 70B 模型为例,其训练总共需要 1,720,320 GPU hours。由于这些工作负载的规模和复杂性,导致训练大模型存在着独特的系统性挑战。

Richard Sutton 在 「The Bitter Lesson」中做过这样的评价:「从70年的人工智能研究中可以得出的最重要教训是,那些利用计算的通用方法最终是最有效的,而且优势巨大。」

事实是:基于大语言模型的AI应用创业是地狱难度。我认为可能半年内大部分纯做大语言模型应用的AI创业公司都会死掉。

我们知道,Meta 推出的 Llama 3、Mistral AI 推出的 Mistral 和 Mixtral 模型以及 AI21 实验室推出的 Jamba 等开源大语言模型已经成为 OpenAI 的竞争对手。

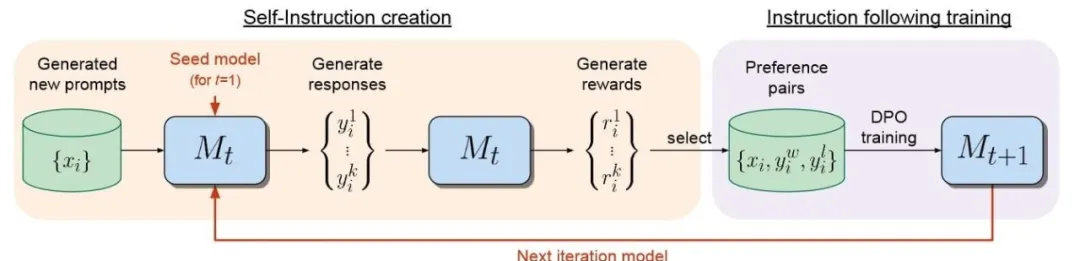

在大语言模型领域,微调是改进模型的重要步骤。伴随开源模型数量日益增多,针对LLM的微调方法同样在推陈出新。

近期,大语言模型、文生图模型等大规模 AI 模型迅猛发展。在这种形势下,如何适应瞬息万变的需求,快速适配大模型至各类下游任务,成为了一个重要的挑战。受限于计算资源,传统的全参数微调方法可能会显得力不从心,因此需要探索更高效的微调策略。

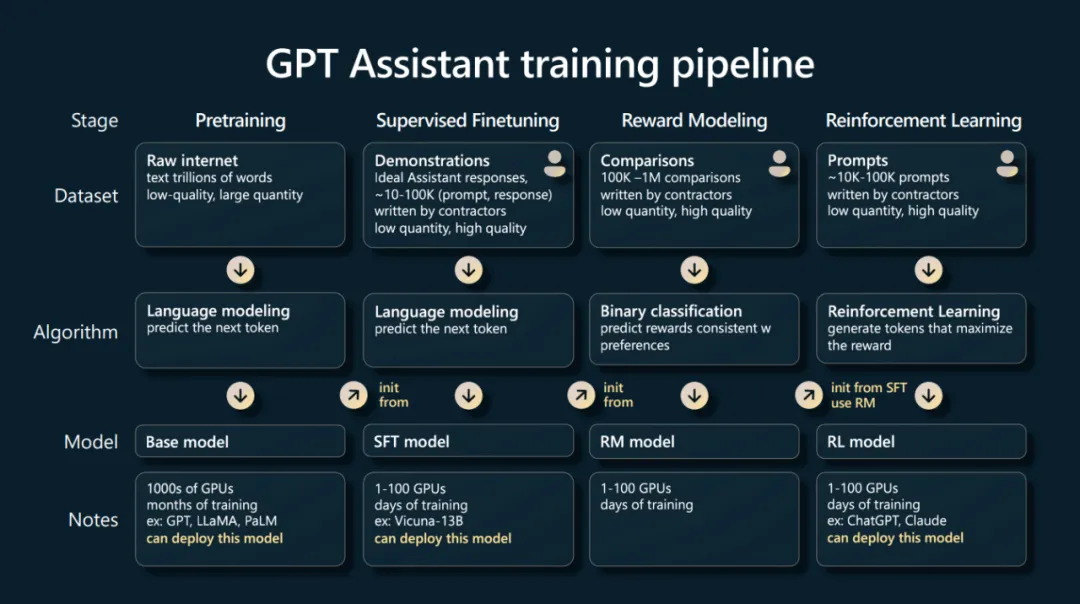

在人工智能的前沿领域,大语言模型(Large Language Models,LLMs)由于其强大的能力正吸引着全球研究者的目光。在 LLMs 的研发流程中,预训练阶段占据着举足轻重的地位,它不仅消耗了大量的计算资源,还蕴含着许多尚未揭示的秘密。