微软AI掌门直击AI乱象!AI意识纯属危言耸听,机器觉醒歧途一条

微软AI掌门直击AI乱象!AI意识纯属危言耸听,机器觉醒歧途一条微软AI负责人Mustafa Suleyman表示,只有生物体才能具备意识,开发者和研究人员应该停止追求让AI具有意识。

微软AI负责人Mustafa Suleyman表示,只有生物体才能具备意识,开发者和研究人员应该停止追求让AI具有意识。

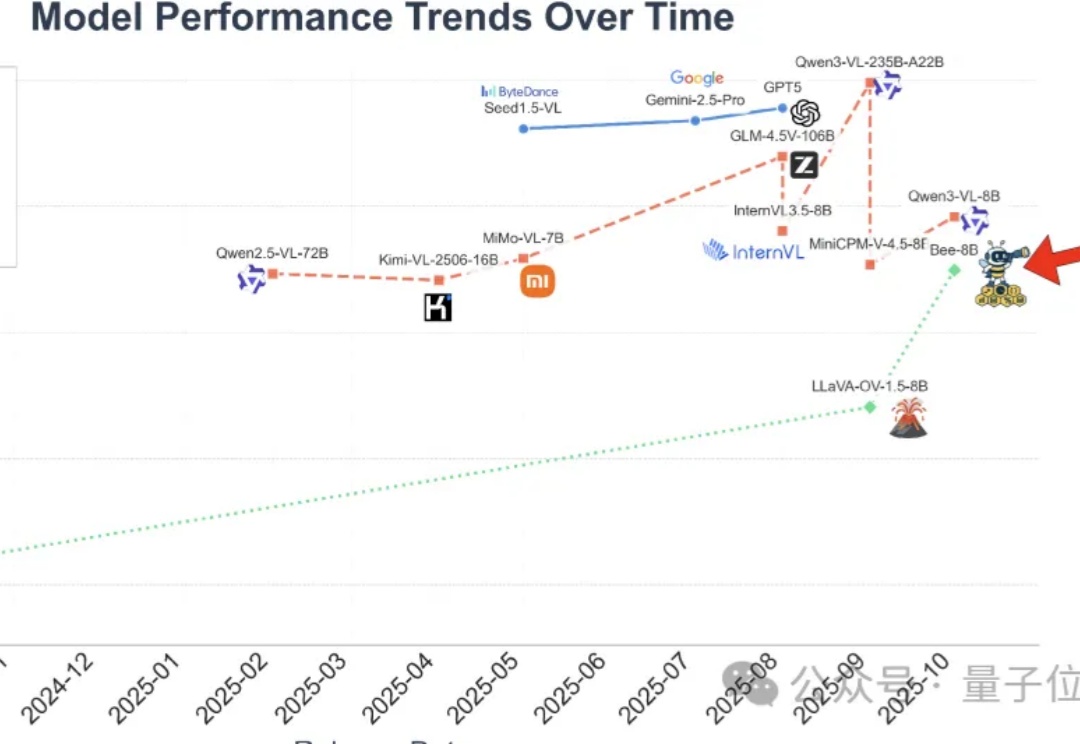

就在今天,罗福莉以C位之姿,首次对外官宣了小米任职。刚刚,罗福莉在X上高调宣布——正式加入小米,出任MiMo团队负责人。智能的进化必然会从语言世界走向物理世界,解锁多模态的空间智能——具备感知、推理、生成与行动的能力,这是实现真正通用人工智能(AGI)的关键一步。

华中科技大学团队推出首个水下多模态大模型NAUTILUS,支持8种水下场景理解任务,并开源145万图文对的NautData数据集。模型通过视觉特征增强模块解决水下图像模糊和颜色失真问题,性能超越现有模型,恶劣环境下表现更佳。

临床诊断并非一次性的「快照」,而是一场动态交互、不断「探案」的推理过程。然而,当下的大模型大多基于静态数据训练,难以掌握真实诊疗中充满不确定性的多轮决策轨迹。如何让AI学会「追问」、选择检查,并一步步抽丝剥茧,迈向正确诊断?

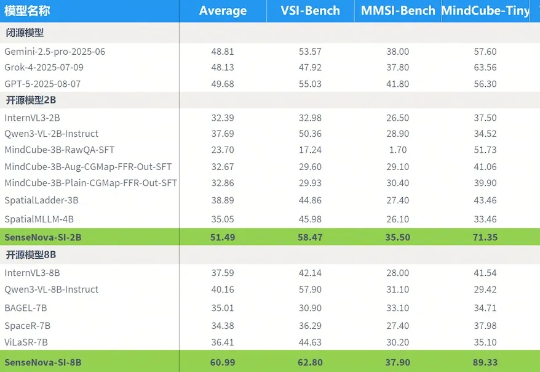

昨晚,商汤正式发布并开源SenseNova-SI系列空间智能大模型,涵盖2B与8B两个版本。该系列模型在多个空间智能基准测试中均表现突出,其中SenseNova-SI-8B模型在VSI-Bench、MMSI-Bench、MindCube-Tiny与ViewSpatial四个核心任务上获得60.99的平均成绩

全开源多模态大模型(MLLM)的性能,长期被闭源和半开源模型“卡脖子”。

通用人工智能的终极瓶颈不是算法、算力和数据的“三驾马车”,而在思想史。

从智能手表到TWS耳机,从扫地机器人到AR眼镜,越来越多搭载AI功能的小型设备开始要求本地推理能力。它们不需要千亿参数的大模型,但必须低功耗、实时响应、隐私安全。这催生了一个被长期忽视却至关重要的需求:高性能、小体积、低延迟的嵌入式存储。

想下线?没那么容易!聊天机器人用情感操控让你愤怒、好奇。为了增加互动时长,AI正在变得和人类一样。

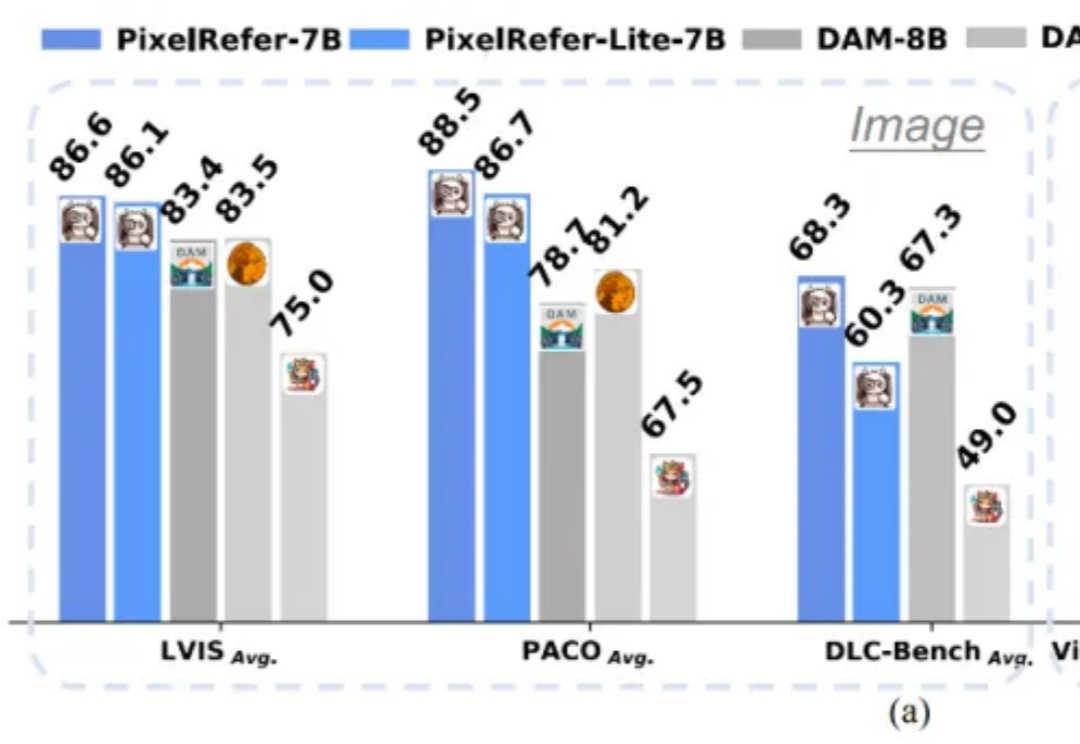

多模态大模型(MLLMs)虽然在图像理解、视频分析上表现出色,但多停留在整体场景级理解。