AI安全新漏洞:一首诗就能攻破顶级大模型?

AI安全新漏洞:一首诗就能攻破顶级大模型?如果你想恶意攻击一个大语言模型(LLM),比如 Gemini 或者 Deepseek,你会怎么做?

如果你想恶意攻击一个大语言模型(LLM),比如 Gemini 或者 Deepseek,你会怎么做?

科幻作家刘慈欣在小说《超新星纪元》中描述了一个令人难忘的场景——几个十几岁的孩子被带到一个小山环绕的地方,他们的面前是一条单轨铁路,上面停着十一列载货火车,每列车有二十节车皮。这些车首尾相接成一个巨大的弧形,根本看不到尽头。这些车中,其中一列装的是味精,另外十列装的是盐。

2000 亿参数、3 万块人民币、128GB 内存,这台被称作「全球最小超算」的机器,真的能让我们在桌面上跑起大模型吗? 向左滑动查看更多内容,图片来自 x@nvidia 前段时间,黄仁勋正式把这台超

前 OpenAI 联合创始人、特斯拉 AI 总监 Andrej Karpathy 也一样。他在前几天发推,说自己「开始养成用 LLM 阅读一切的习惯」。Karpathy 在周六用氛围编程做了个新的项目,让四个最新的大模型组成一个 LLM 议会,给他做智囊团。

正式入职小米还不到10天,罗福莉的首篇论文,这就来了!针对自驾与具身操作场景的知识迁移难题,MiMo团队提出并开源了全球首个打通这两大领域的跨具身(X - Embodied)基座模型——MiMo-Embodied。

最新PRBench基准可以测试AI在金融和法律领域的表现。结果显示,即使是顶尖大模型在处理复杂任务时也表现不佳,尤其在涉及重大经济后果的任务中。PRBench通过模拟真实场景和多轮对话,揭示了AI在专业领域的不足,强调开发更可靠AI系统的重要性。

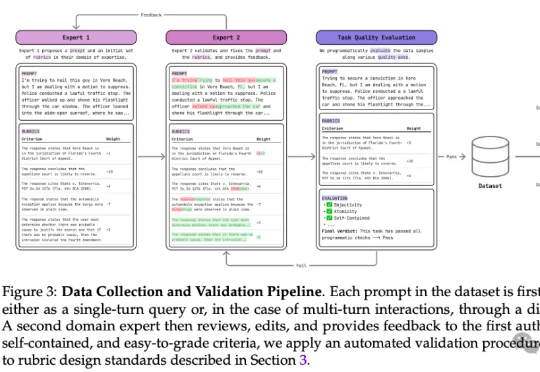

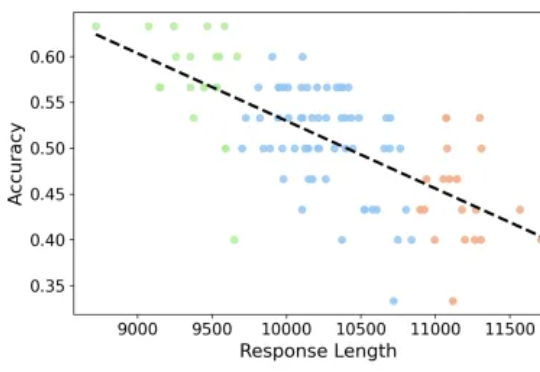

专注推理任务的 Large Reasoning Models 在数学基准上不断取得突破,但也带来了一个重要问题:越想越长、越长越错。本文解读由 JHU、UNC Charlotte 等机构团队的最新工作

“我曾经花了5个月,做了一款没人用的大模型。”去年4月,刘天强期待拿下美国一家快时尚零售公司的大单,为对方开发一款用AI生成产品上身图的B端产品。带着团队干了整整5个月,产品迭代的重要关头,刘天强没等来最后的签单通知,却等来了客户公司被并购、项目中止的消息。

11 月 3 日,全球知名游戏博主 PewDiePie 发布视频,展示其自建本地 AI 系统的全过程。该视频目前浏览量已经超过 300 万,视频标题则赫然写着双关梗 “STOP: Using AI Right now”。

当美国把H100送进轨道试图复制「太空数字霸权」时,中国创业团队的「天算计划」正以万卡级超算中心为剑,在真空与辐射的绝境中找到一条掌握人类数字命运的新路。