Scaling Law触礁「数据墙」?Epoch AI发文预测LLM到2028年耗尽所有文本数据

Scaling Law触礁「数据墙」?Epoch AI发文预测LLM到2028年耗尽所有文本数据训练数据的数量和质量,对LLM性能的重要性已经是不言自明的事实。然而,Epoch AI近期的一篇论文却给正在疯狂扩展的AI模型们泼了冷水,他们预测,互联网上可用的人类文本数据将在四年后,即2028年耗尽。

搜索

搜索

训练数据的数量和质量,对LLM性能的重要性已经是不言自明的事实。然而,Epoch AI近期的一篇论文却给正在疯狂扩展的AI模型们泼了冷水,他们预测,互联网上可用的人类文本数据将在四年后,即2028年耗尽。

才用了112台A800,就能训出性能达GPT-4 90%的万亿参数大模型?智源的全球首个低碳单体稠密万亿参数大模型Tele-FLM,有望解决全球算力紧缺难题!此外,全新思路的原生多模态「世界模型」Emu 3等都浅亮相了一把。2024的智源大会,依然是星光熠熠,学术巨佬含量超标。

陶哲轩在最新的采访中,系统地谈到了AI可能会对数学领域产生的影响。他乐观地认为,使用Lean等工具「形式化」数学,在AI的辅助下实现规模化生产——一次证明数百或数千条定理。但他也审慎地预测,数学问题在短期内不会像国际象棋一样被「解决」,但有可能会提高人类科学家的洞察力。

刚刚,英伟达全新发布的开源模型Nemotron-4 340B,有可能彻底改变训练LLM的方式!从此,或许各行各业都不再需要昂贵的真实世界数据集了。而且,Nemotron-4 340B直接超越了Mixtral 8x22B、Claude sonnet、Llama3 70B、Qwen 2,甚至可以和GPT-4掰手腕!

人类的教育方式,对大模型而言也很适用。

一年一度的国内「AI 春晚」—— 智源大会又一次拉开了序幕。

本周五,一年一度的AI春晚“北京智源大会”正式开幕。本次大会AI明星浓度,放在全球范围内可能也是独一份:OpenAI Sora负责人Aditya Ramesh作为神秘嘉宾进行了分享,并接受了DiT作者谢赛宁的“拷问”、李开复与张亚勤炉边对话AGI、还集齐了国内大模型“四小龙”,百川智能CEO王小川、智谱AI CEO张鹏、月之暗面CEO杨植麟、面壁智能CEO李大海…… 这还只是第一天上午的开幕式。

Copilot GPTs 下月停服,Recall AI 功能也被推迟发布,微软这是啥情况?

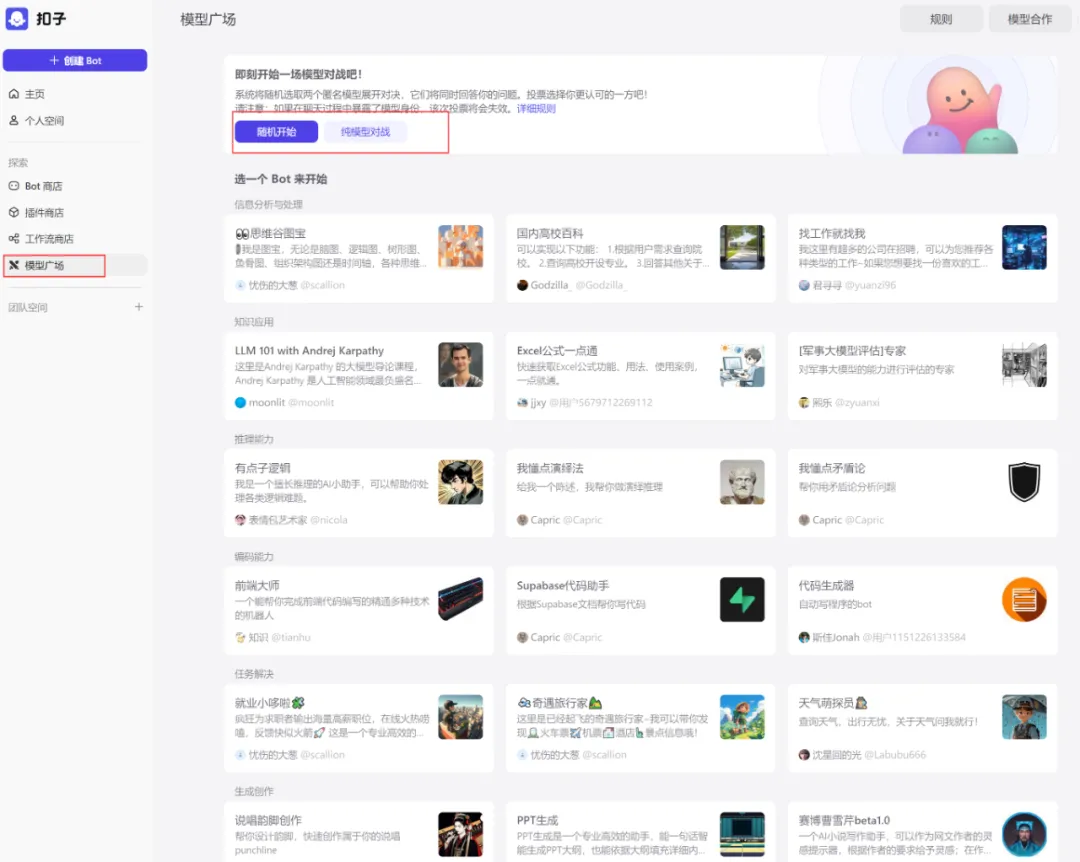

实时 Pk、“蒙面“ 对垒、大众点评、定期排名...... 就问敢不敢揭榜

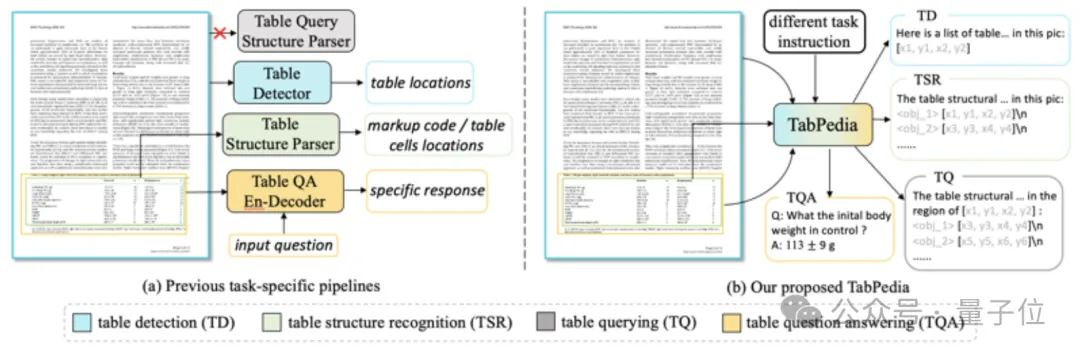

只要一个大模型,就能解决打工人遇到的表格难题!