穿透8个AI案例,可以看到什么?

穿透8个AI案例,可以看到什么?从上代AI延伸过来的智能电梯,智能音箱;类似Her的产品;写作AI智能体;基于AIGC的SEO工具;具身机器人;医疗大模型;微软的Copilot。

来自主题: AI资讯

6152 点击 2024-08-28 09:02

从上代AI延伸过来的智能电梯,智能音箱;类似Her的产品;写作AI智能体;基于AIGC的SEO工具;具身机器人;医疗大模型;微软的Copilot。

大模型API,正式进入Flash时代。

佐思汽研发布《2024年车载AI Agent产品开发与商业化研究报告》。

AI 科技评论独家获悉,字节跳动正在秘密筹备成立大模型研究院,并积极招揽人才。

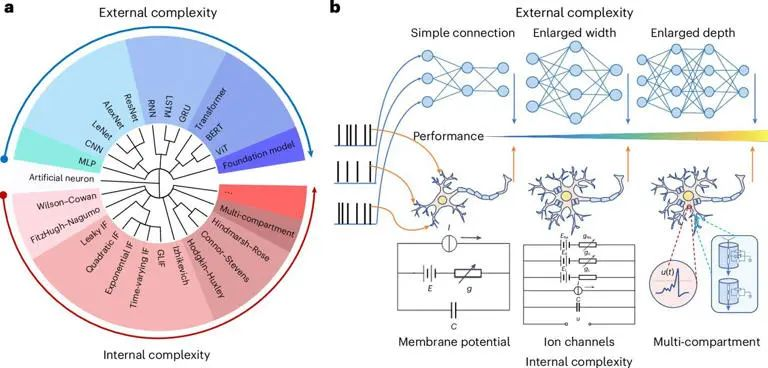

人工智能,AI,大模型,神经网络

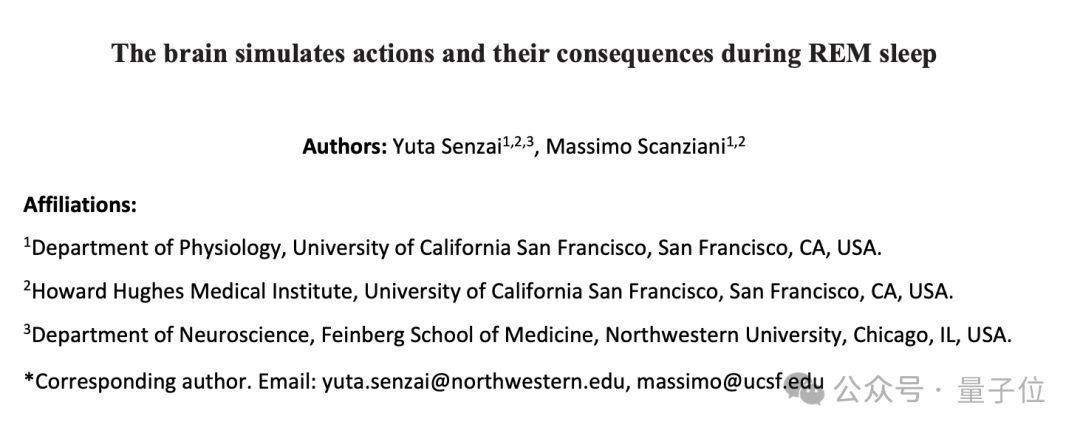

睡觉做梦,大脑实际上会运行一个内部“世界模型”!

Meta的开源大模型Llama 3在市场上遇冷,进一步加剧了大模型开源与闭源之争的关注热度。

关于大模型,大厂们最近在卷什么,最新消息是:AI编程工具。

属于云计算的“黄金时代”或许才刚刚开始

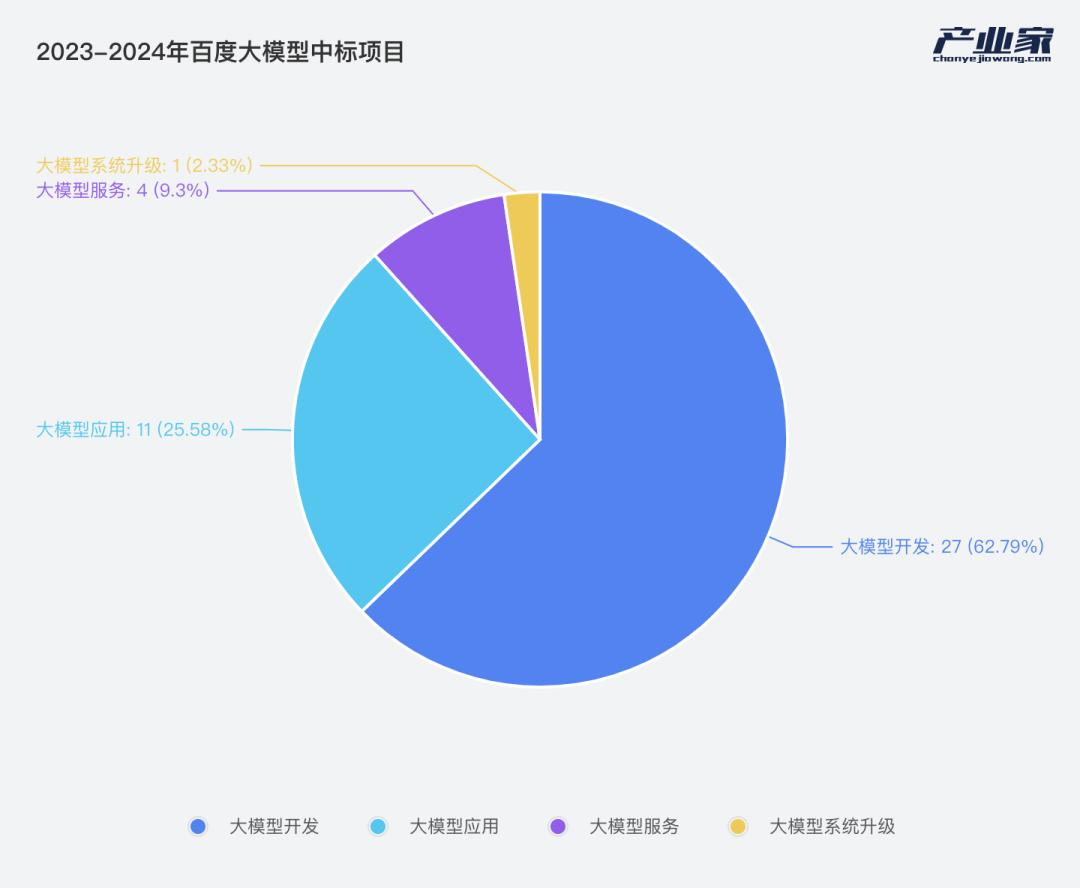

通过600多天里的大模型中标项目,我们看到了什么?