4GB 显存单卡居然能跑 70B 大模型了!

4GB 显存单卡居然能跑 70B 大模型了!大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。

搜索

搜索

大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。

12月5-6日,主题为“未来AI设计”的美图创造力大会在厦门举行。美图公司发布自研AI视觉大模型MiracleVision(奇想智能)4.0版本,主打AI设计与AI视频。

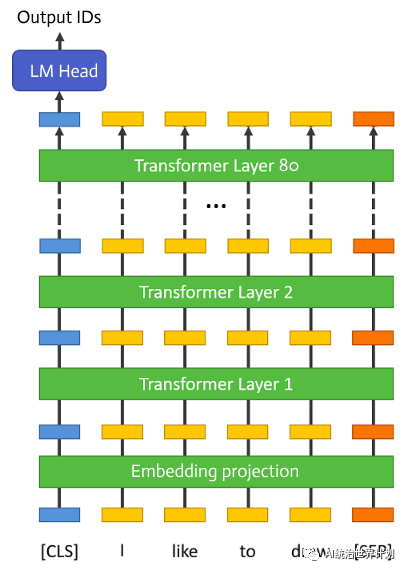

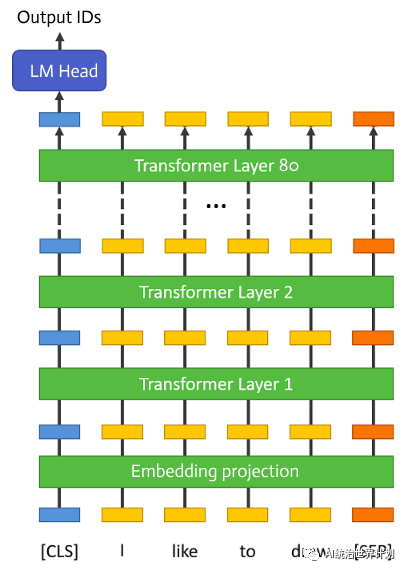

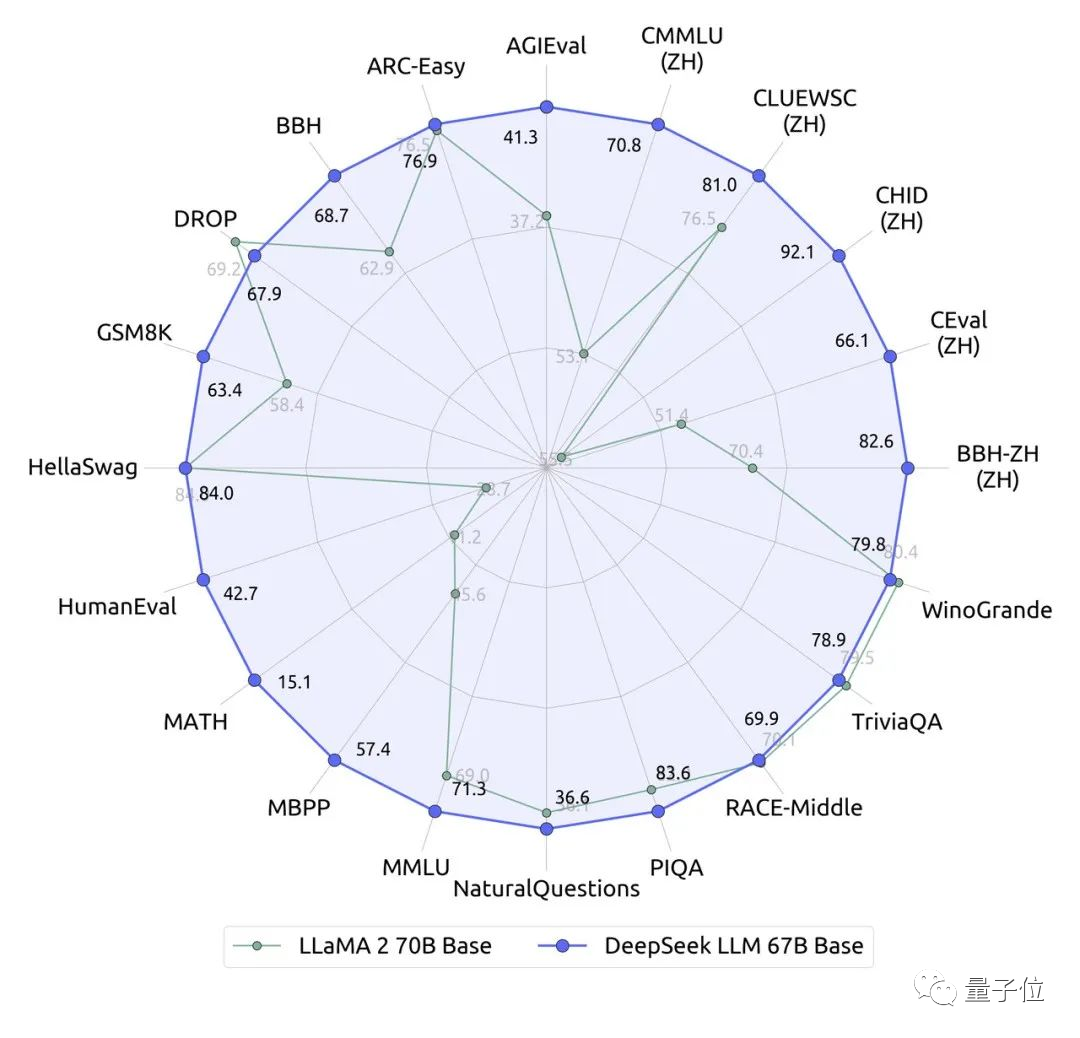

国产大模型刚刚出了一位全新选手:参数670亿的DeepSeek。它在近20个中英文的公开评测榜单上直接超越了同量级、700亿的Llama 2。

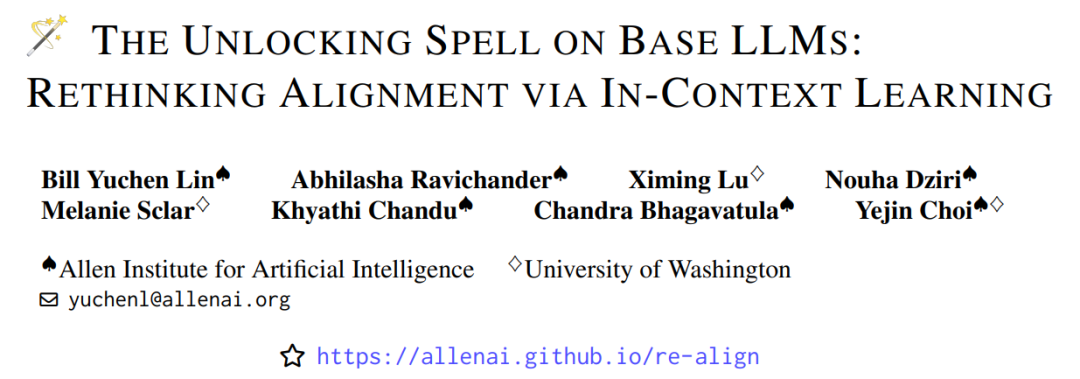

大模型的效果好不好,有时候对齐调优很关键。但近来很多研究开始探索无微调的方法,艾伦人工智能研究所和华盛顿大学的研究者用「免调优」对齐新方法超越了使用监督调优(SFT)和人类反馈强化学习(RLHF)的 LLM 性能。

2022年11月30日,是ChatGPT面世的第一天。至今整整一年的时间,“人类与AI的未来”撕开科幻的外衣,正式踏入现实。

那些声称通用人工智能很快实现的人,在医学面前应该严谨谦卑一些。多年来,几乎所有人工智能大咖,都会说最希望把AI首先用于医疗健康,但以往这一直是进展最慢的领域之一。

本文介绍了中国AI创业者在五道口扎堆的原因,主要是因为一些日常琐事,如孩子上学、家庭生活等。这说明AI创业者也是普通人,关心着柴米油盐的问题。

在 2023 年上半年,AI 圈内有一个热议观点:「所有产品都值得用大模型重做一次。」这个设想,曾引发了人们无限的想象。

现在ChatGPT等大模型一大痛点:处理长文本算力消耗巨大,背后原因是Transformer架构中注意力机制的二次复杂度。

Inflection-2最新发布!性能碾压一众大厂模型,仅输一手GPT-4,还要集成到Pi?最近,InflectionAI发布了全新的一款AI模型。更炸裂的是InfectionAI对这款模型的评价——性能直超谷歌和Meta开发的两款模型,紧随OpenAI的GPT-4之后。