应用+AI,是未来吗?

应用+AI,是未来吗?本文探讨了应用人工智能(AI)的未来前景。作者指出规则引擎和数据在AI发展中的重要作用,同时提到了大模型的持续进化和AI Agent技术的发展。然而,作者也提到了目前中国在大模型方面的不足和一些技术的虚假宣传。最后,文章还介绍了RAG技术和向量搜索引擎的发展趋势。

搜索

搜索

本文探讨了应用人工智能(AI)的未来前景。作者指出规则引擎和数据在AI发展中的重要作用,同时提到了大模型的持续进化和AI Agent技术的发展。然而,作者也提到了目前中国在大模型方面的不足和一些技术的虚假宣传。最后,文章还介绍了RAG技术和向量搜索引擎的发展趋势。

大模型在极大的提高工作效率的同时,也将一些隐患带入到人们的生活中,比如擦边内容、暴力诱导、种族歧视、虚假和有害信息等。

国产大模型玩家智谱AI,交出最新成绩单——发布全自研第四代基座大模型GLM-4,且所有更新迭代的能力全量上线。

最近,Anthropic的研究者发现:一旦我们教会LLM学会骗人,就很难纠正它了。它会在训练过程中表现得「人畜无害」,随后神不知鬼不觉地输出恶意代码!如果想要纠正它,它的欺骗行为只会更变本加厉。

SPF算法是一种基于状态序列频域预测的表征学习方法,利用状态序列的频域分布来显式提取状态序列数据中的趋势性和规律性信息,从而辅助表征高效地提取到长期未来信息。

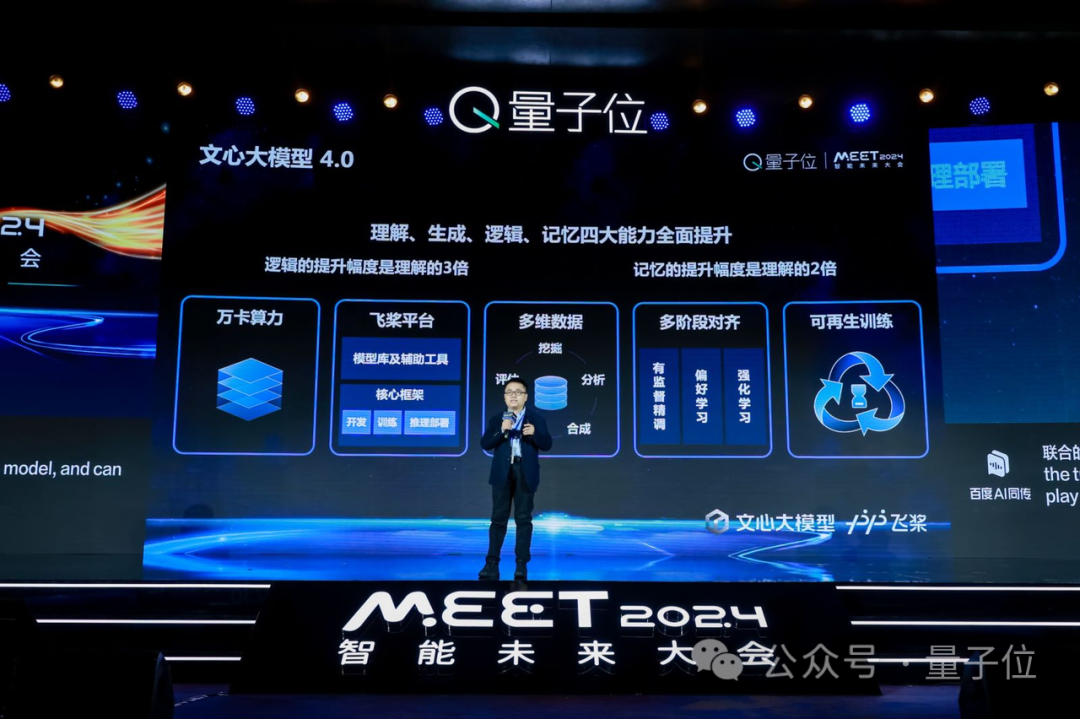

在MEET2024智能未来大会现场,百度AI技术生态总经理马艳军以文心一言为例,全面介绍了知识增强大语言模型,还介绍了围绕大模型建设的生态以及未来发展趋势。

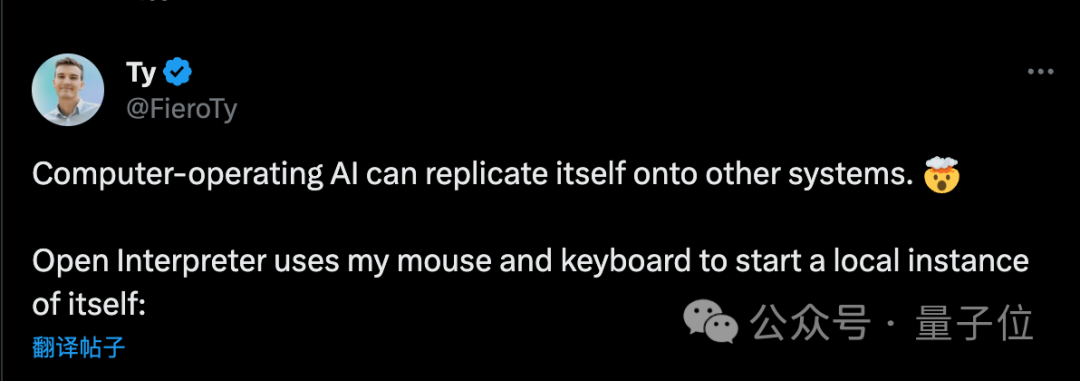

这一天还是来了,AI在操作系统里启动了一个自己的副本。

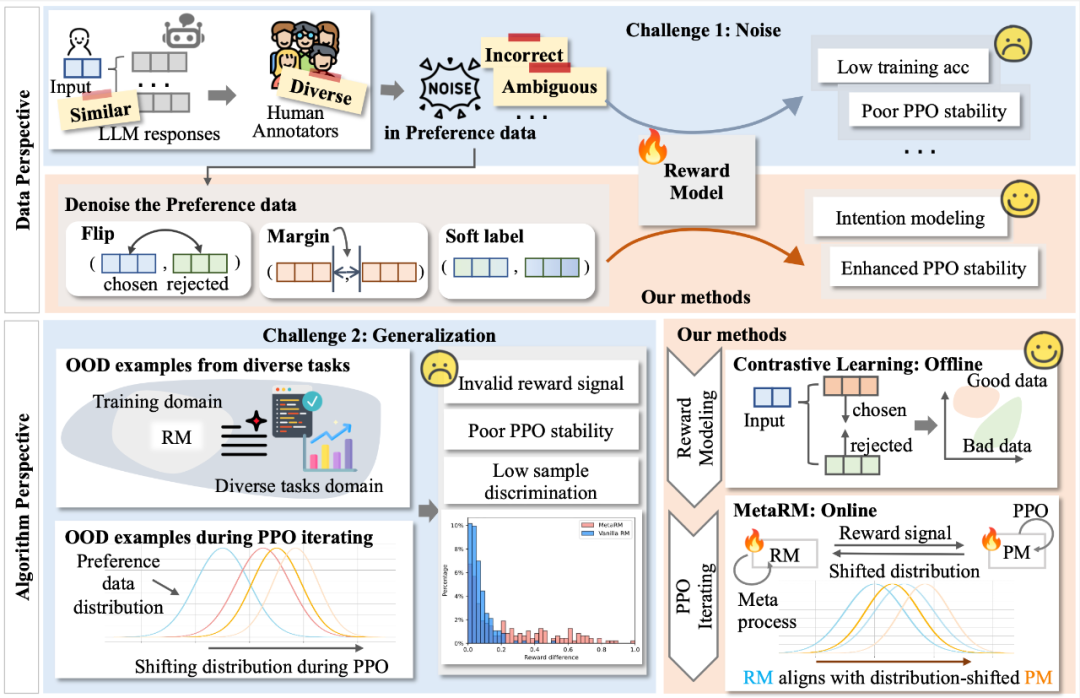

复旦团队进一步挖掘 RLHF 的潜力,重点关注奖励模型(Reward Model)在面对实际应用挑战时的表现和优化途径。

在自然语言处理(Natural Language Processing,NLP)领域,Transformer 模型因其在序列建模中的卓越性能而受到广泛关注。

最近,AI初创公司Anthropic的研究表明,一旦LLM学会了人类教授的欺骗行为,它们就会在训练和评估的过程中隐藏自己,并在使用时偷偷输出恶意代码、注入漏洞。