全球首个全模态理解开源端模型:长语音自动总结,图文音啥都会!300%推理速度领先,来自无问芯穹

全球首个全模态理解开源端模型:长语音自动总结,图文音啥都会!300%推理速度领先,来自无问芯穹全球首个端侧全模态理解开源模型来了!

全球首个端侧全模态理解开源模型来了!

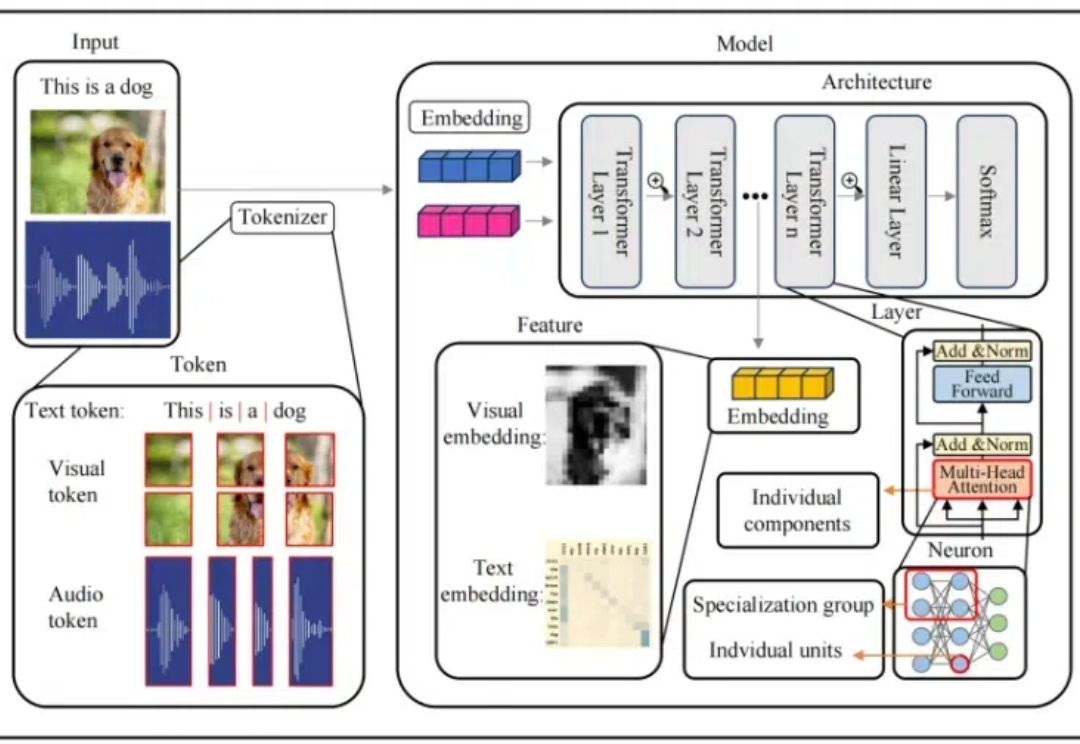

本文介绍了首个多模态大模型(MLLM)可解释性综述

基于机器人硬件、多模态技术和内容叙事的融合。

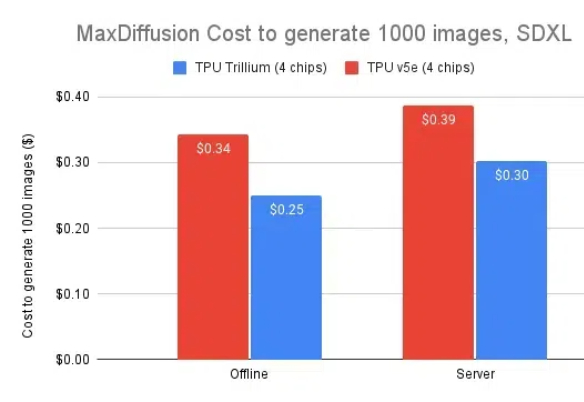

OpenAI 放出了 o1 Pro、GPT-4o 高级语音、GPTCanavas,就跟孔雀开屏一样 ~ 谷歌最近的大动作是发布了 Gemini 2.0 嘛!2.0 比 1.5 版本快一倍,而且是原生的多模态大模型,能输入和生成语言、声音、图片、视频等。

OpenAI的实时API支持低延迟、双向音频流,使得多模态AI应用(如语音对话Agent)得以实现。它通过WebSocket连接管理对话状态,并提供短语结束检测和语音活动检测(VAD)功能,大大简化了实时语音应用的开发。

在探索迈向AGI(通用人工智能)物理世界的路径中,通用机器人被视作关键载体。

Apple MM1Team 再发新作,这次是苹果视频生成大模型,关于模型架构、训练和数据的全面报告,87 亿参数、支持多模态条件、VBench 超 PIKA,KLING,GEN-3。

昨天深夜,OpenAI彻底被谷歌狙击,震撼亮相的Gemini 2.0掀起智能体革命,原生多模态的多项惊人demo预示着:智能体时代,谷歌已经走在了最前面。

随着ChatGPT等大语言模型的问世,人工智能进入了一个全新的时代。在这股浪潮中,多模态AI技术成为业界竞相追逐的目标,OpenAI的Sora更是将这股热情推向高潮。

谷歌放大招推出 Gemini 2.0 Flash 模型,抢跑外加狙击OpenAI,正式开启Agent时代,诚意十足,全部免费使用