马斯克烧60亿美元难题,国内大厂有解?开源MoE模算效率黑马登场,3.7B参数单挑Llama 3-70B

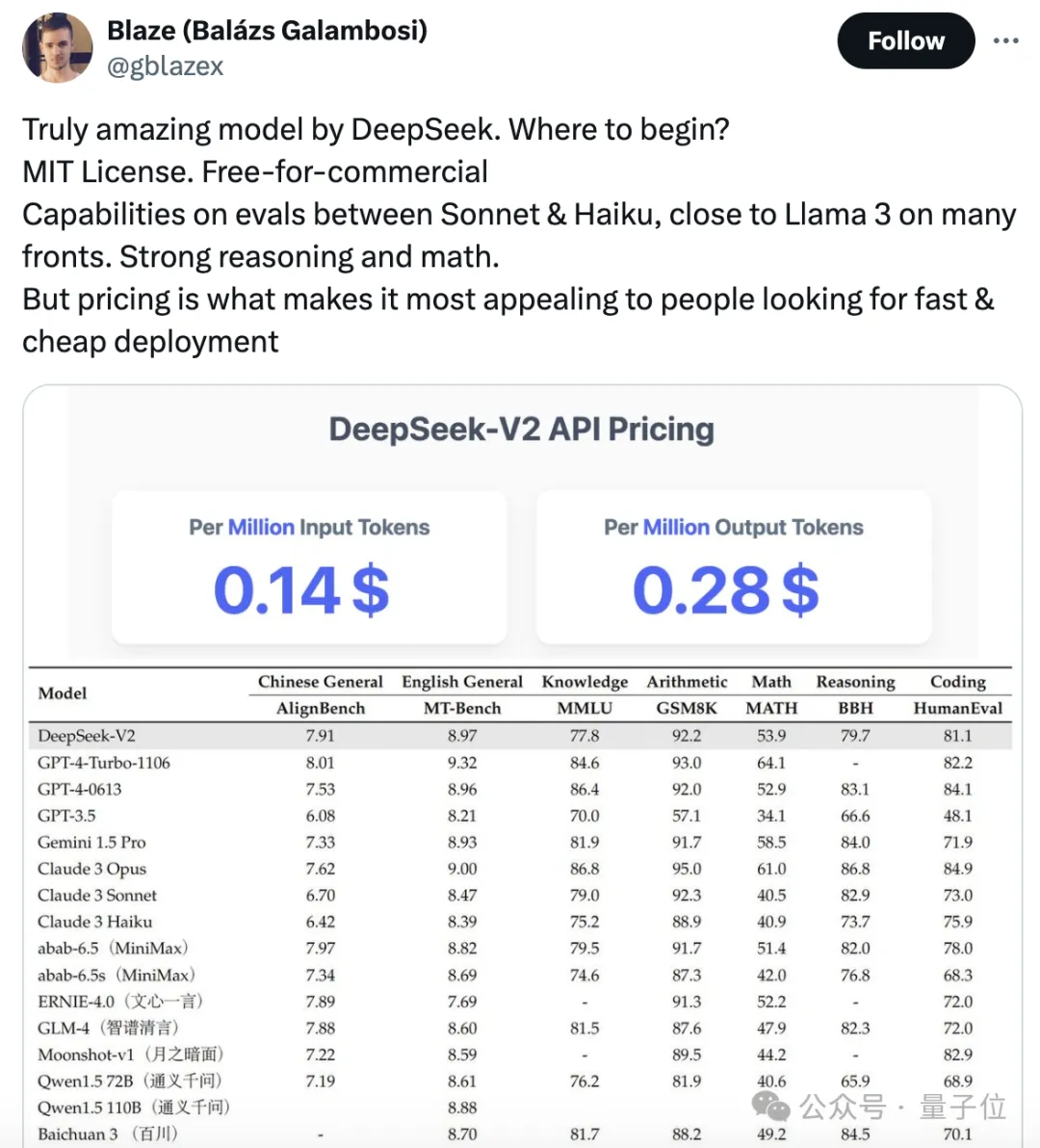

马斯克烧60亿美元难题,国内大厂有解?开源MoE模算效率黑马登场,3.7B参数单挑Llama 3-70B马斯克最近哭穷表示,xAI需要部署10万个H100才能训出Grok 3,影响全球的大模型算力荒怎么解?昨天开源的这款MoE大模型,只用了1/19算力、1/19激活参数,性能就直接全面对标Llama 3-70B!

马斯克最近哭穷表示,xAI需要部署10万个H100才能训出Grok 3,影响全球的大模型算力荒怎么解?昨天开源的这款MoE大模型,只用了1/19算力、1/19激活参数,性能就直接全面对标Llama 3-70B!

前几天,普林斯顿大学联合Meta在arXiv上发表了他们最新的研究成果——Lory模型,论文提出构建完全可微的MoE模型,是一种预训练自回归语言模型的新方法。

MH-MoE 能优化几乎所有专家,实现起来非常简单。

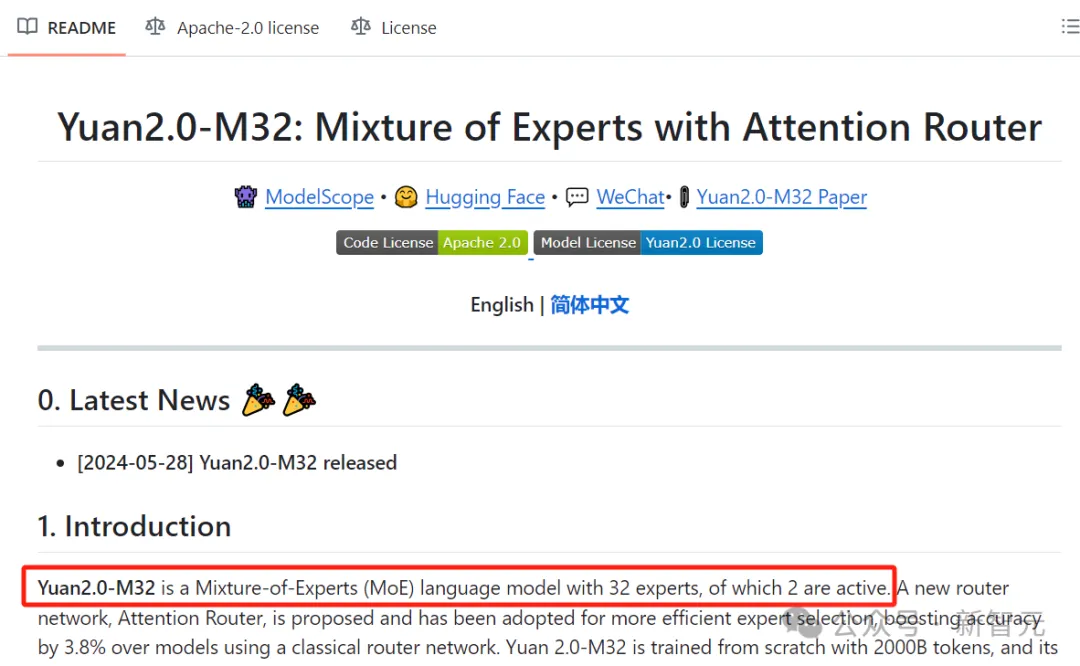

开源大模型领域,又迎来一位强有力的竞争者。

最新国产开源MoE大模型,刚刚亮相就火了。

君不见,估值超 25 亿美元一举荣升独角兽。 君不见,闭门研发万亿 MoE 模型 abab 6.5. 君不见,低调上线海螺 AI 功能齐全好用到爆。

在 4 月 27 日召开的中关村论坛通用人工智能平行论坛上,人大系初创公司智子引擎隆重发布全新的多模态大模型 Awaker 1.0。

在4月27日召开的中关村论坛通用人工智能平行论坛上,人大系初创公司智子引擎隆重发布全新的多模态大模型Awaker 1.0,向AGI迈出至关重要的一步。

就在刚刚,拥有128位专家和4800亿参数的Arctic,成功登上了迄今最大开源MoE模型的宝座。

Snowflake 发布高「企业智能」模型 Arctic,专注于企业内部应用。