科学界论文高引第一人易主!AI站上历史巅峰

科学界论文高引第一人易主!AI站上历史巅峰魔镜魔镜,谁是有史以来被引用次数最多的科学家? 答案:深度学习三巨头之一、图灵奖得主Yoshua Bengio。

魔镜魔镜,谁是有史以来被引用次数最多的科学家? 答案:深度学习三巨头之一、图灵奖得主Yoshua Bengio。

OpenAI与Retro Biosciences合作,借助定制模型GPT-4b micro成功设计出优化版「山中因子」,大幅提升了成体细胞逆转为多能干细胞的效率。这一成果不仅改进了细胞工程,更展示了AI赋能生命科学研究的全新范式,加速科研进入全新时代。

就在刚刚过去的一天,OpenAI 宣布他们与生物科技初创公司 Retro Bio 合作,研发的新模型 GPT-4b micro,设计出了新型且显著增强的山中因子变体。

苹果已悄然成立代号「AKI」(Answers, Knowledge & Information)新团队,致力打造类ChatGPT的「答案引擎」,可整合网页信息直接生成回答,计划嵌入Siri、Safari、Spotlight等系统核心功能。这是苹果重塑AI搜索主控权的重大举措。

医疗科技公司Method AI近日宣布完成2000万美元A轮融资,由私人家族办公室领投,克利夫兰诊所和JobsOhio Growth Capital Fund跟投。该公司致力于通过图像引导手术导航技术改善肿瘤手术效果,解决长期困扰外科领域的视觉局限问题。

Atlas进厂打工技能再进化!波士顿动力联手丰田研究院,首次让人形机器人Atlas能够通过语言指令驱动,一次性处理从折叠配件到整理仓架的复杂作业。这种LBM(Large Behavior Models,大行为模型)方法让机器人具备跨任务泛化能力,迈出了工业化实践的一大步。

硅谷的 AI 赛道上,三位手握国际信息学奥林匹克(IOI)奖牌的华裔青年正改写格局:斯科特・吴、沃登・严、斯蒂芬・郝,2023 年 11 月在硅谷车库启动项目,推出 AI 程序员 Devin。

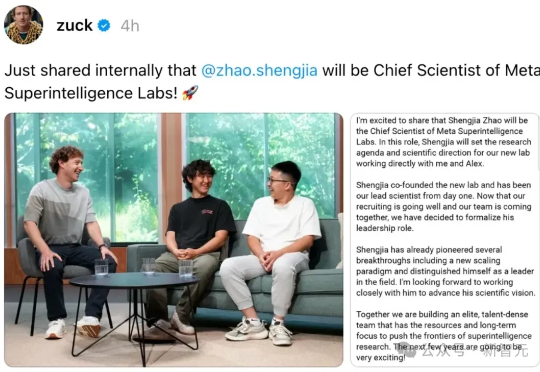

Meta超级智能实验室一拆四以后,首席AI官Alexandr Wang全员信曝光。这位28岁华人获扎克伯格力挺,出任超级智能实验室负责人。内部信强调「超级智能即将到来」,并宣布实验室拆分为四大部门。同时,AGI Foundations团队被解散,成员分流。Yann LeCun地位明显降级,权力重心全面向Wang集中。

00后AI创业潮来袭!华人女生MIT辍学创业,拿下融资2100万美元(折合人民币1.5亿元)。 公司直接剑指RPA(机器人流程自动化)界的Copilot。

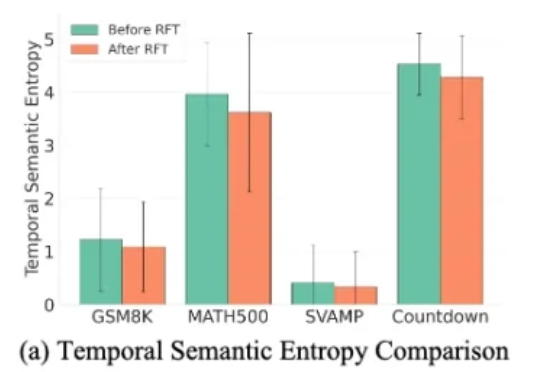

近年来,扩散大语言模型(Diffusion Large Language Models, dLLMs)正迅速崭露头角,成为文本生成领域的一股新势力。与传统自回归(Autoregressive, AR)模型从左到右逐字生成不同,dLLM 依托迭代去噪的生成机制,不仅能够一次性生成多个 token,还能在对话、推理、创作等任务中展现出独特的优势。