AI界的奇迹之夜:一天内4家巨头迭代大模型,苹果首下场

AI界的奇迹之夜:一天内4家巨头迭代大模型,苹果首下场不得不感叹,国外AI大模型的迭代速度,就像是坐火箭????。

不得不感叹,国外AI大模型的迭代速度,就像是坐火箭????。

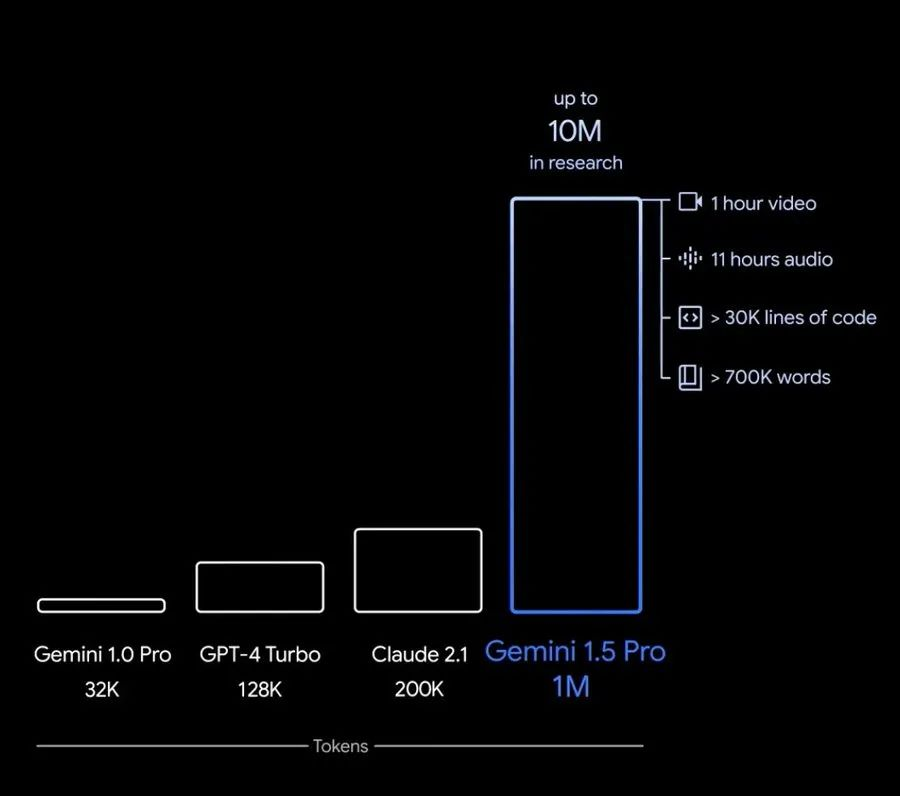

GPT-4问世一年后,全世界已经到处都是GPT-4级别的大模型了。 尤其是最近几个月,这些模型以越发密集的频率现身

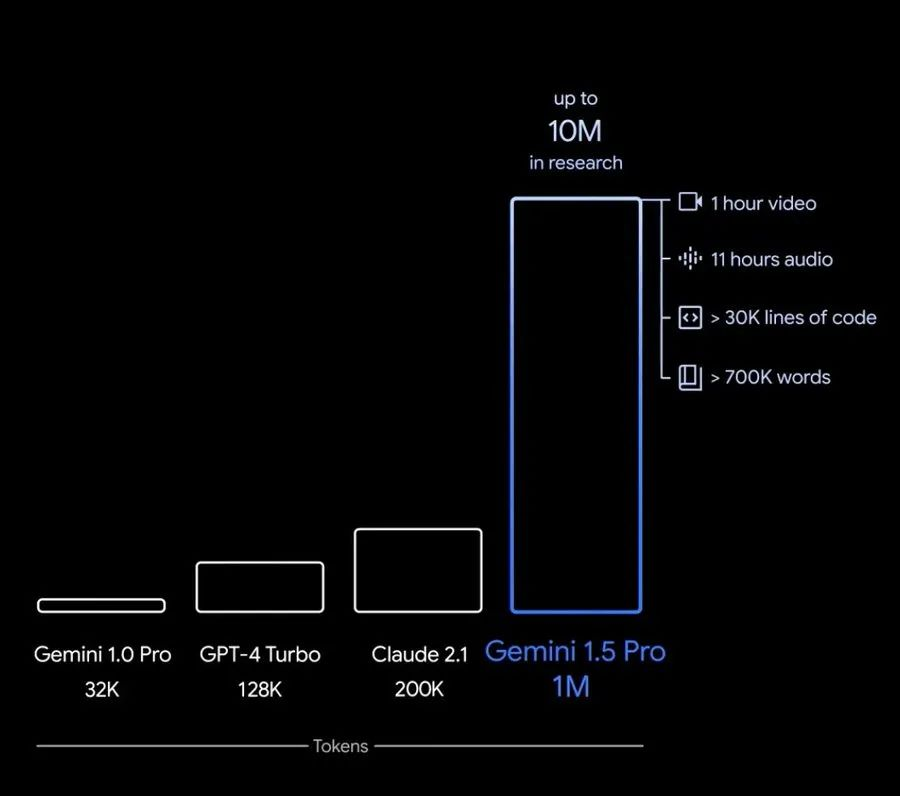

来自人大与浙大学者团队的研究者们把涉及数千篇SCI/SSCI的期刊论文的10000多条推文喂给了GPT-4,让它根据推文回答“这篇论文是否有可能被撤稿”,然后和人类预测的结果相比较。

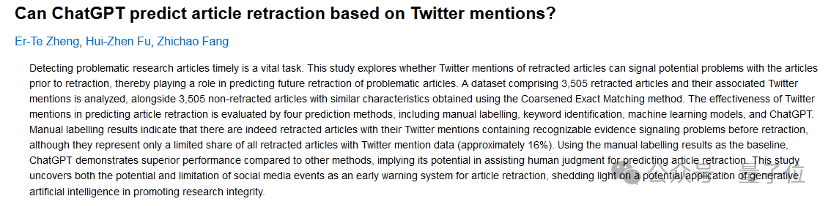

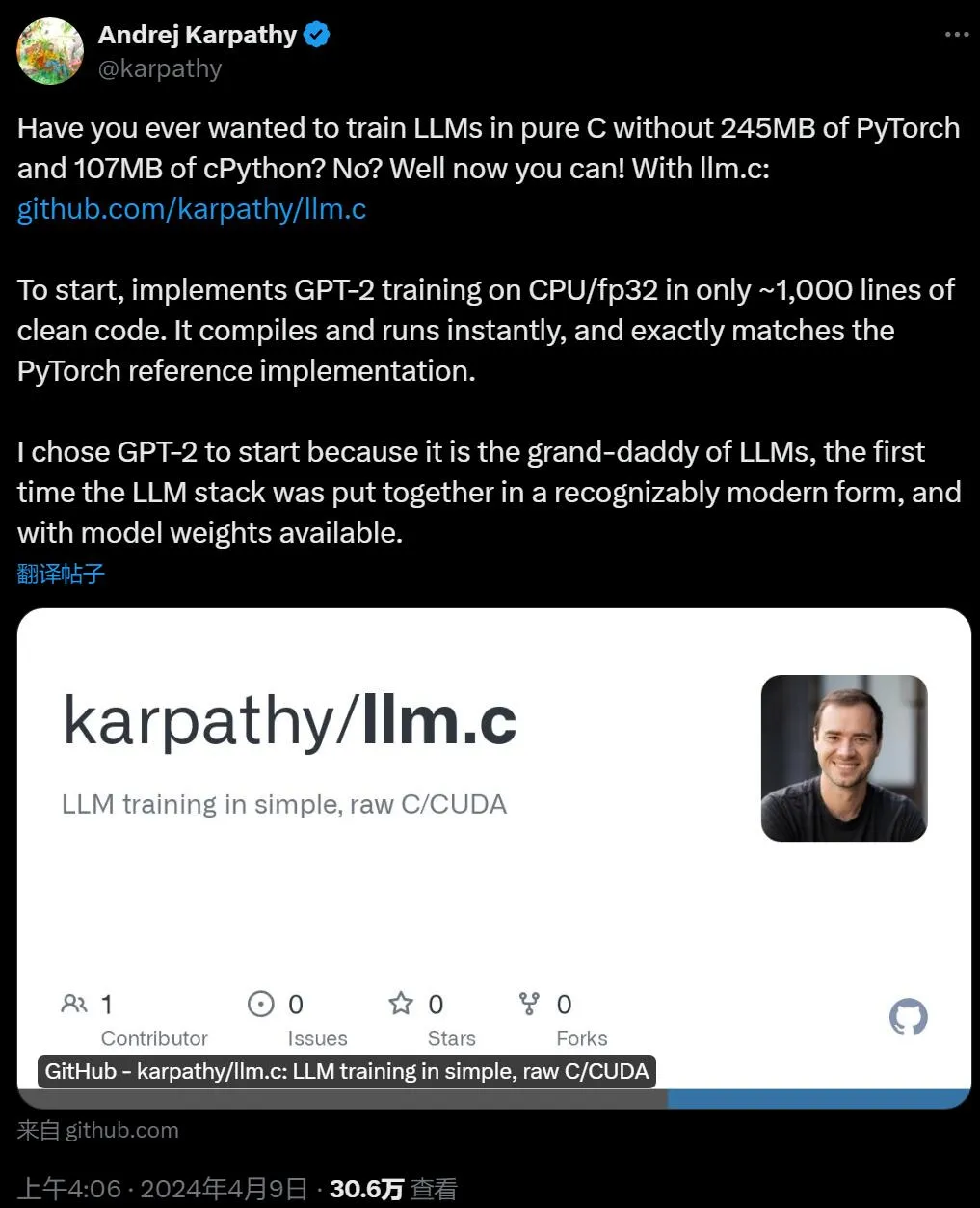

纯C语言训练GPT,1000行代码搞定!,不用现成的深度学习框架,纯手搓。 发布仅几个小时,已经揽星2.3k。

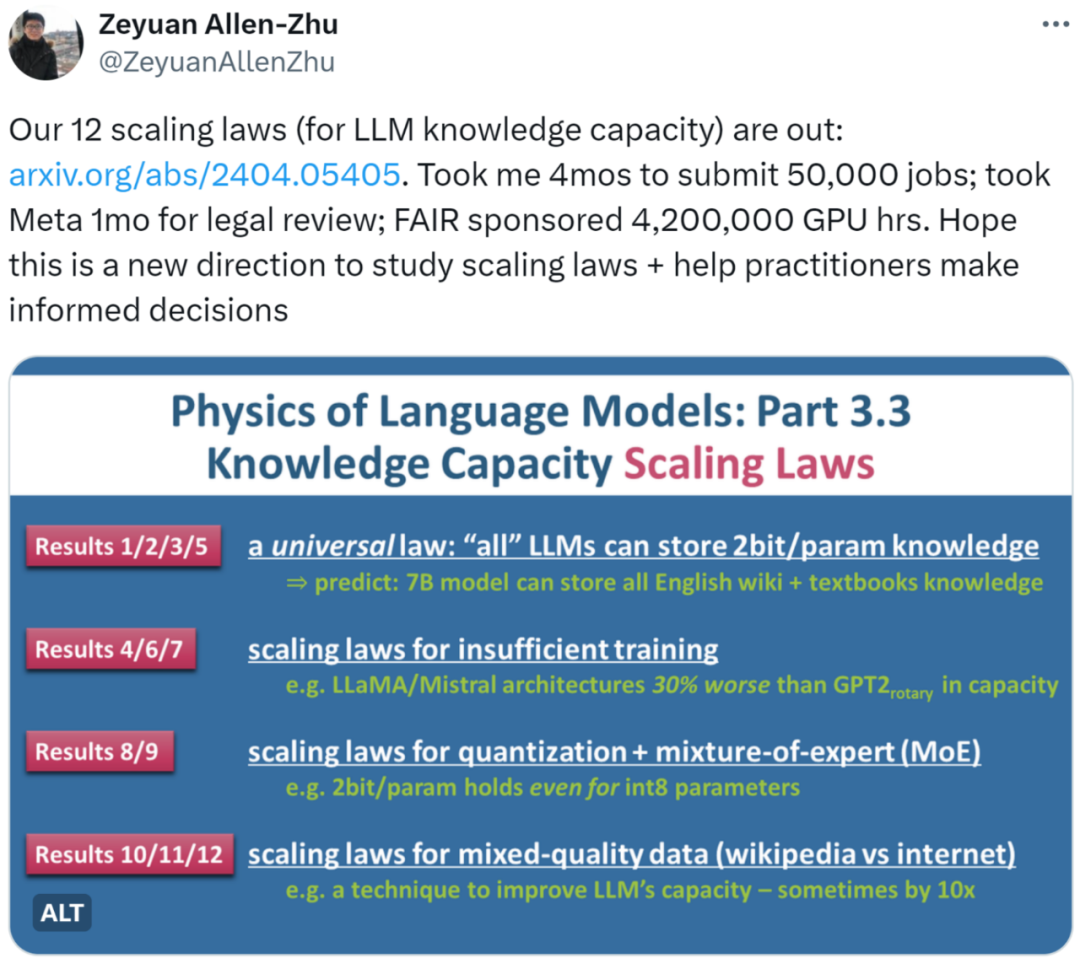

近日,朱泽园 (Meta AI) 和李远志 (MBZUAI) 的最新研究《语言模型物理学 Part 3.3:知识的 Scaling Laws》用海量实验(50,000 条任务,总计 4,200,000 GPU 小时)总结了 12 条定律,为 LLM 在不同条件下的知识容量提供了较为精确的计量方法。

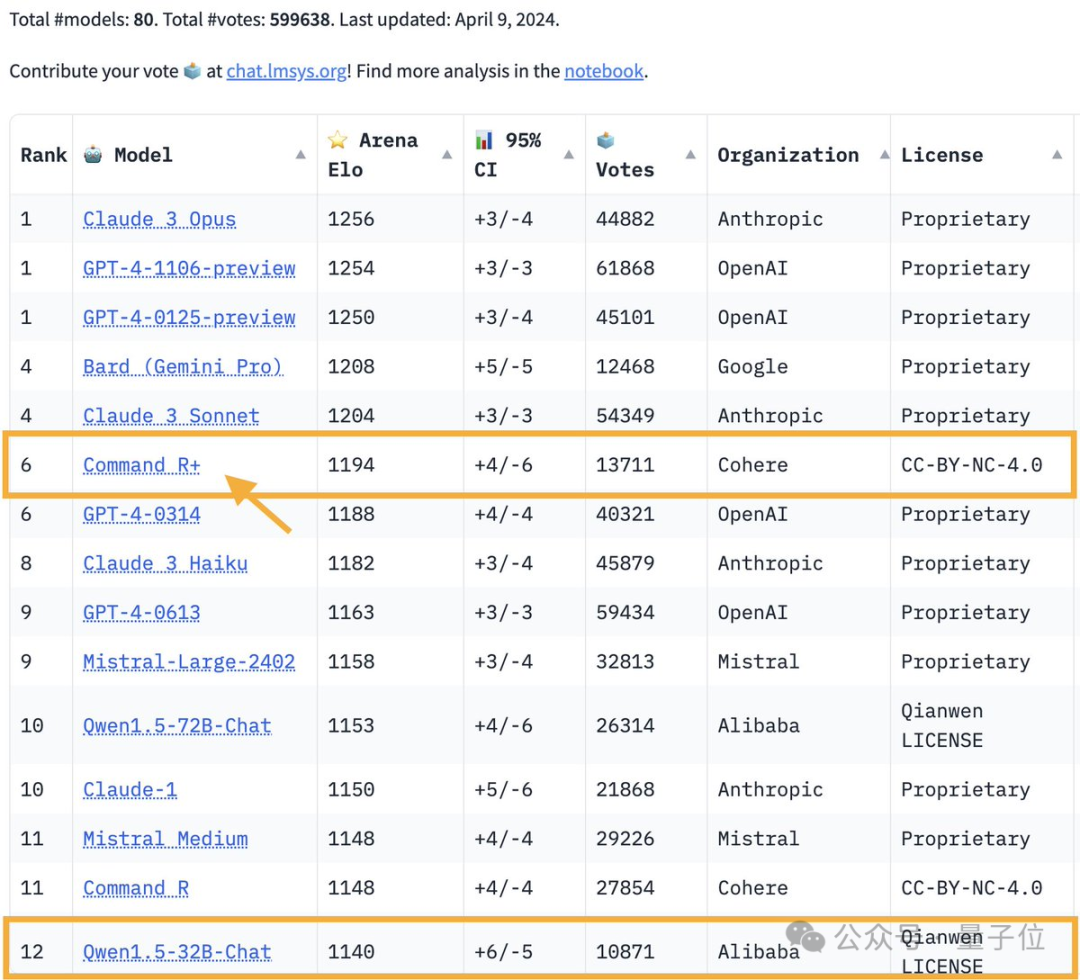

能打得过GPT-4的开源模型出现了!

「Real men program in C.」 众所周知,大语言模型还在快速发展,应该有很多可以优化的地方。我用纯 C 语言来写,是不是能优化一大截? 也许很多人开过这样的脑洞,现在有大佬实现了。

大语言模型的「逆转诅咒」,被解开了。近日,来自Meta FAIR的研究人员推出了反向训练大法,让模型从反方向上学到了事实之间的逻辑,终于改进了这个困扰人们已久的问题。

训大模型的方法可能要被革新了!AI大神Karpathy发布的新项目仅用1000行的C语言训完GPT-2,而不再依赖庞大的GPT-2库。他本人预告,即将上线新课。

距离AI「杀死」搜索引擎,到底还差几步?