Karpathy点赞,这份报告教你如何用 LLaMa 3创建高质量网络数据集

Karpathy点赞,这份报告教你如何用 LLaMa 3创建高质量网络数据集众所周知,对于 Llama3、GPT-4 或 Mixtral 等高性能大语言模型来说,构建高质量的网络规模数据集是非常重要的。然而,即使是最先进的开源 LLM 的预训练数据集也不公开,人们对其创建过程知之甚少。

众所周知,对于 Llama3、GPT-4 或 Mixtral 等高性能大语言模型来说,构建高质量的网络规模数据集是非常重要的。然而,即使是最先进的开源 LLM 的预训练数据集也不公开,人们对其创建过程知之甚少。

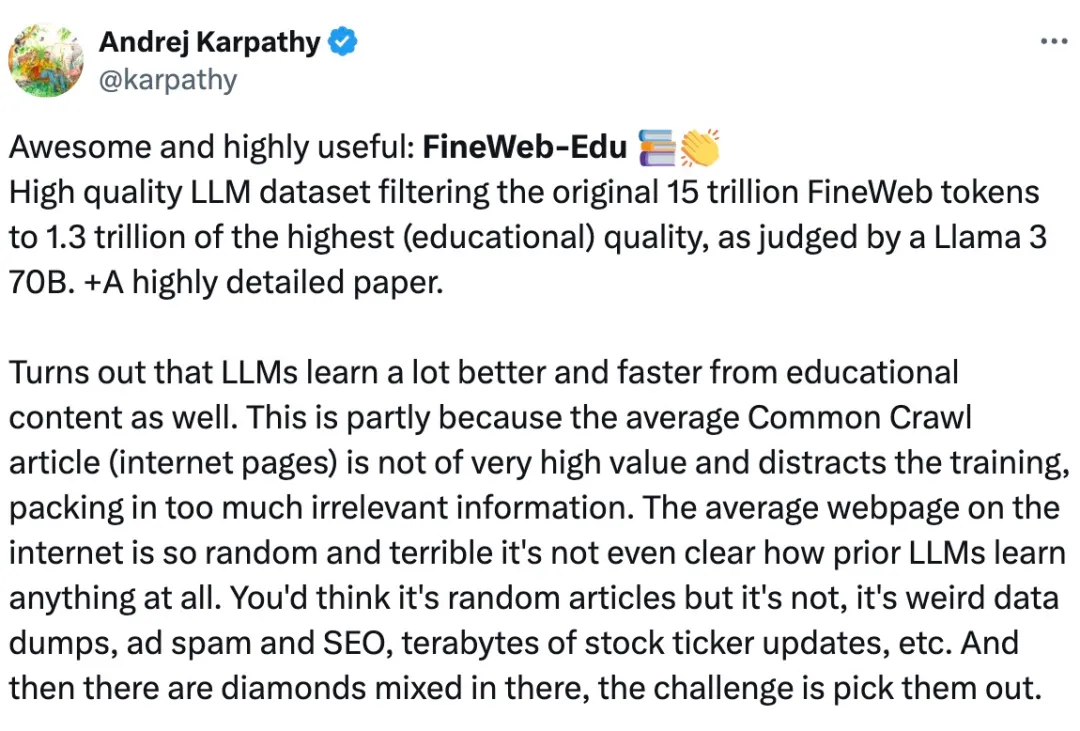

只用强化学习来微调,无需人类反馈,就能让多模态大模型学会做决策!

OpenAI CEO山姆·阿尔特曼去年年底被董事会突然解雇又光速复职的事情一直是硅谷的焦点。现在当时因参与做出解雇阿尔特曼决定而被解雇的前董事会成员海伦·托纳在新播客中又谈到了当时的一些内幕。

据奥特曼自己估计,他和他的风投基金已经投资了400多家公司。

黄仁勋:我家的 GPU 芯片一年一更新,其他家怎么追?

除了OpenAI自己,居然还有别人能用上GPT-4-Base版??

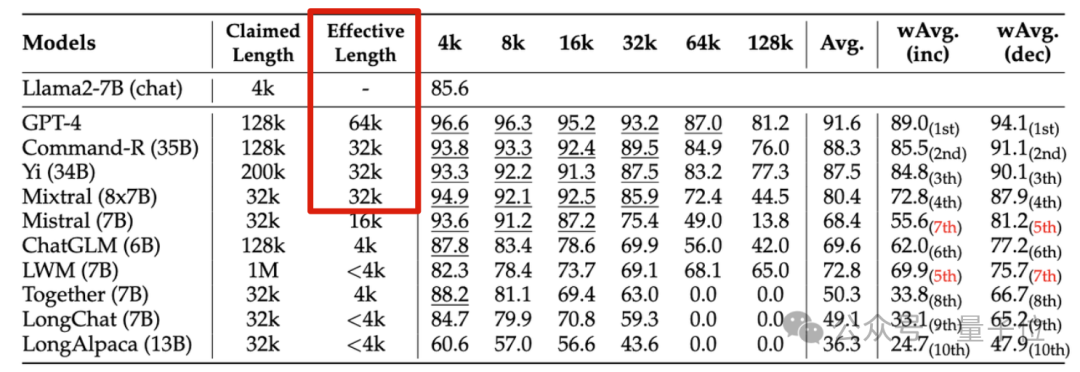

无情戳穿“长上下文”大模型的虚标现象

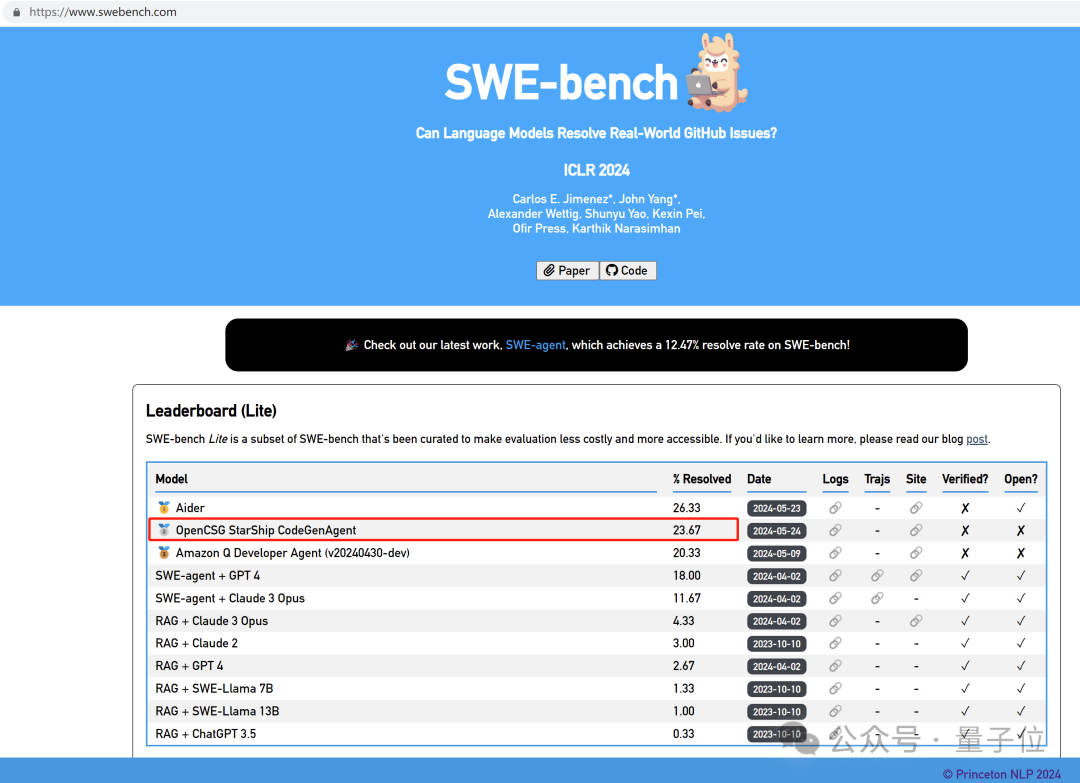

超越Devin!SWEBench排行榜上迎来了新玩家

研究人员提出了一种新的大型语言模型训练方法,通过一次性预测多个未来tokens来提高样本效率和模型性能,在代码和自然语言生成任务上均表现出显著优势,且不会增加训练时间,推理速度还能提升至三倍。

刚刚,老黄又高调向全世界秀了一把:已经量产的Blackwell,8年内将把1.8万亿参数GPT-4的训练能耗狂砍到1/350;英伟达惊人的产品迭代,直接原地冲破摩尔定律;Blackwell的后三代路线图,也一口气被放出。