黄仁勋最新访谈全文:自曝每天使用ChatGPT,每次演讲都硬着头皮上

黄仁勋最新访谈全文:自曝每天使用ChatGPT,每次演讲都硬着头皮上在解释英伟达为何放弃Arm而选择收购Mellanox时,黄仁勋称文化融合充满了挑战。

在解释英伟达为何放弃Arm而选择收购Mellanox时,黄仁勋称文化融合充满了挑战。

未来的大模型,或许都是 A 卡来算的? 从 PC 端到服务器,AMD 一次发布就完成了对 AI 计算的全覆盖。 今天凌晨,AMD 首席执行官苏姿丰(Lisa Su)在旧金山举行的 Advancing AI 2024 活动上发布了全新一代 Ryzen CPU、Instinct AI 计算卡、EPYC AI 芯片等一系列产品。

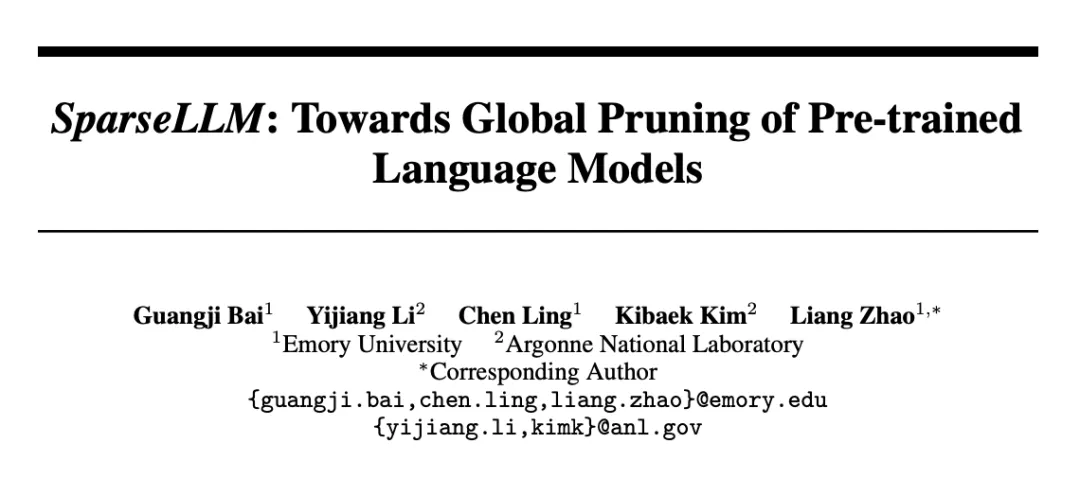

该研究主要探讨了大语言模型的全局剪枝方法,旨在提高预训练语言模型的效率。该成果的发表为大模型的剪枝与优化研究提供了新的视角,并在相关领域具有重要的应用潜力。

在这种背景下,研究团队提出了一个全新的框架:SubgoalXL,结合了子目标(subgoal)证明策略与专家学习(expert learning)方法,在 Isabelle 中实现了形式化定理证明的性能突破。

今天,Sam Altman很罕见的在他的个人网站上发布了一篇推文:The Intelligence Age(智能时代)。

在当今这个智能化迅猛发展的时代,人工智能(AI)监测工具已悄然渗透到职场的各个角落,成为雇主们提升生产力的新宠。它们被赋予了革命性的任务:通过精密的数据追踪和分析,优化员工的工作表现。然而,常春藤联盟之一、世界领先的学术教育机构康奈尔大学 (Cornell University) 最新发布的研究却揭示了一个令人意外的现象:这些被寄予厚望的工具,实际上可能会削弱生产力,甚至引发员工的大规模离职。

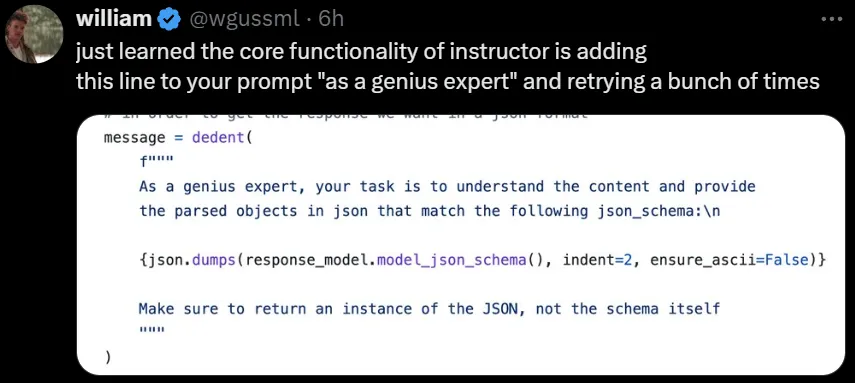

提示词工程不再玄学!

前些天,OpenAI 发布了 ο1 系列模型,它那「超越博士水平的」强大推理性能预示着其必将在人们的生产生活中大有作为。但它的使用成本也很高,以至于 OpenAI 不得不限制每位用户的使用量:每位用户每周仅能给 o1-preview 发送 30 条消息,给 o1-mini 发送 50 条消息。

张大鹏,加拿大皇家科学院院士,加拿大工程院院士,国际电气与电子工程师协会终身会士(IEEE Fellow),国际模式识别协会会士,亚太人工智能学会会士,香港中文大学(深圳)数据科学学院校长学勤讲座教授,深圳市人工智能与机器人研究院(AIRS)计算机视觉研究中心主任,香港中文大学(深圳)—联易融计算机视觉与人工智能联合实验室主任,以及香港理工大学荣誉教授。

9月10日凌晨,苹果发布全新iPhone 16系列,这款产品最重要的更新,也是对于苹果这个系列最大的期待,正是其Apple Intelligence的能力。