谷歌深夜放性价比“猛兽”!Gemini 3.1 Flash轻量版干翻前辈,价格打骨折

谷歌深夜放性价比“猛兽”!Gemini 3.1 Flash轻量版干翻前辈,价格打骨折首Token提速2.5倍,推理成绩干翻前代大模型。

来自主题: AI资讯

6363 点击 2026-03-04 11:29

首Token提速2.5倍,推理成绩干翻前代大模型。

新鲜出炉的龙虾来了!

冲刺多智能体第一股,毛利率超80%。

5天时间,AI就搞定了原本需要6个月完成的菲尔兹奖级数学成果的形式化证明。

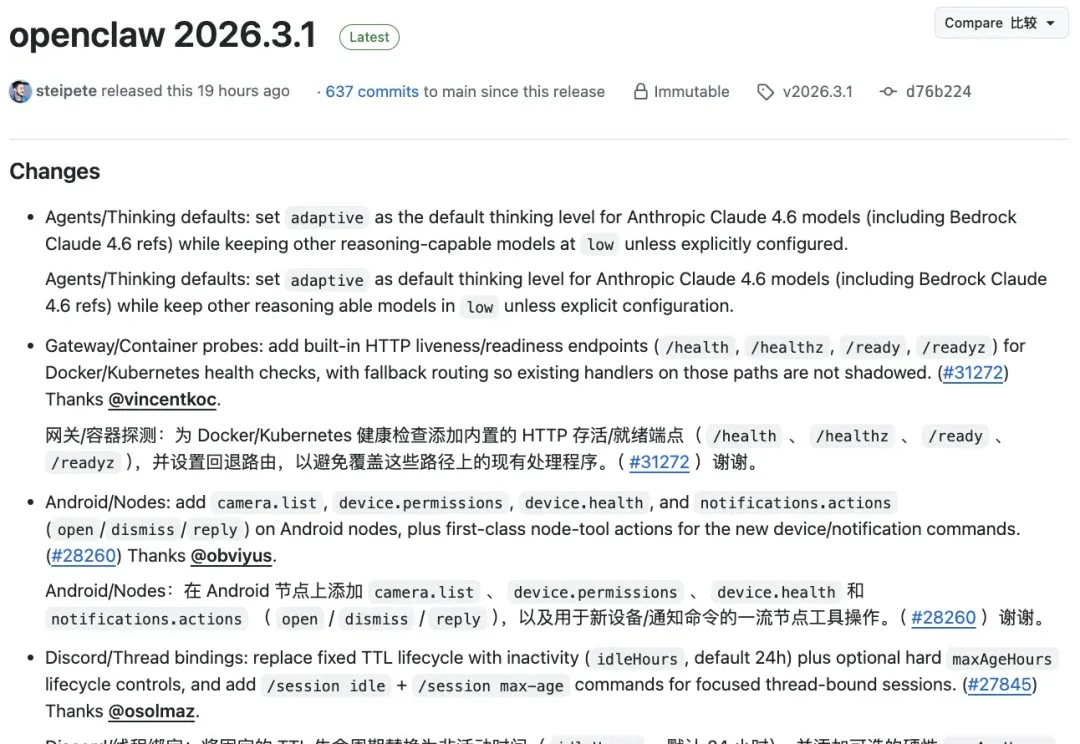

阶跃星辰Step 3.5 Flash霸榜OpenClaw调用排行,全球开发者正在“用脚投票”AI新方向。

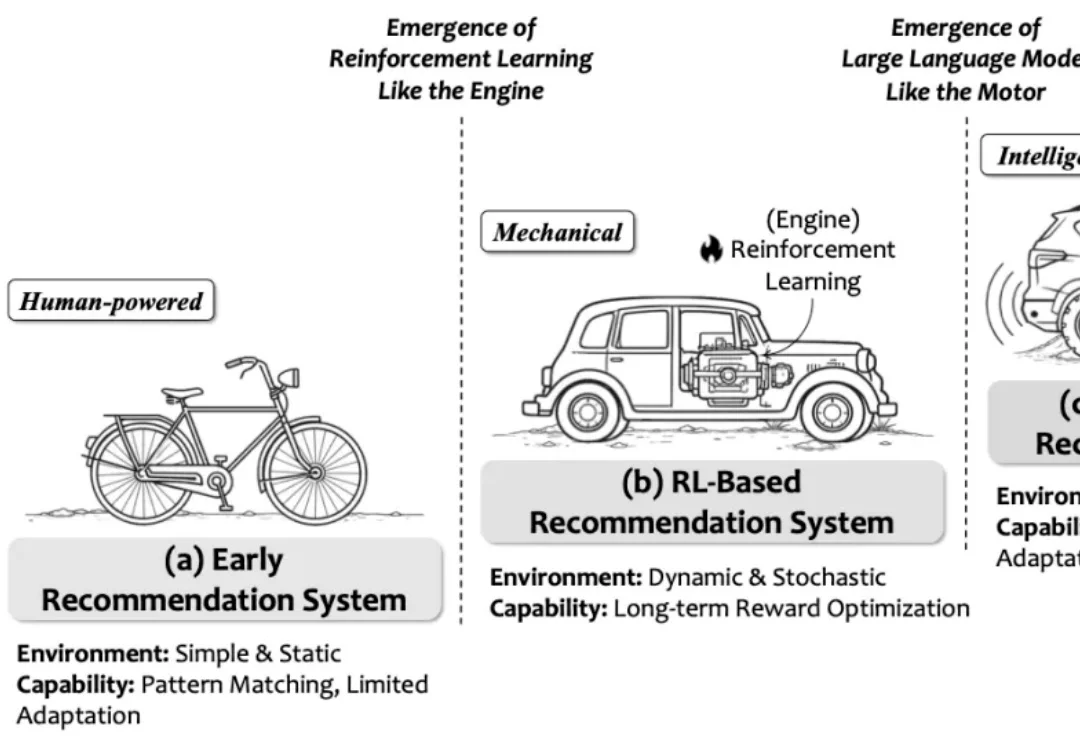

强化学习(RL)将推荐系统建模为序列决策过程,支持长期效益和非连续指标的优化,是推荐系统领域的主流建模范式之一。然而,传统 RL 推荐系统受困于状态建模难、动作空间大、奖励设计复杂、反馈稀疏延迟及模拟环境失真等瓶颈。

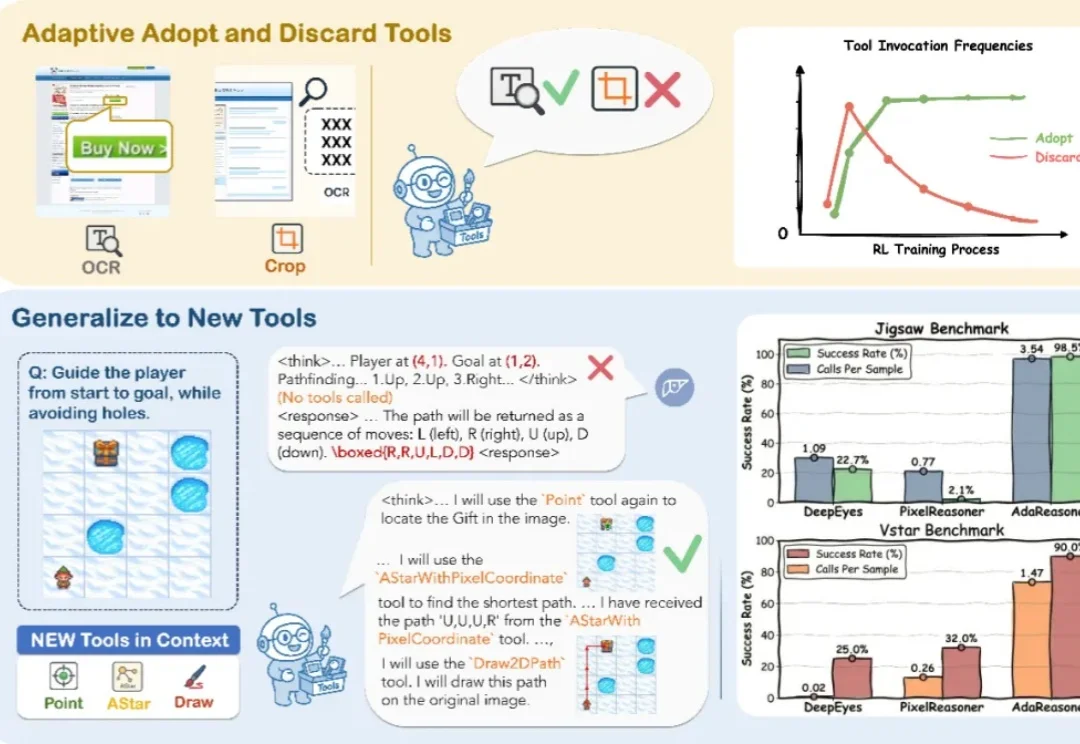

你见过 7B 模型在拼图推理上干翻 GPT-5 吗?

当 AI agent 需要一个「家」的时候,它们没有住进独立的 App,而是搬进了聊天软件。

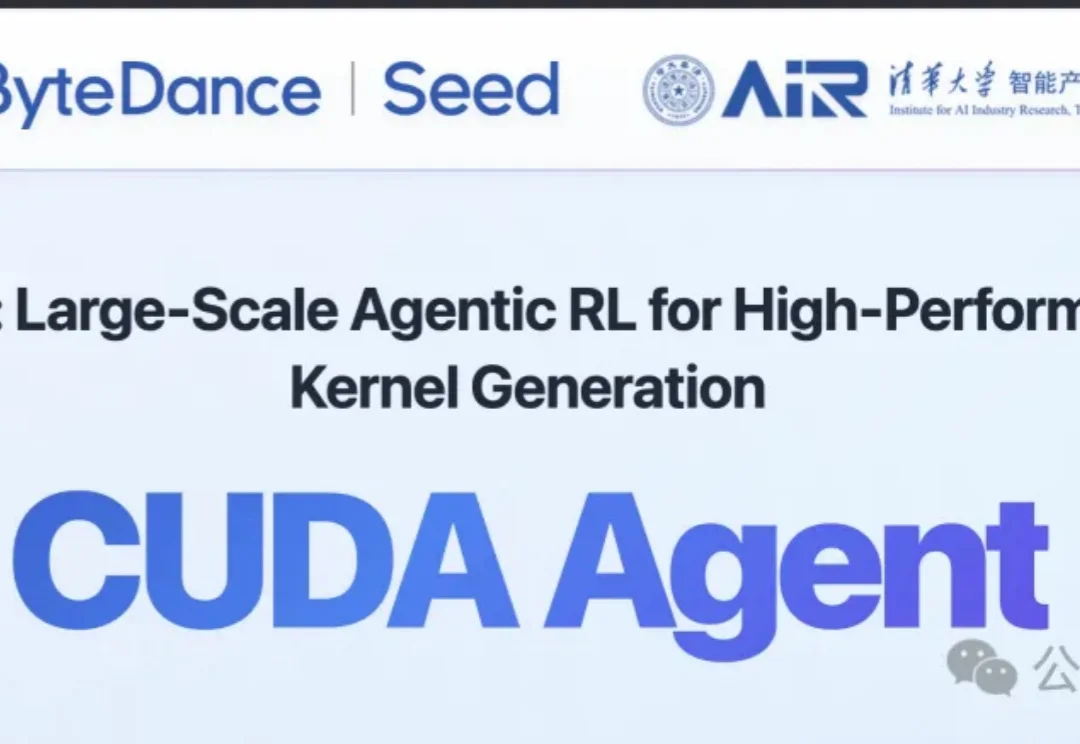

让AI自己写高性能GPU代码,字节Seed与清华AIR团队做到了。

Tabbit 背后的团队,是美团的光年之外 对,就是那个最早由王慧文老师创办,后来并入美团的那个光年之外