“3D视频版Sora”来了

“3D视频版Sora”来了40秒生成3D视频,Stability AI开源首个视频生视频模型。

40秒生成3D视频,Stability AI开源首个视频生视频模型。

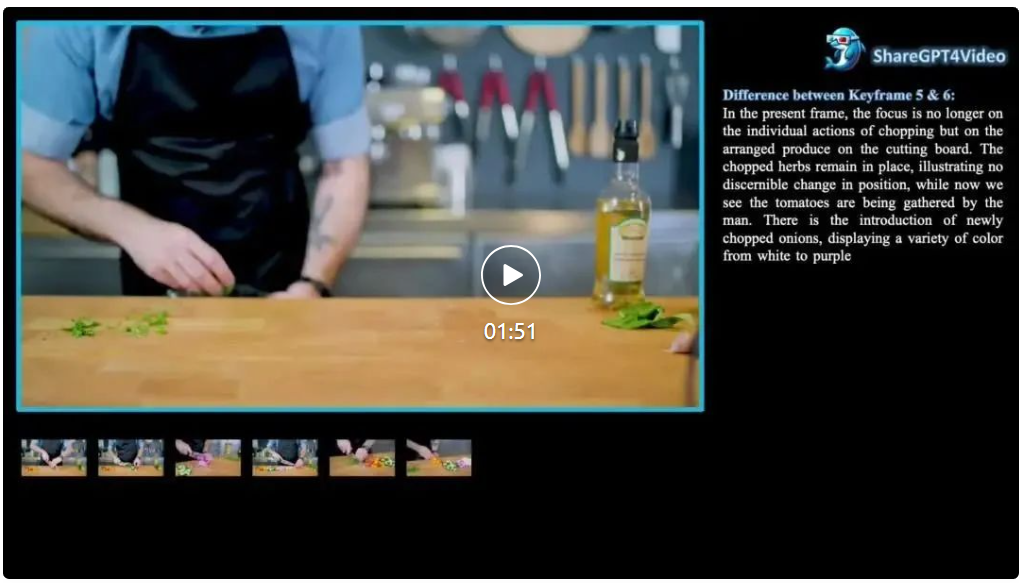

最近,新加坡国立大学联合南洋理工大学和哈工深的研究人员共同提出了一个全新的视频推理框架,这也是首次大模型推理社区提出的面向视频的思维链框架(Video-of-Thought, VoT)。视频思维链VoT让视频多模态大语言模型在复杂视频的理解和推理性能上大幅提升。该工作已被ICML 2024录用为Oral paper。

基于 ChatGPT、LLAMA、Vicuna [1, 2, 3] 等大语言模型(Large Language Models,LLMs)的强大理解、生成和推理能力

几乎每一天,AI都在获得新的能力。在机器人、大模型等热门赛道涌现后,专注企业服务的AI技术成为后起之秀,在智能客服、营销获客、企业培训等企服领域大展拳脚。

近日,首个多模态LLM视频分析综合评估基准Video-MME诞生!在这场全新的考试中,Gemini 1.5 Pro一路遥遥领先,谷歌首席科学家Jeff Dean更是愉快地连续转了3次推。

继Sora官宣之后,多模态大模型在视频生成方面的应用简直就像井喷一样涌现出来,LUMA、Gen-3 Alpha等视频生成模型展现了极佳质量的艺术风格和视频场景的细节雕刻能力,文生视频、图生视频的新前沿不断被扩展令大家惊喜不已,抱有期待。

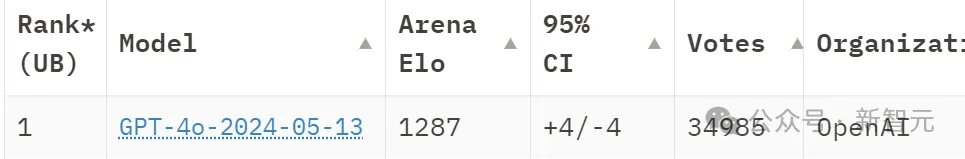

OpenAI和谷歌接连两场发布会,把AI视频推理卷到新高度。 但业界还缺少可以全面评估大模型视频推理能力的基准。 终于,多模态大模型视频分析综合评估基准Video-MME,全面评估多模态大模型的综合视频理解能力,填补了这一领域的空白。

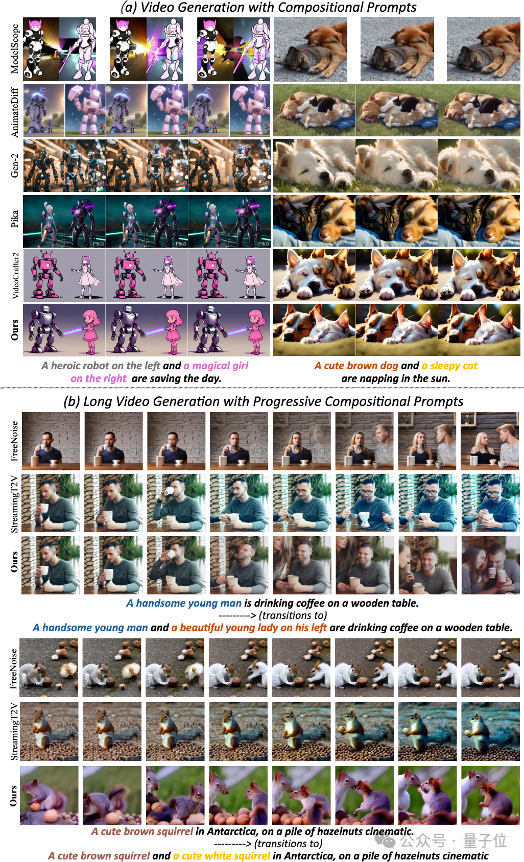

如何生成高难度、指令超复杂的视频呢?

北大-兔展联合发起的Sora开源复现计划Open-Sora-Plan,今起可以生成最长约21秒的视频了!

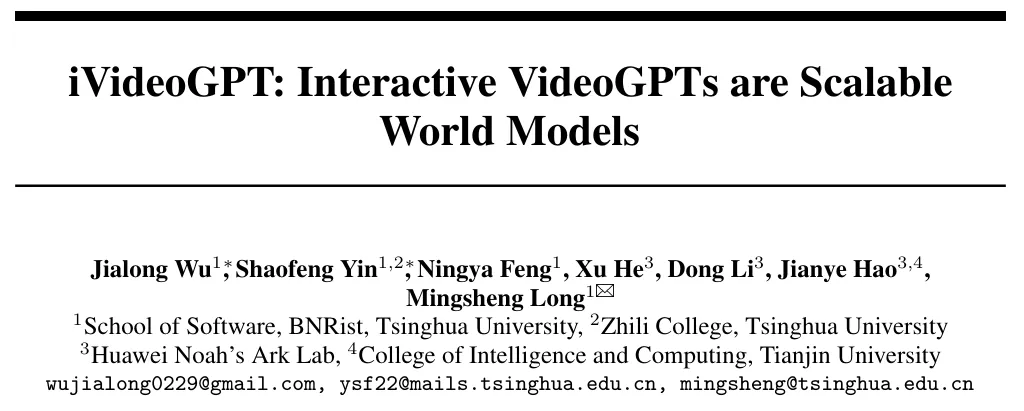

iVideoGPT,满足世界模型高交互性需求。