谁是Adam?NeurIPS 2025审稿爆年度最大笑话!Hinton也曾被拒稿

谁是Adam?NeurIPS 2025审稿爆年度最大笑话!Hinton也曾被拒稿LLM真是把审稿人害惨了!NeurIPS 2025评审结果公,全网都被「谁是Adam」爆梗淹没。更离谱的是,有人的审稿建议中,残留了AI提示的痕迹。

LLM真是把审稿人害惨了!NeurIPS 2025评审结果公,全网都被「谁是Adam」爆梗淹没。更离谱的是,有人的审稿建议中,残留了AI提示的痕迹。

AI教父Hinton中国首秀,在与周伯文教授的17分钟高密度对话中,他首次公开表示当今多模态大模型已具「意识」,并建议以不同技术训练「聪明」与「善良」AI。两人探讨AI主观体验、科学促进AI发展的路径,并寄语青年科研者:坚持怀疑与原创,突破才会发生。

在首次中国演讲中,AI教父Hinton于WAIC2025上探讨数字智能与生物智能的差异,指出AI因具备永生与高效共享而快速超越人脑。他警示若无全球安全协作,超级智能或将反噬人类。Hinton提出通过AI安全研究所联盟与技术栈分离,推动AI向善发展。

等了50年,AI教父Hinton终于「真人现身」中国了!这位图灵奖+诺奖教父级大神,不仅亲自踏上魔都土地,还与市委书记同框合影,瞬间刷屏全网!最近他再次预言,AI已进入觉醒倒计时。现在全网都在翘首以待,准备迎接明天他的高能演讲。

自 ChatGPT 引爆公众认知以来,AI 开始渗透进写作、编程、设计等多个应用场景,推动人类进入“智能体(Agent)”时代。曾经遥不可及的自动化交互,如今正在成为现实。在这背后,一场关于基础设施的重构也悄然展开——从模型能力到部署体验,谁能打通智能 Agent 的“最后一公里”,谁就掌握了这场范式变革的主动权。

AI永生,迟早比人更聪明!Hinton惊人预言:开发超级智能,就是与虎为伴,稍有不慎,人类万劫不复!

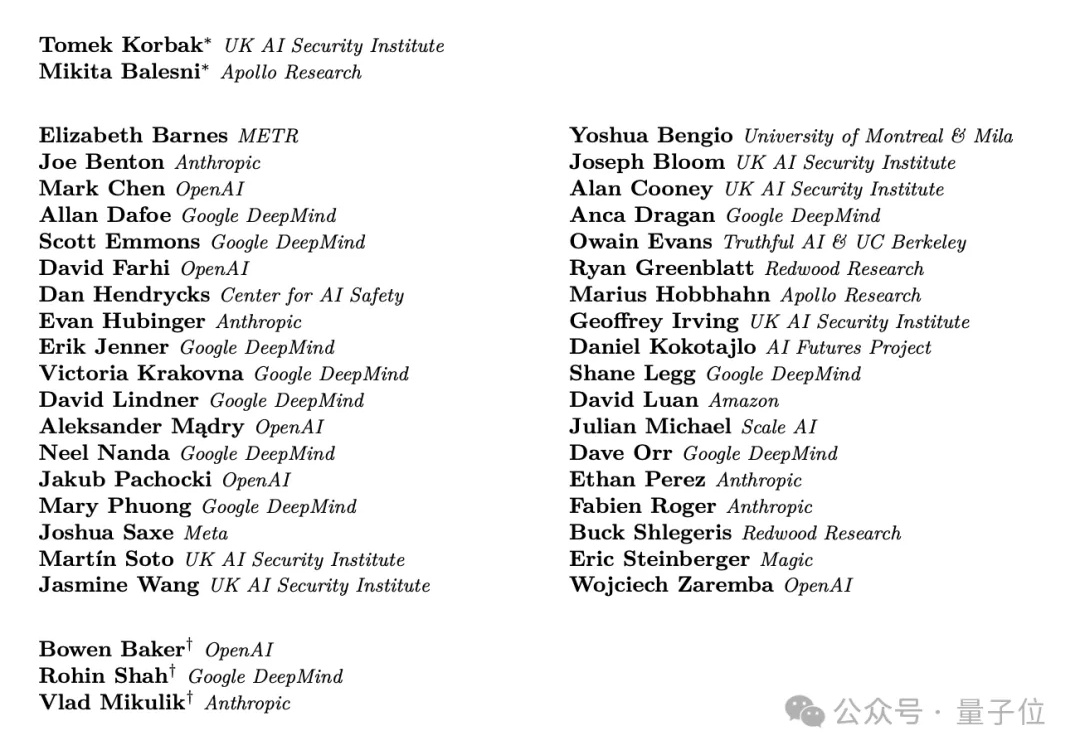

难得难得,几大AI巨头不竞争了不抢人了,改联合一起发研究了。

如果你想知道当自己不再是顶级智慧生物时,生活是什么样子,就去问问一只鸡吧。

就在刚刚,据《连线》杂志报道,OpenAI 总裁 Greg Brockman 本周二在公司 Slack 群里宣布从特斯拉、xAI 和 Meta 挖来四位硬核工程师,并将加入 OpenAI 的扩展团队。值得一提的是,Dalton 和 Ruddarraju 之前也都曾在 Robinhood 工作过。

蛋白质之后,DNA正成为AI+生命科学的下一个热门领域。