贾佳亚团队联合Adobe提出GenProp,物体追踪移除特效样样在行

贾佳亚团队联合Adobe提出GenProp,物体追踪移除特效样样在行论文一作刘少腾,Adobe Research实习生,香港中文大学博士生(DV Lab),师从贾佳亚教授。主要研究方向是多模态大模型和生成模型,包含图像视频的生成、理解与编辑。作者Tianyu Wang、Soo Ye Kim等均为Adobe Research Scientist。

论文一作刘少腾,Adobe Research实习生,香港中文大学博士生(DV Lab),师从贾佳亚教授。主要研究方向是多模态大模型和生成模型,包含图像视频的生成、理解与编辑。作者Tianyu Wang、Soo Ye Kim等均为Adobe Research Scientist。

它可以模仿人类研究者调用搜索引擎、看论文、查参考文献。繁琐冗长的论文调研,现在,只需要两分钟。

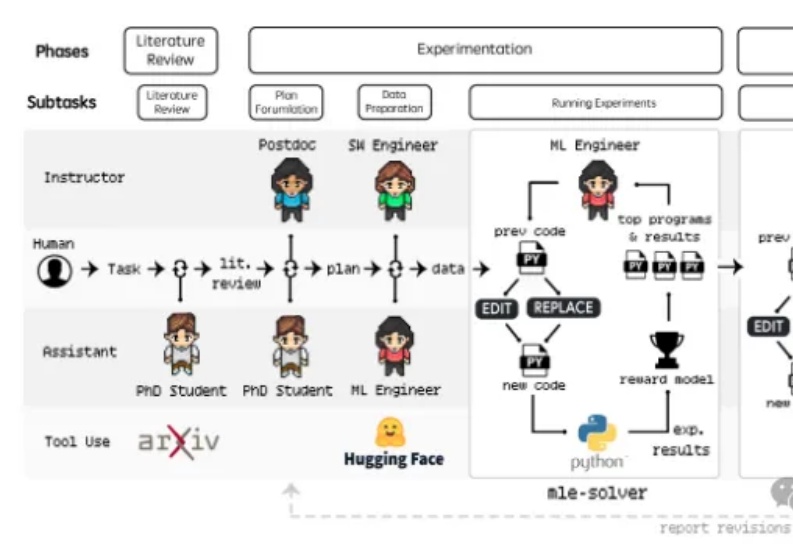

发表于昨天的论文《Agent Laboratory: Using LLM Agents as Research Assistants》对于科研界具有划时代意义,过去几周才能完成的科研任务现在仅需20分钟到一两个小时左右(不同LLM),花费2-13个美金的Token即可完成!

随着Gemini家族的日趋完善、阵容的发展壮大,谷歌大模型将可代表用户完成更多现实工作。

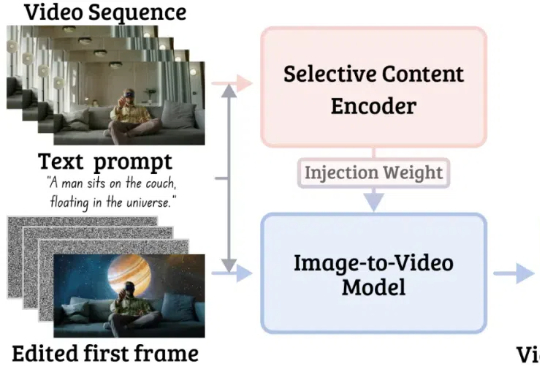

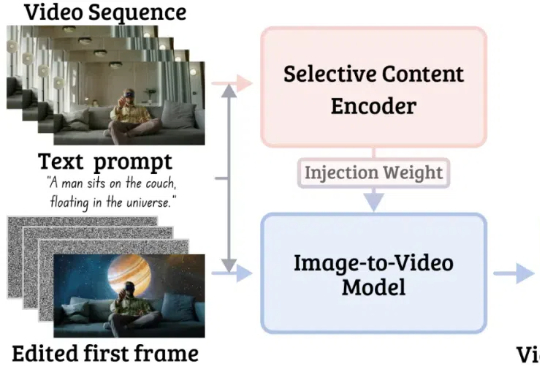

近期,知名研究机构 Appier AI Research 和国立台湾大学,联合发表了一篇论文

上周五,亚马逊研究奖(Amazon Research Awards,ARA)公布了最新一期来自 10 所大学的 10 名获奖者。

最近,Apollo Research团队发布了一项令人深思的研究。这项研究揭示了一个惊人的发现:当前主流的前沿AI模型已经具备了基本的"策划"(Scheming)能力。

人工智能工具正在帮助科研人员快速整合和理解大量科学文献,但完全自动化的高质量文献综述生成仍面临挑战,虽然能提升研究效率,但也存在生成低质量综述的风险,需谨慎使用,所以说现阶段还是人眼看论文靠谱。

2024 年的诺贝尔化学奖颁发给了在结构生物学领域取得重大成就的 David Baker 团队和 AlphaFold 团队,激发了 AI for science 领域新的研究热潮。

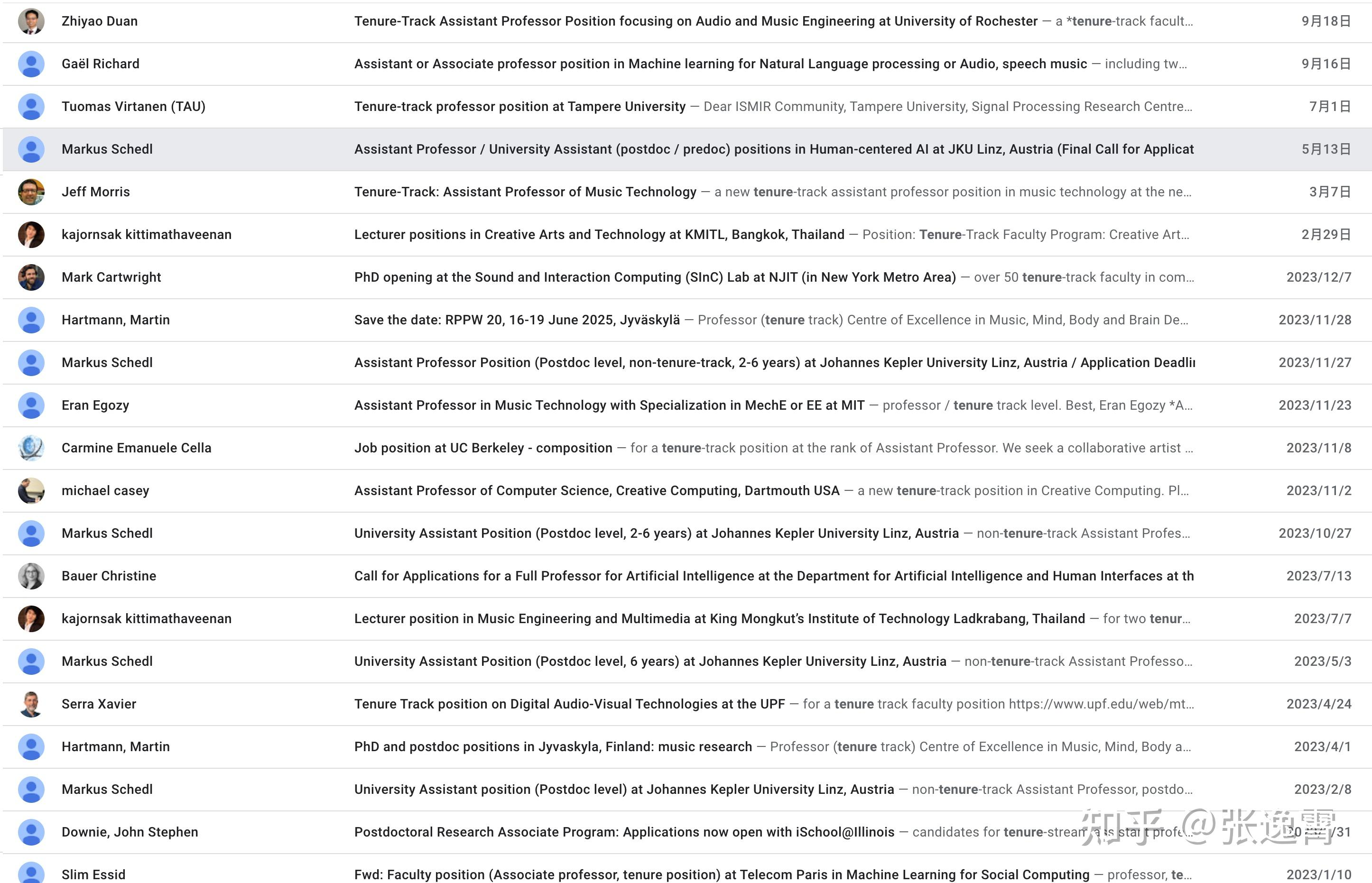

今年拿了腾讯 Al Lab(青云计划”), 字节跳动(Seed) 的 offer, 国外有之前实习的 Sony Research 和 Yamaha 的 return offer, 也有正在面试的 Adobe 和 Meta。 这些工作机会的方向都和我的博士工作完全 match, 没有转方向的痛苦。最后, 我接了字节 Seed 团队的 offer, 结束秋招。