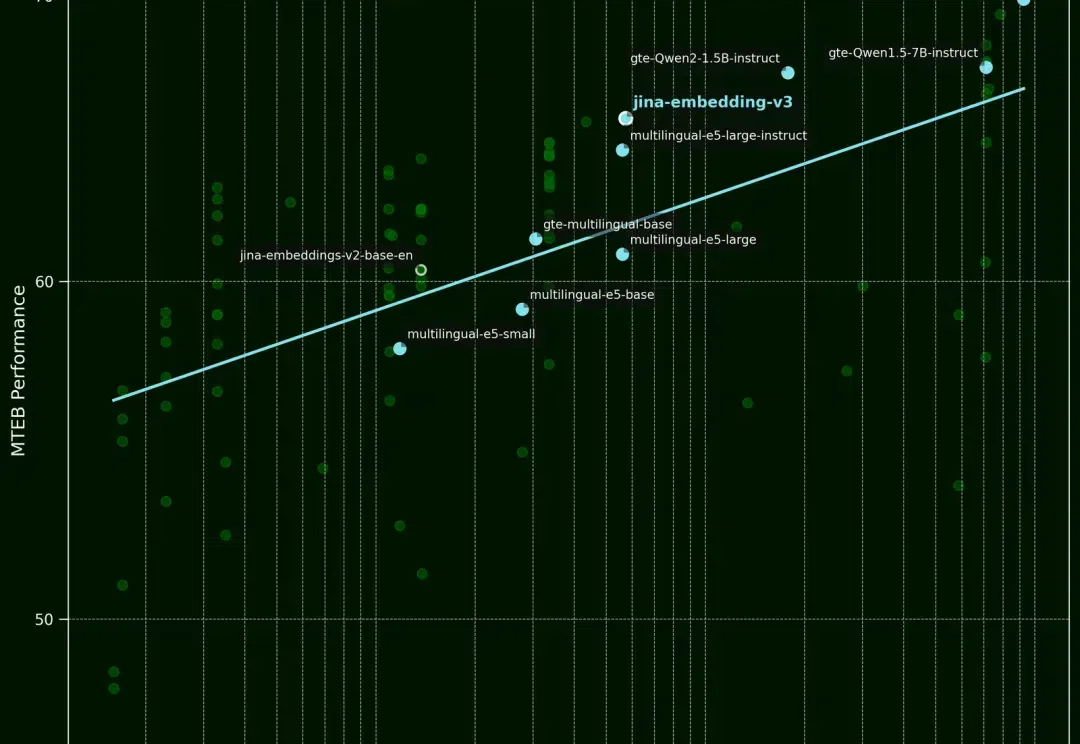

向量模型的词序感知缺陷与优化策略

向量模型的词序感知缺陷与优化策略最近,LAION AI 的创始人 Christoph Schuhmann 分享了一个有趣的发现,他指出,文本向量模型似乎存在一个问题:即使句子词序被打乱,模型输出的向量与原句仍然高度相似。

最近,LAION AI 的创始人 Christoph Schuhmann 分享了一个有趣的发现,他指出,文本向量模型似乎存在一个问题:即使句子词序被打乱,模型输出的向量与原句仍然高度相似。

这就是 Google DeepMind 的「DeepMind 部分」——重视它,是保护它的第一步。

继去年组建了多个AI团队后,近期在线教育大厂高途的创始人陈向东坦言,“我们可能做得不好,我在反思,可能确实做得没有那么好”。一时间,这番言论也让外界对于AI教育的未来开始抱有疑虑。

老iPhone又能再战一年。

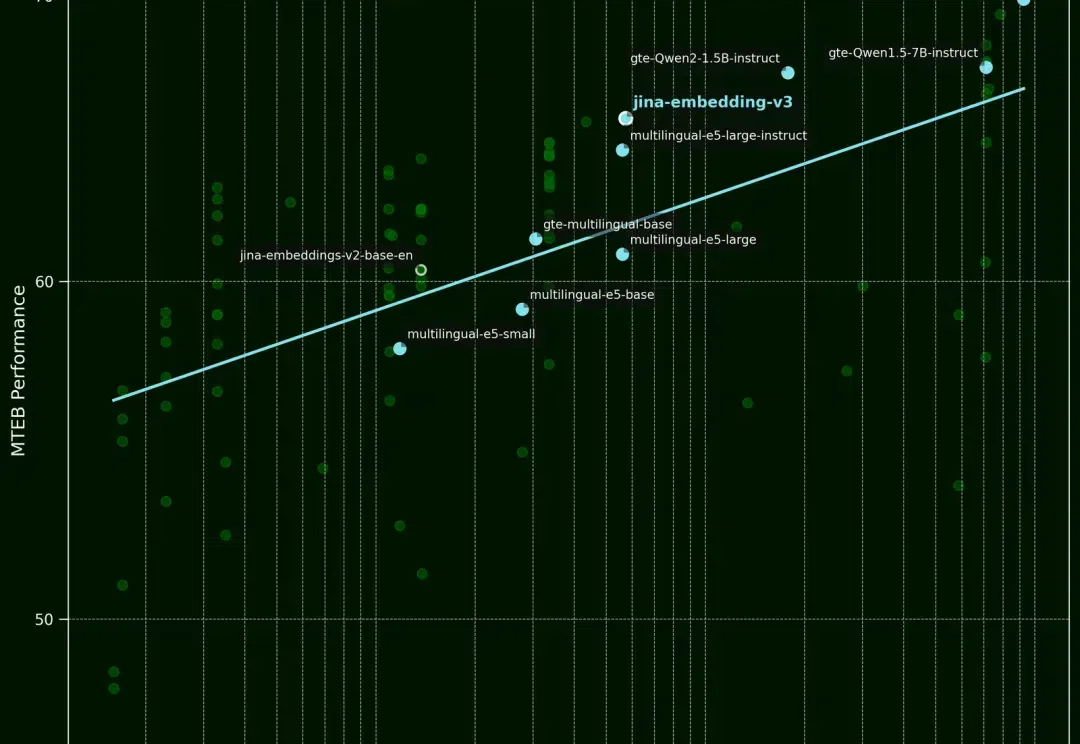

微软下一代14B小模型Phi-4出世了!仅用了40%合成数据,在数学性能上击败了GPT-4o,最新36页技术报告出炉。

AI 编程领域确实是太火了,4 个月前刚完成 6000 万美金融资的 Cursor,其背后公司 Anysphere 再次完成了 1 亿美金融资,估值达到了 26 亿美金,比 4 个月前涨了 6.5 倍。

最近AI业界的观点开始产生变化,Jason Wei明确指出AI for Science蕴藏着巨大的机遇,而其中最大的场景在于AlphaFold 2掀起的蛋白质革命。

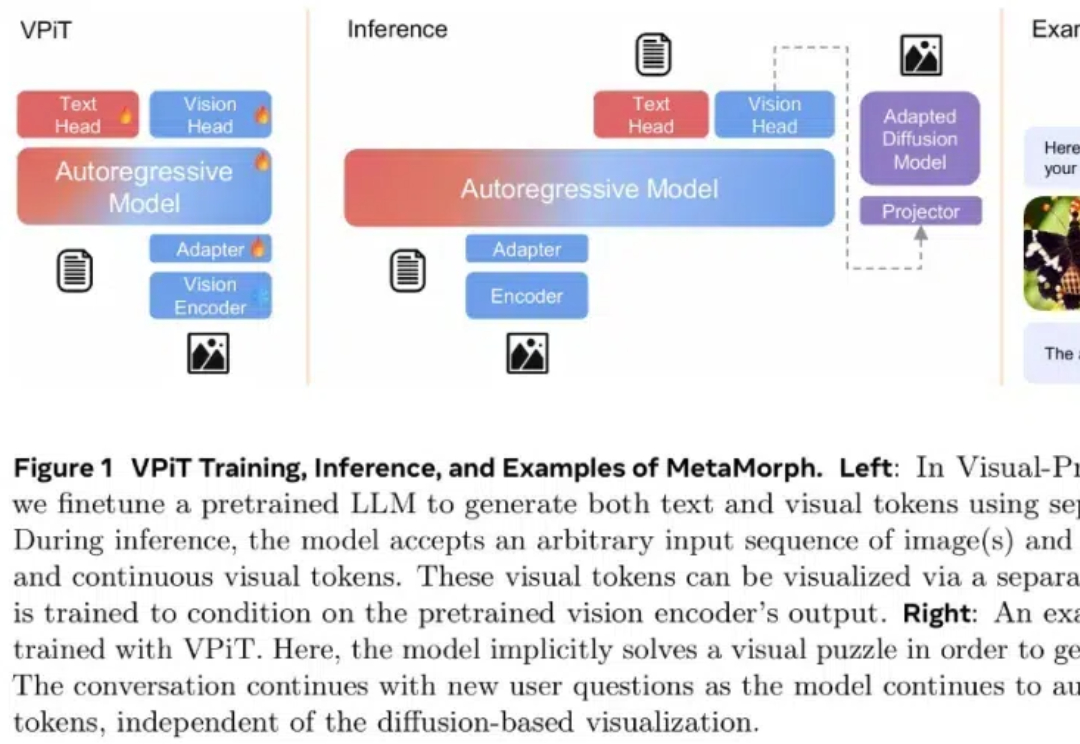

如今,多模态大模型(MLLM)已经在视觉理解领域取得了长足进步,其中视觉指令调整方法已被广泛应用。该方法是具有数据和计算效率方面的优势,其有效性表明大语言模型(LLM)拥有了大量固有的视觉知识,使得它们能够在指令调整过程中有效地学习和发展视觉理解。

12月19日,路透社援引三名消息人士的说法称,苹果公司正与腾讯和字节跳动商谈将二者的人工智能模型整合到在国行iPhone中。不过,据悉这些涉及人工智能大模型的讨论还处于非常早期的阶段。

今年 9 月 iPhone 16 系列发布时,库克明确表示:“新一代 iPhone 彻彻底底为 Apple Intelligence 打造,一个让人激动的新纪元由此开始。”