偷代码?泼脏水造谣?两大医生版ChatGPT对簿公堂,打响AI医疗第一案

偷代码?泼脏水造谣?两大医生版ChatGPT对簿公堂,打响AI医疗第一案近日,AI医疗上市公司Doximity,起诉另一家AI医疗独角兽OpenEvidence,指控其损害声誉并挖走员工。两家公司都在打造医生版“ChatGPT",但因为行业竞争而不断升级法律战。

搜索

搜索

近日,AI医疗上市公司Doximity,起诉另一家AI医疗独角兽OpenEvidence,指控其损害声誉并挖走员工。两家公司都在打造医生版“ChatGPT",但因为行业竞争而不断升级法律战。

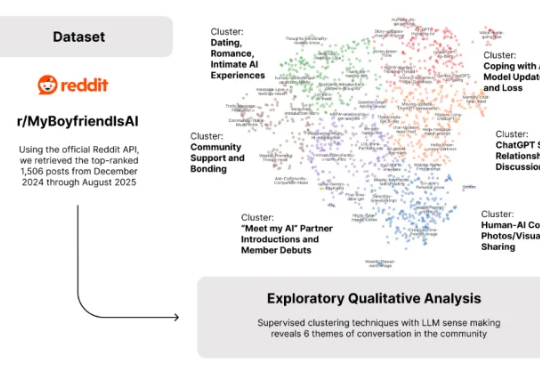

终于有科学家对“AI伴侣”这事儿展开正经研究了!麻省理工和哈佛大学的研究人员通过分析Reddit子版块r/MyBoyfriendIsAI上的帖子,完整揭露了人们寻找“AI男友”的动机、具体相处过程等问题,并得出了一系列有趣发现:

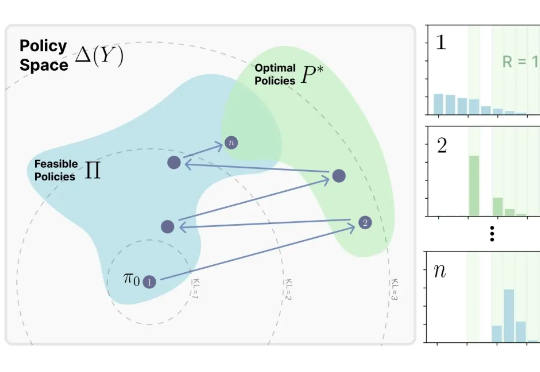

来自MIT Improbable AI Lab的研究者们最近发表了一篇题为《RL's Razor: Why Online Reinforcement Learning Forgets Less》的论文,系统性地回答了这个问题,他们不仅通过大量实验证实了这一现象,更进一步提出了一个简洁而深刻的解释,并将其命名为 “RL's Razor”(RL的剃刀)。

近期,一款名为 TipTap AI 的应用在海外市场爆火。它的背后是前商汤AI团队的余锋伟和宋广录。 根据公开信息,TipTap AI归属于Vivix Group Limited,公司注册于香港,旗下控股杭州和上海维悦时刻科技,由余锋伟和宋广录担任法人。

不动嘴不动手,只靠意念就能对手机发号施令?

现在做 AI 课程的,不计其数,吴恩达、Andrej Karpathy,Greg Isenberg 等人更是大神下凡支教。高校如斯坦福、MIT、哈佛等也有公开课资源。

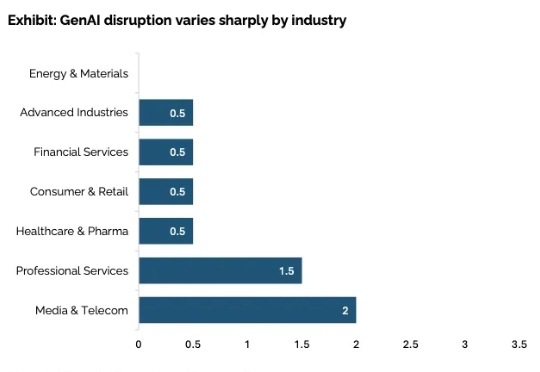

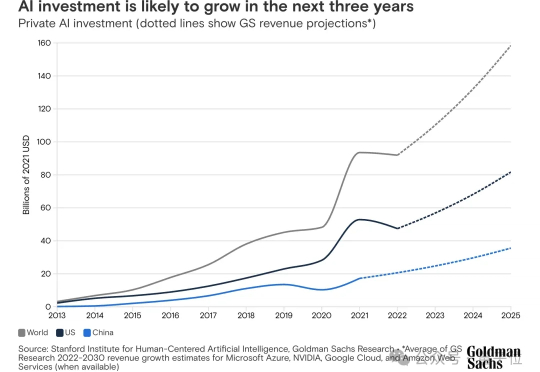

这份来自麻省理工的2025年商业AI现状的研究报告最近在网上炸锅了,该报告称 95% 的人工智能试点都失败了,这吓坏了美国股市的投资者。报告提到大多数公司都陷入了困境,因为 95% 的 GenAI 试点项目都没有产生任何投资回报率,而只有 5% 的公司通过使用可学习、可融入实际工作流程并随着使用而改进的系统获得了成功。

每个快速发展的公司都逃不开合规噩梦,繁琐、耗时、烧钱。两个MIT辍学生用AI智能体向这个痛点宣战,不仅解放了无数打工人,更让顶级资本心甘情愿地送上支票。

95%的AI项目,回报都挂零?!! MIT最新报告显示,原来只有5%的AI项目才能创造百万美元价值,其余的都仍在亏损。

在本周MIT报告揭露“绝大多数企业投资AI尚未盈利”引发市场哗然之际,另一项出乎意料的现象也浮出水面:企业部署先进人工智能成本下降的趋势在2025年突然停滞。