7B的DeepSeek蒸馏Qwen数学超o1!在测试时间强化学习,MIT积分题大赛考93分

7B的DeepSeek蒸馏Qwen数学超o1!在测试时间强化学习,MIT积分题大赛考93分见识过32B的QwQ追平671的DeepSeek R1后——刚刚,7B的DeepSeek蒸馏Qwen模型超越o1又是怎么一回事?新方法LADDER,通过递归问题分解实现AI模型的自我改进,同时不需要人工标注数据。

见识过32B的QwQ追平671的DeepSeek R1后——刚刚,7B的DeepSeek蒸馏Qwen模型超越o1又是怎么一回事?新方法LADDER,通过递归问题分解实现AI模型的自我改进,同时不需要人工标注数据。

DeepSeek现身香港?

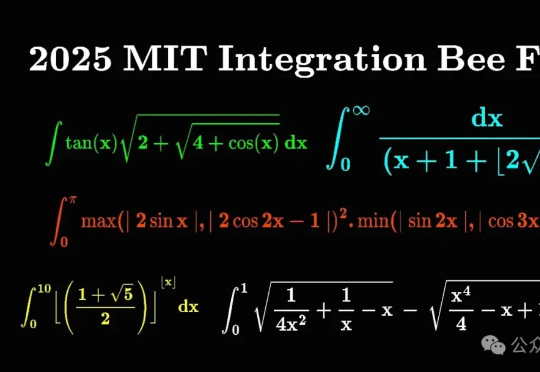

Transformer 很成功,更一般而言,我们甚至可以将(仅编码器)Transformer 视为学习可交换数据的通用引擎。由于大多数经典的统计学任务都是基于独立同分布(iid)采用假设构建的,因此很自然可以尝试将 Transformer 用于它们。

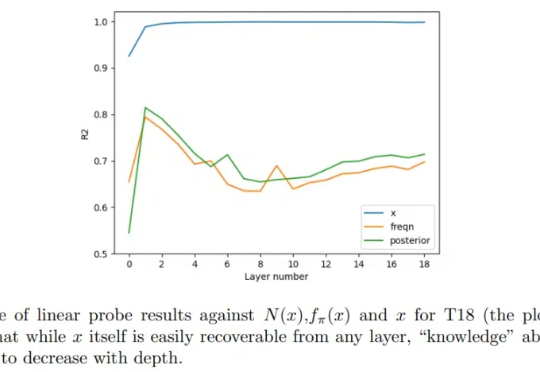

进入到 2025 年,视频生成(尤其是基于扩散模型)领域还在不断地「推陈出新」,各种文生视频、图生视频模型展现出了酷炫的效果。其中,长视频生成一直是现有视频扩散的痛点。

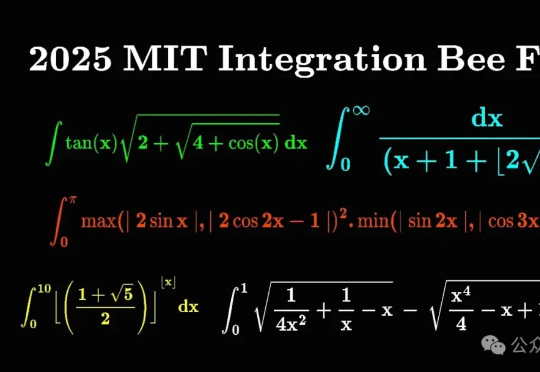

刚刚Grok-3免费开放了!DeepSearch和Think两大模式加持,刚上了热搜的「9.11和9.9哪个大」终于能做对了(但没全对),甚至1分钟秒解MIT积分赛题。然而,它刚一亮相就遭OpenAI研究员「打假」,被对方质疑作弊。

2025全球开发者先锋大会即将重磅开幕!中国首位AGI安全大佬亲临现场,三天精华课程直击AI4S与安全攻防。还有超百亿AI项目招标,直接对项目绝佳机会等你来。

刚刚,阶跃星辰联合吉利汽车集团,开源了两款多模态大模型!新模型共2款:全球范围内参数量最大的开源视频生成模型Step-Video-T2V行业内首款产品级开源语音交互大模型Step-Audio多模态卷王开始开源多模态模型,其中Step-Video-T2V采用的还是最为开放宽松的MIT开源协议,可任意编辑和商业应用。

2月11日,在阿联酋迪拜举办的World Governments Summit 2025峰会上,百度创始人李彦宏与阿联酋AI部长奥马尔·苏丹·奥拉马(Omar Sultan AI Olama)对谈时表示,尽管技术进步、成本降低,但仍需持续投入AI基础设施,以确保处于技术创新的最前沿。

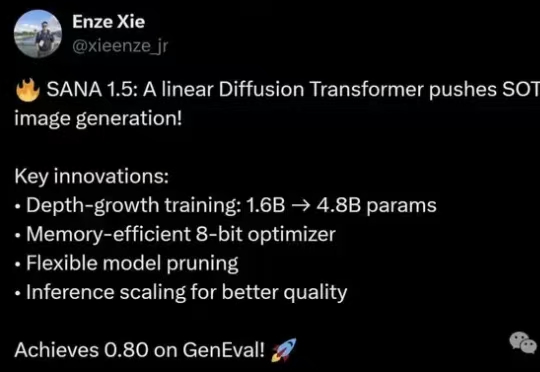

SANA 1.5是一种高效可扩展的线性扩散Transformer,针对文本生成图像任务进行了三项创新:高效的模型增长策略、深度剪枝和推理时扩展策略。这些创新不仅大幅降低了训练和推理成本,还在生成质量上达到了最先进的水平。

最近在网上看多一个说法:中国“AI三杰”都是广东人,但都没有在广东创业和发展。 网友口中的“AI三杰”指的是DeepSeek的创始人梁文锋、Kimi创始人杨植麟、人工智能领域的杰出科学家何恺明.公开资料显示,这三位蜚声全球的AI大牛都很年轻,其中两个是80后、一个是90后,一个在杭州上大学和创业,一个在北京上大学和创业,另一个在美国MIT任教。