深度:AI网红营销平台Aha lab,00后用AI Agent 重塑内容营销,获朱啸虎和锦秋基金投资(指向万亿营销市场)

深度:AI网红营销平台Aha lab,00后用AI Agent 重塑内容营销,获朱啸虎和锦秋基金投资(指向万亿营销市场)00后 Kay Feng 再次创业创立Aha lab,用AI Agent 解决营销中广告主和网红创作者的精准匹配、建联和谈价格问题。获得Product hunt首日日榜冠军,并获得锦秋基金、金沙江创投(朱啸虎)的投资。

00后 Kay Feng 再次创业创立Aha lab,用AI Agent 解决营销中广告主和网红创作者的精准匹配、建联和谈价格问题。获得Product hunt首日日榜冠军,并获得锦秋基金、金沙江创投(朱啸虎)的投资。

继吴永辉担任字节 AI 研发部门 Seed 的负责人后,Seed 组织正在陆续调整。

谷歌现象级产品NotebookLM,两个本科生自学3个月就复刻了?

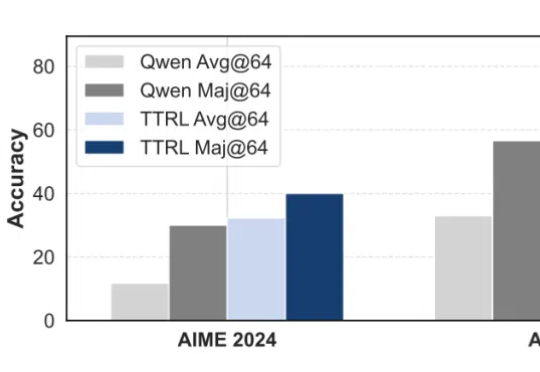

无需数据标注,在测试时做强化学习,模型数学能力暴增159%!

刚刚,清华大模型团队 LeapLab 发布了一款面向 Agent 协作的开源框架:Cooragent。

现在下场做 AI 产品的创业者越来越多,但创业总归是“九死一生”的艰难旅途,我更关心的是,有没有一些有迹可循的办法,能提高成功率?上周,我和一位非典型 AI 创业者——米可世界 AI Lab 的负责人 Simon 聊了一次天,聊出了很多在 AI 创业的宏大叙事中没有的“大实话”,也获得了不少启发。

虽然扩散模型在视频生成领域展现出了卓越的性能,但是视频扩散模型通常需要大量的推理步骤对高斯噪声进行去噪才能生成一个视频。这个过程既耗时又耗计算资源。例如,HunyuanVideo [1] 需要 3234 秒才能在单张 A100 上生成 5 秒、720×1280、24fps 的视频。

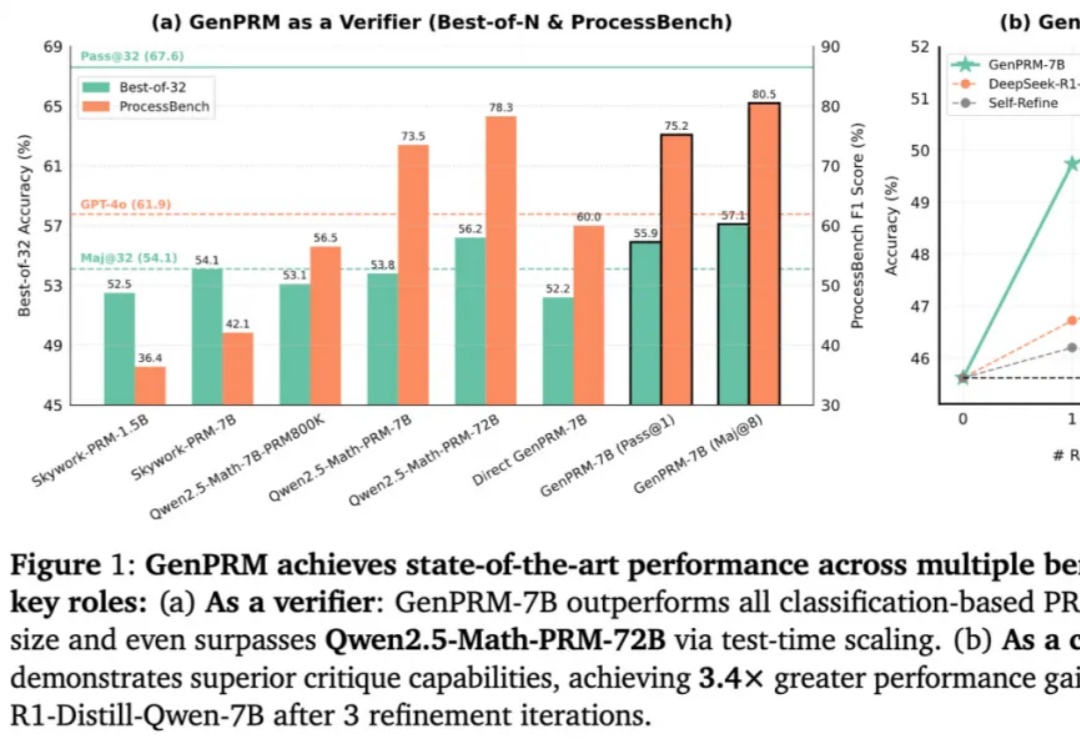

随着 OpenAI o1 和 DeepSeek R1 的爆火,大语言模型(LLM)的推理能力增强和测试时扩展(TTS)受到广泛关注。然而,在复杂推理问题中,如何精准评估模型每一步回答的质量,仍然是一个亟待解决的难题。传统的过程奖励模型(PRM)虽能验证推理步骤,但受限于标量评分机制,难以捕捉深层逻辑错误,且其判别式建模方式限制了测试时的拓展能力。

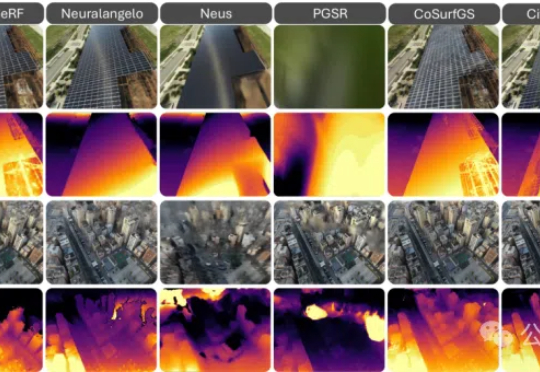

仅用4090就能实现大规模城市场景重建!

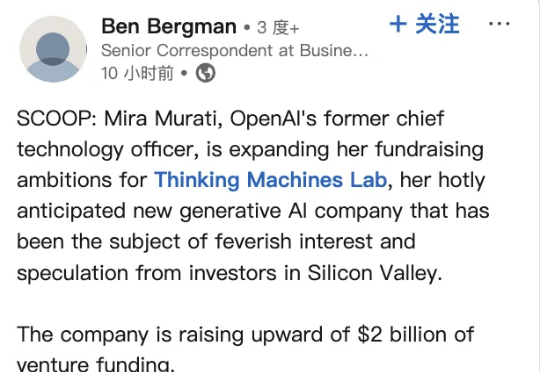

OpenAI前CTO Mira Murati初创公司,正在筹集新融资。20亿美元(折合人民币146亿),还是种子轮!消息称一旦融资完成,Thinking Machines Lab估值将达到超100亿美元。