开源AI拯救Meta一夜飙升1960亿刀,39岁小扎爬出元宇宙深坑!年分红7个亿,靠Llama赢麻了

开源AI拯救Meta一夜飙升1960亿刀,39岁小扎爬出元宇宙深坑!年分红7个亿,靠Llama赢麻了把小扎从元宇宙大坑中拯救出来的,居然是开源AI!市值大涨的Meta,现在能让小扎一年分红7亿美元。股价图一出,LeCun都评论:有意思。

把小扎从元宇宙大坑中拯救出来的,居然是开源AI!市值大涨的Meta,现在能让小扎一年分红7亿美元。股价图一出,LeCun都评论:有意思。

有的大模型对齐方法包括基于示例的监督微调(SFT)和基于分数反馈的强化学习(RLHF)。然而,分数只能反应当前回复的好坏程度,并不能明确指出模型的不足之处。相较之下,我们人类通常是从语言反馈中学习并调整自己的行为模式。

在 AI 赛道中,与动辄上千亿参数的模型相比,最近,小模型开始受到大家的青睐。比如法国 AI 初创公司发布的 Mistral-7B 模型,其在每个基准测试中,都优于 Llama 2 13B,并且在代码、数学和推理方面也优于 LLaMA 1 34B。

2B性能小钢炮来了!刚刚,面壁智能重磅开源了旗舰级端侧多模态模型MiniCPM,2B就能赶超Mistral-7B,还能越级比肩Llama2-13B。成本更是低到炸裂,170万tokens成本仅为1元!

羊驼家族的“最强开源代码模型”,迎来了它的“超大杯”——就在今天凌晨,Meta宣布推出Code Llama的70B版本。

删除权重矩阵的一些行和列,让 LLAMA-2 70B 的参数量减少 25%,模型还能保持 99% 的零样本任务性能,同时计算效率大大提升。这就是微软 SliceGPT 的威力。

Meta 正式发布 Code Llama 70B,这是 Code Llama 系列有史以来最大、性能最好的型号。

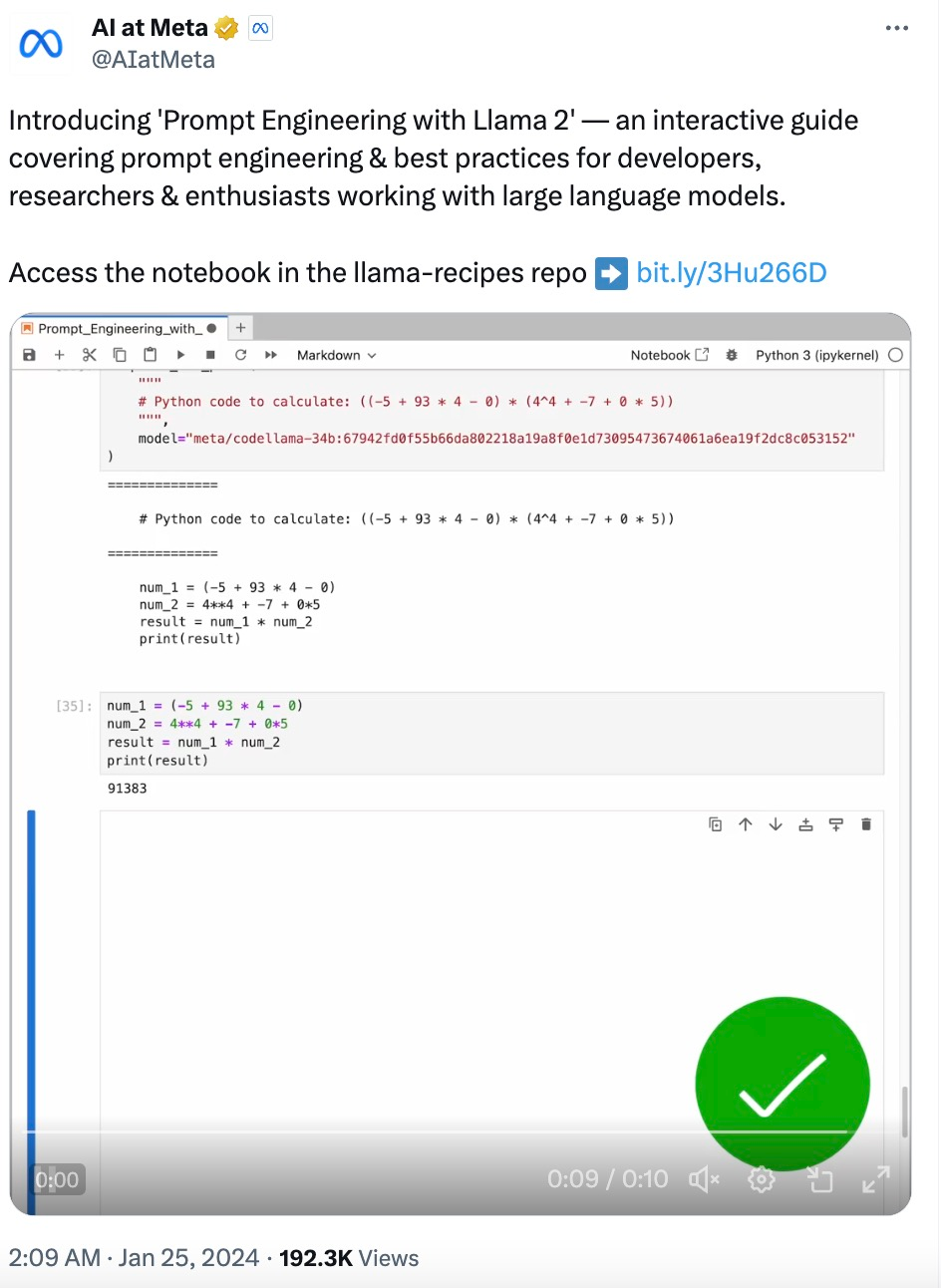

随着大型语言模型(LLM)技术日渐成熟,提示工程(Prompt Engineering)变得越来越重要。一些研究机构发布了 LLM 提示工程指南,包括微软、OpenAI 等等。

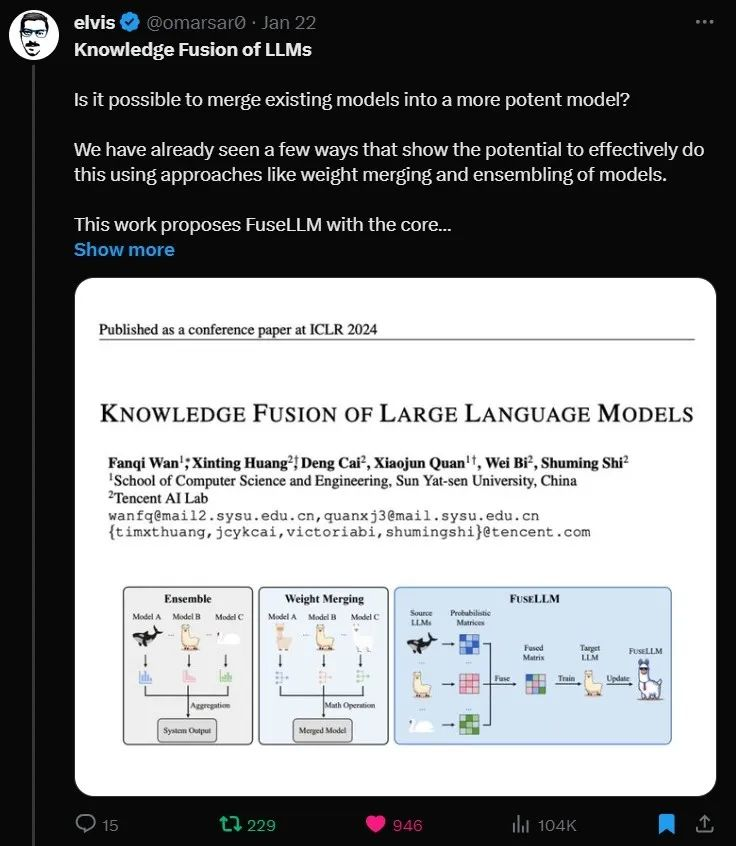

融合多个异构大语言模型,中山大学、腾讯 AI Lab 推出 FuseLLM

1月18日,马克·扎克伯格宣布,Meta正在计划构建自己的AGI(通用人工智能),将在绝大多数领域中都达到或超越人类智能水平。同时他强调,保证会向大众开放这一技术,以便人人都能从中获益。