百倍提升7B模型推理能力!颜水成团队携手新加坡南洋理工大学发布Q*算法

百倍提升7B模型推理能力!颜水成团队携手新加坡南洋理工大学发布Q*算法近日,一篇出自中国团队之手的AI论文在外网引发热议。论文中,研究团队提出了Q*模型算法,帮助Llama-2-7b等小模型达到参数量比其大数十倍、甚至上百倍模型的推理能力,使模型性能迎来惊人提升。

近日,一篇出自中国团队之手的AI论文在外网引发热议。论文中,研究团队提出了Q*模型算法,帮助Llama-2-7b等小模型达到参数量比其大数十倍、甚至上百倍模型的推理能力,使模型性能迎来惊人提升。

是时候把数据Scale Down了!Llama 3揭示了这个可怕的事实:数据量从2T增加到15T,就能大力出奇迹,所以要想要有GPT-3到GPT-4的提升,下一代模型至少还要150T的数据。好在,最近有团队从CommonCrawl里洗出了240T数据——现在数据已经不缺了,但你有卡吗?

排名超过Llama-3-70B,英伟达Nemotron-4 340B问鼎竞技场最强开源模型!

潞晨 Open-Sora 团队在 720p 高清文生视频质量和生成时长上实现了突破性进展,支持无缝产出任意风格的高质量短片,令人惊喜的是,他们选择再给开源社区带来亿点点震撼,继续全部开源。

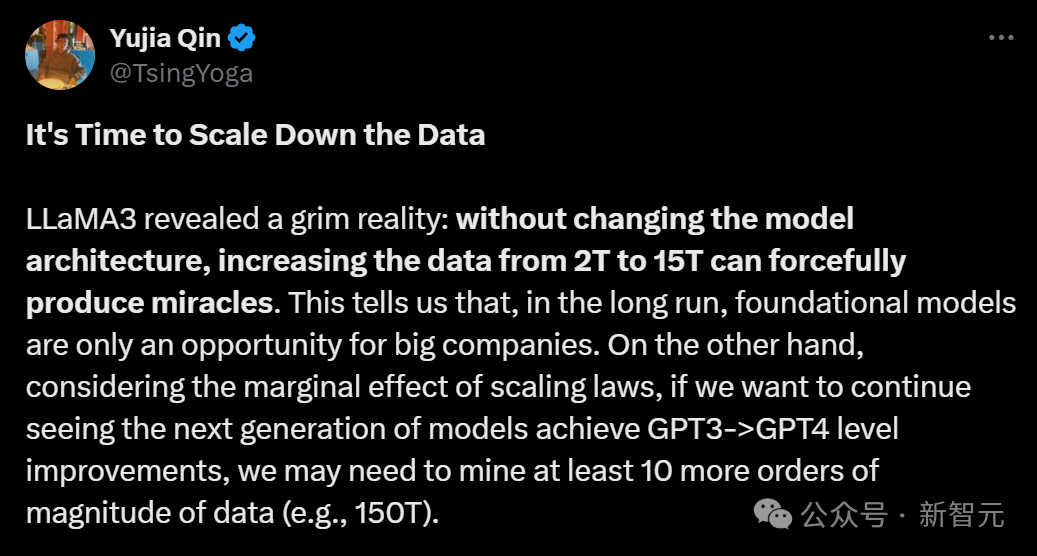

只要1/200的参数,就能让大模型拥有和GPT-4一样的数学能力? 来自复旦和上海AI实验室的研究团队,刚刚研发出了具有超强数学能力的模型。 它以Llama 3为基础,参数量只有8B,却在奥赛级别的题目上取得了比肩GPT-4的准确率。

通过算法层面的创新,未来大语言模型做数学题的水平会不断地提高。

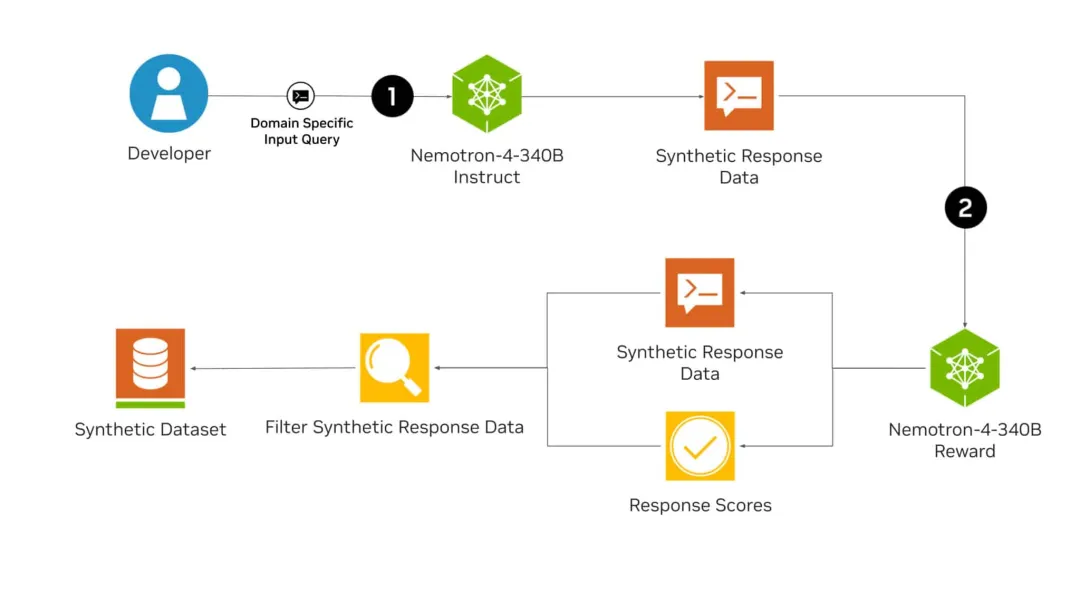

刚刚,英伟达全新发布的开源模型Nemotron-4 340B,有可能彻底改变训练LLM的方式!从此,或许各行各业都不再需要昂贵的真实世界数据集了。而且,Nemotron-4 340B直接超越了Mixtral 8x22B、Claude sonnet、Llama3 70B、Qwen 2,甚至可以和GPT-4掰手腕!

一年一度的国内「AI 春晚」—— 智源大会又一次拉开了序幕。

性能超越 Llama-3,主要用于合成数据。

本周五,一年一度的AI春晚“北京智源大会”正式开幕。本次大会AI明星浓度,放在全球范围内可能也是独一份:OpenAI Sora负责人Aditya Ramesh作为神秘嘉宾进行了分享,并接受了DiT作者谢赛宁的“拷问”、李开复与张亚勤炉边对话AGI、还集齐了国内大模型“四小龙”,百川智能CEO王小川、智谱AI CEO张鹏、月之暗面CEO杨植麟、面壁智能CEO李大海…… 这还只是第一天上午的开幕式。