【深度】通向AGI的钥匙:10万H100超级AI算力集群

【深度】通向AGI的钥匙:10万H100超级AI算力集群10万张H100卡构成的超级AI算力集群就像是现代人类文明的奇观,是人类通向AGI的钥匙。AI时代的军备竞赛已经拉开帷幕,赌注是天量的Capex支出,胜者则有机会成为AI时代的造物主。

10万张H100卡构成的超级AI算力集群就像是现代人类文明的奇观,是人类通向AGI的钥匙。AI时代的军备竞赛已经拉开帷幕,赌注是天量的Capex支出,胜者则有机会成为AI时代的造物主。

全美TOP 5的机器学习博士痛心发帖自曝,自己实验室里H100数目是0!这也引起了ML社区的全球网友大讨论。显然,相比普林斯顿、哈佛这样动辄三四百块H100的GPU大户,更常见的是GPU短缺的「穷人」。同一个实验室的博士,甚至时常会出现需要争抢GPU的情况。

在中文互联网上,英伟达每天都在被颠覆。绝大部分自媒体和短视频达人都讨厌英伟达,包括周鸿祎在内。他们千方百计地指出,某种替代品(不管是不是国产)的性能指标已经超过英伟达A100或H100,后者即将沦为资本市场历史上最大的泡沫云云。尤其是在B站、小红书这样的平台,“英伟达将迅速被替代”可以被视为一致观点,反对这个观点的人将遭到群嘲。

可在单张A100/H100 GPU或TPU主机上高效运行全精度推理。

谷歌开源模型Gemma 2开放了! 虽然前段时间Google I/O大会上,Gemma 2开源的消息就已经被放出,但谷歌还留了个小惊喜—— 除27B模型外,还有一个更轻的9B版本。 DeepMind创始人哈萨比斯表示,27B参数规模下,Gemma 2提供了同类模型最强性能,甚至还能与其两倍大的模型竞争。

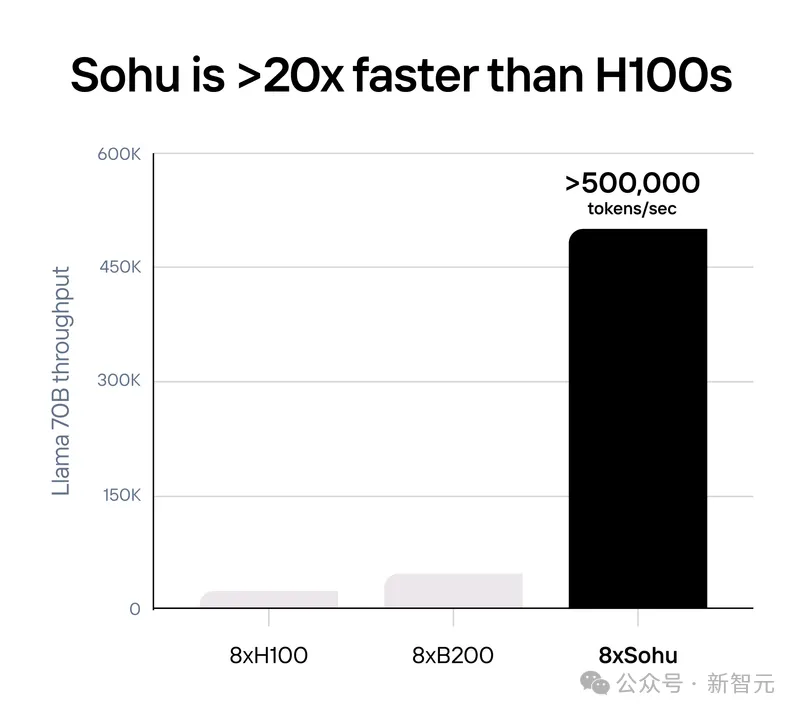

史上最快Transformer芯片诞生了!用Sohu跑Llama 70B,推理性能已超B200十倍,超H100二十倍!刚刚,几位00后小哥从哈佛辍学后成立的公司Etached,宣布再融资1.2亿美元。

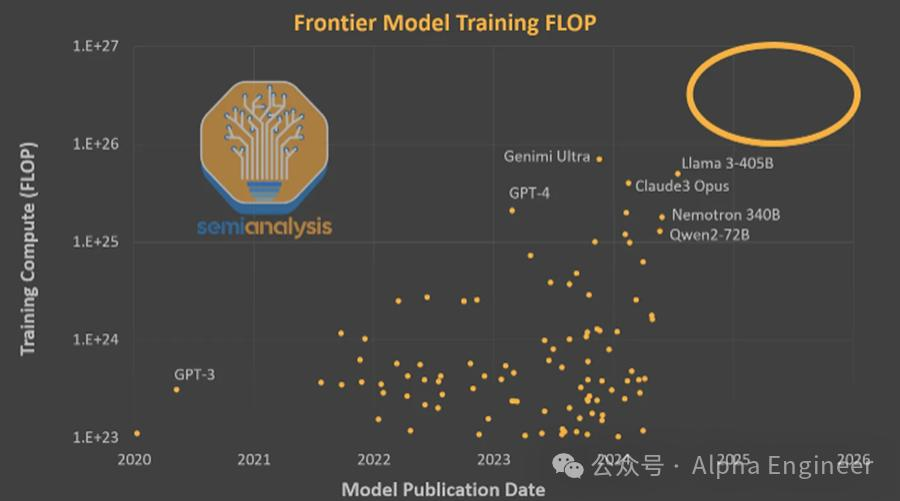

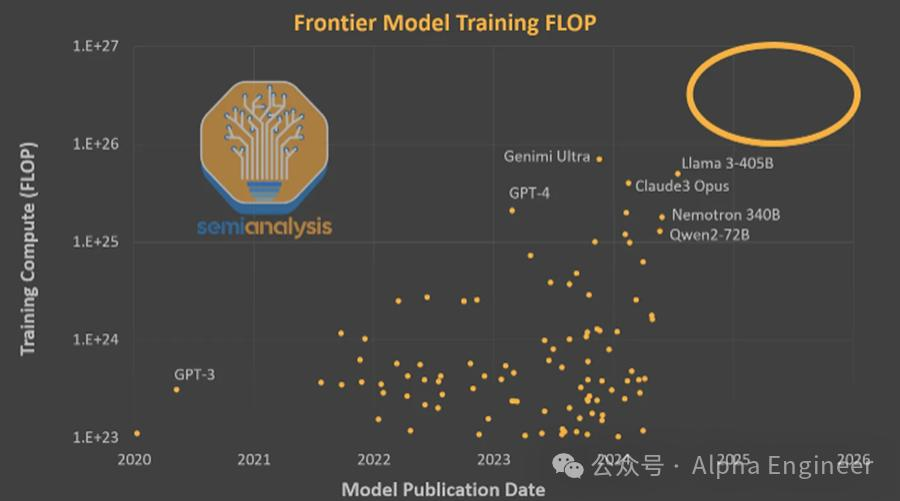

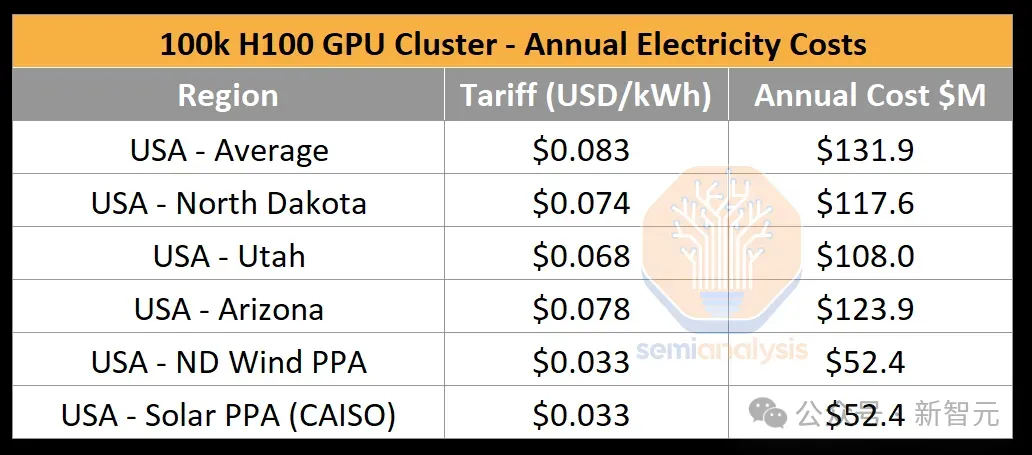

在英伟达市值猛涨、各家科技巨头囤芯片的热潮中,我们往往会忽视GPU芯片是如何转变为数据中心算力的。最近,一篇SemiAnalysis的技术文章就深入解读了10万卡H100集群的构建过程。

AI算力资源越发紧张的当下,斯坦福新研究将GPU运行效率再提升一波——

马斯克:到年底算力将拥有8.5万块H100

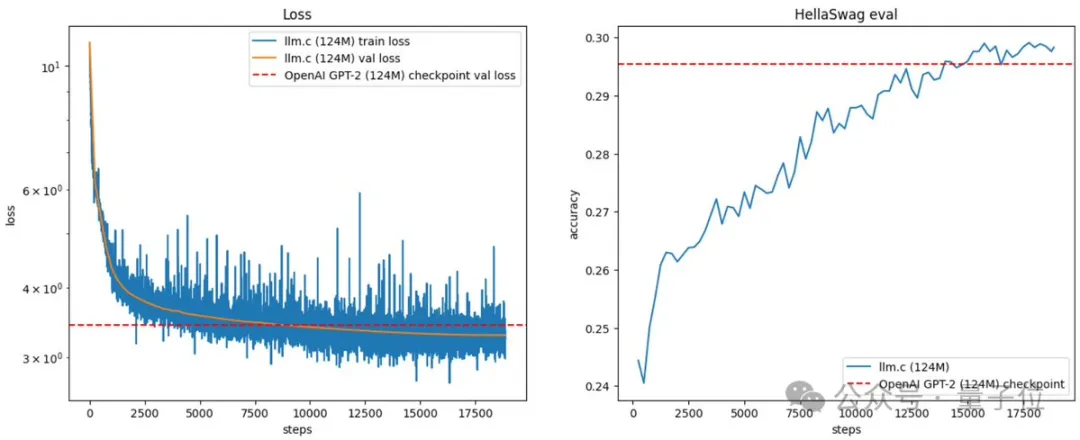

大神Karpathy已经不满足于用C语言造Llama了! 他给自己的最新挑战:复现OpenAI经典成果,从基础版GPT-2开始。