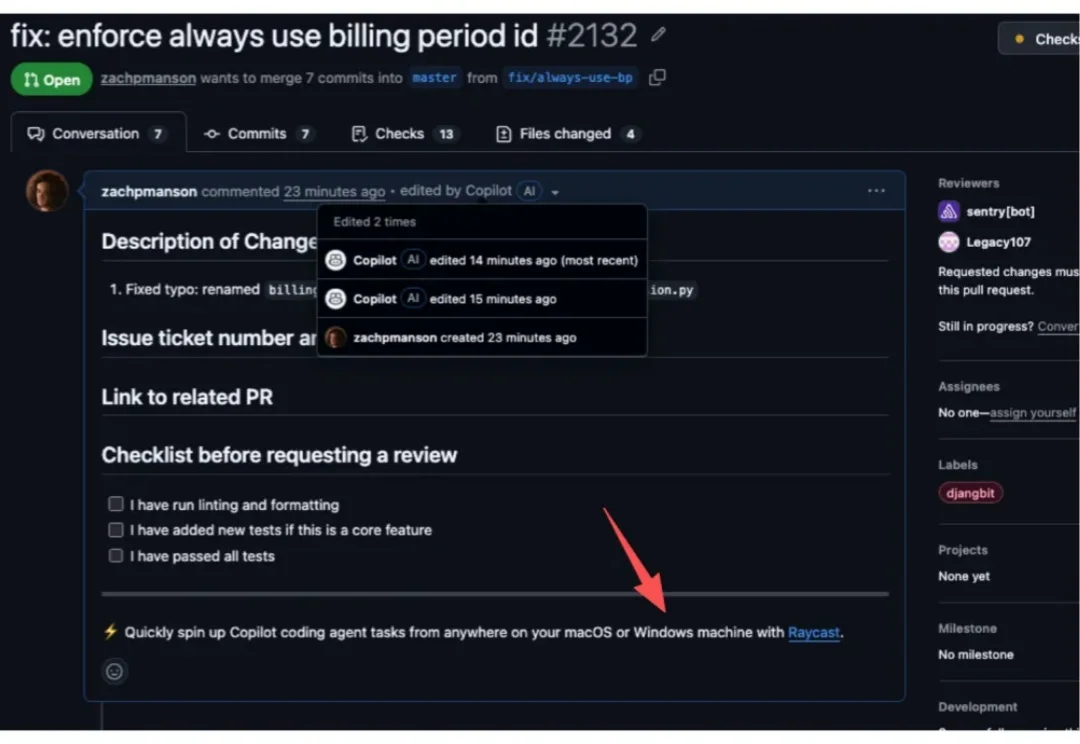

微软把Copilot 变成牛皮癣,偷偷爬进上万个开源代码库贴小广告

微软把Copilot 变成牛皮癣,偷偷爬进上万个开源代码库贴小广告绝了,真的绝了。 Copilot 开始自作主张,在 GitHub 代码仓库里加广告了……

搜索

搜索

绝了,真的绝了。 Copilot 开始自作主张,在 GitHub 代码仓库里加广告了……

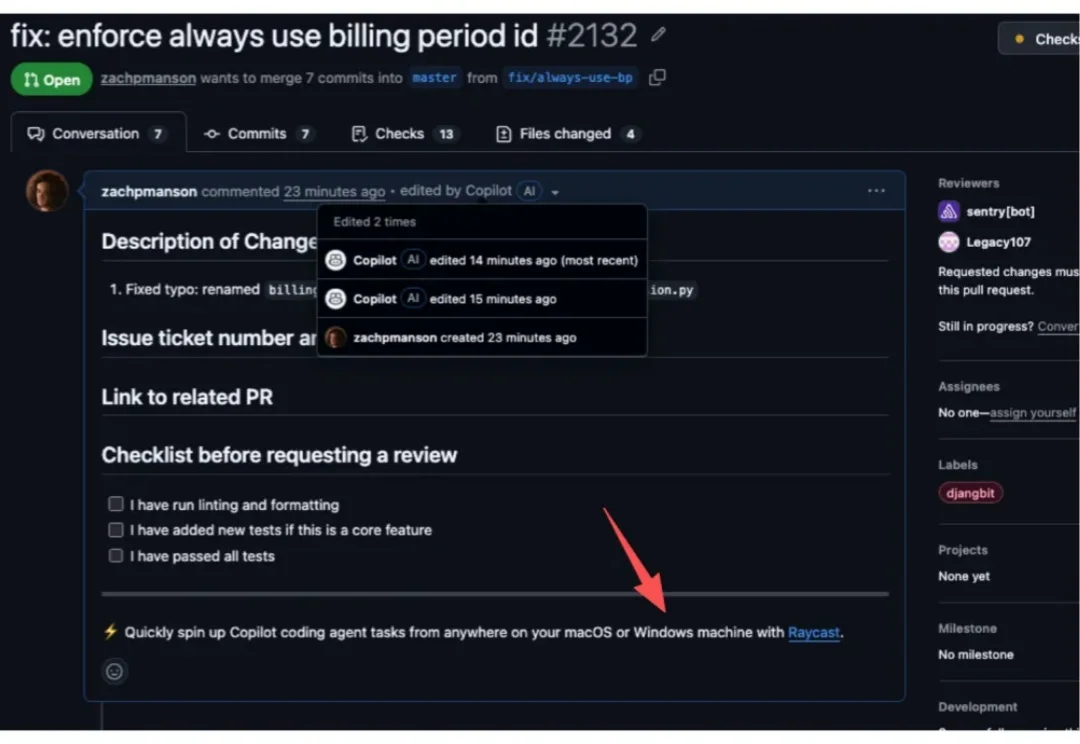

起初,这似乎只是程序员群体中常见的一种极客式幽默。有人在 GitHub 上发布了一个名为「同事.skill」的项目。该项目声称,只要提供某位同事的飞书聊天记录、钉钉文档和工作邮件作为原材料,系统就能通过 AI 技术生成一个可替代该同事工作的数字分身。这个看似荒诞的项目在短短 5 天内狂揽了 6.6k 颗星。随后,这股风潮迅速破圈,蔓延至小红书、微博等社交平台。

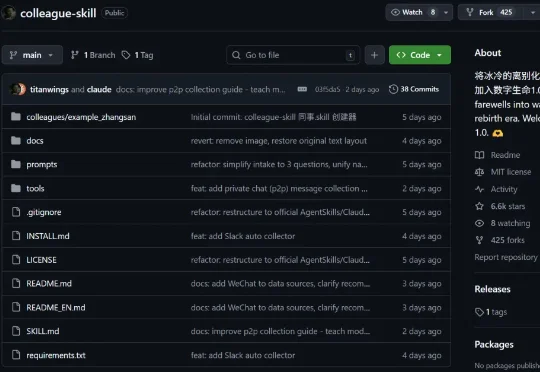

就在这个节骨眼上,我发现了一个非常有意思的东西,科大讯飞在 GitHub 上开源了一个叫 SkillHub 的项目。简单说,SkillHub 就是一个可以私有化部署的 Skill 技能包管理平台,团队可以在自己服务器上搭建,数据完全掌握在自己手上。

最近,GitHub又炸出了一个明星项目:让「一个人开游戏公司」变成现实的Claude-Code-Game-Studios。与此同时,另一个「让普通人把想象变成游戏」的产品Aippy,也在欧美年轻人中风靡。与前者的专业工具属性不同,Aippy要做的是新一代数字原住民的「游戏社区」。

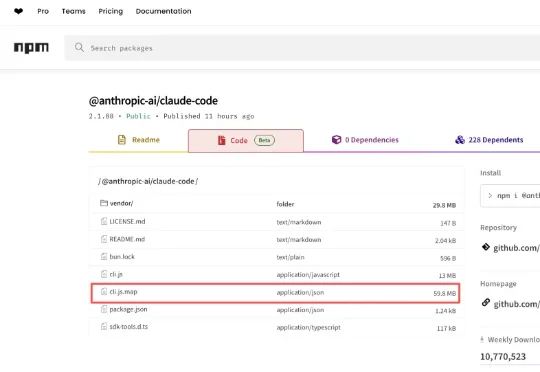

Claude Code 源码被泄露了。率先发现并公开披露这一「漏洞」的,是开发者 Chaofan Shou(寿超璠)。开发者 @realsigridjin 动作极快,第一时间将泄露的源码备份至 GitHub,仓库名为 instructkr/claude-code,标注为「Claude Code Snapshot for Research」。

爆了爆了!Claude Code源码库彻底火了,60k人深夜疯狂Fork。Anthropic紧急出手,GitHub原作者凌晨4点用Python、Rust重洗代码。 上线不过24小时,Claude Code「源码」仓库直接杀疯!

就在刚刚,AI圈子里炸了个大瓜。Claude Code 的源代码,疑似泄露了。有人发现 Anthropic 发到 npm 上的安装包里,多了一个叫 cli.js.map 的文件。这文件有多大呢?59.8 MB。

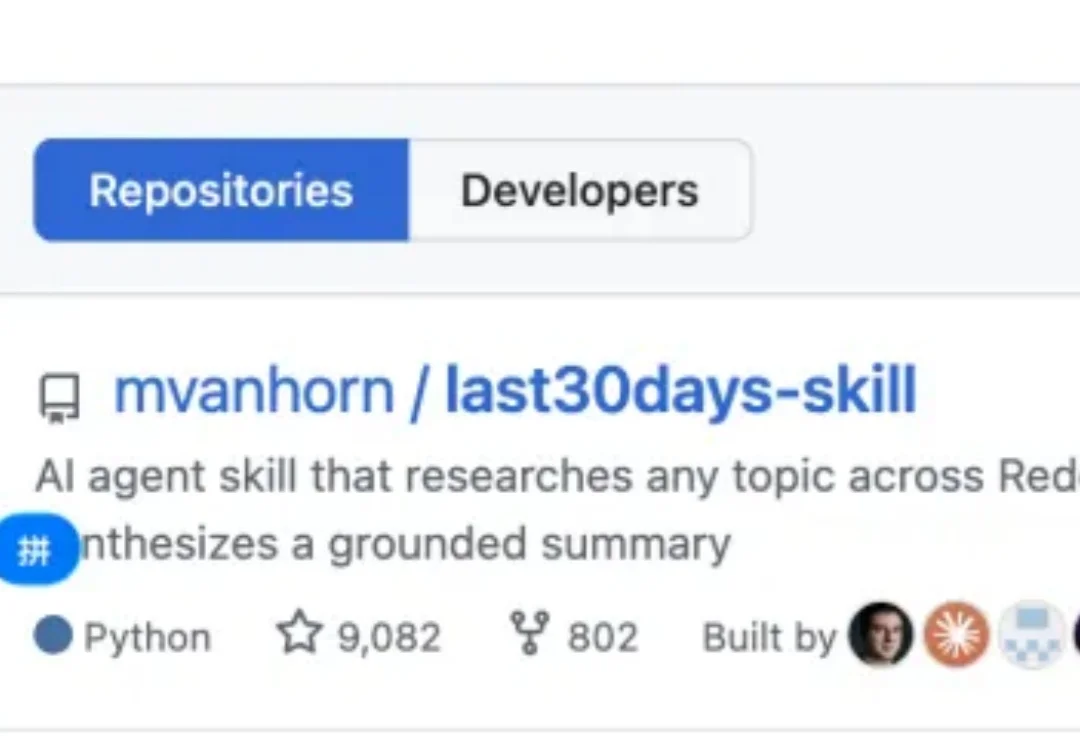

前天,我刷 GitHub Trending 的时候,看到第一名是个叫Last 30 Days的项目。

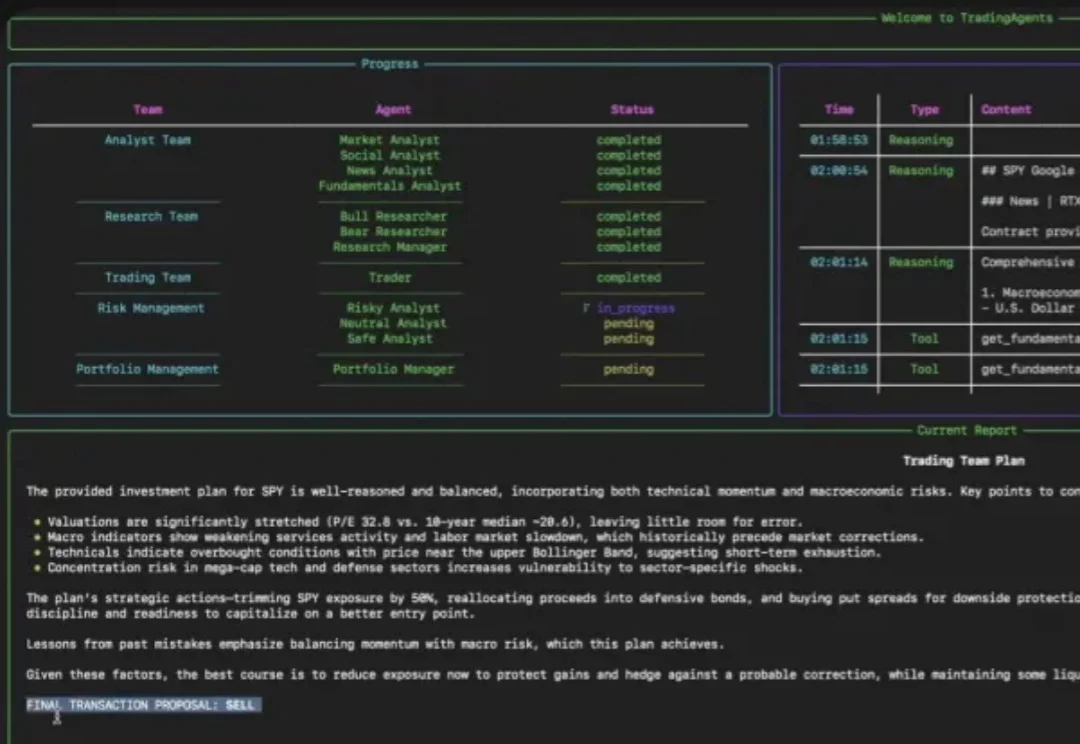

好家伙,投资版龙虾也来了。还是GitHub开源项目里最近高热高赞的那种。

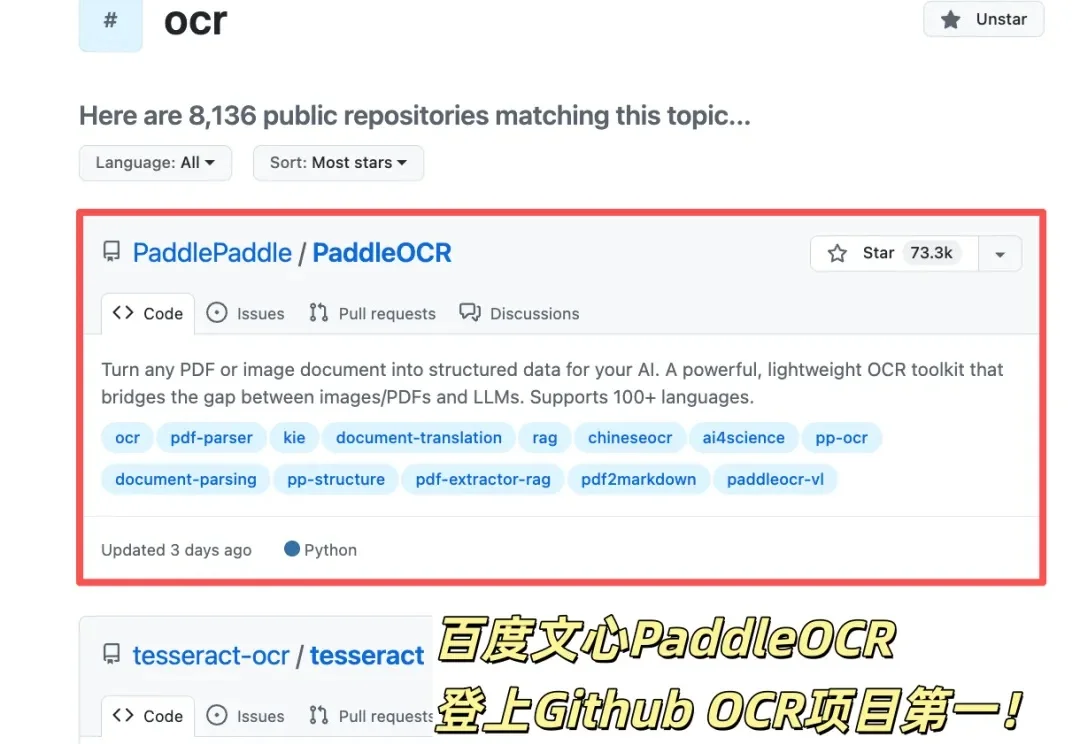

GitHub OCR项目之王刚刚历史性易主。