AI算力提高,高能耗和难散热问题如何突破?

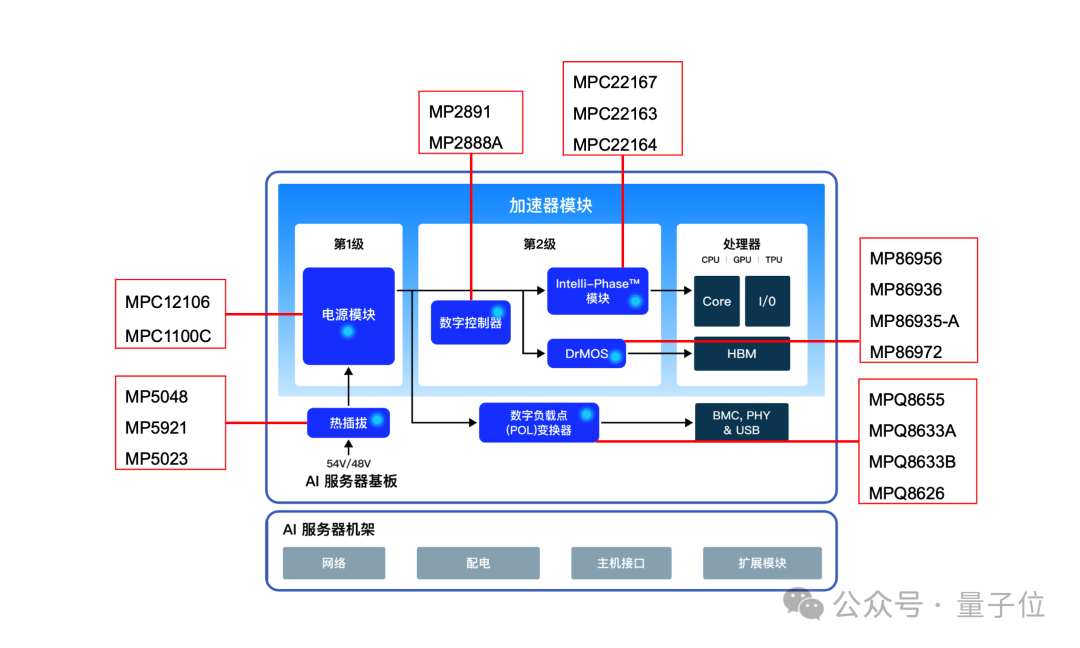

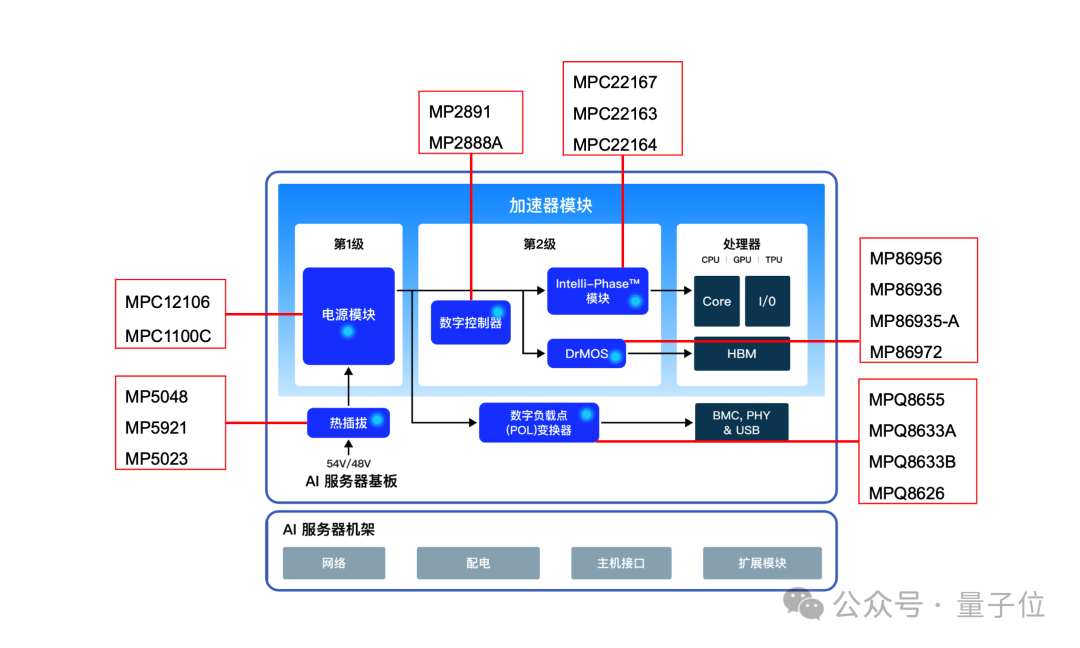

AI算力提高,高能耗和难散热问题如何突破?随着AI技术的广泛应用,从智能手机到自动驾驶汽车,从智能家居到工业自动化,AI供电芯片的需求量正呈爆炸式增长。它不仅为AI系统提供稳定的电力供应,确保系统的正常运行,而且还肩负着节能减排、降低能耗的重任。

随着AI技术的广泛应用,从智能手机到自动驾驶汽车,从智能家居到工业自动化,AI供电芯片的需求量正呈爆炸式增长。它不仅为AI系统提供稳定的电力供应,确保系统的正常运行,而且还肩负着节能减排、降低能耗的重任。

不降低大模型算法精度,还能把芯片的算力利用效率提升 2~10 倍,这就是编译器的魅力。

算力供需平衡预计到2030年才能实现

近日,天才程序员Justine Tunney发推表示自己更新了Llamafile的代码,通过手搓84个新的矩阵乘法内核,将Llama的推理速度提高了500%!

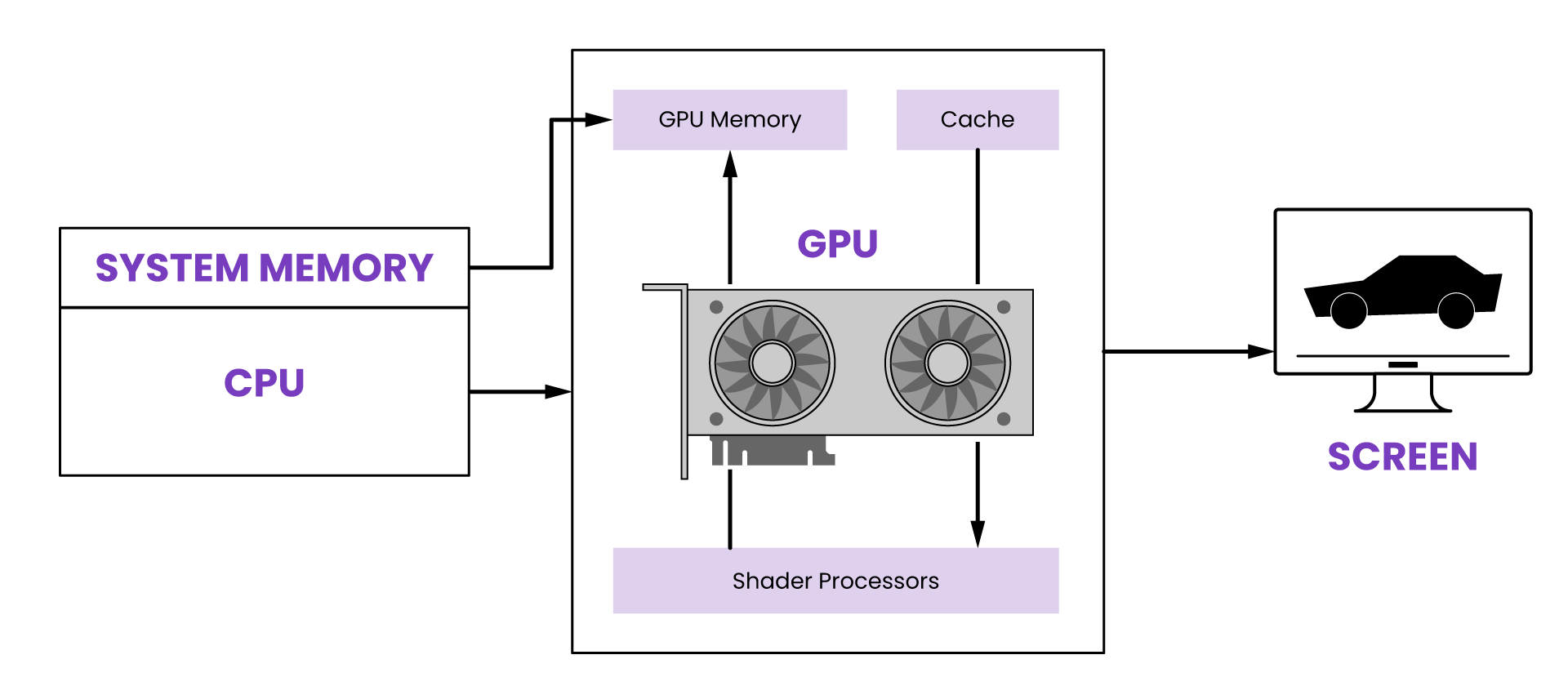

【新智元导读】老黄新GPU深夜炸场,超高规格的背后也付出了不小的代价,小编带大家深入了解一下新架构的硬件细节和成本,新显卡的售价究竟高不高?英伟达也不得不开始卷了

JAX在最近的基准测试中的性能已经不声不响地超过了Pytorch和TensorFlow,也许未来会有更多的大模型诞生在这个平台上。谷歌在背后的默默付出终于得到了回报。

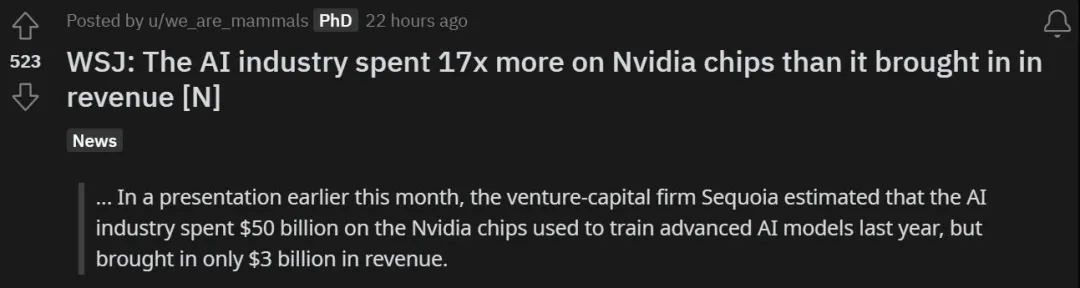

AI程序员Devin上线几周之后,新一轮融资已经达到20亿美元。红杉警告,AI公司买GPU花了500亿,产生的收入只有30亿……

随着生成模型(如 ChatGPT、扩散模型)飞速发展,一方面,生成数据质量越来越高,到了以假乱真的程度;另一方面,随着模型越来越大,也使得人类世界的真实数据即将枯竭。

搞 AI 大模型,实在太烧钱了。我们知道,如今的生成式 AI 有很大一部分是资本游戏,科技巨头利用自身强大的算力和数据占据领先位置,并正在使用先进 GPU 的并行算力将其推广落地。这么做的代价是什么?最近《华尔街日报》一篇有关明星创业公司的报道里给出了答案:投入是产出的 17 倍。