大模型进入「实用」时代,亚马逊云科技已是Next Level

大模型进入「实用」时代,亚马逊云科技已是Next Level在云计算领域竞争最激烈的时代,亚马逊云科技曾提出,云计算的普惠是技术升级带来的。这个说法换到如今的生成式 AI 时代也是成立的。

在云计算领域竞争最激烈的时代,亚马逊云科技曾提出,云计算的普惠是技术升级带来的。这个说法换到如今的生成式 AI 时代也是成立的。

OpenAI今日官宣,ChatGPT正式向所有用户免费开放!所有用户均可以访问定制化GPT、分析图表、询问有关照片的问题以及5月初GPT-4o添加的其他功能。

就在刚刚,法国AI初创公司Mistral发布了自家首款代码生成模型Codestral。不仅支持32K长上下文窗口以及80多种编程语言,而且还用22B的参数量取得了与70B的Llama 3相近的性能。目前,已经开放API与IDE插件供用户使用。

高质量图像编辑的方法有很多,但都很难准确表达出真实的物理世界。 那么,Edit the World试试。

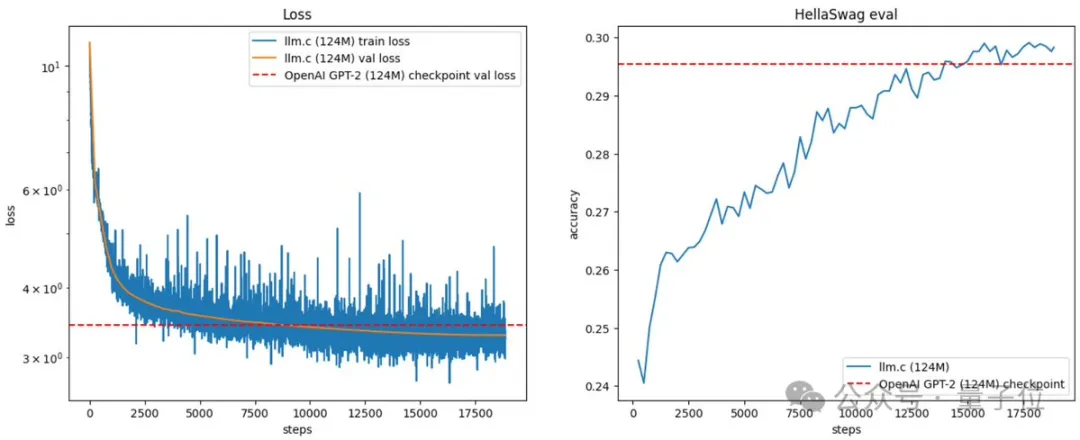

大神Karpathy已经不满足于用C语言造Llama了! 他给自己的最新挑战:复现OpenAI经典成果,从基础版GPT-2开始。

当地时间5月26日,马斯克旗下的人工智能初创公司xAI宣布完成B轮60亿美元融资。主要的投资者包括 Valor Equity Partners、Vy Capital、Andreessen Horowitz、红杉资本等。

OpenAI 开始训练下一个前沿模型了。在联合创始人、首席科学家 Ilya Sutskever 官宣离职、超级对齐团队被解散之后,OpenAI 研究的安全性一直备受质疑。

这是一次「反向图灵测试」,几个全球最先进的大模型坐在一起,坐着火车唱着歌,但其中混进了人类:而 AI 的任务,是把这个人类揪出来。

斯坦福大学的研究人员研究了RAG系统与无RAG的LLM (如GPT-4)相比在回答问题方面的可靠性。研究表明,RAG系统的事实准确性取决于人工智能模型预先训练的知识强度和参考信息的正确性。

出走OpenAI的超级对齐团队负责人Jan Leike,刚刚官宣了自己加入Anthropic的消息,并且开始高调招兵买马。同时,外界也开始对Ilya的去向纷纷猜测:是去Anthropic,xAI,还是自立门户?