52页PPT,谷歌Gemini预训练负责人首次揭秘!扩展定律最优解

52页PPT,谷歌Gemini预训练负责人首次揭秘!扩展定律最优解大模型之战烽火正酣,谷歌Gemini 2.5 Pro却强势逆袭!Gemini Flash预训练负责人亲自揭秘,深挖Gemini预训练的关键技术,看谷歌如何在模型大小、算力、数据和推理成本间找到最优解。

大模型之战烽火正酣,谷歌Gemini 2.5 Pro却强势逆袭!Gemini Flash预训练负责人亲自揭秘,深挖Gemini预训练的关键技术,看谷歌如何在模型大小、算力、数据和推理成本间找到最优解。

多模态大模型几何解题哪家强?

AI 编程助手的不断升级,让越来越多开发者将它们融入实际项目流程中。然而,不同模型与工具之间的体验差异,往往让人又爱又恨。本文作者在尝试用 Claude 开发游戏并为此付出 417美元后,再次挑战使用 Gemini 2.5 + Cursor 打造新作——而这一次,不仅完全免费,整体开发体验也“大幅超预期”。

核心主角依然是Gemini。

谷歌的AI编码能力正在掀起一场风暴!在高尔顿板测试中,Gemini 2.5 Flash以惊艳表现击败OpenAI多款模型,连谷歌首席科学家Jeff Dean都为其点赞。谷歌新模型「dayhush」已在网页开发领域崭露头角,性能超越Gemini 2.5 Pro,被网友称为「AI编码的地震性突破」。

谷歌 Gemma 3 上线刚刚过去一个月,现在又出新版本了。

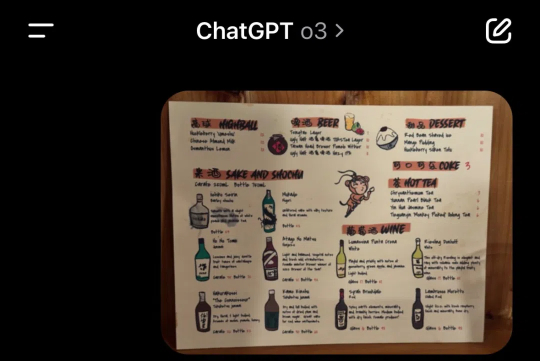

AI智商再创新高!OpenAI o3以惊人的136分刷新门萨智商测试纪录,超越不久前登顶的Gemini 2.5 Pro。更令人瞩目的是其强大的图像理解能力:仅凭一张无EXIF信息的菜单或风景照,o3就能精准推理并反向定位拍摄地点,引发了用AI玩「照片寻址(GeoGuessr)」的新热潮。

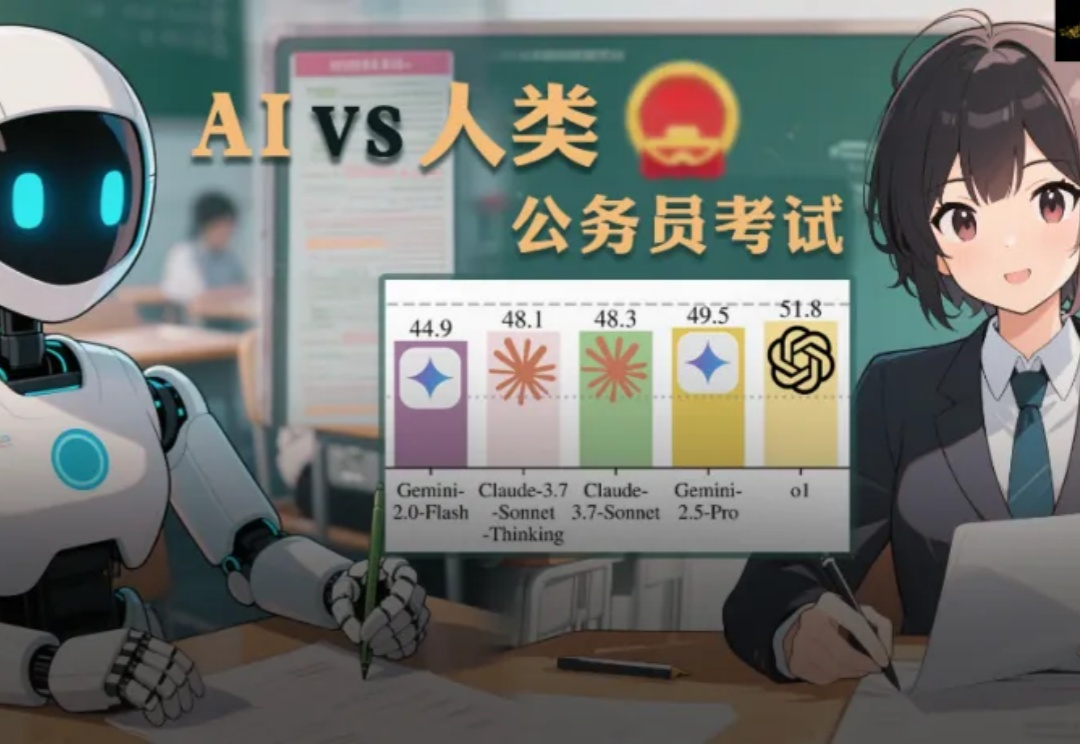

公考行测中的逻辑推理题,是不少考生的噩梦,这次,CMU团队就此为基础,打造了一套逻辑谜题挑战。实测后发现,o1、Gemini-2.5 Pro、Claude-3.7-Sonnet这些顶尖大模型全部惨败!最强的AI正确率也只有57.5%,而人类TOP选手却能接近满分。

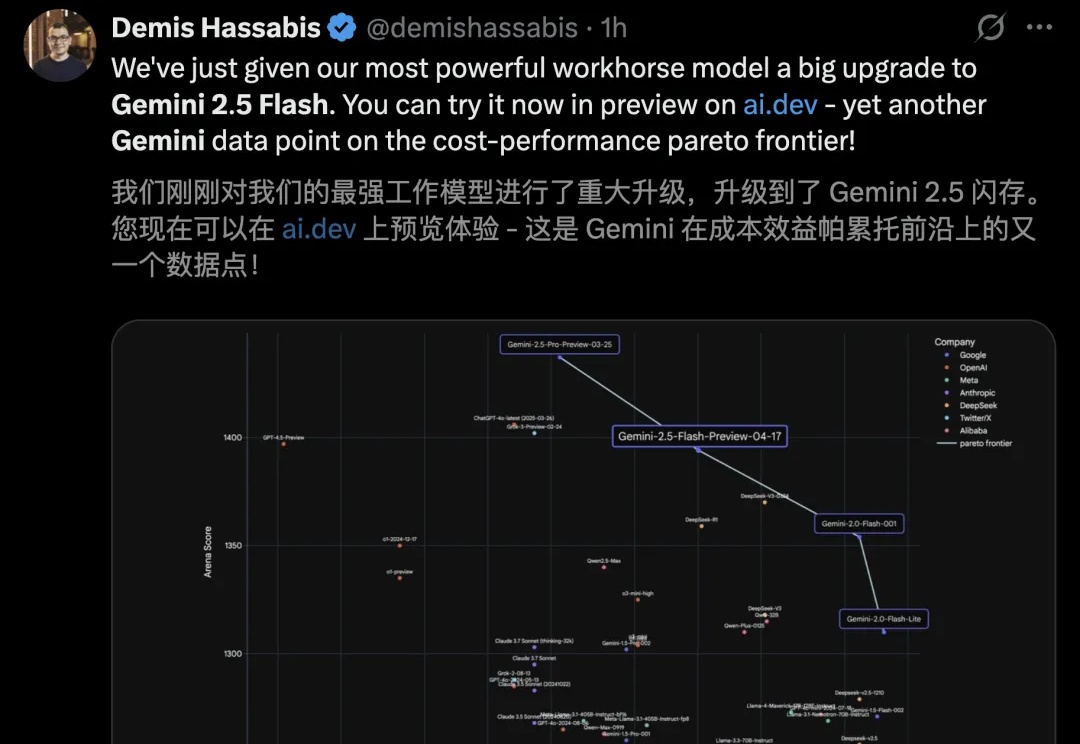

谷歌发布首款混合推理模型Gemini 2.5 Flash,引入了革命性「思考预算」,可灵活控制推理深度,性能一举击败Claude 3.7,比肩o4-mini。而且,关闭思考模式成本直降600%。

悬疑小说的最后一页,隐藏着罪犯的真相。《逆转裁判》的法庭上,真凶在谎言中露出破绽。UCSD研究团队以这款经典游戏为舞台,o1、Gemini 2.5 Pro等模型化身「侦探」,测试AI的推理极限。