对商户投放ROI负责,这个视频营销Agent底气从何而来?丨对话布尔向量

对商户投放ROI负责,这个视频营销Agent底气从何而来?丨对话布尔向量得益于广阔的市场空间和逐渐加码的政策支持,跨境电商近几年来一直是创业者入局的热门赛道。

得益于广阔的市场空间和逐渐加码的政策支持,跨境电商近几年来一直是创业者入局的热门赛道。

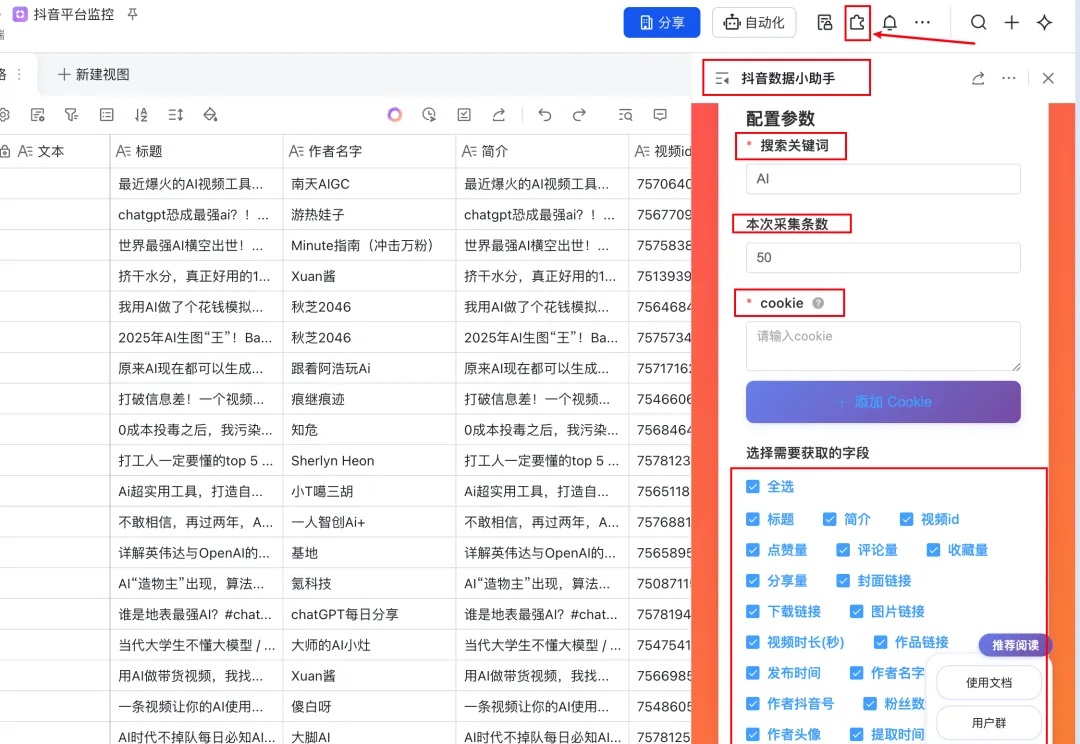

你好,我是袋鼠帝 我最近几乎天天都在用飞书多维表格,使用频率贼高,这玩意儿用起来是真滴爽。

对于谷歌(Google)而言,刚刚过去的一周可以看作其人工智能战略转型的关键节点。随着 Gemini 3 的正式发布,以及名为 Nano Banana Pro 的新模型在社交媒体与开发者社区中迅速走红,这家科技公司正在重新找回自己在 AI 领域的节奏与底气。

在大语言模型(LLM)的研究浪潮中,绝大多数工作都聚焦于优化模型的输出分布 —— 扩大模型规模、强化分布学习、优化奖励信号…… 然而,如何将这些输出分布真正转化为高质量的生成结果 —— 即解码(decoding)阶段,却没有得到足够的重视。

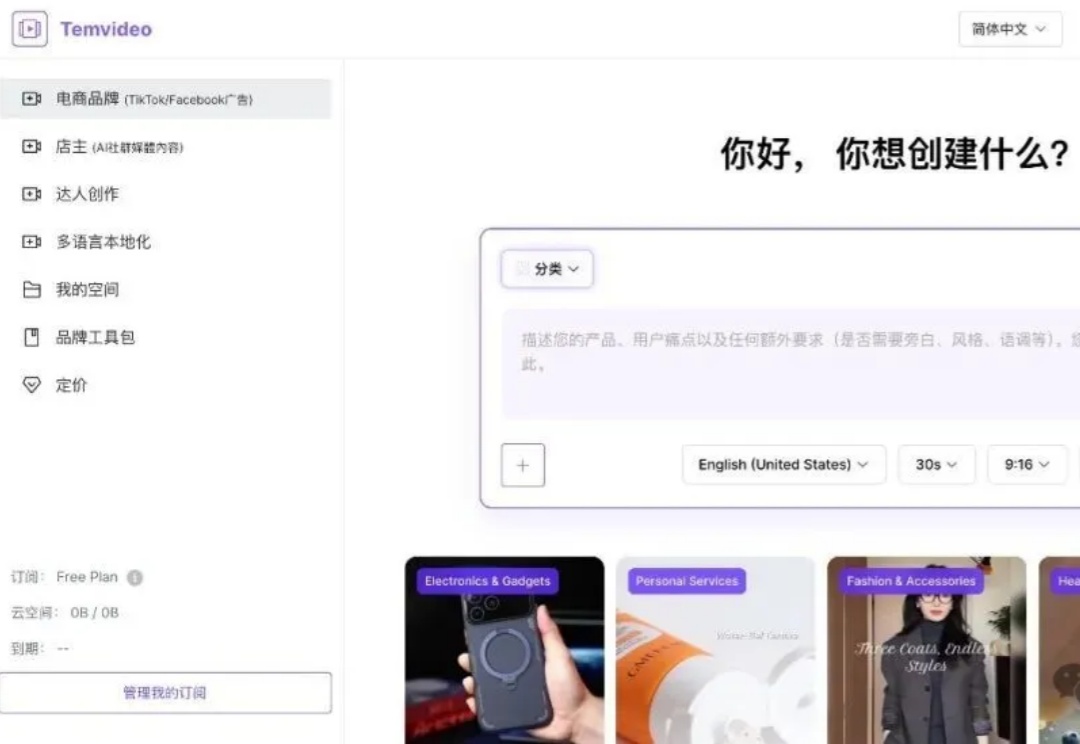

AI 创作 Agent 正在接管过去最耗时的部分。

尽管 Apple Intelligence 在大陆国行机型上落地仍然杳无音讯,但这并不代表苹果没有在努力推进。 前两天,伴随着 iOS 26.1 版本的更新,Apple Intelligence 先一步提供了对于繁体中文的支持。

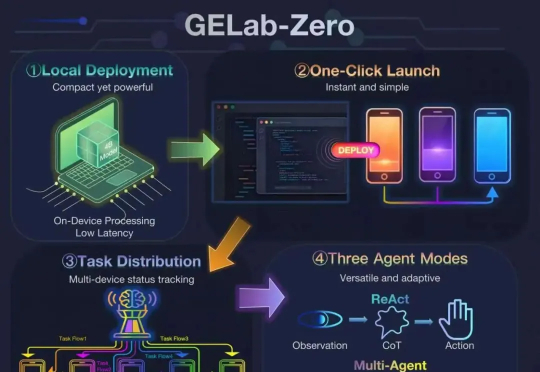

首次将GUI Agent模型与完整配套基建同步开放,支持手搓党一键部署!这就是阶跃星辰刚刚开源的GELab-Zero。其中4B版本的GUI Agent模型在手机端、电脑端等多个GUI榜单上全面刷新同尺寸模型性能纪录,取得SOTA成绩。

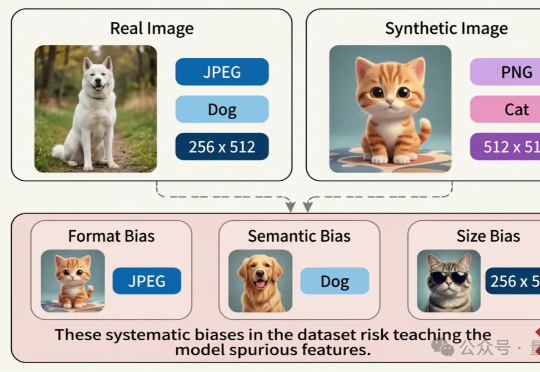

近日,腾讯优图实验室联合华东理工大学、北京大学等研究团队在A生成图像检测(AI-Generated Image Detection)泛化问题上展开研究,提出Dual Data Alignment(双重数据对齐,DDA)方法,从数据层面系统性抑制“偏差特征”,显著提升检测器在跨模型、跨数据域场景下的泛化能力。

中国品牌出海赛道,又多了一笔分量十足的融资消息。中国品牌出海 AI Agent 解决方案企业 北京快牛智营(QuickCEP)宣布完成近亿元融资,本轮由啟赋资本领投,老股东复星锐正超额跟投。融资完成后,QuickCEP 将在巩固跨境电商业务优势的基础上,把服务边界从跨境电商,延展到海外物流、汽车出海、金融出海、游戏出海等更多行业场景,加速其在全球市场的收入增长。

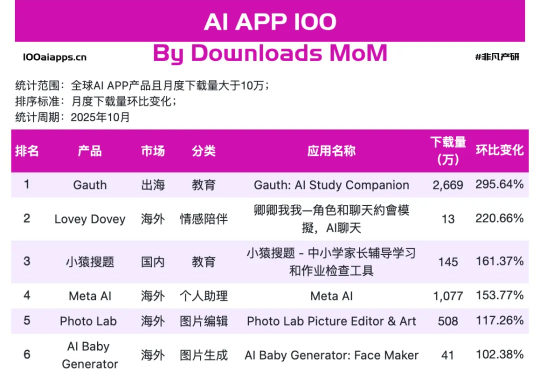

但当我们把视线从焦点模型上,挪到手机里AI应用真实数据上,就会发现一幅不同的画面。可以看到在非凡产研 10 月 AI App 增速榜上,跑得最快的那 17 个,并不是万事皆可聊的通用助手,而是一群看上去有点普通、甚至有点土气的小应用,其中Gauth、Starry、Knowunity、AI Baby Generator已经连续两个月上榜了。